Spark Streaming整合flume和kafka实战

Spark Streaming整合flume实战

flume作为日志实时采集的框架,可以与SparkStreaming实时处理框进行对接,flume实时产生数据,sparkStreaming做实时处理。

Spark Streaming对接FlumeNG有两种方式,一种是FlumeNG将消息Push推给Spark Streaming,还有一种是Spark Streaming从flume 中Poll拉取数据。

Poll方式

(1)安装flume1.6以上

(2)下载依赖包

spark-streaming-flume-sink_2.11-2.0.2.jar放入到flume的lib目录下

(4)写flume的agent,注意既然是拉取的方式,那么flume向自己所在的机器上产数据就行

(5)flume的lib目录下本身自带的scala-library包是2.10的,和我们导入的spark-streaming-flume整合包的版本2.11是不匹配的,所以我们要重新导入图中黄色框中白色包下面的2.11的scala-library包,不然flume启动会产生问题。

(6)编写flume-poll.conf配置文件

a1.sources = r1

a1.sinks = k1

a1.channels = c1

#source

a1.sources.r1.channels = c1

a1.sources.r1.type = spooldir

a1.sources.r1.spoolDir = /root/data

a1.sources.r1.fileHeader = true

#channel

a1.channels.c1.type =memory

a1.channels.c1.capacity = 20000

a1.channels.c1.transactionCapacity=5000

#sinks

a1.sinks.k1.channel = c1

a1.sinks.k1.type = org.apache.spark.streaming.flume.sink.SparkSink

a1.sinks.k1.hostname=hdp-node-01

a1.sinks.k1.port = 8888

a1.sinks.k1.batchSize= 2000

//flume启动命令

flume-ng agent -n a1 -c /opt/software/flume-1.7.0/conf -f /opt/software/flume-1.7.0/conf/flume-conf.properties -Dflume.root.logger=INFO,console

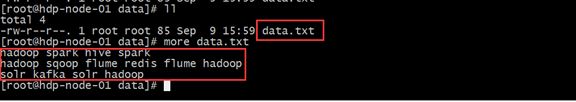

服务器上的 /root/data目录下准备数据文件data.txt

如果收不到数据就修改文件名

(7)启动spark-streaming应用程序,去flume所在机器拉取数据

(8)代码实现

需要添加pom依赖

org.apache.spark

spark-streaming-flume_2.10

2.0.2

org.apache.spark

spark-streaming_2.11

2.0.2

具体代码如下:

package cn.test.spark

import java.net.InetSocketAddress

import org.apache.spark.storage.StorageLevel

import org.apache.spark.streaming.dstream.{DStream, ReceiverInputDStream}

import org.apache.spark.streaming.flume.{FlumeUtils, SparkFlumeEvent}

import org.apache.spark.streaming.{Seconds, StreamingContext}

import org.apache.spark.{SparkConf, SparkContext}

/**

* sparkStreaming整合flume 拉模式Poll

*/

object SparkStreaming_Flume_Poll {

//newValues 表示当前批次汇总成的(word,1)中相同单词的所有的1

//runningCount 历史的所有相同key的value总和

def updateFunction(newValues: Seq[Int], runningCount: Option[Int]): Option[Int] = {

val newCount =runningCount.getOrElse(0)+newValues.sum

Some(newCount)

}

def main(args: Array[String]): Unit = {

//配置sparkConf参数

val sparkConf: SparkConf = new SparkConf().setAppName("SparkStreaming_Flume_Poll").setMaster("local[2]")

//构建sparkContext对象

val sc: SparkContext = new SparkContext(sparkConf)

//构建StreamingContext对象,每个批处理的时间间隔

val scc: StreamingContext = new StreamingContext(sc, Seconds(5))

//设置checkpoint

scc.checkpoint("./")

//设置flume的地址,可以设置多台

val address=Seq(new InetSocketAddress("192.168.200.160",8888))

// 从flume中拉取数据

val flumeStream: ReceiverInputDStream[SparkFlumeEvent] = FlumeUtils.createPollingStream(scc,address,StorageLevel.MEMORY_AND_DISK)

//获取flume中数据,数据存在event的body中,转化为String

val lineStream: DStream[String] = flumeStream.map(x=>new String(x.event.getBody.array()))

//实现单词汇总

val result: DStream[(String, Int)] = lineStream.flatMap(_.split(" ")).map((_,1)).updateStateByKey(updateFunction)

result.print()

scc.start()

scc.awaitTermination()

}

}

park Streaming整合kafka实战

kafka作为一个实时的分布式消息队列,实时的生产和消费消息,这里我们可以利用SparkStreaming实时计算框架实时地读取kafka中的数据然后进行计算。

在spark1.3版本后,kafkaUtils里面提供了两个创建dstream的方法,一种为KafkaUtils.createDstream,另一种为KafkaUtils.createDirectStream。

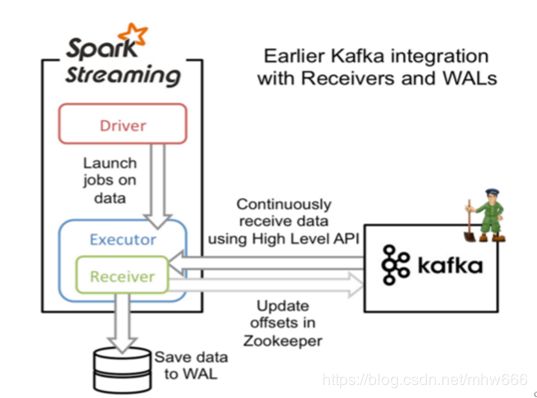

KafkaUtils.createDstream方式

构造函数为KafkaUtils.createDstream(ssc, [zk], [consumer group id], [per-topic,partitions] ) 使用了receivers来接收数据,利用的是Kafka高层次的消费者api,对于所有的receivers接收到的数据将会保存在Spark executors中,然后通过Spark Streaming启动job来处理这些数据,默认会丢失,可启用WAL日志,它同步将接受到数据保存到分布式文件系统上比如HDFS。 所以数据在出错的情况下可以恢复出来 。

A、创建一个receiver来对kafka进行定时拉取数据,ssc的rdd分区和kafka的topic分区不是一个概念,故如果增加特定主消费的线程数仅仅是增加一个receiver中消费topic的线程数,并不增加spark的并行处理数据数量。

B、对于不同的group和topic可以使用多个receivers创建不同的DStream

C、如果启用了WAL(spark.streaming.receiver.writeAheadLog.enable=true)

同时需要设置存储级别(默认StorageLevel.MEMORY_AND_DISK_SER_2),

即KafkaUtils.createStream(….,StorageLevel.MEMORY_AND_DISK_SER)

KafkaUtils.createDstream实战

(1)添加kafka的pom依赖

(必须用这个依赖)

(必须用这个依赖)

(必须用这个依赖)

org.apache.spark

spark-streaming-kafka-0-8_2.11

2.1.0

org.apache.spark

spark-streaming_2.11

2.0.2

(2)启动zookeeper集群

zkServer.sh start

(3)启动kafka集群

kafka-server-start.sh /export/servers/kafka/config/server.properties

(4) 创建topic

kafka-topics.sh --create --zookeeper hdp-node-01:2181 --replication-factor 1 --partitions 3 --topic kafka_spark

(5) 向topic中生产数据

通过shell命令向topic发送消息

kafka-console-producer.sh --broker-list hdp-node-01:9092 --topic kafka_spark

(6)编写Spark Streaming应用程序

package cn.bw.kafka

import org.apache.spark.streaming.dstream.DStream

import org.apache.spark.streaming.kafka.KafkaUtils

import org.apache.spark.streaming.{Seconds, StreamingContext}

import org.apache.spark.{SparkConf, SparkContext}

import scala.collection.immutable

//todo:利用sparkStreaming接受kafka中的数据实现单词计数----采用receivers

object SparkStreamingKafka_Receiver_checkpoint {

def updateFunc(a:Seq[Int], b:Option[Int]) :Option[Int] ={

Some(a.sum+b.getOrElse(0))

}

def main(args: Array[String]): Unit = {

val checkpointPath = "./kafka-receiver"

val ssc = StreamingContext.getOrCreate(checkpointPath, () => {

createFunc(checkpointPath)

})

ssc.start()

ssc.awaitTermination()

}

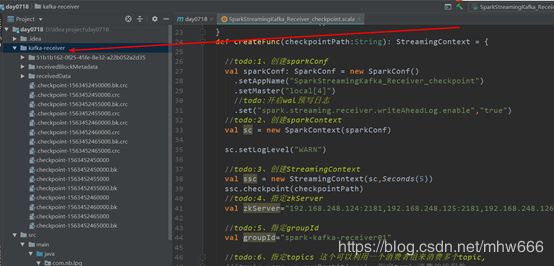

def createFunc(checkpointPath:String): StreamingContext = {

//todo:1、创建sparkConf

val sparkConf: SparkConf = new SparkConf()

.setAppName("SparkStreamingKafka_Receiver_checkpoint")

.setMaster("local[4]")

//todo:开启wal预写日志

.set("spark.streaming.receiver.writeAheadLog.enable","true")

//todo:2、创建sparkContext

val sc = new SparkContext(sparkConf)

sc.setLogLevel("WARN")

//todo:3、创建StreamingContext

val ssc = new StreamingContext(sc,Seconds(5))

ssc.checkpoint(checkpointPath)

//todo:4、指定zkServer

val zkServer="192.168.145.132:2181,192.168.145.133:2181,192.168.145.134:2181"

//todo:5、指定groupId

val groupId="spark-kafka-receiver01"

//todo:6、指定topics 这个可以利用一个消费者组来消费多个topic,

//(topic_name -> numPartitions) 指定topic消费的线程数

val topics=Map("kafka_spark"->1)

//todo:7、并行运行更多的接收器读取kafak topic中的数据,这里设置3个

val resultDStream: immutable.IndexedSeq[DStream[String]] = (1 to 3).map(x => {

//todo:8、通过使用KafkaUtils的createStream接受kafka topic中的数据,生成DStream

val kafkaDataDStream: DStream[String] = KafkaUtils.createStream(ssc, zkServer, groupId, topics).map(x => x._2)

kafkaDataDStream

}

)

//todo:利用StreamContext将所有的DStream组合在一起

val kafkaDStream: DStream[String] = ssc.union(resultDStream)

//todo:8、获取kafka中topic的内容

//todo:9、切分每一行。每个单词记为1

val wordAndOne: DStream[(String, Int)] = kafkaDStream.flatMap(_.split(" ")).map((_,1))

//todo:10、相同单词出现的次数累加

val result: DStream[(String, Int)] = wordAndOne.updateStateByKey(updateFunc)

//todo:打印

result.print()

ssc

}

}

总结:

通过这种方式实现,刚开始的时候系统正常运行,没有发现问题,但是如果系统异常重新启动sparkstreaming程序后,发现程序会重复处理已经处理过的数据,这种基于receiver的方式,是使用Kafka的高阶API来在ZooKeeper中保存消费过的offset的。这是消费Kafka数据的传统方式。这种方式配合着WAL机制可以保证数据零丢失的高可靠性,但是却无法保证数据被处理一次且仅一次,可能会处理两次。因为Spark和ZooKeeper之间可能是不同步的。官方现在也已经不推荐这种整合方式,官网相关地址下面我们使用官网推荐的第二种方式kafkaUtils的createDirectStream()方式。

PS:通过今天spark整合flume和kafka以及报的各种错,发现最大的问题也是最多的问题就是依赖问题。依赖包一定要用以上文档中的依赖。scala-SDK最好使用2.11.8版本的,不需要的依赖就注释掉。如果你发现依赖报红线,那么就是下载依赖jar包冲突。是因为你之前多次下载依赖,所以产生冲突。解决方式是新建项目重新依赖试一下。

如果你发现你的程序代码和虚拟机的kafka都没有问题,那就试着把你的checkpoint缓存目录干掉。个人猜测:如果你的这个缓存目录是有缓存的checkpoint文件时,此时程序启动后会默认去读取checkpoint中的数据,而不会实时读取kafka生产者发来的数据。如图