- AWS Certified Cloud Practitioner 认证考试 测试题与解析

DEMI0815

AWSaws大数据云计算

AWSCertifiedCloudPractitioner认证考试测试题与解析SecurityandCompliance(安全性与合规性)TechnologyCloudConcepts(云概念)BillingandPricing(计费与定价)SecurityandCompliance(安全性与合规性)1:Whichofthefollowingisarecommendedwaytoprovidepr

- 2022-08-28

色空世界

细胞离子通道(IonChannel)的作用离子通道是信息在细胞之间传递的工具。离子通道就是可以让带电离子通过的通道。以通道调控方式来区别,则可以分成“配体门控性离子通道”(Ligand-gatedIonChannel)和“电压门控性离子通道”(Voltage-gatedIonChannel)。离子移动的驱动力是电位差。细胞可以通过消耗能量把带电离子主动运送到离子通道的另一端,然后让细胞膜内外的带电

- lanqiaoOJ 4330:欧拉函数模板

hnjzsyjyj

信息学竞赛#算法数学基础欧拉函数

【题目来源】https://www.lanqiao.cn/problems/4330/learning/【问题描述】这是一道模板题。首先给出欧拉函数的定义:即φ(n)表示的是小于等于n的数中和n互质的数的个数。比如说φ(6)=2,当n是质数的时候,显然有φ(n)=n-1。【题目大意】给定n个正整数,请你求出每个数的欧拉函数。【输入格式】输入共两行。第一行输入一个整数表示n。第二行输入n个整数。【输

- lanqiaoOJ 2122:数位排序 ← 排序(自定义比较函数)

【题目来源】https://www.lanqiao.cn/problems/2122/learning/【题目描述】小蓝对一个数的数位之和很感兴趣,今天他要按照数位之和给数排序。当两个数各个数位之和不同时,将数位和较小的排在前面,当数位之和相等时,将数值小的排在前面。例如,2022排在409前面,因为2022的数位之和是6,小于409的数位之和13。又如,6排在2022前面,因为它们的数位之和相同

- lanqiaoOJ 2145:求阶乘 ← 二分法

hnjzsyjyj

信息学竞赛#分治算法与双指针算法二分法

【题目来源】https://www.lanqiao.cn/problems/2145/learning/【题目描述】满足N!的末尾恰好有K个0的最小的N是多少?如果这样的N不存在输出-1。【输入格式】一个整数K。【输出格式】一个整数代表答案。【输入样例】2【输出样例】10【评测用例规模与约定】对于30%的数据,1≤K≤10^6.对于100%的数据,1≤K≤10^18.【算法分析】●二分法的应用条件

- client-go: k8s选主

快速上手下面这个代码就是一个选主的大概逻辑packagemainimport("context""flag""fmt"_"net/http/pprof""os""path/filepath""time""golang.org/x/exp/rand"v1"k8s.io/api/core/v1"metav1"k8s.io/apimachinery/pkg/apis/meta/v1""k8s.io/ap

- YOLOv5改进策略|YOLOv5 ⾃主检查和跟踪相关的任务|基于视觉的⽆⼈⽔⾯舰艇⾃主导航 极端海洋条件

斌擎人工智能官方账号

YOLO人工智能YOLOv5目标检测计算机视觉深度学习自主导航

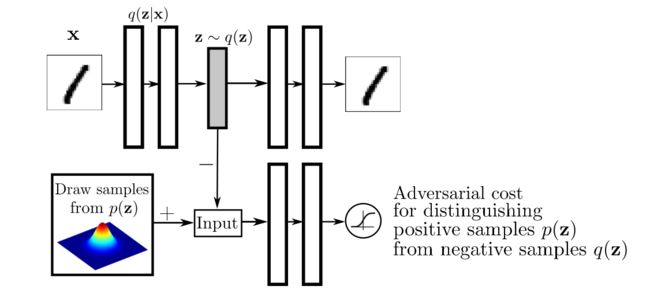

目录介绍解决方案目标检测的视觉结论视觉感知是无人水面舰艇(USV)自主导航的重要组成部分,特别是与自主检查和跟踪相关的任务。这些任务涉及基于视觉的导航技术来识别导航目标。海洋环境中极端天气条件下的能⻅度降低使得基于视觉的方法难以正常工作。为了克服这些问题,本文提出了一种基于视觉的自主导航框架,用于在极端海洋条件下跟踪目标物体。所提出的框架由一个集成感知管道组成,该管道使用生成对抗网络(GAN)来消

- 如何调整优化器的参数来优化神经网络性能?

Idividuals

深度学习神经网络机器学习pythonscikit-learn

不同优化器有不同的可调整参数,下面以常见的优化器为例,讲解如何调整其参数来优化神经网络性能:Adam优化器Adam优化器有几个关键参数:learning_rate(学习率)、beta_1、beta_2和epsilon。1.学习率(learning_rate)-作用:控制每次参数更新的步长。学习率过大,模型可能无法收敛,在最优解附近振荡甚至发散;学习率过小,训练速度会非常缓慢。-调整方法:通常初始值

- 8月19日 我只选择和平 | 我的奇迹日志

白兰白小兔

D19~LESSON19今天,我不断重复对自己说,我充满爱,我可爱。我感受到我对其他人充满爱,我也值得他们的爱。我爱我自己,我爱每个人,而且每个人都爱我。无论假我试图告诉我什么,我知道我值得拥有爱。今天,我知道我充满爱,我可爱。首先我很喜欢今天这段话,特别是英文原文。很适合对自己暗暗鼓励~~TodayIconstantlyrepeattomyselfthatIamlovingandlovable.

- 人工智能入门指南:从基础概念到实际应用

前些天发现了一个巨牛的人工智能学习网站,通俗易懂,风趣幽默,忍不住分享一下给大家。点击跳转到网站。https://www.captainbed.cn/north文章目录1.**人工智能的基本概念**1.1什么是人工智能?1.2人工智能的分类2.**人工智能的核心技术**2.1机器学习(MachineLearning)2.1.1机器学习的类型2.1.2机器学习流程2.2深度学习(DeepLearni

- 基于探路者算法优化的核极限学习机(KELM)分类算法

智能算法研学社(Jack旭)

智能优化算法应用机器学习#核极限学习机(KELM)算法分类数据挖掘

基于探路者算法优化的核极限学习机(KELM)分类算法文章目录基于探路者算法优化的核极限学习机(KELM)分类算法1.KELM理论基础2.分类问题3.基于探路者算法优化的KELM4.测试结果5.Matlab代码摘要:本文利用探路者算法对核极限学习机(KELM)进行优化,并用于分类1.KELM理论基础核极限学习机(KernelBasedExtremeLearningMachine,KELM)是基于极限

- 日常英语口语积累 | 第一轮

Ivy_IBFE

【口语练习资料】1.新闻编辑室(快)2.老友记3.摩登家庭4.CommencementspeechTips:1.readingandconsuminginformation2.nottomemorize3.nottoprematurelyapproachanativespeaker4.buildingyourinventoryofwordsandexpressions5.watchingTVors

- TensorFlow深度学习实战——DCGAN详解与实现

盼小辉丶

深度学习tensorflow生成对抗网络

TensorFlow深度学习实战——DCGAN详解与实现0.前言1.DCGAN架构2.构建DCGAN生成手写数字图像2.1生成器与判别器架构2.2构建DCGAN相关链接0.前言深度卷积生成对抗网络(DeepConvolutionalGenerativeAdversarialNetwork,DCGAN)是一种基于生成对抗网络(GenerativeAdversarialNetwork,GAN)的深度学

- 【转】【译】How to Handle Very Long Sequences with LSTM(LSTM RNN 超长序列处理)

开始奋斗的胖子

机器学习RNNLSTM序列深度学习

原文地址http://machinelearningmastery.com/handle-long-sequences-long-short-term-memory-recurrent-neural-networks/一个长的输入序列却只对应一个或者一小段输出就是我们经常说的序列标注和序列分类。主要包括下面一些例子:包含上千个词的文件情感分类(NLP)包含上千个时间状态的脑电痕迹分类(Medici

- 胶水(119)

假装是老付

他是那种非常聪明的人,总觉得你在下一盘高阶象棋,而不是和他进行一场热情友好的辩论。Hewasthetypeofpersonwhowassosmartthatitalwaysfeltlikeyouwereplayinganadvancedgameofchessratherthanhavingacordialdebatewithhim.他没有像训练国际象棋运动员那样思考此后的三步棋,而是思考已经走过的

- C# 设计模式概况

业余撸码人

.net设计模式c#.net

什么是设计模式大家熟知的GOF23种设计模式,源自《DesignPatterns:ElementsofReusableObject-OrientedSoftware》一书,由ErichGamma、RichardHelm、RalphJohnson和JohnVlissides合著,四人组GangofFour简称GOF。总结了在面向对象语言开发过程中常见问题的解决方案。设计模式是面向对象语言开发过程中,

- “闭门造车”之多模态思路浅谈:自回归学习与生成

PaperWeekly

回归学习数据挖掘人工智能机器学习

©PaperWeekly原创·作者|苏剑林单位|科学空间研究方向|NLP、神经网络这篇文章我们继续来闭门造车,分享一下笔者最近对多模态学习的一些新理解。在前文《“闭门造车”之多模态思路浅谈:无损》中,我们强调了无损输入对于理想的多模型模态的重要性。如果这个观点成立,那么当前基于VQ-VAE、VQ-GAN等将图像离散化的主流思路就存在能力瓶颈,因为只需要简单计算一下信息熵就可以表明离散化必然会有严重

- 伽卡他卡电子教室:技术原理、功能解析与教育场景实践

一、术语澄清与技术定位“伽卡他卡”(Gakataka)在计算机科学领域的核心实体为伽卡他卡电子教室软件。需注意其与无关技术的区别:❌与分布式流处理平台ApacheKafka无技术关联;❌与AI模型GauGAN、半导体技术GAA等“G”开头术语无关。核心定位:一款专为教育场景设计的局域网教学管理软件,由伽卡他卡公司开发。二、核心功能与应用场景1.核心模块屏幕广播:实时传输教师端操作画面;远程控制:教

- KAIST:LLM混合递归推理

大模型任我行

大模型-推理优化人工智能自然语言处理语言模型论文笔记

标题:Mixture-of-Recursions:LearningDynamicRecursiveDepthsforAdaptiveToken-LevelComputation来源:arXiv,2507.10524摘要缩放语言模型解锁了令人印象深刻的能力,但伴随的计算和内存需求使训练和部署都很昂贵。现有的效率工作通常针对参数共享或自适应计算,留下了如何同时实现两者的问题。我们引入了混合递归(MoR

- 【HDLBits习题详解 2】Circuit - Sequential Logic(5)Finite State Machines 【更新中...】

薄荷雪

fpga开发

1.Fsm1(SimpleFSM1-asynchronousreset)moduletop_module#(parameterA=0;parameterB=1;),(outputregout,inputclk,inputareset,inputin);regstate,next_state;//Outputlogic//assignout=(state==...);assignout=;alway

- How to SSH into your Ubuntu machine from macOS as superuser

captainOO7

Networkingsshubuntumacos

ToSSHintoyourUbuntumachinefrommacOSassuperuser,you’llfirstconnectasaregularuser,thenelevateprivilegesonceloggedin.Here'showtodoitstepbystep:Step1:EnableSSHonUbuntuMakesuretheSSHserverisinstalledandrun

- 文献精读:青藏高原东北部青海湖流域沿海拔分布的蒸散量及其主要影响因素

GIS炒茄子

经验分享

文献阅读的是Ma-2019的《EvapotranspirationanditsdominantcontrolsalonganelevationgradientintheQinghaiLakewatershed,northeastQinghai-TibetPlateau》,(IF6.3,SCIQ1)。01引言:研究背景和目的ET会同时受到多个因子的影响,包括太阳辐射、温度、风速、湿度、植物特性和土壤

- SPARKLE:深度剖析强化学习如何提升语言模型推理能力

摘要:强化学习(ReinforcementLearning,RL)已经成为赋予语言模型高级推理能力的主导范式。尽管基于RL的训练方法(例如GRPO)已经展示了显著的经验性收益,但对其优势的细致理解仍然不足。为了填补这一空白,我们引入了一个细粒度的分析框架,以剖析RL对推理的影响。我们的框架特别研究了被认为可以从RL训练中受益的关键要素:(1)计划遵循和执行,(2)问题分解,以及(3)改进的推理和知

- Python机器学习教程

Python机器学习教程(MachineLearningwithPythonTutorial)PDFVersionQuickGuideResourcesJobSearchDiscussionPDF版本快速指南资源资源求职讨论区MachineLearning(ML)isbasicallythatfieldofcomputersciencewiththehelpofwhichcomputersyste

- 【DW11月-深度学习】Task03前馈神经网络

沫2021

参考链接:https://datawhalechina.github.io/unusual-deep-learning/#/4.%E5%89%8D%E9%A6%88%E7%A5%9E%E7%BB%8F%E7%BD%91%E7%BB%9C一、神经元模型2.1神经元1943年,美国神经生理学家沃伦·麦卡洛克(WarrenMcCulloch)和数学家沃尔特·皮茨(WalterPitts)对生物神经元进行

- 边缘智能革命:嵌入式机器学习如何让万物“思考”

万能小贤哥

机器学习人工智能

当智能手表精准识别你的健身动作,工业传感器预测设备故障于毫秒之间,农业传感器自动调节灌溉水量——这些并非科幻场景,而是嵌入式机器学习(EmbeddedMachineLearning,或TinyML)正在悄然重塑的现实。这场发生在设备边缘的智能革命,正将AI从云端的数据中心拉近到我们指尖的每一台设备中。一、嵌入式机器学习:定义与核心价值嵌入式机器学习是指在资源极端受限的微控制器(MCU)、微处理器(

- 4 How to talk about doctors?

MrWisdom

1.internist:nAgeneralphysician.Also,aspecialistininternalmedicine.internus:Latinrootinsideinternal:adjinsideintern:nwhoisamedicalgraduateservinganapprenticeshipinsideahospital.2.gynecologist:nadoctorf

- 预测导管原位癌浸润性复发的深度学习:利用组织病理学图像和临床特征

浪漫的诗人

论文深度学习人工智能

文章目录研究内容目的方法数据集模型开发模型训练与评估外部验证统计分析研究结果模型性能风险分层外部验证特征重要性原文链接原文献:Deeplearningforpredictinginvasiverecurrenceofductalcarcinomainsitu:leveraginghistopathologyimagesandclinicalfeatures研究背景【DCIS与IBC的关联】乳腺导管

- 《How to Take Smart Notes》读书笔记1

LY320

最近在读一本书,题为《HowtoTakeSmartNotes:OneSimpleTechniquetoBoostWriting,LearningandThinking–forStudents,AcademicsandNonfictionBookWriters》1。尚未读完,分享一些读这本书的感想,我的一些心得,和不解。这本书让我觉得最有收获的点是更新了我对记录和整理笔记的认识。通常我们在记录笔记时

- 【深度学习基础】PyTorch中model.eval()与with torch.no_grad()以及detach的区别与联系?

目录1.核心功能对比2.使用场景对比3.区别与联系4.典型代码示例(1)模型评估阶段(2)GAN训练中的判别器更新(3)提取中间特征5.关键区别总结6.常见问题与解决方案(1)问题:推理阶段显存爆掉(2)问题:Dropout/BatchNorm行为异常(3)问题:中间张量意外参与梯度计算7.最佳实践8.总结以下是PyTorch中model.eval()、withtorch.no_grad()和.d

- JAVA基础

灵静志远

位运算加载Date字符串池覆盖

一、类的初始化顺序

1 (静态变量,静态代码块)-->(变量,初始化块)--> 构造器

同一括号里的,根据它们在程序中的顺序来决定。上面所述是同一类中。如果是继承的情况,那就在父类到子类交替初始化。

二、String

1 String a = "abc";

JAVA虚拟机首先在字符串池中查找是否已经存在了值为"abc"的对象,根

- keepalived实现redis主从高可用

bylijinnan

redis

方案说明

两台机器(称为A和B),以统一的VIP对外提供服务

1.正常情况下,A和B都启动,B会把A的数据同步过来(B is slave of A)

2.当A挂了后,VIP漂移到B;B的keepalived 通知redis 执行:slaveof no one,由B提供服务

3.当A起来后,VIP不切换,仍在B上面;而A的keepalived 通知redis 执行slaveof B,开始

- java文件操作大全

0624chenhong

java

最近在博客园看到一篇比较全面的文件操作文章,转过来留着。

http://www.cnblogs.com/zhuocheng/archive/2011/12/12/2285290.html

转自http://blog.sina.com.cn/s/blog_4a9f789a0100ik3p.html

一.获得控制台用户输入的信息

&nbs

- android学习任务

不懂事的小屁孩

工作

任务

完成情况 搞清楚带箭头的pupupwindows和不带的使用 已完成 熟练使用pupupwindows和alertdialog,并搞清楚两者的区别 已完成 熟练使用android的线程handler,并敲示例代码 进行中 了解游戏2048的流程,并完成其代码工作 进行中-差几个actionbar 研究一下android的动画效果,写一个实例 已完成 复习fragem

- zoom.js

换个号韩国红果果

oom

它的基于bootstrap 的

https://raw.github.com/twbs/bootstrap/master/js/transition.js transition.js模块引用顺序

<link rel="stylesheet" href="style/zoom.css">

<script src=&q

- 详解Oracle云操作系统Solaris 11.2

蓝儿唯美

Solaris

当Oracle发布Solaris 11时,它将自己的操作系统称为第一个面向云的操作系统。Oracle在发布Solaris 11.2时继续它以云为中心的基调。但是,这些说法没有告诉我们为什么Solaris是配得上云的。幸好,我们不需要等太久。Solaris11.2有4个重要的技术可以在一个有效的云实现中发挥重要作用:OpenStack、内核域、统一存档(UA)和弹性虚拟交换(EVS)。

- spring学习——springmvc(一)

a-john

springMVC

Spring MVC基于模型-视图-控制器(Model-View-Controller,MVC)实现,能够帮助我们构建像Spring框架那样灵活和松耦合的Web应用程序。

1,跟踪Spring MVC的请求

请求的第一站是Spring的DispatcherServlet。与大多数基于Java的Web框架一样,Spring MVC所有的请求都会通过一个前端控制器Servlet。前

- hdu4342 History repeat itself-------多校联合五

aijuans

数论

水题就不多说什么了。

#include<iostream>#include<cstdlib>#include<stdio.h>#define ll __int64using namespace std;int main(){ int t; ll n; scanf("%d",&t); while(t--)

- EJB和javabean的区别

asia007

beanejb

EJB不是一般的JavaBean,EJB是企业级JavaBean,EJB一共分为3种,实体Bean,消息Bean,会话Bean,书写EJB是需要遵循一定的规范的,具体规范你可以参考相关的资料.另外,要运行EJB,你需要相应的EJB容器,比如Weblogic,Jboss等,而JavaBean不需要,只需要安装Tomcat就可以了

1.EJB用于服务端应用开发, 而JavaBeans

- Struts的action和Result总结

百合不是茶

strutsAction配置Result配置

一:Action的配置详解:

下面是一个Struts中一个空的Struts.xml的配置文件

<?xml version="1.0" encoding="UTF-8" ?>

<!DOCTYPE struts PUBLIC

&quo

- 如何带好自已的团队

bijian1013

项目管理团队管理团队

在网上看到博客"

怎么才能让团队成员好好干活"的评论,觉得写的比较好。 原文如下: 我做团队管理有几年了吧,我和你分享一下我认为带好团队的几点:

1.诚信

对团队内成员,无论是技术研究、交流、问题探讨,要尽可能的保持一种诚信的态度,用心去做好,你的团队会感觉得到。 2.努力提

- Java代码混淆工具

sunjing

ProGuard

Open Source Obfuscators

ProGuard

http://java-source.net/open-source/obfuscators/proguardProGuard is a free Java class file shrinker and obfuscator. It can detect and remove unused classes, fields, m

- 【Redis三】基于Redis sentinel的自动failover主从复制

bit1129

redis

在第二篇中使用2.8.17搭建了主从复制,但是它存在Master单点问题,为了解决这个问题,Redis从2.6开始引入sentinel,用于监控和管理Redis的主从复制环境,进行自动failover,即Master挂了后,sentinel自动从从服务器选出一个Master使主从复制集群仍然可以工作,如果Master醒来再次加入集群,只能以从服务器的形式工作。

什么是Sentine

- 使用代理实现Hibernate Dao层自动事务

白糖_

DAOspringAOP框架Hibernate

都说spring利用AOP实现自动事务处理机制非常好,但在只有hibernate这个框架情况下,我们开启session、管理事务就往往很麻烦。

public void save(Object obj){

Session session = this.getSession();

Transaction tran = session.beginTransaction();

try

- maven3实战读书笔记

braveCS

maven3

Maven简介

是什么?

Is a software project management and comprehension tool.项目管理工具

是基于POM概念(工程对象模型)

[设计重复、编码重复、文档重复、构建重复,maven最大化消除了构建的重复]

[与XP:简单、交流与反馈;测试驱动开发、十分钟构建、持续集成、富有信息的工作区]

功能:

- 编程之美-子数组的最大乘积

bylijinnan

编程之美

public class MaxProduct {

/**

* 编程之美 子数组的最大乘积

* 题目: 给定一个长度为N的整数数组,只允许使用乘法,不能用除法,计算任意N-1个数的组合中乘积中最大的一组,并写出算法的时间复杂度。

* 以下程序对应书上两种方法,求得“乘积中最大的一组”的乘积——都是有溢出的可能的。

* 但按题目的意思,是要求得这个子数组,而不

- 读书笔记-2

chengxuyuancsdn

读书笔记

1、反射

2、oracle年-月-日 时-分-秒

3、oracle创建有参、无参函数

4、oracle行转列

5、Struts2拦截器

6、Filter过滤器(web.xml)

1、反射

(1)检查类的结构

在java.lang.reflect包里有3个类Field,Method,Constructor分别用于描述类的域、方法和构造器。

2、oracle年月日时分秒

s

- [求学与房地产]慎重选择IT培训学校

comsci

it

关于培训学校的教学和教师的问题,我们就不讨论了,我主要关心的是这个问题

培训学校的教学楼和宿舍的环境和稳定性问题

我们大家都知道,房子是一个比较昂贵的东西,特别是那种能够当教室的房子...

&nb

- RMAN配置中通道(CHANNEL)相关参数 PARALLELISM 、FILESPERSET的关系

daizj

oraclermanfilespersetPARALLELISM

RMAN配置中通道(CHANNEL)相关参数 PARALLELISM 、FILESPERSET的关系 转

PARALLELISM ---

我们还可以通过parallelism参数来指定同时"自动"创建多少个通道:

RMAN > configure device type disk parallelism 3 ;

表示启动三个通道,可以加快备份恢复的速度。

- 简单排序:冒泡排序

dieslrae

冒泡排序

public void bubbleSort(int[] array){

for(int i=1;i<array.length;i++){

for(int k=0;k<array.length-i;k++){

if(array[k] > array[k+1]){

- 初二上学期难记单词三

dcj3sjt126com

sciet

concert 音乐会

tonight 今晚

famous 有名的;著名的

song 歌曲

thousand 千

accident 事故;灾难

careless 粗心的,大意的

break 折断;断裂;破碎

heart 心(脏)

happen 偶尔发生,碰巧

tourist 旅游者;观光者

science (自然)科学

marry 结婚

subject 题目;

- I.安装Memcahce 1. 安装依赖包libevent Memcache需要安装libevent,所以安装前可能需要执行 Shell代码 收藏代码

dcj3sjt126com

redis

wget http://download.redis.io/redis-stable.tar.gz

tar xvzf redis-stable.tar.gz

cd redis-stable

make

前面3步应该没有问题,主要的问题是执行make的时候,出现了异常。

异常一:

make[2]: cc: Command not found

异常原因:没有安装g

- 并发容器

shuizhaosi888

并发容器

通过并发容器来改善同步容器的性能,同步容器将所有对容器状态的访问都串行化,来实现线程安全,这种方式严重降低并发性,当多个线程访问时,吞吐量严重降低。

并发容器ConcurrentHashMap

替代同步基于散列的Map,通过Lock控制。

&nb

- Spring Security(12)——Remember-Me功能

234390216

Spring SecurityRemember Me记住我

Remember-Me功能

目录

1.1 概述

1.2 基于简单加密token的方法

1.3 基于持久化token的方法

1.4 Remember-Me相关接口和实现

- 位运算

焦志广

位运算

一、位运算符C语言提供了六种位运算符:

& 按位与

| 按位或

^ 按位异或

~ 取反

<< 左移

>> 右移

1. 按位与运算 按位与运算符"&"是双目运算符。其功能是参与运算的两数各对应的二进位相与。只有对应的两个二进位均为1时,结果位才为1 ,否则为0。参与运算的数以补码方式出现。

例如:9&am

- nodejs 数据库连接 mongodb mysql

liguangsong

mongodbmysqlnode数据库连接

1.mysql 连接

package.json中dependencies加入

"mysql":"~2.7.0"

执行 npm install

在config 下创建文件 database.js

- java动态编译

olive6615

javaHotSpotjvm动态编译

在HotSpot虚拟机中,有两个技术是至关重要的,即动态编译(Dynamic compilation)和Profiling。

HotSpot是如何动态编译Javad的bytecode呢?Java bytecode是以解释方式被load到虚拟机的。HotSpot里有一个运行监视器,即Profile Monitor,专门监视

- Storm0.9.5的集群部署配置优化

roadrunners

优化storm.yaml

nimbus结点配置(storm.yaml)信息:

# Licensed to the Apache Software Foundation (ASF) under one

# or more contributor license agreements. See the NOTICE file

# distributed with this work for additional inf

- 101个MySQL 的调节和优化的提示

tomcat_oracle

mysql

1. 拥有足够的物理内存来把整个InnoDB文件加载到内存中——在内存中访问文件时的速度要比在硬盘中访问时快的多。 2. 不惜一切代价避免使用Swap交换分区 – 交换时是从硬盘读取的,它的速度很慢。 3. 使用电池供电的RAM(注:RAM即随机存储器)。 4. 使用高级的RAID(注:Redundant Arrays of Inexpensive Disks,即磁盘阵列

- zoj 3829 Known Notation(贪心)

阿尔萨斯

ZOJ

题目链接:zoj 3829 Known Notation

题目大意:给定一个不完整的后缀表达式,要求有2种不同操作,用尽量少的操作使得表达式完整。

解题思路:贪心,数字的个数要要保证比∗的个数多1,不够的话优先补在开头是最优的。然后遍历一遍字符串,碰到数字+1,碰到∗-1,保证数字的个数大于等1,如果不够减的话,可以和最后面的一个数字交换位置(用栈维护十分方便),因为添加和交换代价都是1