Hadoop2.6.5单机安装

一,安装环境

硬件:虚拟机

操作系统:Centos-7 64位

主机名:linux01

安装用户:root

二,安装JDK

安装JDK1.6或者以上版本。这里安装jdk1.8.0。

下载地址:http://www.oracle.com/technetwork/java/javase/downloads/index.html

1,下载jdk-8u181-linux-x64.rpm,解压/usr/java/jdk1.8.0。

2,在/etc/profile中添加如下配置:

#jdk1.8

export JAVA_HOME=/usr/java/jdk1.8.0

export CLASSPATH=.:$JAVA_HOME/lib/dt.jar:$JAVA_HOME/lib/tools.jar

export PATH=$PATH:$JAVA_HOME/bin

export JAVA_HOME CLASSPATH PATH 3,使环境变量生效,#source ~/.profile

4,安装验证# java -version

java version "1.8.0_181"

Java(TM) SE Runtime Environment (build 1.8.0_181-b13)

Java HotSpot(TM) 64-Bit Server VM (build 25.181-b13, mixed mode)

三,配置SSH无密码登陆

$ ssh-keygen -t dsa -P '' -f ~/.ssh/id_dsa

$ cat ~/.ssh/id_dsa.pub >> ~/.ssh/authorized_keys验证ssh,# ssh localhost

不需要输入密码即可登录。

四,安装Hadoop2.6.5

1,下载Hadoop2.6.5

下载地址:链接:https://pan.baidu.com/s/1f_gbagkY6Kd-J_f29Bqptw 密码:gkvc

2,解压安装

1),复制 hadoop-2.6.5.tar.gz 到/root/hadoop目录下,

然后#tar -xzvf hadoop-2.6.5.tar.gz 解压,解压后目录为:/root/hadoop/hadoop-2.6.5

2),在/root /hadoop/目录下,建立tmp、hdfs/name、hdfs/data目录,执行如下命令

#mkdir /root/hadoop/tmp

#mkdir /root/hadoop/hdfs

#mkdir /root/hadoop/hdfs/data

#mkdir /root/hadoop/hdfs/name

3),设置环境变量,#vi ~/.bash_profile

编辑insert

保存退出esc :wq :q!(退出不保存)

# set hadoop path

export HADOOP_HOME=/root /hadoop/hadoop-2.6.5

export PATH=$PATH:$HADOOP_HOME/bin4),使环境变量生效,$source ~/.bash_profile

3,Hadoop配置

进入$HADOOP_HOME/etc/hadoop目录,配置 hadoop-env.sh等。涉及的配置文件如下:

hadoop-2.6.5/etc/hadoop/hadoop-env.sh

hadoop-2.6.5/etc/hadoop/yarn-env.sh

hadoop-2.6.5/etc/hadoop/core-site.xml

hadoop-2.6.5/etc/hadoop/hdfs-site.xml

hadoop-2.6.5/etc/hadoop/mapred-site.xml

hadoop-2.6.5/etc/hadoop/yarn-site.xml

1)配置hadoop-env.sh

# The java implementation to use.

#export JAVA_HOME=${JAVA_HOME}

export JAVA_HOME=/usr/lib/jdk1.8.02)配置yarn-env.sh

#export JAVA_HOME=/home/y/libexec/jdk1.6.0/

export JAVA_HOME=/usr/lib/jdk1.8.03)配置core-site.xml

添加如下配置:

fs.default.name

hdfs://localhost:9000

HDFS的URI,文件系统://namenode标识:端口号

hadoop.tmp.dir

/root/hadoop/tmp

namenode上本地的hadoop临时文件夹

4),配置hdfs-site.xml

添加如下配置

dfs.name.dir

/root/hadoop/hdfs/name

namenode上存储hdfs名字空间元数据

dfs.data.dir

/root/hadoop/hdfs/data

datanode上数据块的物理存储位置

dfs.replication

1

副本个数,配置默认是3,应小于datanode机器数量

5),配置mapred-site.xml

添加如下配置:

mapreduce.framework.name

yarn

6),配置yarn-site.xml

添加如下配置:

yarn.nodemanager.aux-services

mapreduce_shuffle

yarn.resourcemanager.webapp.address

${yarn.resourcemanager.hostname}:8099

4,Hadoop启动

1)格式化namenode

[root@localhost hadoop]# cd /root/hadoop/hadoop-2.6.5

[root@localhost hadoop-2.6.5]# bin/hadoop namenode -forma

2)启动NameNode 和 DataNode 守护进程

$ sbin/ ./start-dfs.sh3)启动ResourceManager 和 NodeManager 守护进程

$ sbin/ ./start-yarn.sh5,启动验证

1)执行jps命令,有如下进程,说明Hadoop正常启动

# jps

54679 NameNode

54774 DataNode

15741 Jps

9664 Master

55214 NodeManager

55118 ResourceManager

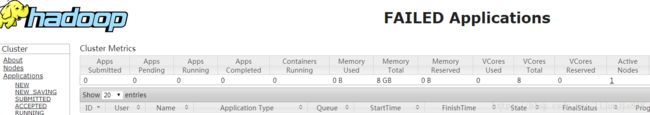

54965 SecondaryNameNode2)在浏览器中输入:http://192.168.2.2:8099/cluster 即可看到YARN的ResourceManager的界面。注意:默认端口是8088,这里我设置了yarn.resourcemanager.webapp.address为:${yarn.resourcemanager.hostname}:8099