音视频技术的高光时刻: LiveVideoStackCon 2019上海 音视频技术大会

Mux 流媒体专家Phil Cluff在4月19、20日举办的LiveVideoStackCon 2019上海音视频技术大会中发表了主题演讲,并根据自己在大会中的所见所闻,对其它部分精彩内容进行了详细的分析与总结。

文 / Phil Cluff

译 / John

原文

https://mux.com/blog/highlights-livevideostackcon-shanghai-2019/

上个月,我很荣幸地被邀请参加在上海举办的LiveVideoStackCon 2019 音视频技术大会并就如何设计出色的视频API进行了主题演讲。不得不说,这是一场由LiveVideoStack组织的专注于在线流媒体等音视频技术、服务与解决方案的饕餮盛宴。

LiveVideoStackCon 2019对我们——Mux与Demuxed会议的运营者来说是一个不错的能与音视频行业的优秀同仁沟通交流机会,因此我决定跨越大半个地球来到令人惊叹的上海参加这场技术大会。

为期两天的LiveVideoStackCon 2019 上海吸引了400-500名中国最优秀、最具创新力的音视频工程师。在这场大会中我不仅发表了主题演讲,还参与了多场讲座与圆桌会议,内容包括但不限于AI+多媒体、视频编解码、开源技术栈与多媒体传输网络。虽然我的中文不算出色,但凭借在音视频领域的多年耕耘与谷歌翻译的良好协助,我完全体会到了与会嘉宾和观众的热情以及音视频技术不断发展的澎湃动力。

中国正在成为机器学习的领导者

尽管在Mux,我们认为自己是将机器学习应用在音视频领域的行业领导者——例如我们的基于机器学习的Per-Title编码解决方案与和自适应编码相关的产品等;但让我们感到震惊的是,我们在LiveVideoStackCon上看到的大量基于机器学习的解决方案与商业应用,从TCP的选择到图像识别优化,都是借助神经网络得以实现。我们十分期待能在Demuxed 2019看到这样机器学习的行业应用百花齐放的局面。

来自中兴微电子的人工智能首席科学家徐科借主题演讲,深入浅出地分享了如何将机器学习运用于视频传输与分析当中;除此之外徐科还谈到了机器学习在计算机视觉领域的一些挑战并提供了一系列应用实例,让我倍感惊讶的是在这场演讲上,徐科对去年十月在“自然”杂志上发表的一篇题为《基于伦理学的机器学习实验(“The Moral Machine experiment” )》的论文进行了可视化分析。此实验旨在分析危险发生时人们的主观选择对于机器学习算法的影响,并揭露了不同国家与地区文化和社会的差异——例如当危机发生时,英国人相对于美国人更愿意把更多生存的机会留给年轻人。

我最喜欢的基于机器学习的解决方案之一是用于选择由智能手机拍摄的照片,其最佳曝光后处理设置参数的机器学习训练算法,该算法由同济大学开发并逐渐落地。除了执行所有我们已知的传统方法,此解决方案还执行了Google的“Auto Awesome”特性。

为什么中国会成为机器学习领域的领导者?从一些研究机构给出的结果我们不难找到答案——首先,中国拥有全球规模最大的消费电子市场,这不仅仅是因为中国拥有全世界最多的人口数量,还因为中国拥有一个以技术为导向的社会与市场。与西方相比,中国的移动支付技术正经历着爆炸式增长。据观察,中国政府对人工智能研究的投入大大高于其他任何西方国家,尤其对于图像分析和面部识别的研究更是颇为重视,西方国家需要花费很大资源与时间才能赶上中国现在取得的技术水平。

中国仍在继续推进自己的视频编解码器

在之前的很长一段时间内,我并没有在维基百科等渠道听说过AVS(Audio Video Standard)——一个几乎只在中国开发与使用的音视频多媒体编解码器。AVS的第一个版本实现了足以比肩MPEG 2与H.264的压缩比,其中编解码器的更新版本AVS +压缩效果大致与H.264相当。AVS解码器通常位于机顶盒中以接收有线和卫星广播,在一些Android电视或机顶盒中我们可以发现AVS系编解码器的存在。而自亚马逊宣布推出Alexa语音服务以来,依赖Google Android的AVS发展面临重重阻力,特别是因为Alexa现在开始越来越多地出现在家庭智能影音设备之中。

但出乎我意料的是AVS协议仍处于积极的开发状态中且最新的标准版本AVS2声称其压缩性能已优于HEVC。令人遗憾的是,由于未能实现桌面浏览器或iOS设备的支持,AVS2似乎不太可能在中国以外的其他地区取得商业成功,尽管与HEVC相比,AVS2具有更明智的专利池结构。

基于AV1的商用编码器不断涌现

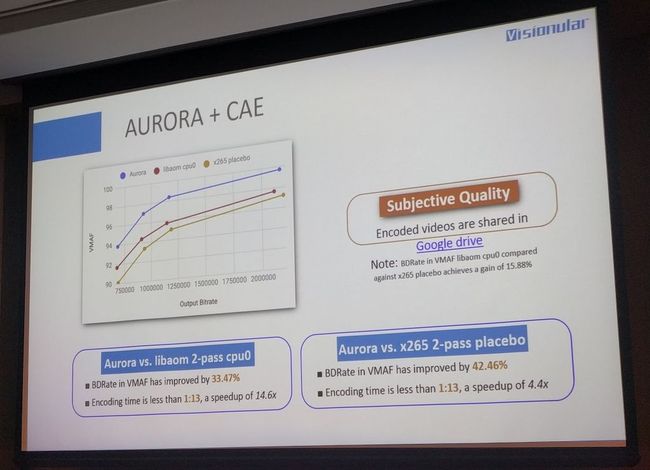

虽然诸多中国公司继续对AVS2等本土编解码器追加投资,但开源编解码器特别是AV1仍为大家关注的重点。来自腾讯的刘杉借主题演讲对当前编解码器的总体发展进行了精彩的阐述,而Zoe Liu则以AV1的更新为主题,详细介绍了rav1e与dav1d的最新改进;除此之外,Zoe Liu的公司Visionular构建了一套基于机器学习的增强型视频编码器,她展示了这套全新开发的AV1编码器Aurora的一些参数与数据。从质量和性能的角度来看,目前Aurora的综合性能优于libaom;而某些测试序列的VMAF得分则提高了30%以上,在质量和编码性能方面Aurora也优于lib-x265。值得注意的是,libaom并未针对性能进行特别优化,而是被设计成参考级编码器。

尽管Zoe并没有比较Aurora与rav1e或SVT-AV1,尽管两者都可在许可证下免费获得,但我们相信,为了与免费产品竞争,Aurora必须表现出足够的速度或质量改进。然而Visionular宣称即将推出一款软件实时编码器,这在商业市场上还属首例。

在Mux,我们将继续研究、开发和测试AV1生态系统中的商业与免费软件。我们坚信开放的编解码器生态系统适合每一个参与音视频行业建设的开发者,我们希望为此生态系统的良性发展作出贡献。

备用TCP堆栈逐渐普及

TCP的举足轻重有目共睹。尽管在大多数互联网设备与服务中被使用,但TCP并非为互联网而生。现代网络架构与CDN并不一定需要TCP中存在的积极拥塞与流量控制机制。

很长一段时间以来,企业为了提高数据吞吐量,减少延迟并增强数据链路的可靠性,一直在尝试实现兼容TCP的网络堆栈。其中尝试的一些方法依赖于在已经接收到先前有效载荷的TCP ACK之前抢先发送的后续数据序列,其目的是有效调整拥塞控制算法。但此类型技术需要被微调以减少阻碍正常带宽的风险, TCP应当与同一网络上更传统的TCP实现共存。

来自Akamai的Will Law在LiveVideoStackCon上借主题演讲详细阐述了Akamai如何通过兼容各种不同的TCP以提供最佳性能的TCP协议加速技术,包括FastTCP(2012年被Akamai收购)、BBR(Google的TCP替代方案,被Fastly与Spotify使用)、RENO与CUBIC等。与此同时,Akamai正致力于训练神经网络,该网络可以识别出在每个HTTP请求中使用何种拥塞控制算法以达到最佳效果。不得不说这真的很新颖!

在中国的这段时间我也有幸与Cascade Range Networks的Sean进行了交谈,并了解一些他们正尝试使用兼容性TCP替代Linux网络堆栈的探索。让我印象深刻的是,他们借软件部署设备之间的差异,实现从10美元的闭路电视摄像机到10,000美元的核心网络服务器都显示出性能的显着提升。

我们将密切关注这一领域的发展。我们对Cascade Range Network的产品以及即将推出的谷歌BBR V2感到非常期待。

摘要

如果你有机会来到中国,那么LiveVideoStackCon将是一场不容错过的绝佳技术盛宴。我非常享受在上海的时光,更多是因为这里有着与欧美等国家截然不同的技术发展理念,让我们学会了掌握核心技术的特别奥义。

LiveVideoStack 招募

LiveVideoStack正在招募编辑/记者/运营,与全球顶尖多媒及技术专家和LiveVideoStack年轻的伙伴一起,推动多媒体技术生态发展。了解岗位信息请在BOSS直聘上搜索“LiveVideoStack”,或通过微信“Tony_Bao_”与主编包研交流。

LiveVideoStackCon 2019北京正在招募讲师,无论你是技术派还是学术派,亦或是行业专家,无论你的团队有多小、有多新,都可以来申请成为LiveVideoStackCon的讲师。点击【阅读原文】了解更多大会相关信息。