- 2018年10月检视

呼和浩特张勇

2018年10月检视10月月度检视2018年11月呼和浩特市1101张勇没有反思的人生不值得过-苏格拉底【2018年10月目标及检视完成情况】罗列年度目标及完成进度10/12一,家庭和睦夫妻恩爱(同频共情的沟通与高质量的陪伴。)二,子女成为对社会有用之人(全家人正在养成物品归位和整洁的习惯,科学的学习习惯,生活习惯和高效使用优质的教育资源)三,做一个不惧困难,有能力面对各种问题的人(学习易效能,善

- 艰难,周旋

六块八毛八_4a05

感受不到你的喜欢,我劝自己对你的喜欢也只能始于心,也止于心……毕竟已经过了那个喜欢你与你没关系的倔强年纪……只是,我还是不够洒脱,还是对你留有念想,对你的幻想是我拒绝别人的一切理由,哪怕是别人的几句暧昧,我都觉得是对你的背叛……可悲的是,我的“忠贞”感动着自己,却对你装的比陌生人还淡定……我们都在被辜负的同时辜负着别人,在失望于别人的同时,成为了别人的失望……慢慢地,才懂得了你站在桥上看风景看风景

- 哈马斯和真主党官员曝伊朗安全官员策划了对以色列的突袭

聚百宝国际时事谈

《华尔街日报》报道哈马斯和真主党高级成员称伊朗安全官员帮助策划了周六哈马斯对以色列的突然袭击并于上周一在贝鲁特举行的一次会议上批准了这次袭击哈马斯领导人伊斯梅尔·哈尼亚表示哈马斯正处于伟大胜利的边缘伊朗制造的产品由伊朗伊斯兰共和国船只从沙希德·拉吉或霍梅尼港运输到叙利亚拉塔基亚然后从那里运往黎巴嫩南部打击区域与阿尔塔巴兹卸载iSO集装箱的港口区域完全匹配真主党精锐特种部队拉杜安部队已部署到与以色列

- C++ 数组详解:从基础到实战

光の

javajvm前端

一、数组的定义与核心特性(一)什么是数组?数组(Array)是C++中用于存储一组相同类型元素的连续内存空间。它通过一个统一的名称(数组名)和索引(下标)来访问每个元素,是实现批量数据管理的基础工具。(二)核心特性特性说明同类型所有元素必须是同一数据类型(如int、double)连续性元素在内存中连续存放,地址递增(&arr[i+1]=&arr[i]+sizeof(类型))固定大小数组声明时需指定

- 班长朋友

Visby

文:‖18岁的小仙女图片发自App昨天与一简友聊天,聊了一天做了什么什么事,然后我说,我陪一个朋友聊了一整天的天。可能这种事情在以前是一件很经常的事情,可是,从上个学期开始认真对待生活的时候,已经没有这样和一个人聊这么久了。因为冰哥的书相识虽然我称呼朋友班长,也知道他是一个第八年的老班长。可是,与班长朋友的相识,却是因为冰哥的书,一系列的书。刚从部队回来,闲来无事便每每翻阅冰哥写的一系列的书,然后

- 每天学习点销售技巧:潜水艇销售法

V叔能量圈

文/巍巍昆仑日更D11每个人都离开销售技巧,即使你不从事销售工作,因为我们平台工作与生活,都要与人打交道,销售就是让人与人沟通更顺畅,彼此达到双赢多赢合作。潜水艇销售法一、建立与客户亲和信任客户成交的前提是建立彼此信任,信任从几个方面入手,对公司信任,对产品信任,对销售人员信任,成交就是成功交换价值,客户提供金钱,我们提供产品和服务,客户对我们产品和服务满意,就会重复购买,同时介绍一些其他客户进行

- 碰一碰发视频、碰一碰写好评源码搭建技术开发,支持OEM贴牌

18538162800余+

音视频矩阵线性代数

在移动互联网时代,便捷的交互体验成为吸引用户的关键。“碰一碰发视频”与“碰一碰写好评”功能借助近场通信(NFC)等技术,为用户带来了全新的操作体验,同时也为商家和内容创作者开辟了高效的推广与互动途径。本文将深入探讨这两项功能背后的技术开发要点。一、核心技术基础1.NFC近场通信技术NFC技术是实现碰一碰交互的基石。它基于ISO14443等协议,让设备在短距离(通常为10厘米以内)内进行安全的数据交

- 还在了解什么是SSL证书嘛?一篇文章让你简洁明了的认识SSL

一、SSL基础概念1.SSL的定义SSL(SecureSocketsLayer)是一种安全协议,用于在客户端(如浏览器)与服务器之间建立加密通信。它通过数据加密、身份验证和完整性保护,确保网络传输的安全性。2.SSL与TLS的关系SSL:由网景公司于1994年开发,最后一个版本是SSL3.0。TLS(TransportLayerSecurity):SSL的升级版,由IETF标准化。目前主流版本是T

- 代码签名:保障软件安全与可信的关键防线

Arwen303

代码签名SSL证书ssl网络协议网络

在当今数字化时代,软件应用广泛渗透于各个领域,其安全性与可信度至关重要。代码签名作为一项核心技术手段,犹如软件世界的“数字身份证”,为软件的合法身份与完整性保驾护航。一、代码签名介绍(一)定义与原理代码签名是一种通过数字证书对软件代码进行数字签名的技术。它利用公钥加密体系,开发者使用私钥对代码进行签名,而用户端则通过对应的公钥来验证签名的有效性。当软件被签署后,任何对代码的篡改都会导致签名验证失败

- 这么简单的从零到一做HTML 网页,你确定不来看看吗?

paid槮

html服务器前端

HTML网页的介绍HTML(HypertextMarkupLanguage,超文本标记语言)是一种用于创建网页的标准标记语言,是一种与Python不同的编程语言。网页文件的扩展名通常为,html或.htm,这两种扩展名都可使用,并不会影响文件内容简单的HTML网页框架每一个HTML网页都包含一个基础框架,其他的内容都是在基础框架内进行扩充的。示例代码:这里是标题在这里填入正文这是一个较为基础的HT

- Java实习模拟面试之创玖科技:前后端交互、数据库、Spring全家桶、性能优化与Linux实战

培风图南以星河揽胜

java面试java面试科技

关键词:JavaScript、JQuery、Ajax、Node.js、MySQL、Oracle、Spring、SpringMVC、SpringBoot、MyBatis、Tomcat、Redis、Nginx、Linux、Git、SAAS系统开发一、面试开场:自我介绍面试官提问:请做个自我介绍,重点突出你的技术栈和项目经验。候选人回答:您好,我是一名计算机科学与技术专业的应届生,具备扎实的Java基础

- Java与机器学习的邂逅:Weka框架入门指南

墨夶

Java学习资料1java机器学习数据挖掘

在这个数据驱动的时代,机器学习已经成为各行业创新和优化的关键技术。而Java,作为一门成熟且广泛应用的编程语言,在企业级应用开发中占据着重要地位。将二者结合起来,利用Java实现机器学习算法,不仅可以充分发挥其强大的生态系统优势,还能为开发者提供一个高效、稳定的开发环境。今天,我们将带您走进Java与机器学习的世界,探索如何使用Weka这一著名的机器学习库来开启您的智能之旅。Weka简介及其优势什

- CSS 单位完全指南:掌握 em、rem、vh、vw 等响应式布局核心单位

编程随想▿

CSScss前端html网页布局

目录一、绝对单位vs相对单位二、核心相对单位详解1.em单位2.rem单位(Rootem)3.vh与vw单位4.vmin与vmax单位三、实战应用场景对比五、专家建议与最佳实践六、总结一、绝对单位vs相对单位绝对单位(如px)固定不变,而相对单位则基于其他参考值动态计算,更适合响应式设计:/*绝对单位示例*/.fixed-size{width:300px;/*始终为300像素*/}/*相对单位示例

- 解锁 JavaScript 模块化:ES6 Module 语法深度指南

编程随想▿

ES6javascriptes6前端开发语言

目录ES6Module核心语法1.export-导出模块内容(1)命名导出(NamedExports)(3)混合导出(CombiningNamedandDefault)2.import-导入模块内容(1)导入命名导出(2)导入默认导出(3)混合导入3.动态导入(import())重要特性与注意事项总结ES6Module核心语法ES6Module的核心围绕两个关键字:export和import。1.

- JavaScript的介绍及嵌入方式

紫罗兰丶

JavaScript介绍JavaScript是运行在浏览器端的脚步语言,JavaScript主要解决的是前端与用户交互的问题,包括使用交互与数据交互。JavaScript是浏览器解释执行的,前端脚本语言还有JScript(微软,IE独有),ActionScript(Adobe公司,需要插件)等。JavaScript嵌入页面的方式1.页面script标签嵌入vara="你好!"2.外部引用

- 跟100位大师练,练完就成高手丨写作工具箱 22

丨张伟丨

大师写作100练丨文/张伟蹯溪百日极致写作练习营这是椰子私塾第1788篇原创输出最厉害的招数,往往最简单。练到极致,就是绝招,写作亦如此。跟100位大师练,练完就成高手丨写作工具箱22不同风格的语言运用1、文学语言基本要求:生动、形象、真实、准确等等。小说有自己的语言特征。2、叙述语言包括:文本描写、说明、抒情、议论、阐释、交代等等。3、人物语言包括:对话,独白等等。主要作用是体现人物性格与性情变

- 《红楼梦》第三十三回:手足小动眈眈唇舌,不肖种种大承笞挞,我的读书分享

清水秋

《红楼梦》第三十三回:手足小动眈眈唇舌,不肖种种大承笞挞。这一回里:忠顺府长史官代替忠顺王爷来找贾政询问琪官的下落,贾政不知道琪官将自己贴身的汗巾赠予宝玉。史官当着贾政的面,当场点破了这件事。史官问起琪官的最新住处,宝玉说在东郊离城二十里有个什么紫檀堡,他在那里置了几亩田地和几件房舍。史官说他去那里找找看,没找到还要问宝玉。贾环听闻金钏投井而死,就添油加醋的对贾政说:金钏的死与宝玉脱不了干系,还说

- Java 二维数组详解:从基础语法到实战应用,彻底掌握多维数据结构

大葱白菜

java合集开发语言java后端学习个人开发

作为一名Java开发工程师,你一定在实际开发中遇到过需要处理表格、矩阵、图像像素、游戏地图等场景。这时候,二维数组(2DArray)就派上用场了。本文将带你全面掌握:Java中二维数组的定义与初始化方式二维数组的内存结构与访问机制二维数组的遍历、修改与扩容技巧二维数组在实际业务中的应用场景二维数组与集合类(如List>)的互转常见误区与最佳实践并通过丰富的代码示例和真实项目场景讲解,帮助你写出更高

- FPGA相关通信问题详解

霖12

fpga开发笔记信号处理信息与通信学习开发语言

首先感谢大佬@征途黯然.-CSDN博客的就我的上篇文章《FPGA通信设计十问》提出的问题,我在此做出回复一.解释FFT(快速傅里叶变换)如何在FPGA的IP核中高效实现FFT作为将时域信号转换为频域的核心算法,其在FPGA中的高效实现依赖于硬件架构与算法特性的深度适配。1.流水线架构:提升吞吐量FFT的核心是“蝶形运算”,其计算过程可分解为log2(N)级(N为FFT点数),每级包含N/2次蝶形运

- HTTPS协议的应用场景分析

Arwen303

https网络协议http

HTTPS协议的应用场景分析一、Web服务与交互网页浏览场景:用户通过浏览器访问各类网站(如门户网站、资讯平台),传输HTML、CSS、JavaScript等静态资源。应用:主流网站普遍采用HTTPS,确保页面内容安全加载。例如,Wikipedia、新浪等站点通过HTTPS防止内容被篡改。安全需求:防止页面被中间人劫持植入恶意广告或脚本。在线表单与用户登录场景:用户提交注册表单、登录账号时传输用户

- Sequential Thinking:AI深度思考的新范式及其与CoT、ReAct的对比分析

码字的字节

人工智能SequentialCoTReAct

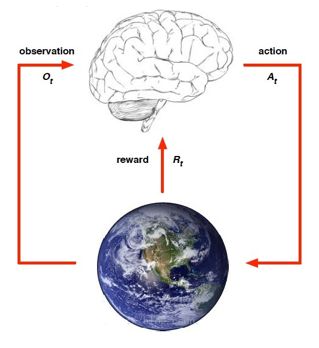

引言:AI深度思考的演进与SequentialThinking的崛起在人工智能技术快速发展的今天,AI模型的思考能力正经历着从简单应答到深度推理的革命性转变。这一演进过程不仅反映了技术本身的进步,更体现了人类对机器智能认知边界的持续探索。早期的大语言模型虽然能够生成流畅的文本,但在处理复杂问题时往往表现出"浅思考"的局限性——答案可能看似合理,却缺乏严谨的推理过程和系统性考量。例如,2022年的一

- 只有做最好的自己才能吸引来最好的别人

雷继伟668

陈果说:“只有同等能量的人才会相互吸引、相互识别、相互欣赏”。你若盛开,蝴蝶自来。所以,如果你想要遇到非常优秀的朋友、知己、亦或是情侣,请你静静地成长,美美的绽放。待你盛开,优秀的人自然会被你吸引而来,与你为友、陪你作伴、携你前行!读书、思考、践行,一定能让你成为更好的自己。读书,就是将别人的思想变成一块块垫脚石,筑起自己的思想殿堂。在大多数人的生活中,自己的身边都会有一些非常优秀的人。她们美的貌

- Windows环境Chrome安装提示无可用更新问题解决【2024年版】

zrhsmile

Windowschromewindows

现象卸载了Chrome浏览器之后,通过腾讯管家安装Chrome浏览器,发现都无法一键安装或安装【注:一键安装或安装,都没有任何反应】如果可以科学上网,发现通过下载Google的网址,下载Chrome浏览器的安装软件ChromeSetup.exe,也无法安装。提示:“无可用的更新”或“与服务器的连接意外终止”原因出现这个问题的原因是因为安装程序是和google直连的或者杀毒软件阻止了连接解决方案【亲

- 纸板制造学习3·DOE实验(如正交试验)优化压力组合

xinzheng新政

制造学习

·DOE实验(如正交试验)优化压力组合DOE(DesignofExperiments,实验设计)是一种通过科学规划实验方案,系统分析多因素对结果影响的方法,正交试验是其核心工具之一。在纸板生产中,DOE可通过少量实验快速找到气缸压力、原纸克重等变量的最优组合,提升效率与质量。以下是简要科普:一、DOE的核心目标识别关键因素:确定哪些变量(如热板压力、原纸克重)对结果(如纸板厚度、粘合强度)影响最大

- 一元线性回归模型与最小二乘法

liuzx32

监督学习中,如果预测的变量是离散的,我们称其为分类(如决策树,支持向量机等),如果预测的变量是连续的,我们称其为回归。回归分析中,如果只包括一个自变量和一个因变量,且二者的关系可用一条直线近似表示,这种回归分析称为一元线性回归分析。如果回归分析中包括两个或两个以上的自变量,且因变量和自变量之间是线性关系,则称为多元线性回归分析。对于二维空间线性是一条直线;对于三维空间线性是一个平面,对于多维空间线

- 公路桥梁施工质量管理与控制方法分析

阿卞是宝藏啊

本文还有配套的精品资源,点击获取简介:本文深入探讨了公路桥梁施工中如何实施有效的质量管理与控制,强调了质量管理的重要性,详述了质量控制的理论基础,并概述了施工前后质量策划、材料与设备质量控制、施工过程监控、质量信息管理、问题处理与改进、竣工验收及后期维护的方法。强调了全面质量管理理论与现代信息技术的应用,旨在确保工程安全、可靠与耐久。1.质量管理的重要性1.1市场竞争中的质量要素在当今竞争日益激烈

- 写在工作一周年

宝妈小丸子

【作于七年前一晃工作已八年-_-||】上周收到了工会送来的祝福卡片,小感动一下。惊觉来到单位已快一周年了。2010年5月11日,在忙乱的体检之后,我在冯老师的带领下来到团委报到,开始了实习的日子。忙碌的生活伴着温暖与欢乐。各位亲切的老师、可爱的孩子们教会了我很多,我很快有了归属感,116是个家,团委是个家,首经贸也是个家。我喜欢在夕阳西沉的时候走在赛欧天桥上眺望远方,世界仿佛在那一刻变得宁静。我渐

- 多云环境下的统一安全架构设计

TechVision大咖圈

安全架构多云安全合规性统一架构零信任深度防御身份管理

关键词:多云安全、统一架构、零信任、深度防御、身份管理、威胁检测、SIEM、合规性文章目录引言:多云时代的安全挑战多云环境面临的安全挑战统一安全架构设计原则核心安全组件架构多层防护体系设计统一身份管理与访问控制安全监控与威胁检测实施策略与最佳实践总结与展望引言:多云时代的安全挑战在这个"云来云去"的时代,企业就像搬家一样,从单一的云服务商逐渐向多云架构迁移。就好比以前只在一家银行存钱,现在为了"不

- 盟接之桥说制造:差异化定位与效率竞争的双轮驱动

盟接之桥

制造人工智能大数据数据库服务器

在当今竞争日益激烈的商业环境中,企业如何在市场中脱颖而出,既避免陷入同质化的价格战,又能够通过效率提升实现可持续发展,是每一个经营者必须思考的问题。本文将围绕“差异化”与“效率竞争”两大核心战略展开分析,探讨企业如何通过差异化定位构建独特的竞争优势,并通过效率优化降低成本结构,从而实现高质量发展。一、差异化竞争:构建独特价值的商业路径差异化是指企业在产品、服务、品牌、商业模式等方面与竞争对手形成显

- 一堆零食

爱生活的小吴老师

又是被班上的娃们感动的一天晚饭时因为要给十几个学生下载志愿汇错过了打饭时间上完两节晚自习回到办公室看到我的办公桌被零食“占领”了还有一杯晾到刚好能喝的水那一刻真是被感动了感动于孩子们的细心与关心平时我对学生特别严格作业书写,读书音量,课本摆放,墩布放置,甚至宿舍的鞋都要鞋跟朝外排成一条直线学生从开始的不习惯到慢慢接受再到养成良好的习惯这个过程真是酸甜苦辣咸五味皆俱一路走来慢慢走进彼此的心里便有了更

- windows下源码安装golang

616050468

golang安装golang环境windows

系统: 64位win7, 开发环境:sublime text 2, go版本: 1.4.1

1. 安装前准备(gcc, gdb, git)

golang在64位系

- redis批量删除带空格的key

bylijinnan

redis

redis批量删除的通常做法:

redis-cli keys "blacklist*" | xargs redis-cli del

上面的命令在key的前后没有空格时是可以的,但有空格就不行了:

$redis-cli keys "blacklist*"

1) "blacklist:12:

[email protected]

- oracle正则表达式的用法

0624chenhong

oracle正则表达式

方括号表达示

方括号表达式

描述

[[:alnum:]]

字母和数字混合的字符

[[:alpha:]]

字母字符

[[:cntrl:]]

控制字符

[[:digit:]]

数字字符

[[:graph:]]

图像字符

[[:lower:]]

小写字母字符

[[:print:]]

打印字符

[[:punct:]]

标点符号字符

[[:space:]]

- 2048源码(核心算法有,缺少几个anctionbar,以后补上)

不懂事的小屁孩

2048

2048游戏基本上有四部分组成,

1:主activity,包含游戏块的16个方格,上面统计分数的模块

2:底下的gridview,监听上下左右的滑动,进行事件处理,

3:每一个卡片,里面的内容很简单,只有一个text,记录显示的数字

4:Actionbar,是游戏用重新开始,设置等功能(这个在底下可以下载的代码里面还没有实现)

写代码的流程

1:设计游戏的布局,基本是两块,上面是分

- jquery内部链式调用机理

换个号韩国红果果

JavaScriptjquery

只需要在调用该对象合适(比如下列的setStyles)的方法后让该方法返回该对象(通过this 因为一旦一个函数称为一个对象方法的话那么在这个方法内部this(结合下面的setStyles)指向这个对象)

function create(type){

var element=document.createElement(type);

//this=element;

- 你订酒店时的每一次点击 背后都是NoSQL和云计算

蓝儿唯美

NoSQL

全球最大的在线旅游公司Expedia旗下的酒店预订公司,它运营着89个网站,跨越68个国家,三年前开始实验公有云,以求让客户在预订网站上查询假期酒店时得到更快的信息获取体验。

云端本身是用于驱动网站的部分小功能的,如搜索框的自动推荐功能,还能保证处理Hotels.com服务的季节性需求高峰整体储能。

Hotels.com的首席技术官Thierry Bedos上个月在伦敦参加“2015 Clou

- java笔记1

a-john

java

1,面向对象程序设计(Object-oriented Propramming,OOP):java就是一种面向对象程序设计。

2,对象:我们将问题空间中的元素及其在解空间中的表示称为“对象”。简单来说,对象是某个类型的实例。比如狗是一个类型,哈士奇可以是狗的一个实例,也就是对象。

3,面向对象程序设计方式的特性:

3.1 万物皆为对象。

- C语言 sizeof和strlen之间的那些事 C/C++软件开发求职面试题 必备考点(一)

aijuans

C/C++求职面试必备考点

找工作在即,以后决定每天至少写一个知识点,主要是记录,逼迫自己动手、总结加深印象。当然如果能有一言半语让他人收益,后学幸运之至也。如有错误,还希望大家帮忙指出来。感激不尽。

后学保证每个写出来的结果都是自己在电脑上亲自跑过的,咱人笨,以前学的也半吊子。很多时候只能靠运行出来的结果再反过来

- 程序员写代码时就不要管需求了吗?

asia007

程序员不能一味跟需求走

编程也有2年了,刚开始不懂的什么都跟需求走,需求是怎样就用代码实现就行,也不管这个需求是否合理,是否为较好的用户体验。当然刚开始编程都会这样,但是如果有了2年以上的工作经验的程序员只知道一味写代码,而不在写的过程中思考一下这个需求是否合理,那么,我想这个程序员就只能一辈写敲敲代码了。

我的技术不是很好,但是就不代

- Activity的四种启动模式

百合不是茶

android栈模式启动Activity的标准模式启动栈顶模式启动单例模式启动

android界面的操作就是很多个activity之间的切换,启动模式决定启动的activity的生命周期 ;

启动模式xml中配置

<activity android:name=".MainActivity" android:launchMode="standard&quo

- Spring中@Autowired标签与@Resource标签的区别

bijian1013

javaspring@Resource@Autowired@Qualifier

Spring不但支持自己定义的@Autowired注解,还支持由JSR-250规范定义的几个注解,如:@Resource、 @PostConstruct及@PreDestroy。

1. @Autowired @Autowired是Spring 提供的,需导入 Package:org.springframewo

- Changes Between SOAP 1.1 and SOAP 1.2

sunjing

ChangesEnableSOAP 1.1SOAP 1.2

JAX-WS

SOAP Version 1.2 Part 0: Primer (Second Edition)

SOAP Version 1.2 Part 1: Messaging Framework (Second Edition)

SOAP Version 1.2 Part 2: Adjuncts (Second Edition)

Which style of WSDL

- 【Hadoop二】Hadoop常用命令

bit1129

hadoop

以Hadoop运行Hadoop自带的wordcount为例,

hadoop脚本位于/home/hadoop/hadoop-2.5.2/bin/hadoop,需要说明的是,这些命令的使用必须在Hadoop已经运行的情况下才能执行

Hadoop HDFS相关命令

hadoop fs -ls

列出HDFS文件系统的第一级文件和第一级

- java异常处理(初级)

白糖_

javaDAOspring虚拟机Ajax

从学习到现在从事java开发一年多了,个人觉得对java只了解皮毛,很多东西都是用到再去慢慢学习,编程真的是一项艺术,要完成一段好的代码,需要懂得很多。

最近项目经理让我负责一个组件开发,框架都由自己搭建,最让我头疼的是异常处理,我看了一些网上的源码,发现他们对异常的处理不是很重视,研究了很久都没有找到很好的解决方案。后来有幸看到一个200W美元的项目部分源码,通过他们对异常处理的解决方案,我终

- 记录整理-工作问题

braveCS

工作

1)那位同学还是CSV文件默认Excel打开看不到全部结果。以为是没写进去。同学甲说文件应该不分大小。后来log一下原来是有写进去。只是Excel有行数限制。那位同学进步好快啊。

2)今天同学说写文件的时候提示jvm的内存溢出。我马上反应说那就改一下jvm的内存大小。同学说改用分批处理了。果然想问题还是有局限性。改jvm内存大小只能暂时地解决问题,以后要是写更大的文件还是得改内存。想问题要长远啊

- org.apache.tools.zip实现文件的压缩和解压,支持中文

bylijinnan

apache

刚开始用java.util.Zip,发现不支持中文(网上有修改的方法,但比较麻烦)

后改用org.apache.tools.zip

org.apache.tools.zip的使用网上有更简单的例子

下面的程序根据实际需求,实现了压缩指定目录下指定文件的方法

import java.io.BufferedReader;

import java.io.BufferedWrit

- 读书笔记-4

chengxuyuancsdn

读书笔记

1、JSTL 核心标签库标签

2、避免SQL注入

3、字符串逆转方法

4、字符串比较compareTo

5、字符串替换replace

6、分拆字符串

1、JSTL 核心标签库标签共有13个,

学习资料:http://www.cnblogs.com/lihuiyy/archive/2012/02/24/2366806.html

功能上分为4类:

(1)表达式控制标签:out

- [物理与电子]半导体教材的一个小问题

comsci

问题

各种模拟电子和数字电子教材中都有这个词汇-空穴

书中对这个词汇的解释是; 当电子脱离共价键的束缚成为自由电子之后,共价键中就留下一个空位,这个空位叫做空穴

我现在回过头翻大学时候的教材,觉得这个

- Flashback Database --闪回数据库

daizj

oracle闪回数据库

Flashback 技术是以Undo segment中的内容为基础的, 因此受限于UNDO_RETENTON参数。要使用flashback 的特性,必须启用自动撤销管理表空间。

在Oracle 10g中, Flash back家族分为以下成员: Flashback Database, Flashback Drop,Flashback Query(分Flashback Query,Flashbac

- 简单排序:插入排序

dieslrae

插入排序

public void insertSort(int[] array){

int temp;

for(int i=1;i<array.length;i++){

temp = array[i];

for(int k=i-1;k>=0;k--)

- C语言学习六指针小示例、一维数组名含义,定义一个函数输出数组的内容

dcj3sjt126com

c

# include <stdio.h>

int main(void)

{

int * p; //等价于 int *p 也等价于 int* p;

int i = 5;

char ch = 'A';

//p = 5; //error

//p = &ch; //error

//p = ch; //error

p = &i; //

- centos下php redis扩展的安装配置3种方法

dcj3sjt126com

redis

方法一

1.下载php redis扩展包 代码如下 复制代码

#wget http://redis.googlecode.com/files/redis-2.4.4.tar.gz

2 tar -zxvf 解压压缩包,cd /扩展包 (进入扩展包然后 运行phpize 一下是我环境中phpize的目录,/usr/local/php/bin/phpize (一定要

- 线程池(Executors)

shuizhaosi888

线程池

在java类库中,任务执行的主要抽象不是Thread,而是Executor,将任务的提交过程和执行过程解耦

public interface Executor {

void execute(Runnable command);

}

public class RunMain implements Executor{

@Override

pub

- openstack 快速安装笔记

haoningabc

openstack

前提是要配置好yum源

版本icehouse,操作系统redhat6.5

最简化安装,不要cinder和swift

三个节点

172 control节点keystone glance horizon

173 compute节点nova

173 network节点neutron

control

/etc/sysctl.conf

net.ipv4.ip_forward =

- 从c面向对象的实现理解c++的对象(二)

jimmee

C++面向对象虚函数

1. 类就可以看作一个struct,类的方法,可以理解为通过函数指针的方式实现的,类对象分配内存时,只分配成员变量的,函数指针并不需要分配额外的内存保存地址。

2. c++中类的构造函数,就是进行内存分配(malloc),调用构造函数

3. c++中类的析构函数,就时回收内存(free)

4. c++是基于栈和全局数据分配内存的,如果是一个方法内创建的对象,就直接在栈上分配内存了。

专门在

- 如何让那个一个div可以拖动

lingfeng520240

html

<!DOCTYPE html PUBLIC "-//W3C//DTD XHTML 1.0 Transitional//EN" "http://www.w3.org/TR/xhtml1/DTD/xhtml1-transitional.dtd">

<html xmlns="http://www.w3.org/1999/xhtml

- 第10章 高级事件(中)

onestopweb

事件

index.html

<!DOCTYPE html PUBLIC "-//W3C//DTD XHTML 1.0 Transitional//EN" "http://www.w3.org/TR/xhtml1/DTD/xhtml1-transitional.dtd">

<html xmlns="http://www.w3.org/

- 计算两个经纬度之间的距离

roadrunners

计算纬度LBS经度距离

要解决这个问题的时候,到网上查了很多方案,最后计算出来的都与百度计算出来的有出入。下面这个公式计算出来的距离和百度计算出来的距离是一致的。

/**

*

* @param longitudeA

* 经度A点

* @param latitudeA

* 纬度A点

* @param longitudeB

*

- 最具争议的10个Java话题

tomcat_oracle

java

1、Java8已经到来。什么!? Java8 支持lambda。哇哦,RIP Scala! 随着Java8 的发布,出现很多关于新发布的Java8是否有潜力干掉Scala的争论,最终的结论是远远没有那么简单。Java8可能已经在Scala的lambda的包围中突围,但Java并非是函数式编程王位的真正觊觎者。

2、Java 9 即将到来

Oracle早在8月份就发布

- zoj 3826 Hierarchical Notation(模拟)

阿尔萨斯

rar

题目链接:zoj 3826 Hierarchical Notation

题目大意:给定一些结构体,结构体有value值和key值,Q次询问,输出每个key值对应的value值。

解题思路:思路很简单,写个类词法的递归函数,每次将key值映射成一个hash值,用map映射每个key的value起始终止位置,预处理完了查询就很简单了。 这题是最后10分钟出的,因为没有考虑value为{}的情

![]()

![]()