MapReduce代码实现wordcount

https://www.cnblogs.com/huxinga/p/6939896.html

https://www.cnblogs.com/wolfblogs/p/4156403.html

1 maven环境搭建

- 下载maven包,解压到安装路径;

- 默认配置文件setting.xml是在.m2目录下获取的,如果没有会在安装路径conf目录下获取;

- 配置setting.xml,主要是本地仓库路径,及远程仓库路径:

#本地仓库

D:\Program Files\Maven\apache-maven-3.6.1\Repository

#远程仓库配置 默认的远程仓库在国外,很慢

alimaven

aliyun maven

http://maven.aliyun.com/nexus/content/groups/public/

central

- 使用IDE时需要同时将IDE默认的maven配置做修改适配,才可以正常使用maven;

- maven pom.xml文件,wordcount主要依赖

hadoop-common, hadoop-mapreduce-client-core两个jar,pom文件如下:

4.0.0

org.apache.maven.plugins

maven-jar-plugin

WordCount

true

lib/

lessness

MapReduce

1.0-SNAPSHOT

org.apache.hadoop

hadoop-common

3.1.2

org.apache.hadoop

hadoop-mapreduce-client-core

3.1.2

org.projectlombok

lombok

1.16.18

provided

2 编写MapReduce程序

实现MapReduce需要做的实际只需要实现两个函数,org.apache.hadoop.mapreduce.Mapper类内的map函数,和org.apache.hadoop.mapreduce.Reducer内的reduce函数,按照实际的业务在map和reduce内实现逻辑;

一个map函数或者一个reduce函数时否丢应一个task,map和reduce都是有资源管理(yarn的ResourceManger)按实际的分片量来分配的资源,那么一个map对应的时什么输入,时一个分片,还是多个分片,对应的时一个task调用多次map还是一个task调用各自独有的map。同理对reduce也有这个问题,输入reduce函数的时一个partition分块还是一个键值对

后文有简答

实际代码如下:

import java.io.IOException;

import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.Path;

import org.apache.hadoop.io.LongWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Job;

import org.apache.hadoop.mapreduce.Mapper;

import org.apache.hadoop.mapreduce.Reducer;

import org.apache.hadoop.mapreduce.lib.input.FileInputFormat;

import org.apache.hadoop.mapreduce.lib.output.FileOutputFormat;

public class WordCount {

/**

* 一个map函数或者一个reduce函数时否丢应一个task,map和reduce都是有资源管理(yarn的ResourceManger)按实际的分片量来分配的资源

* 那么一个map对应的时什么输入,时一个分片,还是多个分片,对应的时一个task调用多次map还是一个task调用各自独有的map

*/

//自定义的mapper,继承org.apache.hadoop.mapreduce.Mapper

public static class MyMapper extends org.apache.hadoop.mapreduce.Mapper{

/**

* 此处的MAP相当于只做了,区分不懂的输入,对输入分组,同时将输入做映射,

* @param key 输入的键,在本程序这个键无实际意义, 只为记录分片,由于在输入map前输入经切割为多个,此时输入map函数的时分片后的

* @param value 输入的值,在本程序中意味这时输入的文本字符串化了

* @param context hadoop自定义的数据结构,采用泛型的形式,可以自定义输入输出的数据类型,在本文中为单词和出现次数的键值对

* @throws IOException

* @throws InterruptedException

*/

@Override

protected void map(LongWritable key, Text value, Mapper.Context context)

throws IOException, InterruptedException {

String line = value.toString();

//split 函数是用于按指定字符(串)或正则去分割某个字符串,结果以字符串数组形式返回,这里按照"\t"来分割text文件中字符,即一个制表符,这就是为什么我在文本中用了空格分割,导致最后的结果有很大的出入。

String[] splited = line.split("[^a-zA-Z0-9]");

//foreach 就是 for(元素类型t 元素变量x:遍历对象obj){引用x的java语句}

for (String word : splited) {

context.write(new Text(word), new LongWritable(1));

}

}

}

public static class MyReducer extends org.apache.hadoop.mapreduce.Reducer{

/**

* 在shuffle阶段,将Map的键值对对相同键值的做了合并,同时对输入按照键排序;

* reduce阶段每次输入的都是一个键值对

* @param k2 输入的键,对应为单词和出现次数的迭代器,且迭代器值为1

* @param v2s 单词出现次数的迭代器,在本程序中,值为1

* @param context 同上文Map,此处按道理不用在入参处定义,可以作为返回值来处理。

* @throws IOException

* @throws InterruptedException

*/

@Override

protected void reduce(Text k2, Iterable v2s,

Reducer.Context context) throws IOException, InterruptedException {

//由于做了shufft, 相同的键的值合并为迭代器,并且按键排序了

long count = 0L;

for (LongWritable v2 : v2s) {

count += v2.get();

}

LongWritable v3 = new LongWritable(count);

context.write(k2, v3);

}

}

//客户端代码,写完交给ResourceManager框架去执行

public static void main(String[] args) throws Exception {

/**

* 运行mapreduce程序前都要初始化Configuration,该类主要是读取mapreduce系统配置信息,这些信息包括hdfs还有mapreduce,

* 也就是安装hadoop时候的配置文件例如:core-site.xml、hdfs-site.xml和mapred-site.xml等等文件里的信息,

* 我们开发mapreduce时候只是在填空,在map函数和reduce函数里编写实际进行的业务逻辑,

* 其它的工作都是交给mapreduce框架自己操作的,但是至少我们要告诉它怎么操作啊,

* 比如hdfs在哪里啊,mapreduce的jobstracker在哪里啊,而这些信息就在conf包下的配置文件里。

* https://www.cnblogs.com/wolfblogs/p/4156403.html

*/

Configuration conf = new Configuration(); //获取hadoop配置信息,此处也可以自定义写入配置参数

conf.setInt("", 1);

Job job = Job.getInstance(conf, WordCount.class.getSimpleName());

// 打成jar执行

job.setJarByClass(WordCount.class);

//数据在哪里?

FileInputFormat.setInputPaths(job, args[0]);

//使用哪个mapper处理输入的数据?

job.setMapperClass(MyMapper.class);

//map输出的数据类型是什么?

job.setMapOutputKeyClass(Text.class);

job.setMapOutputValueClass(LongWritable.class);

//使用哪个reducer处理输入的数据?

job.setReducerClass(MyReducer.class);

//reduce输出的数据类型是什么?

job.setOutputKeyClass(Text.class);

job.setOutputValueClass(LongWritable.class);

//数据输出到哪里?

FileOutputFormat.setOutputPath(job, new Path(args[1]));

//交给yarn去执行,直到执行结束才退出本程序, 此处应该时按照实际hadoop环境配置决定怎么执行的

job.waitForCompletion(true);

}

}

3 mapreduce原理详解

首先讲讲物理实体,参入mapreduce作业执行涉及4个独立的实体:

客户端(client):编写mapreduce程序,配置作业,提交作业,这就是程序员完成的工作;

JobTracker:初始化作业,分配作业,与TaskTracker通信,协调整个作业的执行,对应于yarn的ResourceManager;

TaskTracker:保持与JobTracker的通信,在分配的数据片段上执行Map或Reduce任务,TaskTracker和JobTracker的不同有个很重要的方面,就是在执行任务时候TaskTracker可以有n多个,JobTracker则只会有一个(JobTracker只能有一个就和hdfs里namenode一样存在单点故障,我会在后面的mapreduce的相关问题里讲到这个问题的)

Hdfs:保存作业的数据、配置信息等等,最后的结果也是保存在hdfs上面,输入输出都是在hdfs内的,但是也可以在本地文件系统下运行,这样就存放在本地文件系统下。

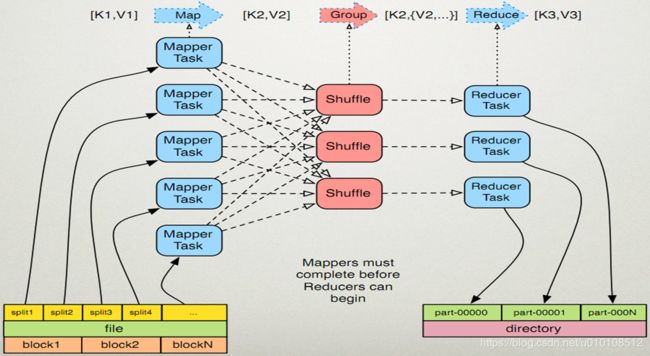

MapReduce的运行机制:

首先是客户端要编写好mapreduce程序,配置好mapreduce的作业也就是job,接下来就是提交job了,提交job是提交到JobTracker上的,这个时候JobTracker就会构建这个job,具体就是分配一个新的job任务的ID值,接下来它会做检查操作,这个检查就是确定输出目录是否存在,如果存在那么job就不能正常运行下去,JobTracker会抛出错误给客户端,接下来还要检查输入目录是否存在,如果不存在同样抛出错误,如果存在JobTracker会根据输入计算输入分片(Input Split),如果分片计算不出来也会抛出错误,至于输入分片后面会做讲解的,这些都做好了JobTracker就会配置Job需要的资源了。分配好资源后,JobTracker就会初始化作业,初始化主要做的是将Job放入一个内部的队列,让配置好的作业调度器能调度到这个作业,作业调度器会初始化这个job,初始化就是创建一个正在运行的job对象(封装任务和记录信息),以便JobTracker跟踪job的状态和进程。

初始化完毕后,作业调度器会获取输入分片信息(input split),每个分片创建一个map任务。接下来就是任务分配了,这个时候tasktracker会运行一个简单的循环机制定期发送心跳给jobtracker,心跳间隔是5秒,程序员可以配置这个时间,心跳就是jobtracker和tasktracker沟通的桥梁,通过心跳,jobtracker可以监控tasktracker是否存活,也可以获取tasktracker处理的状态和问题,同时tasktracker也可以通过心跳里的返回值获取jobtracker给它的操作指令。任务分配好后就是执行任务了。在任务执行时候jobtracker可以通过心跳机制监控tasktracker的状态和进度,同时也能计算出整个job的状态和进度,而tasktracker也可以本地监控自己的状态和进度。当jobtracker获得了最后一个完成指定任务的tasktracker操作成功的通知时候,jobtracker会把整个job状态置为成功,然后当客户端查询job运行状态时候(注意:这个是异步操作),客户端会查到job完成的通知的。如果job中途失败,mapreduce也会有相应机制处理,一般而言如果不是程序员程序本身有bug,mapreduce错误处理机制都能保证提交的job能正常完成。

下面我从逻辑实体的角度讲解mapreduce运行机制,这些按照时间顺序包括:输入分片(input split)、map阶段、combiner阶段、shuffle阶段和reduce阶段。

1. 输入分片(input split):在进行map计算之前,mapreduce会根据输入文件计算输入分片(input split),每个输入分片(input split)针对一个map任务,输入分片(input split)存储的并非数据本身,而是一个分片长度和一个记录数据的位置的数组,输入分片(input split)往往和hdfs的block(块)关系很密切,假如我们设定hdfs的块的大小是64mb,如果我们输入有三个文件,大小分别是3mb、65mb和127mb,那么mapreduce会把3mb文件分为一个输入分片(input split),65mb则是两个输入分片(input split)而127mb也是两个输入分片(input split),换句话说我们如果在map计算前做输入分片调整,例如合并小文件,那么就会有5个map任务将执行,而且每个map执行的数据大小不均,这个也是mapreduce优化计算的一个关键点。

2. map阶段:就是程序员编写好的map函数了,因此map函数效率相对好控制,而且一般map操作都是本地化操作也就是在数据存储节点上进行;

3. combiner阶段:combiner阶段是程序员可以选择的,combiner其实也是一种reduce操作,因此我们看见WordCount类里是用reduce进行加载的。Combiner是一个本地化的reduce操作,它是map运算的后续操作,主要是在map计算出中间文件前做一个简单的合并重复key值的操作,例如我们对文件里的单词频率做统计,map计算时候如果碰到一个hadoop的单词就会记录为1,但是这篇文章里hadoop可能会出现n多次,那么map输出文件冗余就会很多,因此在reduce计算前对相同的key做一个合并操作,那么文件会变小,这样就提高了宽带的传输效率,毕竟hadoop计算力宽带资源往往是计算的瓶颈也是最为宝贵的资源,但是combiner操作是有风险的,使用它的原则是combiner的输入不会影响到reduce计算的最终输入,例如:如果计算只是求总数,最大值,最小值可以使用combiner,但是做平均值计算使用combiner的话,最终的reduce计算结果就会出错。

4. shuffle阶段:将map的输出作为reduce的输入的过程就是shuffle了,这个是mapreduce优化的重点地方。这里我不讲怎么优化shuffle阶段,讲讲shuffle阶段的原理,因为大部分的书籍里都没讲清楚shuffle阶段。Shuffle一开始就是map阶段做输出操作,一般mapreduce计算的都是海量数据,map输出时候不可能把所有文件都放到内存操作,因此map写入磁盘的过程十分的复杂,更何况map输出时候要对结果进行排序,内存开销是很大的,map在做输出时候会在内存里开启一个环形内存缓冲区,这个缓冲区专门用来输出的,默认大小是100mb,并且在配置文件里为这个缓冲区设定了一个阀值,默认是0.80(这个大小和阀值都是可以在配置文件里进行配置的),同时map还会为输出操作启动一个守护线程,如果缓冲区的内存达到了阀值的80%时候,这个守护线程就会把内容写到磁盘上,这个过程叫spill,另外的20%内存可以继续写入要写进磁盘的数据,写入磁盘和写入内存操作是互不干扰的,如果缓存区被撑满了,那么map就会阻塞写入内存的操作,让写入磁盘操作完成后再继续执行写入内存操作,前面我讲到写入磁盘前会有个排序操作,这个是在写入磁盘操作时候进行,不是在写入内存时候进行的,如果我们定义了combiner函数,那么排序前还会执行combiner操作。

每次spilt操作也就是写入磁盘操作时候就会写一个溢出文件,也就是说在做map输出有几次spill就会产生多少个溢出文件,等map输出全部做完后,map会合并这些输出文件。这个过程里还会有一个Partitioner操作,对于这个操作很多人都很迷糊,其实Partitioner操作和map阶段的输入分片(Input split)很像,一个Partitioner对应一个reduce作业,如果我们mapreduce操作只有一个reduce操作,那么Partitioner就只有一个,如果我们有多个reduce操作,那么Partitioner对应的就会有多个,Partitioner因此就是reduce的输入分片,这个程序员可以编程控制,主要是根据实际key和value的值,根据实际业务类型或者为了更好的reduce负载均衡要求进行,这是提高reduce效率的一个关键所在。到了reduce阶段就是合并map输出文件了,Partitioner会找到对应的map输出文件,然后进行复制操作,复制操作时reduce会开启几个复制线程,这些线程默认个数是5个,程序员也可以在配置文件更改复制线程的个数,这个复制过程和map写入磁盘过程类似,也有阀值和内存大小,阀值一样可以在配置文件里配置,而内存大小是直接使用reduce的tasktracker的内存大小,复制时候reduce还会进行排序操作和合并文件操作,这些操作完了就会进行reduce计算了。

5. reduce阶段:和map函数一样也是程序员编写的,最终结果是存储在hdfs上的。

4 Hadoop实际任务调度,及数据在集群内的流转

TODO

5 Mapreduce的相关问题

① jobtracker的单点故障:jobtracker和hdfs的namenode一样也存在单点故障,单点故障一直是hadoop被人诟病的大问题,为什么hadoop的做的文件系统和mapreduce计算框架都是高容错的,但是最重要的管理节点的故障机制却如此不好,我认为主要是namenode和jobtracker在实际运行中都是在内存操作,而做到内存的容错就比较复杂了,只有当内存数据被持久化后容错才好做,namenode和jobtracker都可以备份自己持久化的文件,但是这个持久化都会有延迟,因此真的出故障,任然不能整体恢复,另外hadoop框架里包含zookeeper框架,zookeeper可以结合jobtracker,用几台机器同时部署jobtracker,保证一台出故障,有一台马上能补充上,不过这种方式也没法恢复正在跑的mapreduce任务。

② 做mapreduce计算时候的输入输出检查:输出一般是一个文件夹,而且该文件夹是不能存在,而且这个检查做的很早,当我们提交job时候就会进行,mapreduce之所以这么设计是保证数据可靠性,如果输出目录存在reduce就搞不清楚你到底是要追加还是覆盖,不管是追加和覆盖操作都会有可能导致最终结果出问题,mapreduce是做海量数据计算,一个生产计算的成本很高,例如一个job完全执行完可能要几个小时,因此一切影响错误的情况mapreduce是零容忍的。

③ Mapreduce的输入输出流:还有一个InputFormat和OutputFormat,我们在编写map函数时候发现map方法的参数是直接操作行数据,没有牵涉到InputFormat,这些事情在我们new Path时候mapreduce计算框架帮我们做好了,而OutputFormat也是reduce帮我们做好了,我们使用什么样的输入文件,就要调用什么样的InputFormat,InputFormat是和我们输入的文件类型相关的,mapreduce里常用的InputFormat有FileInputFormat普通文本文件,SequenceFileInputFormat是指hadoop的序列化文件,另外还有KeyValueTextInputFormat。OutputFormat就是我们想最终存储到hdfs系统上的文件格式了,这个根据你需要定义了,hadoop有支持很多文件格式。