【论文解读 KDD 2018 | HEER】Easing Embedding Learning by Comprehensive Transcription of HIN

论文链接:https://dl.acm.org/doi/10.1145/3219819.3220006

代码链接:https://github.com/GentleZhu/HEER

会议:KDD 2018

目录

1 摘要

2 介绍

2.1 动机

2.2 作者分析了现有的一些方法

2.3 挑战

2.4 贡献

3 HEER

3.1 一些定义

3.2 The HEER Model

4 总结

参考文献

1 摘要

HIN在引入丰富的信息的同时,也引入了潜在的不兼容性。为了保留网络中丰富但潜在不兼容的信息,作者研究了对HIN的综合转录问题。本文提出了HEER算法,通过结合边的表示和恰当的异质度量,学习HIN的嵌入表示。(实验任务是edge reconstruction task)

2 介绍

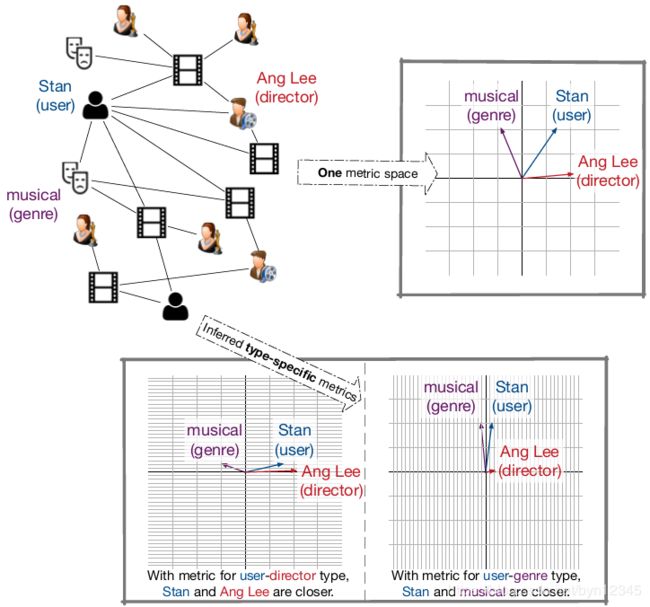

HIN不仅引入了丰富的语义信息,还引入了潜在不兼容的语义信息,这为HIN的嵌入学习带来了挑战。例如下图所示,Stan喜欢musical类型的电影,也喜欢Ang Lee导演的电影。但是Ang Lee没有导演过musical类型的电影,所以若这些节点都被映射到同一个度量空间的话,Ang Lee和musical的距离会很远,因为它们不相似。因此,在同一个度量空间中,Stan不可能同时和这两个节点距离近。为了缓解这一问题,作者引入边的表示并且针对不同类型的边使用不同的度量空间。这样Stan节点可以在两个度量空间中分别于Ang Lee和musical距离近。

2.1 动机

(1)研究HIN的综合转录问题,目标是在嵌入表示中融入HIN中丰富且有着潜在不兼容性的语义信息,并且不涉及额外的专家知识、特征工程以及监督。

(2)提供易于使用的方法,充分发挥HIN中的信息,以实现多种多样的应用。

2.2 作者分析了现有的一些方法

(1)解决同质信息网络的方法通常是基于元路径的,这不能解决HIN的综合转录问题。因为元路径的选择很麻烦,而且选取出来的元路径只针对特定任务或者只能反映出HIN的部分信息。

(2)还有一些针对HIN的方法,只对特定种类的HIN或添加了副信息的HIN进行了表示学习。这些方法不能应用到一般的HIN。并且大多数针对HIN的嵌入表示方法只为表示学习提供了一个度量空间,这可以处理HIN中部分可兼容语义信息,但是若对HIN整体记性综合转录则会带来信息损失。

(3)最近的研究[1]提出了一个方法,通过在嵌入学习前将HIN分解成多个领域的,实现了在避免信息损失的条件下(如:丰富的异质信息、潜在冲突的语义信息)获得高质量的HIN表示。但是这种方法独立地获取到了不同领域的信息,但是完全禁止了跨领域的联合学习。本文提出的方法允许不同兼容性的网络组件,在联合学习过程中进行不同程度的协作。

2.3 挑战

(1)对复杂且不兼容的异质信息进行编码;

(2)在无监督的情况下捕获HIN的机构信息,并且能辨别出潜在不兼容的语义信息。

作者提出HEER算法,在节点表示的基础上建立边的表示,并且为不同类型的边采用不同的异构度量。同时,不同类型的边上的信息也被利用,反过来更新节点表示和边表示。

2.4 贡献

(1)研究了HIN嵌入学习中的综合转录问题,保留了HIN丰富的语义信息,并且易于在下游任务中使用。

(2)提出现实世界中的HIN存在不可兼容的语义信息,这为HIN的综合转录带来了挑战。

(3)提出算法HEER,利用边的表示和异构度量,解决HIN的综合转录问题。

(4)实验证明了HEER的有效性。

3 HEER

3.1 一些定义

(1)异质信息网络

- 有向图

,节点类型映射

,节点类型映射 ,边类型映射

,边类型映射 ,

, 或

或 。

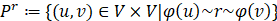

。 - 对于边类型

,定义

,定义 ,其中

,其中 表示节点类型对

表示节点类型对 由类型为r的边连接。

由类型为r的边连接。  表示从节点u到节点v的类型为r的连边e的权重。

表示从节点u到节点v的类型为r的连边e的权重。 分别代表节点u的连边类型为r的出度和入度。

分别代表节点u的连边类型为r的出度和入度。

(2)节点和边的表示

- 节点嵌入映射为

,边嵌入映射为

,边嵌入映射为 。

。 - 节点嵌入为

,节点对(u,v)由边嵌入

,节点对(u,v)由边嵌入 表示。

表示。

(3)HIN的综合转录

学习到尽可能多的HIN中的丰富信息用于表示,并且不需要额外的专家知识、特征工程,也不需要监督。

3.2 The HEER Model

学习到的HIN的嵌入表示应该对语义信息进行了有效的编码,所以应有重构HIN的能力。HEER模型使用边的表示,不仅能够预测两节点间是否有边,还能推断出边的类型。

为了让HEER能够处理无向图和有向图,节点嵌入根据出入度被分成了两部分:![]() 。基于节点嵌入的边嵌入表示如下:

。基于节点嵌入的边嵌入表示如下:

已知边的嵌入表示![]() 的条件下,定义节点对(u, v)的typed closeness如下,其中

的条件下,定义节点对(u, v)的typed closeness如下,其中![]() 表示类型为r的边向量:

表示类型为r的边向量:

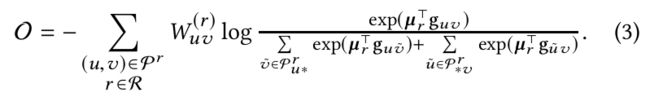

为了衡量嵌入表示重构HIN的能力,需要针对边类型r最小化权重和typed closeness的差异:

将式(1)带入式(2),最终的目标函数如下:

模型如下图所示:

该模型结构,输入是一个异质网络,之后网络中的节点使用index表示,通过F网络学习出node embedding,之后通过g函数来学习出边的embedding,最后通过type之间的相似度,也就是定义的相似度函数和原始连接关系共同作为ground truth,最后训练出网络参数,从而能够学到网络的嵌入模型。

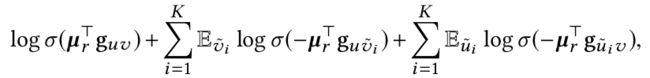

由于式(1)的分母计算复杂。所以采用负采样的方法缩短计算时间。每次(u, v)之间类型为r的边,都以正比于权重的概率从HIN中采样。得到K个负样本节点对![]() 和K个负样本节点对

和K个负样本节点对![]() 。损失函数计算如下:

。损失函数计算如下:

作者使用mini-batch随机下降最小化带有负采样的损失函数,并且使用LINE预训练的节点嵌入初始化为HEER中的节点嵌入,μr![]() 初始化为值全为1的向量。

初始化为值全为1的向量。

4 总结

HEER模型提出了HIN中由于类型不同而导致的语义不兼容性,使用边的表示和不同的度量空间表示解决了这一问题,想法很有新意。

HEER不光学习到了节点的表示,还学习到了边的表示。

但是HEER模型也有一定的局限性,没有充分利用HIN的复杂结构信息,只考虑到了节点对(节点的一阶邻居)来生成嵌入表示。要想利用更复杂的信息,可能还需要基于元路径的方法或者是其他新方法。

实验只进行了边重构这一个任务,有些单一,不知道在其他典型的任务上效果如何。

参考文献

[1] Yu Shi, Huan Gui, Qi Zhu, Lance Kaplan, and Jiawei Han. 2018. AspEm: Embedding Learning by Aspects in Heterogeneous Information Networks.. In SDM.