Object Tracking in Satellite Videos by Fusing the Kernel Correlation Filter and the Three-Frame-Diff

抽象

对象跟踪是计算机视觉领域的热门话题。高分辨率遥感传感器提供的详细空间信息使跟踪卫星视频中的目标成为可能。近年来,相关过滤器已经产生了令人鼓舞的结果。但是,在处理卫星视频中的对象跟踪方面,由于每个目标的大小与整个图像相比都太小,并且目标和背景是非常相似。因此,在这封信中,我们通过融合KCF跟踪器和三帧差算法,提出了一种新的卫星视频目标跟踪方法。本文提出了一种特定的策略,以利用KCF跟踪器和三帧差异算法来构建强大的跟踪器。我们在三个卫星视频中评估了所提出的方法,并展示了其相对于其他最新跟踪方法的优越性。索引词-数据融合,内核相关过滤器(KCF),对象跟踪,卫星视频,三帧差异。

一 引言

在针对低分辨率图像的视觉信息处理术语中,大多数算法效果不佳[1]。为了获得有关图像的更多信息,非常需要高分辨率(VHR)的图像[2]。因此,VHR遥感影像已引起人们极大的兴趣,并在许多应用中得到了广泛的应用[3] – [6]。最近,商业卫星技术在捕获VHR视频方面取得了重大进展。遥感视频具有进行运动分析[3],交通监控[4],[5],可疑物体监视[6]等的巨大潜力。目前,国际空间站发布的具有1m空间分辨率的视频[ 7],并引起了很多关于车辆目标识别和跟踪的关注。中国生产的吉林一号商业卫星可以提供0.72 m的空间分辨率的VHR卫星视频[8]。这些进步表明,可以从卫星视频中跟踪移动物体。

通常,跟踪算法可以根据其表示方案分为生成模型[9]-[12]或判别模型[13]-[20]。就生成模型而言,跟踪被视为搜索问题,以在前一帧的邻域内找到与目标对象最相似的区域。已经提出了多种基于生成模型的搜索算法。例如,l1-tracker [9]使用了目标和琐碎片段模板的稀疏线性组合。亚当等。 [10]设计了一种外观模型来处理部分遮挡。罗斯等。 [11]提出了增量视觉跟踪算法来理解增量低维子空间[21]。区分模型比生成模型引起了广泛的关注。他们将对象跟踪视为二进制分类问题。野兔等。 [13]利用图像特征来训练基于支持向量机[17],[22]的分类器。 Kalal等。 [15]使用了一组结构约束来指导升压分类器的采样过程。另外,已经投入了大量的精力来提取特征[23],例如颜色特征,基于可变形部分的模型[24]和卷积神经网络(CNN)。使用颜色特征[25]-[29]和CNN [30]-[32]的算法已经获得了令人满意的结果。

最近,基于相关滤波器的跟踪方法在对象跟踪中获得了出色的性能[18],[20],[26],[27],[33]-[35]。 Henriques等。 [18]提出了一种核相关滤波器(KCF)算法,在目标周围区域进行密集采样。它可以通过密集采样来利用负样本中的大量信息。此外,KCF通过构造循环矩阵将计算从空间域转换为傅立叶域。结果,大大降低了计算成本。

对于卫星视频,一帧的总大小最多可以达到3840×2160像素或更多,包含超过800万像素,是正常帧大小的100倍以上。同时,感兴趣的目标仅占用约30×80像素,有时甚至更少。与整个分析框架相比,这太小了。此外,目标与背景非常相似,并且分辨率较低。这些问题导致跟踪窗口漂移的可能性更高。卫星摄像机相对稳定,在卫星视频体验中目标的周围环境的变化少于常见的对象跟踪数据。

因此,我们利用三帧差方法检测运动物体。三帧差异方法可以检测到三帧之间的细微变化和像素相关的变化,并且可以突出显示背景中较小的移动目标。借助于三帧差方法,可以减少由KCF引起的漂移偏移。

因此,在这封信中,我们通过融合KCF跟踪器和卫星视频的三帧差方法,提出了一种新的对象跟踪方法。 KCF跟踪器和三帧差异方法包含在特定的融合框架中。这种融合策略可以同时利用KCF跟踪器和三帧差异方法。通过将来自KCF跟踪器的形状信息和来自三帧差异方法的变化信息组合到最终跟踪结果中,与许多最新的跟踪算法相比,我们提出的方法可以更准确地解决每个目标的位置。图1显示了该方法的总体流程图。由于卫星图像的整体尺寸太大,因此我们放大了图像的很小区域,其中包括运动目标。

二 方法

A.三帧差异

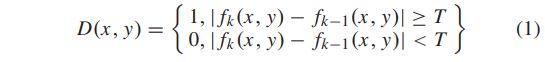

对于给定的视频序列,当前帧由第k帧表示,前一帧由第(k-1)帧表示。 生成二进制图像D为

其中fk(x,y)表示第k帧在点(x,y)上的灰度值,D(x,y)表示相应的二进制值,T是阈值,对于这三个的最终结果非常重要 帧差异。 T由Otsu自动计算[36]。 Wojcik和Kaminski [37]提出了三帧差方法。 给定三个连续的帧,例如,第(k-1),第k和第(k 1),通过从第(k)帧中减去第(k -1)帧来计算D1(x,y),如(2) ),然后如(3)所示,通过从第(k 1)帧中减去第k帧来计算D2(x,y)。 然后,(4)可用于通过D1(x,y)∩D1(x,y)生成D(x,y)

与直观的两帧差相比,三帧差方法可以更有效地处理遮挡,并且可以减少无关的噪声点。

B.内核相关过滤器跟踪

大多数现代跟踪器的核心组件是区分性分类器,其任务是区分目标及其周围环境。为了应对自然图像变化,通常使用翻译和缩放后的样本补丁来训练分类器。这样的样本集充满了冗余-任何重叠的像素都必须相同。基于简单的观察,提出了KCF [18],以充分利用阴性样本并减少冗余。此外,KCF将跟踪问题视为回归而非分类。对于每个样本,KCF不会将正样本标记为1,将负样本标记为0,而是给出介于0和1之间的值。

典型的基于相关滤波器的跟踪器将目标区域样本图像X的大小为I×J的分类器训练。通过将X循环移位,如(5)所示,该方法获得大量训练样本xi,j,其中(i,j)∈{0,1,...,I -1}×{0,1,.。 。,J − 1}

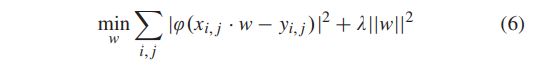

其中x = [x1,x2,...,xn]表示基本样本,而X表示通过循环移位x的训练样本。 对于二维图像块,x表示图像块的一维特征表示,例如定向梯度直方图(HOG)。 KCF利用分类器将它们映射到高斯函数标签yi,j。 然后,该算法使用滤波器w对目标进行建模。 岭回归训练结果可以通过搜索最小值来获得。

其中ϕ表示核函数将特征映射到核空间中,而λ是正则化参数。 根据[18],已知w = i,jαi,j ϕ(xi,j),其中

在(7)中,kx x代表核相关性[18],F被定义为离散算子,而λ是一个常数以减少过拟合的可能性。 在这里,我们采用以下高斯核函数:

其中F-1表示傅立叶逆变换,F ∗(x’)指F(x’)的共轭,是矩阵的Hadamard乘积。

在检测阶段,我们首先将前一帧中的目标位置作为中心位置,在新帧中裁剪大小为I×J的图像块z,然后将分类器的响应值计算为

其中,x~是学习目标的外观模型,响应值yˆ是指候选目标与真实目标之间的相似度。 这样,可以通过搜索y ^的最大值,即,

然后,可以估计当前帧中的目标位置,将其用作下一帧的基本样本。

C.追踪器融合

在本节中,我们将介绍融合策略,以结合KCF跟踪器的结果和三帧差异[38]。 对于每一帧,输入是KCF跟踪器的结果和三帧差异。 我们称结果为Tj,j∈[1,2]。 每个跟踪结果由N个有边界的候选样本bi,j i∈[1 ... N]-序列中每个帧一个。 通过我们的方法创建的融合结果T *每帧包含一个矩形框。

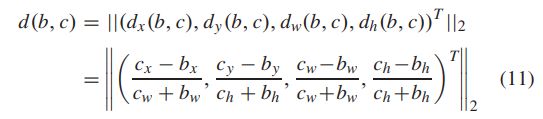

与数据融合中的多数表决不同,该方法为每个候选框设置一个参数,我们称其为吸引力a。 融合候选者离跟踪结果框越近,其吸引力就越大。 首先,我们将介绍如何计算两个盒子之间的距离。 对于框b和c,可以按以下方式计算距离:

其中x,y,w和h表示框的左上角的水平纵坐标,宽度和高度。 我们假设所有盒子都具有相同的大小,并且忽略比例更改,因此可以如下简化距离:

其中σ是一个常数,用于控制距离对吸引力的影响。 此参数对于最终跟踪结果至关重要。 bi,j表示在帧i处算法j的候选框。 为了找到最终融合盒e ∗ i∈T ∗,我们选择所有候选盒子中吸引力最大的一个作为最终结果。 在这封信中,我们将基于三帧差方法和KCF跟踪器构建一个融合跟踪器。 算法1中介绍了我们算法的基本步骤。

三 实验内容

实验中使用了三个视频。前两个视频由Deimos Imaging和UrtheCast提供,第三个视频由Chang Guang Satellite Technology Co.,Ltd提供。这些视频分别描述了加拿大,迪拜和新德里的交通状况。第一和第二数据集的图像大小为3840×2160像素。第三个数据集的图像大小为3600×2700像素。对于我们的实验,已选择列车和汽车作为目标。图2显示了这三个数据集的详细信息。此外,我们将第一帧的位置初始化,并通过将输出跟踪边界框与地面真实边界框进行比较来评估所提出的算法。为了进行比较,采用了五种最新的跟踪算法:跟踪学习检测(TLD)[15],触击[13],KCF [18],长期相关跟踪(LCT)[39]和判别尺度空间跟踪(DSST)[33]。

该算法在具有8 GB内存和Intel Core i5 2.8 GHz CPU的C OpenCV库中实现。所提算法的速度为9帧/秒。由于以前在KCF算法上的工作已经证明,与应用原始像素特征相比,应用HOG特征可以实现更高的跟踪精度,因此我们在融合框架中采用了HOG特征[18]。搜索窗口的大小设置为目标大小的1.5倍。高斯函数中使用的σ已选择为0.5。 HOG特征的像元大小为4×4,块大小为16×16,块步幅为8×8,HOG特征的方向仓数为9。此外,正则化λ设置为10 −4。将(7)中的α设定为0.25。所有这些参数均设置为与[18]相同。对于三帧差计算,(2)和(3)中的T值通过自适应聚类图像阈值获得,即OTSU [36]。对于实验的融合部分,将控制距离对(13)中的吸引力的影响的常数σ设置为地面真值边界框的初始大小。

在评估指标方面,已经采用了精度图和成功图[40],[41]。如果预测的目标中心在距地面真相的距离阈值内,则可以认为帧已正确跟踪。精度曲线仅显示在一定距离范围内正确跟踪的帧的百分比。如图3所示,相对于其他五个精确度绘图的竞争对手跟踪器,我们的方法取得了出色的性能。我们还计算了每个跟踪器的曲线下面积(AUC)。对于精确图,所提出方法的AUC为0.76,大于LCT(0.74),DSST(0.52),KCF(0.38),打击(0.36)和TLD(0.33)。如果预测目标和地面真相的重叠分数(OS)大于阈值,则可以将一帧视为正确帧。就成功图而言,建议方法的AUC为0.56,大于LCT(0.54),DSST(0.41),KCF(0.26),打击(0.23)和TLD(0.21)。表I和II分别根据像素的中心位置误差(CLE)和OS的百分比列出了准确的结果。最佳性能用红色粗体数字标记。拟议的融合跟踪器在迪拜和新德里数据集中排名第一,在加拿大数据集中排名第二。拟议的融合跟踪器的平均CLE和OS优于其他五个跟踪器。实际上,就迪拜和新德里数据集而言,TLD,struck和KCF完全失败,而就新德里数据集而言,DSST完全失败。对于所有三个数据集,只有拟议的融合跟踪器和LCT成功。结果表明,所提出的融合跟踪器对于卫星视频跟踪是有效的。

图4显示了这三个视频的一些跟踪结果的屏幕截图。除了我们提出的方法外,还选择了LCT和DSST,因为它们在比较算法方面的性能要优于其他方法。可以看出,我们提出的方法可以准确地跟踪运动目标。 LCT可以达到视觉上相似的结果。但是,根据图3以及表I和II所示的定量评估,我们提出的方法是优越的。

提出的方法的性能比其他现有技术更高的原因如下。在卫星视频中,由于分辨率相对较低,目标只能移动很小,并且与背景极为相似。为了解决这些问题,我们将KCF [18]跟踪器与三帧差方法相结合,形成了我们提出的方法。三帧差异方法可以检测到三帧之间的微小变化和像素相关的变化,甚至可以在背景中突出显示小的移动目标。三帧差异法可以捕获目标的大致区域,而KCF跟踪器可以定位目标的更精确位置。相反,其他五种最新算法未能检测到目标的轻微变化。

四 结论

在这封信中,已经提出了一种用于在卫星视频中进行目标跟踪的新型融合跟踪器。提出的新型融合跟踪器融合了KCF跟踪器和三帧差异方法。由于卫星图像的像素超过800万,并且目标物体很小,并且图像的分辨率较低,因此大多数传统的对象跟踪算法都无法获得令人满意的结果。提出的融合跟踪器同时利用了KCF跟踪器和三帧差异方法,并将它们与特定策略融合在一起。我们通过评估每个候选框与KCF跟踪器生成的边界框之间的距离以及三帧差计算来确定其吸引力值。在三个卫星视频上进行的实验表明,在精确度图和成功度图上,融合跟踪器的性能优于五个最新跟踪器。未来工作的一个有趣方向是改善融合跟踪器的时间性能