统计学习方法笔记——k近邻算法

- 简介

- k近邻算法

- k近邻模型

- 模型

- 距离度量

- k值的选择

- 分类决策规则

- k近邻算法的实现:kd树

- 构造kd树

- 搜索kd树

简介

k近邻法是一种基本分类与回归方法。k近邻法假设给定一个训练数据集,其中的实例类别已定。分类时,对新的实例,根据其k个最近邻的训练实例的类别,通过多数表决方式预测。因此,不具有显示的学习过程。k值的选择、距离度量、分类决策规则是k近邻法的三个基本要素。于1968年由Cover和Hart提出。

k近邻算法

直观解释就是:给定一个训练集,对新的输入实例,在训练集中找到与该实例最邻近的k个实例,这k个实例的多数属于某个类,就把该输入实例分为这个类。

算法3.1(k近邻法)

输入:训练集 T=(x1,y1),(x2,y2),...,(xN,yN) T = ( x 1 , y 1 ) , ( x 2 , y 2 ) , . . . , ( x N , y N ) 。

输出:实例x所属的类y

(1) 根据给定的距离度量,在训练集T中找出与x最邻近的k个点,涵盖着k个点的x的邻域记作 Nk(x) N k ( x ) ;

(2) 在 Nk(x) N k ( x ) 中根据分类决策规则(如多数表决)决定x的类别y:

其中 I I 为指示函数,即当 yi=cj y i = c j 时 I I 为1,否则 I I 为0。

当k=1时就被称为 最近邻算法。

k近邻模型

模型

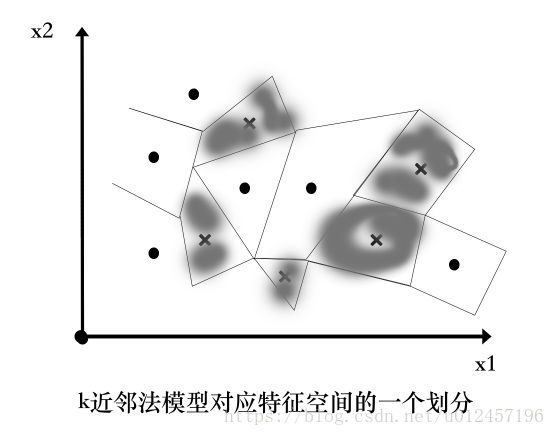

k近邻法中,当训练集、距离度量(如欧式距离)、k值及分类决策规则(如多数表决)确定后,对任何一个新的输入实例,它所属的类唯一的确定。这相当于已经将特征空间划分为一些子空间,子空间里面的每个点所属的类都已经被分好了。

特征空间中,每个训练集中的类别 yi y i 有如瓜分领土般将特征空间划分自己的势力范围,在每个划分的小块叫做单元(cell)。每个训练实例有一个单元, yi y i 作为其单元中所有点的类标记(class label)。这就导致每个单元的实例点的类别是确定的。如下图所示:

距离度量

特征空间中两个实例点的距离是两个实例点相似程度的反映,k近邻算法一般是n维的向量空间,使用的距离是欧式距离,也可以是其他更一般的 Lp L p 距离或Minkowski距离。

对于两个输入向量 xi,xj x i , x j 的 Lp L p 距离定义为:

当p=2时称为 欧式距离(Euclidean distance),当p=1时称为 曼哈顿距离(Manhattan distance)

当 p=∞ p = ∞ 时,它是各个坐标距离的最大值,即

k值的选择

k值得选择会对k近邻算法的结果产生重大影响。若选择较小的k值,近似误差会减小,只有与输入实例较近的训练实例才会起作用,但缺点是估计误差会增大,预测结果会对近邻的实例点非常敏感,若近邻点是噪声预测就会出错。k值得减小意味着整体模型变得复杂,容易发生过拟合。

若选取较大的k值,则与上面相反,选取与输入实例较远的训练实例也会对预测起作用。k值得增大意味着整体模型变得简答。

实际应用中,k值一般选取较小的值,采用交叉验证来选取最优的k值。

分类决策规则

k近邻法中的分类决策规则往往是多数表决,即由输入实例的k个近邻的训练实例中的多数类决定。

给定 x∈X x ∈ X ,其最近邻的k个训练实例点构成集合 Nk(x) N k ( x ) ,如果涵盖 Nk(x) N k ( x ) 的区域的类别是 cj c j ,那么误分类率是:

要是的 误分类率即 经验风险最小,所以多数表决规则等价于经验风险最小化。

k近邻算法的实现:kd树

实现k近邻法时,主要考虑的问题时如何对训练数据进行快速k近邻搜索。k近邻法最简单的实现方法是线性扫描,这要计算输入实例与每一个训练实例的距离。当数据量很大时不可行。为了提高效率,可以考虑使用特殊的结构存储训练数据,以减少计算距离的次数。比如kd树。

构造kd树

kd树是一种对k维空间中的实例点进行存储以便对其快速检索的树形结构,它是二叉树。表示对k维空间的一个划分。构造kd树相当于不断地用垂直于坐标轴的超平面将k维空间切分,构成一系列的k维超矩形区域。kd树的每个结点对应于一个k维超矩形区域。

构造kd树的方法如下:构造根结点,使得根结点对应于k维空间中包含所有实例点的超矩形区域;通过下面的递归方法,不断的对k维空间进行切分,生成子节点。在矩形区域(结点)上面选择一个坐标轴和在此坐标轴上的一个切分店,确定一个超平面,这个超平面通过选定的切分点并垂直于选定的坐标轴,将当前超矩形区域切分为左右两个子区域。这时,实例被分到两个子区域。这个过程直到子区域内没有实例时终止(到了叶结点)。过程中将实例保存在相应的结点上。

通常,一次选择坐标轴对空间切分,选择训练实例点在选定坐标轴上的中位数为切分点。这样得到的kd数是平衡的。但平衡kd数搜索时效率未必是最优的。

例子:给定一个二维空间数据集:

构造一个平衡kd树。

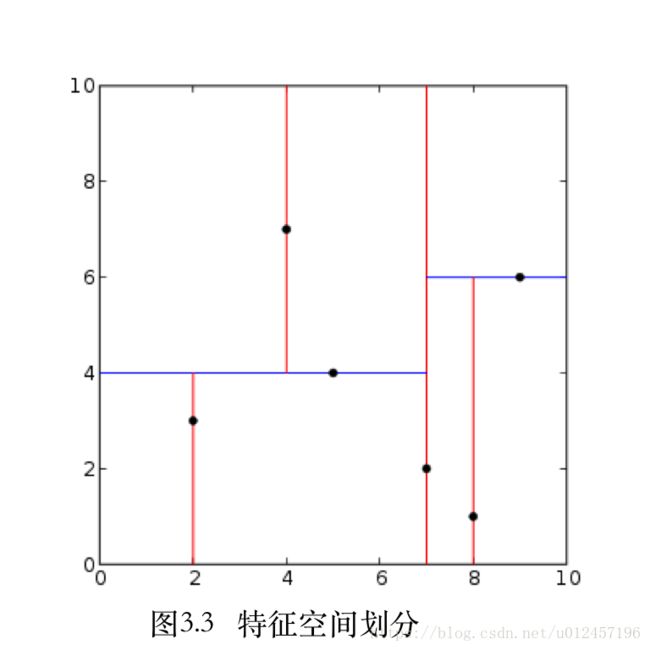

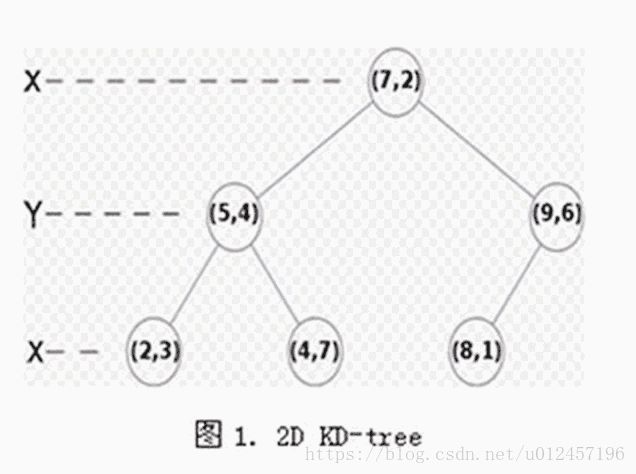

解:根结点对应包含数据集T的矩形,选择 x(1) x ( 1 ) 轴,6个数据点的 x(1) x ( 1 ) 坐标的中位数是7,以平面 x(1)=7 x ( 1 ) = 7 将空间分为左右两个子矩形(子节点);接着,左矩形以 x(2)=4 x ( 2 ) = 4 分为两个子矩形,右矩形以 x(2)=6 x ( 2 ) = 6 分为两个子矩形。如此递归,得到如下图3.3所示的特征空间划分和图3.4所示的kd树。

算法3.2(构造平衡kd树)

输入:k维空间数据集 T=x1,x2,...xN T = x 1 , x 2 , . . . x N ,其中 xi=(x(1)i,x(2)i,...,x(k)i)T,i=1,2,...N; x i = ( x i ( 1 ) , x i ( 2 ) , . . . , x i ( k ) ) T , i = 1 , 2 , . . . N ;

输出:kd树

(1) 开始:构造根结点,根结点对应包含T的k维空间的超矩形区域。选择 x(1) x ( 1 ) 为坐标轴,以T中所有实例的 x(1) x ( 1 ) 坐标的中位数为切分点,将根结点对应的超矩形区域分为两个子区域。切分由通过切分点并与坐标轴 x(1) x ( 1 ) 垂直的超平面实现。

由根结点生成深度为1的左右子节点;左子结点对应坐标 x(1) x ( 1 ) 小于切分点的子区域,右结点的大于。将落在切分超平面的实例点保存在根结点。

(2) 重复:对深度为j的结点,选择 x(l) x ( l ) 为切分的坐标轴,其中 l=j l = j ,有该结点生成深度为j+1的左右子结点;将落在切分超平面上的实例点保存在该结点。

(3) 直到两个子区域没有实例存在时停止。从而完成kd树划分。

搜索kd树

利用kd树可以省去大部分数据点的搜索,从而减少搜索的计算量。给定一个目标点,搜索其最近邻,首先找到包含目标点的叶结点;然后从该叶结点一次回退到父结点;不断查找与目标点最邻近的结点,这样搜索被限制在了空间的局部区域上,提高了效率。

包含目标点的叶结点对应包含目标点的最小超矩形区域,以此叶结点的实例点作为当前最近点。目标点的最近邻一定在以目标为中心并通过当前最近点的超球体的内部。然后返回当前结点的父结点,如果父结点的另一子节点的超矩形区域与超球体相交,那么在相交的区域内寻找与目标点更近的实例点。如果存在这样的点,则将此点作为新的当前最近点。算法转到更上一级的父结点,继续上述过程。如果父结点的另一子结点的超矩形区域与超球体不想交,或者不存在更近的点,则停止搜索。

例子 给定如下图(3.5)所示的kd树,根结点为A,其子结点为B,C等。树上一共存储了7个实例点;另有一个输入目标实例点S,求S的最近邻。

解:首先在kd树中找到包含S的叶结点,以点D作为近似最近邻。真正最近邻一定在以点S为中心通过点D的圆的内部。然后返回点D的父结点B,在结点B的另一个子结点F的区域内搜索最近邻。结点F的区域与圆不想交,不可能有最近邻点。继续返回上一级父结点A,在结点A的另一子结点C的区域内搜索最近邻,结点C的区域与圆相交;该区域在圆内的实例点有点E,点E比点D更近,成为新的最近邻近似。最后得到点E是点S的最近邻。

算法3.3 (用kd树的最近邻搜索)

输入:已构造的kd树;目标点x;

输出:x的最近邻

- 在kd树中找出包含目标点x的叶结点:从根结点出发,递归向下访问kd树。若目标点x当前维的坐标小于切分点的坐标,则移动到左子节点,否则移动到右子节点。直到子结点为叶结点为止。

- 以此叶结点为“当前最近点”。

- 递归地向上回退,在每个结点进行以下操作:

- 如果该结点保存的 实例点比当前最近点距离目标点更近,则以该实例点为“当前最近点”。

- 当前最近点一定存在于该结点一个子结点对应的区域。检查该子结点的父结点的另一子结点对应的区域是否有更近的点。具体的,检查另一子结点对应区域是否与以目标点为球心、以目标点与“当前最近点”间的距离为半径的超球体相交。如果相交,可能在另一个子结点对应的区域内存在距离目标点更近的点,移动到另一个子结点,递归搜索。如果不想交,则向上回退。

- 当回退到根结点时,搜索结束,最后的“当前最近点”即为x的最近邻点。

如果实例点是随机分布的,kd树搜索的平均计算复杂度为O(logN),kd树适合训练实例数远大于空间维数的k近邻索索。当空间维数接近训练实例数时,效率会下降接近线性扫描。