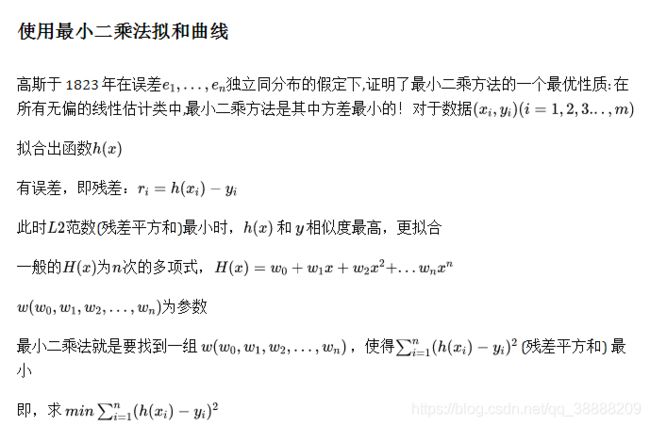

多项式函数拟合sin函数(最小二乘法求解参数及其正则化)

1.统计学习是关于计算机基于数据构建概率统计模型并运用模型对数据进行分析与预测的一门学科。统计学习包括监督学习、非监督学习、半监督学习和强化学习。

2.统计学习方法三要素——模型、策略、算法,对理解统计学习方法起到提纲挈领的作用。

3.本书主要讨论监督学习,监督学习可以概括如下:从给定有限的训练数据出发, 假设数据是独立同分布的,而且假设模型属于某个假设空间,应用某一评价准则,从假设空间中选取一个最优的模型,使它对已给训练数据及未知测试数据在给定评价标准意义下有最准确的预测。

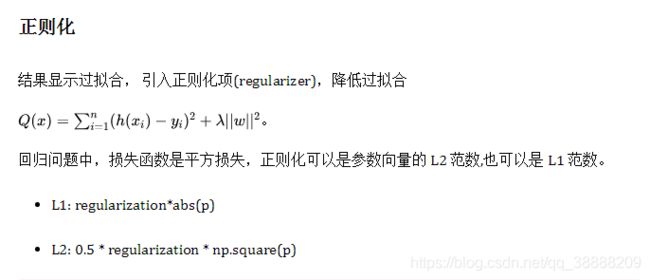

4.统计学习中,进行模型选择或者说提高学习的泛化能力是一个重要问题。如果只考虑减少训练误差,就可能产生过拟合现象。模型选择的方法有正则化与交叉验证。学习方法泛化能力的分析是统计学习理论研究的重要课题。

5.分类问题、标注问题和回归问题都是监督学习的重要问题。本书中介绍的统计学习方法包括感知机、K近邻法、朴素贝叶斯法、决策树、逻辑斯谛回归与最大熵模型、支持向量机、提升方法、EM 算法、隐马尔可夫模型和条件随机场。这些方法是主要的分类、标注以及回归方法。它们又可以归类为生成方法与判别方法。

import numpy as np

import matplotlib.pyplot as plt

from scipy.optimize import leastsq

# 我们要拟合的目标函数

def real_func(x):

return np.sin(2*np.pi*x)

# 我们自己定义的多项式函数

def fit_func(p, x):

f = np.poly1d(p) # np.poly1d([2,3,5,7])返回的是函数,2x3 + 3x2 + 5x + 7

ret = f(x)

return ret

# 计算残差

def residuals_func(p, x, y):

ret = fit_func(p, x) - y

return ret

def fitting(M=0):

"""

M 为 多项式的次数

"""

# 随机初始化多项式参数

p_init = np.random.rand(M + 1) # 返回M+1个随机数作为多项式的参数

# 最小二乘法:具体函数的用法参见我的博客:残差函数,残差函数中参数一,其他的参数

p_lsq = leastsq(residuals_func, p_init, args=(x, y))

# 求解出来的是多项式当中的参数,就是最小二乘法中拟合曲线的系数

# print('Fitting Parameters:', p_lsq[0])

return p_lsq[0]

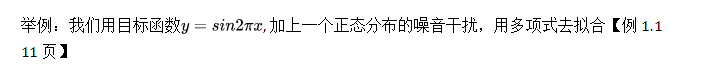

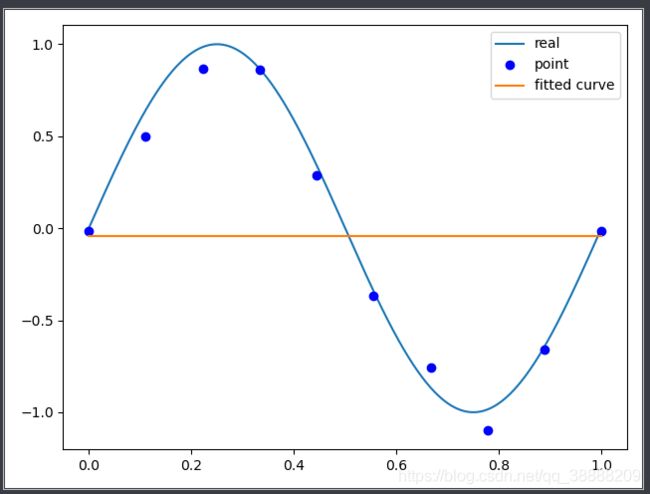

# 书中10个点,对y加上了正态分布的残差

x = np.linspace(0, 1, 10)

y_old = real_func(x)

y = [np.random.normal(0, 0.1) + yi for yi in y_old]

x_real = np.linspace(0, 1, 1000)

y_real = real_func(x_real)

plt.plot(x_real, y_real, label="real")

plt.plot(x, y, 'bo', label='point')

# fiitting函数中args=(x, y)是条用的是上面定义的10个点的全局变量x,y

plt.plot(x_real, fit_func(fitting(9), x_real), label="fitted curve")

plt.legend()

plt.show()

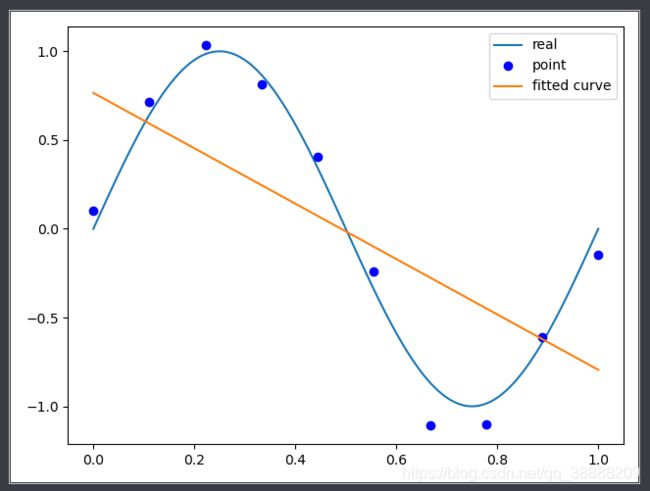

M=0

M=1

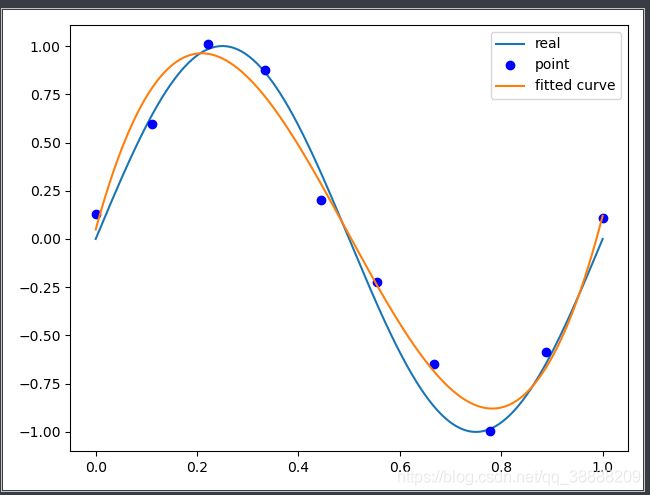

M=3

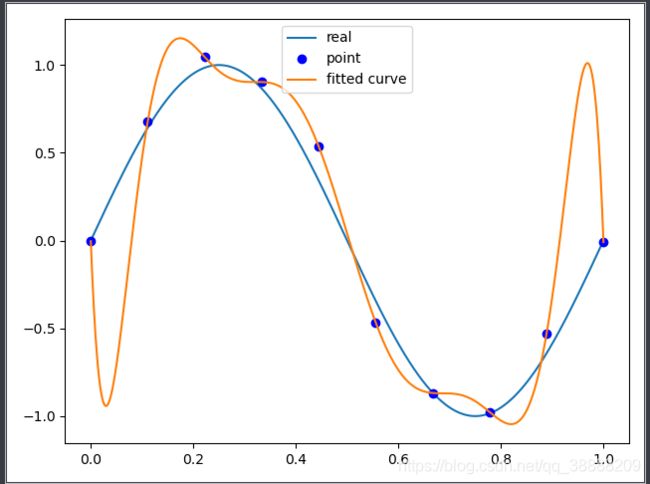

M=9

W是参数,就是最小二乘法求得到的系数

lambda是regularization,是自定义的系数。

import numpy as np

import matplotlib.pyplot as plt

from scipy.optimize import leastsq

# 我们要拟合的目标函数

def real_func(x):

return np.sin(2*np.pi*x)

# 我们自己定义的多项式函数

def fit_func(p, x):

f = np.poly1d(p) # np.poly1d([2,3,5,7])返回的是函数,2x3 + 3x2 + 5x + 7

ret = f(x)

return ret

# 计算残差

def residuals_func(p, x, y):

ret = fit_func(p, x) - y

return ret

# 返回残差和正则项

def residuals_func_regularization(p, x, y):

ret = fit_func(p, x) - y

ret = np.append(ret,

np.sqrt(0.5 * regularization * np.square(p))) # L2范数作为正则化项

return ret

def fitting(M=0):

"""

M 为 多项式的次数

"""

# 随机初始化多项式参数

p_init = np.random.rand(M + 1) # 返回M+1个随机数作为多项式的参数

# 最小二乘法:具体函数的用法参见我的博客:残差函数,残差函数中参数一,其他的参数

p_lsq = leastsq(residuals_func, p_init, args=(x, y))

# 求解出来的是多项式当中的参数,就是最小二乘法中拟合曲线的系数

# print('Fitting Parameters:', p_lsq[0])

return p_lsq[0]

# 书中10个点,对y加上了正态分布的残差

x = np.linspace(0, 1, 10)

y_old = real_func(x)

y = [np.random.normal(0, 0.1) + yi for yi in y_old]

x_real = np.linspace(0, 1, 1000)

y_real = real_func(x_real)

# # 画出10个散点,sin图像,和拟合的曲线

# plt.plot(x_real, y_real, label="real")

# plt.plot(x, y, 'bo', label='point')

# plt.plot(x_real, fit_func(fitting(9), x_real), label="fitted curve")

# plt.legend()

# plt.show()

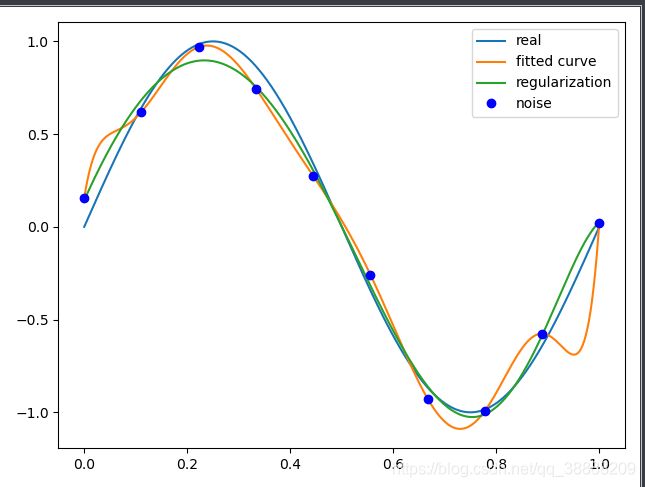

# 画出添加正则项的曲线

regularization = 0.0001

p_init = np.random.rand(9 + 1)

p_lsq_regularization = leastsq(

residuals_func_regularization, p_init, args=(x, y))

# 画出原sin图像,不加正则项的图像,加上正则项的图像,10个点的散点图

# 不加正则项和加上正则项都是9次方,10个系数

plt.plot(x_real, real_func(x_real), label='real')

plt.plot(x_real, fit_func(fitting(9), x_real), label='fitted curve')

plt.plot(

x_real,

fit_func(p_lsq_regularization[0], x_real),

label='regularization')

plt.plot(x, y, 'bo', label='noise')

plt.legend()

plt.show()