flink实战--数据流编程模型(Dataflow Programming Model)

概述

本文讲述flink的数据流编程模型,通过本文的讲述可以对flink的编程模型有一个清楚的认识,便于在编写flink程序时,进行选择使用。

另外,本文是一篇翻译文章,来自于flink的官方文档。见参考文献。

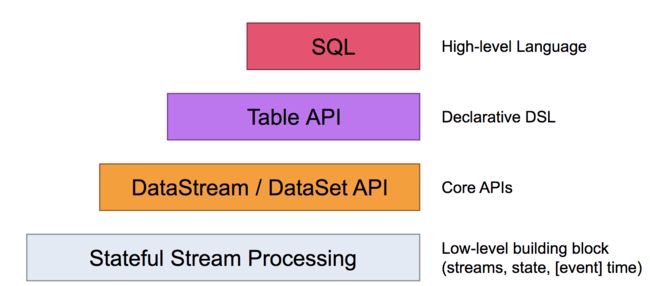

译者注:本文介绍了flink对外提供的不同层次的编程接口,和spark类似,flink对外提供了三种层次的编程接口:core API,Table API,SQL。

- core API:提供了一套针对streaming处理的函数,这个和sprak的RDD操作函数类似;

- Table API:对core API进行了封装让使用者在操作数据时更加方便,且对其实现进行了优化,让其性能比core API更高,这一次和spark的dataframe类似。

- SQL:和spark sql类似,flink是基于Table API实现的,方便通过SQL对flink的streaming进行操作。

API的抽象层次

如下图所示,Flink提供不同级别的抽象来开发流/批处理应用程序:

-

最低级抽象只支持有状态的流(stateful streaming)。它通过Process Function嵌入到DataStream API中。它允许用户自由处理来自一个或多个流的事件,并使用一致的容错状态。此外,用户可以注册事件时间和处理时间回调函数,允许程序实现复杂的计算逻辑。

-

实际上,大多数应用程序不需要上述的低级抽象层,而是针对Core API编程,如DataStream API(有边界/无边界流)和DataSet API(有界数据集)。这些流畅的API提供了用于数据处理的通用构造模块,例如各种形式的用户指定的转换(transformations),连接(joins),聚合(aggregations),窗口(windows),状态(state)等。在这些API中处理的数据类型在相应的编程语言中表示为类。

低级处理函数与DataStream API集成在一起,因此只能对某些操作进行低级抽象。

DataSet API在有界数据集上提供了额外的处理原语,如循环/迭代。

- Table API是以表为中心的声明性DSL(Domain Specific Language),可以是动态修改表(表示流时)。Table API遵循(扩展)关系模型:表附加了一个结构(schema)(类似于关系数据库中的表),API提供了可比较的操作,例如:select,project,join,group-by,aggregate等。Table API程序以声明方式定义应该执行的逻辑操作。尽管Table API可以通过各种类型的用户定义函数进行扩展,但它的表现力不如Core API,但使用起来更简洁(编写的代码更少)。此外,Table API程序还会通过优化程序,在执行之前应用优化规则。

可以在表和DataStream / DataSet之间无缝转换,允许程序混合使用Table API以及DataStream和DataSet API。

- Flink提供的最高级抽象是SQL。这种抽象在语义和表达方面类似于Table API,但是将程序表示为SQL查询表达式。SQL抽象与Table API紧密交互,SQL查询可以在Table API中定义的表上执行。

程序和数据流(Programs and Dataflows)

Flink程序的基本构建块是流(streams)和转换(transformations)。(请注意,Flink的DataSet API中使用的DataSet也是内部流 - 稍后会详细介绍。)从概念上讲,流是(可能永无止境的)数据记录流,而转换(transformation)是一种操作:它将一个或多个流作为输入,而输出一个或多个流。

执行时,Flink程序被映射到流式数据流(streaming dataflows),程序由流和转换运算符组成。每个数据流都以一个或多个源开头,并以一个或多个接收器(sinks)结束。数据流类似于任意有向无环图(DAG:directed acyclic graphs)。尽管通过迭代结构允许特殊形式的循环,但为了简单起见,我们将在大多数情况下对其进行平滑过渡。

通常,程序中的转换(transformations)与数据流(dataflow)中的运算符(operators)之间存在一对一的对应关系。但是,有时一个转换可能包含多个转换运算符。

数据源和接收器(sinks)在文档:streaming connectors 和 batch connectors中。

数据转换的说明在:DataStream operators

和DataSet transformations文档中。

并行数据流(Parallel Dataflows)

Flink中的程序本质上是并行和分布式的(parallel and distributed)。在执行期间,流(stream)具有一个或多个流分区(stream partitions),并且每个运算算子有一个或多个子任务。这些子任务彼此独立,并且可以在不同的线程中执行,并且可能在不同的机器或容器上执行。

算子的子任务数量,就是指定算子的并行度(parallelism)。流的并行性通常是其生成运算符的并行性。同一程序的不同运算符可能具有不同的并行级别。

流可以以一对一(或转发)(one-to-one (or forwarding) )模式或以重新分发(redistributing)模式在两个算子(operators)之间传输数据:

-

一对一(One-to-one)流(例如,在上图中的Source和map()算子之间)保留元素的分区和排序。这意味着map()运算符的subtask [1]将看到与Source运算符的subtask [1]生成的顺序相同的元素。

-

重新分配(Redistributing)流(在上图的map()和keyBy/window之间,以及keyBy/window和Sink之间)修改流的分区。根据所选择的转换,每个算子的子任务将数据发送到不同的目标子任务。示例中:keyBy()(通过散列密钥重新分区),broadcast()或rebalance()(随机重新分区)。

在重新分配过程中,交换元素之间的排序仅保留在每对发送和接收的子任务中(例如,map()的子任务[1]和keyBy/window的子任务[2])。因此,在此示例中,保留了每个key内的排序,但并行性确实引入了关于不同key的聚合结果到达接收器的顺序的非确定性。

窗口(Windows)

聚合事件(例如: counts, sums)在流上的工作方式与批处理方式不同。例如,不可能计算流中的所有元素,因为流通常是无限的(无界)。相反,流上的聚合(计数,总和等)由窗口(windows)限定,例如“在最后5分钟内计数”或“最后100个元素的总和”。

Windows可以是时间驱动的(例如:每30秒)或数据驱动(例如:每100个元素)。人们通常区分不同类型的窗口,例如翻滚窗口(没有重叠),滑动窗口(具有重叠)和会话窗口(由不活动间隙打断)。

可以在此博客文章中找到更多窗口示例。更多详细信息在窗口文档中。

时间(Time)

当在流程序中引用时间(例如定义窗口)时,可以参考不同的时间概念:

- 事件时间(Event Time):是创建事件的时间。它通常通过事件中的时间戳进行描述,例如由生产传感器或生产服务附加。Flink通过时间戳分配器访问事件时间戳。

- 注入时间(Ingestion time ):是在数据源算子中事件进入Flink数据流的时间。

- 处理时间(Processing Time):是本地时间,算子执行基于时间的操作。

有状态的操作(Stateful Operations)

虽然数据流(dataflow)中的许多算子只是一次查看一个单独的事件(event)(例如事件解析器),但某些算子会记住多个事件(例如窗口操作算子)的信息。这些操作称为有状态(stateful)。

有状态操作的状态保持在可以被认为是嵌入式键/值存储的状态中。状态被分区并严格地与有状态算子读取的流一起分发。因此,只有在keyBy()函数之后才能在键控流上访问键/值状态,并且限制为与当前事件的键相关联的值。对齐流和状态的密钥可确保所有状态更新都是本地操作,从而保证一致性而无需事务开销。此对齐还允许Flink重新分配状态并透明地调整流分区。

容错检查点(Checkpoints for Fault Tolerance)

Flink使用流重放(stream replay)和检查点(checkpointing)的组合实现容错。检查点与每个输入流中的特定点以及每个操作算子的对应状态相关。通过恢复算子的状态并从检查点重放事件,可以从检查点恢复流的数据流(stream dataflow),同时保持一致性(恰好一次处理语义)。

检查点间隔是在执行期间用恢复时间(需要重放的事件的数量)来折衷容错开销的手段。

容错内部的描述提供了有关Flink如何管理检查点和相关主题的更多信息。有关启用和配置检查点的详细信息,请参阅检查点API文档。

流的批量处理(Batch on Streaming)

Flink执行批处理程序(batch programs )作为流程序的特殊情况,其中流是有界的(有限数量的元素)。DataSet在内部被视为数据流。因此,上述概念以相同的方式应用于批处理程序,并且它们适用于流程序,除了少数例外:

- 批处理程序的容错不使用检查点。通过完全重放流来进行恢复。这是可能的,因为输入有限。这会使成本更多地用于恢复,但使常规处理更便宜,因为它避免了检查点。

- DataSet API中的有状态操作使用简化的内存/核外数据结构,而不是键/值索引。

- DataSet API引入了特殊的同步(超级步骤)迭代,这些迭代只能在有界流上进行。有关详细信息,请查看迭代文档。

总结

参考文献

- 官方文档:Dataflow Programming Model