深度学习手记(六)之实现稀疏自编码算法(SAE)的优化过程

- 简单介绍自编码算法(SAE)

首先,自编码算法是一种无监督算法,可以自动从无标注数据中学习特征,可以给出比原始数据更好的特征描述。当然,这是利用了自编码的一种属性:稀疏性,因为具有稀疏性,完成了特征的自动选择而不是采用随机的方式,这种方式明显要靠谱一些。就跟主成分分析方法(PCA)类似,自动完成了降维的过程。自编码器要求输出尽可能等于输入,从公式也可以看出来。

并且它的隐藏层必须满足一定的稀疏性,即隐藏层不能携带太多信息。所以隐藏层对输入进行了压缩,并在输出层中解压缩。如果中间隐藏层是线性转换,那么n个隐藏神经元就相当于输入数据映射到最明显的n个主元,而如果是非线性转换,比如使用sigmoid激活函数,那么自编码器就与PCA有所不同,特别是当多个自编码器级联在一起构成深度网络的时候必须用非线性转换来求激活值。整个过程肯定会丢失信息,但训练能够使丢失的信息尽量少。通过引入惩罚机制和BP算法解决最小化信息丢失问题。 - 对模型进行优化

1.模型优化器的选择。

对于稀疏自编码神经网络,很多都是使用的梯度下降优化损失函数,但是,这个算法有一个缺点,容易陷入局部极小值,更致命的是来自鞍点,即一个维度向上倾斜且另一维度向下倾斜的点。这些鞍点通常被相同误差值的平面所包围,这使得SGD算法很难脱离出来,因为梯度在所有维度上接近于零。

下面我们实验一下:

import tensorflow as tf

import numpy as np

import matplotlib.pyplot as plt

# 导入 MNIST 数据

from tensorflow.examples.tutorials.mnist import input_data

mnist = input_data.read_data_sets("D:/Project/DLearning/DL_TensorFlow/mnist_data", one_hot=True)

# 参数

learning_rate = 0.01 # 学习速率

training_epochs = 20 # 训练批次

batch_size = 128 # 随机选择训练数据大小

display_step = 1 # 展示步骤

# 网络参数

# 我这里采用了三层编码,实际针对mnist数据,隐层两层,分别为256,128效果最好

n_hidden_1 = 512 # 第一隐层神经元数量

n_hidden_2 = 256 # 第二

n_hidden_3 = 128 # 第三

n_input = 784 # 输入

# tf Graph输入

X = tf.placeholder("float32", [None, n_input])

# 权重初始化

weights = {

'encoder_h1': tf.Variable(tf.random_normal([n_input, n_hidden_1])),

'encoder_h2': tf.Variable(tf.random_normal([n_hidden_1, n_hidden_2])),

'encoder_h3': tf.Variable(tf.random_normal([n_hidden_2, n_hidden_3])),

'decoder_h1': tf.Variable(tf.random_normal([n_hidden_3, n_hidden_2])),

'decoder_h2': tf.Variable(tf.random_normal([n_hidden_2, n_hidden_1])),

'decoder_h3': tf.Variable(tf.random_normal([n_hidden_1, n_input])),

}

# 偏置值初始化

biases = {

'encoder_b1': tf.Variable(tf.random_normal([n_hidden_1])),

'encoder_b2': tf.Variable(tf.random_normal([n_hidden_2])),

'encoder_b3': tf.Variable(tf.random_normal([n_hidden_3])),

'decoder_b1': tf.Variable(tf.random_normal([n_hidden_2])),

'decoder_b2': tf.Variable(tf.random_normal([n_hidden_1])),

'decoder_b3': tf.Variable(tf.random_normal([n_input])),

}

# 开始编码

def encoder(x):

# sigmoid激活函数,layer = x*weights['encoder_h1']+biases['encoder_b1']

layer_1 = tf.nn.sigmoid(tf.add(tf.matmul(x, weights['encoder_h1']),

biases['encoder_b1']))

layer_2 = tf.nn.sigmoid(tf.add(tf.matmul(layer_1, weights['encoder_h2']),

biases['encoder_b2']))

layer_3 = tf.nn.sigmoid(tf.add(tf.matmul(layer_2, weights['encoder_h3']),

biases['encoder_b3']))

return layer_3

# 开始解码

def decoder(x):

# sigmoid激活函数,layer = x*weights['decoder_h1']+biases['decoder_b1']

layer_1 = tf.nn.sigmoid(tf.add(tf.matmul(x, weights['decoder_h1']),

biases['decoder_b1']))

layer_2 = tf.nn.sigmoid(tf.add(tf.matmul(layer_1, weights['decoder_h2']),

biases['decoder_b2']))

layer_3 = tf.nn.sigmoid(tf.add(tf.matmul(layer_2, weights['decoder_h3']),

biases['decoder_b3']))

return layer_3

# 构造模型

encoder_op = encoder(X)

encoder_result = encoder_op

decoder_op = decoder(encoder_op)

# 预测

y_pred = decoder_op

# 实际输入数据当作标签

y_true = X

# 定义代价函数和优化器,最小化平方误差,这里可以根据实际修改误差模型

loss = tf.reduce_mean(tf.pow(y_true - y_pred, 2))

optimizer = tf.train.GradientDescentOptimizer(learning_rate).minimize(loss)

# 初始化变量

init = tf.global_variables_initializer()

# 运行

with tf.Session() as sess:

sess.run(init)

# 总的batch

total_batch = int(mnist.train.num_examples / batch_size)

# 开始训练

for epoch in range(training_epochs):

for i in range(total_batch):

batch_xs, batch_ys = mnist.train.next_batch(batch_size)

_, c = sess.run([optimizer, loss], feed_dict={X: batch_xs})

# 展示每次训练结果

if epoch % display_step == 0:

print("Epoch:", '%02d' % (epoch + 1),

"cost=", "{:.9f}".format(c))附上结果:

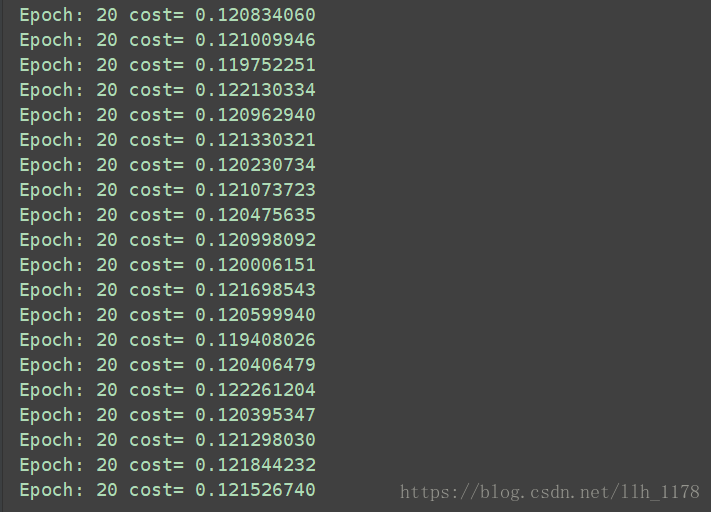

可以看出损失还是挺大的,而且在优化过程中,cost值始终在0.44左右徘徊,说明了算法陷入了局部最优解。这就是SGD的致命缺陷。

接下来我们使用Adagrad方法。Adagrad算法是通过参数来调整合适的学习率η,对稀疏参数进行大幅更新和对频繁参数进行小幅更新。因此,Adagrad方法非常适合处理稀疏数据。但是,这恰恰也是一个问题,学习率η总是在降低和衰减,就会导致梯度消失。

注:使用Adagrad算法优化时,增大学习率。其他的不用改动。

learning_rate = 0.6

optimizer = tf.train.AdagradOptimizer(learning_rate).minimize(loss)附上结果:

模型性能提升了一些,可以看出的确是比较适合稀疏数据。

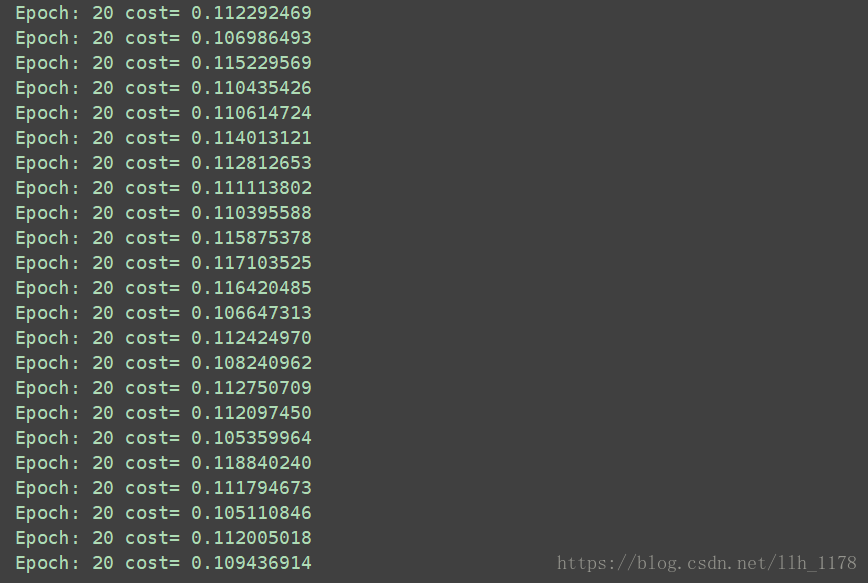

接下来我们再看Adagrad的提升版——Rmsprop优化器,它倾向于解决其学习率衰减的问题。

optimizer = tf.train.RMSPropOptimizer(learning_rate).minimize(loss)Adam算法即自适应时刻估计方法(Adaptive Moment Estimation),能计算每个参数的自适应学习率,并且计算每个参数的对应动量变化并独立存储。与其他自适应学习率算法相比,其收敛速度更快,学习效果更为有效,而且可以纠正其他优化技术中存在的问题,如学习率消失、收敛过慢或是高方差的参数更新导致损失函数波动较大等问题。

下面,我们看看效果:

模型的性能确实又有所提升了,怎么让它再有所提升呢?使用优化器到此为止,我们再使用激活函数(将sigmoid变成relu函数)、指数衰减学习率、滑动平均模型对整个模型进行优化。得到结果如下:

是不是模型的性能再一次提升了,但是,我相信这不是终止,肯定还会有其他的方法进行提升的,只是现在能力有限。再接再厉吧!

参考:

https://zhuanlan.zhihu.com/p/27449596?utm_source=weibo&utm_medium=social

https://www.2cto.com/kf/201612/572954.html