数据竞赛入门系列——天池二手车交易价格预测【3】特征工程

一、介绍

本系列是记录我参加Datawhale入门数据竞赛过程中的内容和一些体会。希望能够提高自己!

竞赛为天池二手车交易价格预测。

整个系列分为五部分内容:

- 赛题理解

- 数据分析

- 特征工程

- 建模调参

- 模型融合

此为系列的第三部分,即特征工程。

二、异常值处理

2.1 删除异常值

def outliers_proc(data, col_name, scale=3):

"""

用于清洗异常值,默认用 box_plot(scale=3)进行清洗

:param data: 接收 pandas 数据格式

:param col_name: pandas 列名

:param scale: 尺度

:return:

"""

def box_plot_outliers(data_ser, box_scale):

"""

http://www.360doc.com/content/19/0409/10/52645714_827399221.shtml

利用箱线图去除异常值

:param data_ser: 接收 pandas.Series 数据格式

:param box_scale: 箱线图尺度,

:return:

"""

iqr = box_scale * (data_ser.quantile(0.75) - data_ser.quantile(0.25)) # 计算分位数

val_low = data_ser.quantile(0.25) - iqr # 下边缘

val_up = data_ser.quantile(0.75) + iqr # 上边缘

rule_low = (data_ser < val_low) # 过滤掉上下边缘以外的数据

rule_up = (data_ser > val_up)

return (rule_low, rule_up), (val_low, val_up)

data_n = data.copy() # 备份数据

data_series = data_n[col_name] # 处理的是哪个特征

rule, value = box_plot_outliers(data_series, box_scale=scale) # 利用箱线图去除异常值

index = np.arange(data_series.shape[0])[rule[0] | rule[1]] #

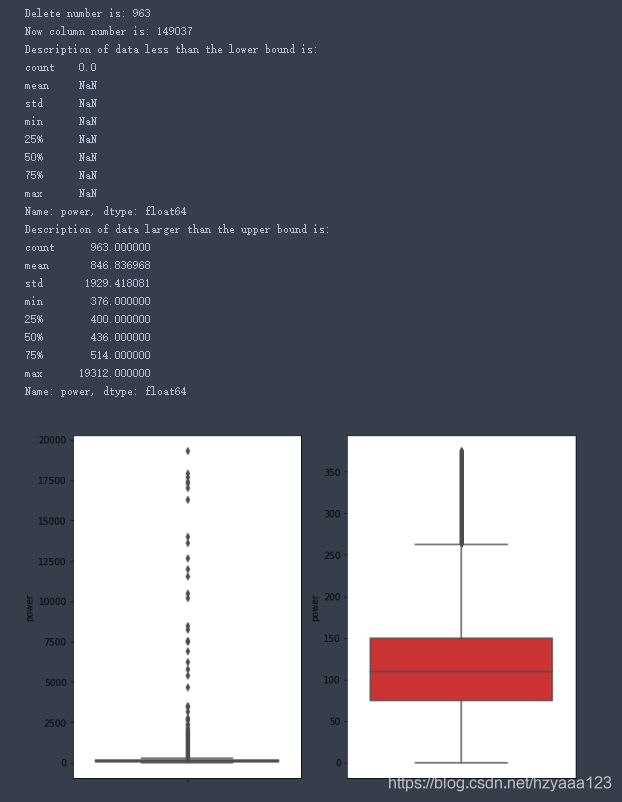

print("Delete number is: {}".format(len(index)))

data_n = data_n.drop(index)

data_n.reset_index(drop=True, inplace=True)

print("Now column number is: {}".format(data_n.shape[0]))

index_low = np.arange(data_series.shape[0])[rule[0]]

outliers = data_series.iloc[index_low]

print("Description of data less than the lower bound is:")

print(pd.Series(outliers).describe())

index_up = np.arange(data_series.shape[0])[rule[1]]

outliers = data_series.iloc[index_up]

print("Description of data larger than the upper bound is:")

print(pd.Series(outliers).describe())

fig, ax = plt.subplots(1, 2, figsize=(10, 7))

sns.boxplot(y=data[col_name], data=data, palette="Set1", ax=ax[0])

sns.boxplot(y=data_n[col_name], data=data_n, palette="Set1", ax=ax[1])

return data_n

# 我们可以删掉一些异常数据,以 power 为例。

# 这里删不删同学可以自行判断

# 但是要注意 test 的数据不能删 = = 不能掩耳盗铃是不是

Train_data = outliers_proc(Train_data, 'power', scale=3)

这里通过箱线图分析删除异常值。可以参考这个博客方便理解:剔除箱线图中的异常值。

2.2 特征构造

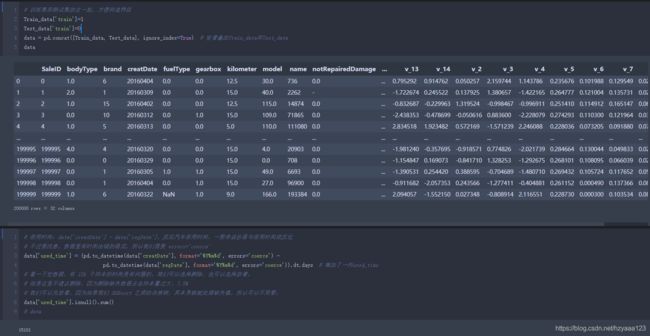

# 训练集和测试集放在一起,方便构造特征

Train_data['train']=1

Test_data['train']=0

data = pd.concat([Train_data, Test_data], ignore_index=True) # 竖着叠加Train_data和Test_data

# 使用时间:data['creatDate'] - data['regDate'],反应汽车使用时间,一般来说价格与使用时间成反比

# 不过要注意,数据里有时间出错的格式,所以我们需要 errors='coerce'

data['used_time'] = (pd.to_datetime(data['creatDate'], format='%Y%m%d', errors='coerce') -

pd.to_datetime(data['regDate'], format='%Y%m%d', errors='coerce')).dt.days # 增加了一列used_time

# 看一下空数据,有 15k 个样本的时间是有问题的,我们可以选择删除,也可以选择放着。

# 但是这里不建议删除,因为删除缺失数据占总样本量过大,7.5%

# 我们可以先放着,因为如果我们 XGBoost 之类的决策树,其本身就能处理缺失值,所以可以不用管;

data['used_time'].isnull().sum()

# data

关于这里为什么要构造特征,我个人的理解是:以used_time为例,根据我们的常识,一辆二手车卖的价格高低,和它使用的时间应该是有关系的,同一个型号的车,理论上来说应该使用时间越少卖的价格越高,因此构造了一个特征,方便学习。

关于这里为什么要构造特征,我个人的理解是:以used_time为例,根据我们的常识,一辆二手车卖的价格高低,和它使用的时间应该是有关系的,同一个型号的车,理论上来说应该使用时间越少卖的价格越高,因此构造了一个特征,方便学习。

下面再构造一个特征:

# 从邮编中提取城市信息,相当于加入了先验知识

data['city'] = data['regionCode'].apply(lambda x : str(x)[:-3])

data = data

# 计算某品牌的销售统计量,同学们还可以计算其他特征的统计量

# 这里要以 train 的数据计算统计量

Train_gb = Train_data.groupby("brand")

all_info = {}

for kind, kind_data in Train_gb:

info = {}

kind_data = kind_data[kind_data['price'] > 0]

info['brand_amount'] = len(kind_data)

info['brand_price_max'] = kind_data.price.max()

info['brand_price_median'] = kind_data.price.median()

info['brand_price_min'] = kind_data.price.min()

info['brand_price_sum'] = kind_data.price.sum()

info['brand_price_std'] = kind_data.price.std()

info['brand_price_average'] = round(kind_data.price.sum() / (len(kind_data) + 1), 2)

all_info[kind] = info

brand_fe = pd.DataFrame(all_info).T.reset_index().rename(columns={"index": "brand"})

data = data.merge(brand_fe, how='left', on='brand')

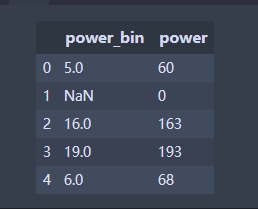

bin = [i*10 for i in range(31)]

data['power_bin'] = pd.cut(data['power'], bin, labels=False)

data[['power_bin', 'power']].head()

# 删除不需要的数据

data = data.drop(['creatDate', 'regDate', 'regionCode'], axis=1)

print(data.shape)

data.columns

这里是按照品牌来统计价格的相关信息,然后添加到特征里面,相当于加入了先验信息,如果我们不手动构造,让模型去学到某个品牌的相关信息还是比较难的,我们手动加进去一方便降低了模型学习这些信息的难度,另一方面这些先验信息也的确符合我们人对于品牌影响价格的理解。

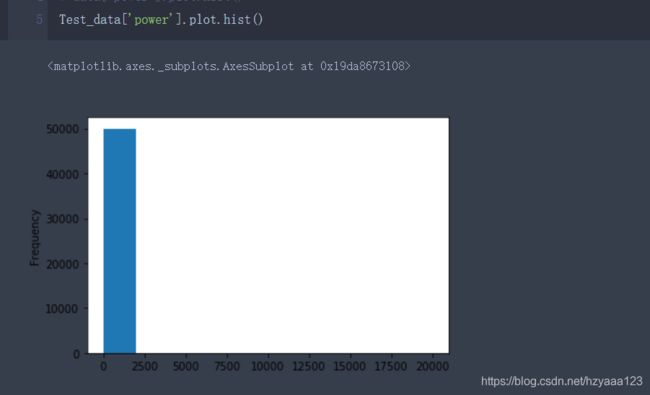

# 我们看下数据分布:

data['power'].plot.hist()

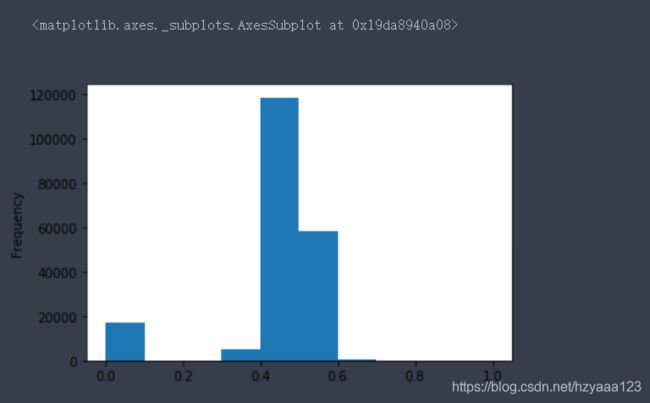

这个分布是和正态分布相去甚远的,产生此现象的原因是Test_data的异常值没有处理,可以看下Test_data的分布和Train_data的分布:

这个分布是和正态分布相去甚远的,产生此现象的原因是Test_data的异常值没有处理,可以看下Test_data的分布和Train_data的分布:

Test_data['power'].plot.hist()

Train_data['power'].plot.hist()

可以看到,确实是由于Test_data的异常分布导致的data的异常分布。

可以看到,确实是由于Test_data的异常分布导致的data的异常分布。

可以对其取对数,再做归一化:

# 我们对其取 log,在做归一化

from sklearn import preprocessing

min_max_scaler = preprocessing.MinMaxScaler()

data['power'] = np.log(data['power'] + 1)

data['power'] = ((data['power'] - np.min(data['power'])) / (np.max(data['power']) - np.min(data['power'])))

data['power'].plot.hist()

如果数据分布本身就是正常的,就不需要取对数了,可以直接进行归一化。

如果数据分布本身就是正常的,就不需要取对数了,可以直接进行归一化。

例如km这个特征:

# km 的比较正常,应该是已经做过分桶了

data['kilometer'].plot.hist()

# 所以我们可以直接做归一化

data['kilometer'] = ((data['kilometer'] - np.min(data['kilometer'])) /

(np.max(data['kilometer']) - np.min(data['kilometer'])))

data['kilometer'].plot.hist()

# 除此之外 还有我们刚刚构造的统计量特征:

# 'brand_amount', 'brand_price_average', 'brand_price_max',

# 'brand_price_median', 'brand_price_min', 'brand_price_std',

# 'brand_price_sum'

# 这里不再一一举例分析了,直接做变换,

def max_min(x):

return (x - np.min(x)) / (np.max(x) - np.min(x))

data['brand_amount'] = ((data['brand_amount'] - np.min(data['brand_amount'])) /

(np.max(data['brand_amount']) - np.min(data['brand_amount'])))

data['brand_price_average'] = ((data['brand_price_average'] - np.min(data['brand_price_average'])) /

(np.max(data['brand_price_average']) - np.min(data['brand_price_average'])))

data['brand_price_max'] = ((data['brand_price_max'] - np.min(data['brand_price_max'])) /

(np.max(data['brand_price_max']) - np.min(data['brand_price_max'])))

data['brand_price_median'] = ((data['brand_price_median'] - np.min(data['brand_price_median'])) /

(np.max(data['brand_price_median']) - np.min(data['brand_price_median'])))

data['brand_price_min'] = ((data['brand_price_min'] - np.min(data['brand_price_min'])) /

(np.max(data['brand_price_min']) - np.min(data['brand_price_min'])))

data['brand_price_std'] = ((data['brand_price_std'] - np.min(data['brand_price_std'])) /

(np.max(data['brand_price_std']) - np.min(data['brand_price_std'])))

data['brand_price_sum'] = ((data['brand_price_sum'] - np.min(data['brand_price_sum'])) /

(np.max(data['brand_price_sum']) - np.min(data['brand_price_sum'])))

# 对类别特征进行 OneEncoder

data = pd.get_dummies(data, columns=['model', 'brand', 'bodyType', 'fuelType',

'gearbox', 'notRepairedDamage', 'power_bin'])

print(data.shape)

data.columns

三、特征筛选

有关这一部分,主要用到的是嵌入式特征。这部分我也还没搞明白,等下一节补上。

四、总结

特征工程还是非常重要的,但是我还没有搞很明白,这篇文章的部分理解可能也不正确。希望后面能继续加油!