- 基于 Python 的机器学习模型部署到 Flask Web 应用:从训练到部署的完整指南

m0_74825223

python机器学习flask

目录引言技术栈步骤一:数据预处理步骤二:训练机器学习模型步骤三:创建FlaskWeb应用步骤四:测试Web应用步骤五:模型的保存与加载保存模型加载模型并在Flask中使用步骤六:Web应用的安全性考量示例:简单的输入验证示例:自定义错误处理示例:使用Flask-JWT-Extended进行认证结论参考资料引言在当今数据驱动的时代,机器学习模型已经广泛应用于各行各业,从金融、医疗到教育等领域。然而,

- 机器学习:scikit-learn 和 Jupyter Notebook(推荐初学者使用google colab)

wyc9999ww

机器学习scikit-learnjupyter人工智能python

对于初学者来说,scikit-learn是一个理想的机器学习入门工具。不仅提供了丰富的算法和功能,还通过一致的API设计,确保能够快速上手并进行各种机器学习任务。通过使用scikit-learn,可以专注于理解和实践机器学习的核心概念,而不必过多担心底层实现细节。所以scikit-learn能轻松实现从数据预处理到模型训练和评估的完整流程。此外在推荐一个适合初学者的深度学习平台工具googleco

- 有趣的python代码实例_Python之路:200个Python有趣的小例子一网打尽

weixin_39845406

有趣的python代码实例

概述博主最近在学习python,看完了一整套学习视频,然后呃呃呃,还是用不太流畅。碰巧在全球最大的同性交友论坛GayHub(呸!是开源代码托管平台Github)上面发现了一个项目,该项目列举了200多个Python小例子,Python基础、Python坑点、Python字符串和正则、Python绘图、Python日期和文件、Web开发、数据科学、机器学习、深度学习、TensorFlow、Pytor

- 机器学习数学基础-定积分应用-经济问题

华东算法王(原聪明的小孩子

小孩哥解析宋浩微积分算法

定积分在经济学中的应用广泛,特别是用来解决与累积量、平均值、总收入、成本、利润等相关的问题。以下是定积分在经济学中的几个常见应用场景:1.总收入和总成本的计算在经济学中,定积分常用于计算总收入、总成本等累积量。如果给定价格函数和需求函数或供应函数,定积分可以帮助我们计算从某一数量到另一数量之间的总收入或总成本。总收入:假设某商品的价格随数量的变化而变化,价格函数为(p(x)),其中(x)表示销售的

- 迁移学习与RBF神经网络

fanxbl957

人工智能理论与实践迁移学习神经网络人工智能

迁移学习与RBF神经网络一、引言在机器学习和深度学习领域,迁移学习和神经网络都是备受关注的重要技术。迁移学习旨在将从一个或多个源任务中学习到的知识应用到目标任务中,以加快目标任务的学习过程,提高学习效果,尤其在数据稀缺或训练资源有限的情况下展现出显著优势。而RBF(径向基函数)神经网络作为一种经典的神经网络结构,以其独特的函数逼近能力和良好的局部逼近特性,在众多领域取得了出色的性能表现。将迁移学习

- 用大数据“喂养”出来的AI模型ChatGPT 爆火是大数据、大算力、强算法的支撑,中国缺乏的什么?

Ai17316391579

深度学习服务器人工智能

先来了解一下ChatGPT的基本情况ChatGPT本质属于生成式人工智能,属于无监督或半监督的机器学习。与之相关的还有Discriminativemodeling区分式模型,区分式模型大多属于监督式学习。生成性人工智能目前有两种主要的框架:GAN(GenerativeAdversarialNetwork)和GPT(GenerativePre-trainedTransformer)。GAN目前广泛应

- AIGC视频生成国产之光:ByteDance的PixelDance模型

好评笔记

AIGC-视频补档AIGC计算机视觉人工智能深度学习机器学习论文阅读面试

大家好,这里是好评笔记,公主号:Goodnote,专栏文章私信限时Free。本文详细介绍ByteDance的视频生成模型PixelDance,论文于2023年11月发布,模型上线于2024年9月,同时期上线的模型还有Seaweed(论文未发布)。优质专栏回顾:机器学习笔记深度学习笔记多模态论文笔记AIGC—图像文章目录论文摘要引言输入训练和推理时的数据处理总结相关工作视频生成长视频生成方法模型架构

- Python气象数据分析:风速预报订正、台风预报数据智能订正、机器学习预测风电场的风功率、浅水模型、预测ENSO等

小艳加油

大气科学python人工智能气象机器学习

目录专题一Python和科学计算基础专题二机器学习和深度学习基础理论和实操专题三气象领域中的机器学习应用实例专题四气象领域中的深度学习应用实例更多应用Python是功能强大、免费、开源,实现面向对象的编程语言,在数据处理、科学计算、数学建模、数据挖掘和数据可视化方面具备优异的性能,这些优势使得Python在气象、海洋、地理、气候、水文和生态等地学领域的科研和工程项目中得到广泛应用。可以预见未来Py

- YOLOv8/YOLOv11使用web界面推理自己的模型,Gradio框架快速搭建

挂科边缘

YOLOv8改进YOLO前端计算机视觉目标检测人工智能python

前言Gradio是一个开源Python库,用于快速构建和共享机器学习模型的Web界面。开发者可以通过简单的Python代码将机器学习模型封装成交互式应用,无需复杂的设置即可在浏览器中使用自己训练好模型。接下来教你使用Gradio框架构建一个简单Web界面推理YOLOv8/YOLOv11模型。话不多说上检测结果:一、YOLOv8/YOLOv11源码下载YOLOv8源码下载:官网打不开的话,从我的网盘

- 深度学习笔记——模型部署

好评笔记

深度学习笔记深度学习笔记人工智能transformer模型部署大模型部署大模型

大家好,这里是好评笔记,公主号:Goodnote,专栏文章私信限时Free。本文简要概括模型部署的知识点,包括步骤和部署方式。文章目录模型部署模型部署的关键步骤常见的模型部署方式优势与挑战总结边缘端部署方案总结历史文章机器学习深度学习模型部署模型部署是指将训练好的机器学习或深度学习模型集成到生产环境中,使其能够在实际应用中处理实时数据和提供预测服务。模型部署的流程涉及模型的封装、部署环境的选择、部

- 探索泰坦尼克号生存分类数据集:机器学习与数据分析的完美起点

岑童嵘

探索泰坦尼克号生存分类数据集:机器学习与数据分析的完美起点【下载地址】泰坦尼克号生存分类数据集本仓库提供了一个经典的机器学习数据集——泰坦尼克号生存分类数据集。该数据集包含两个CSV文件:训练集和测试集。数据集主要用于训练和评估机器学习模型,以预测泰坦尼克号乘客的生存情况项目地址:https://gitcode.com/open-source-toolkit/35561项目介绍泰坦尼克号生存分类数

- 基于Python机器学习、深度学习技术提升气象、海洋、水文领域实践应用

KY_chenzhao

python机器学习深度学习气象

1.背景与目标ENSO(ElNiño-SouthernOscillation)是全球气候系统中最显著的年际变率现象之一,对全球气候、农业、渔业等有着深远的影响。准确预测ENSO事件的发生和发展对于减灾防灾具有重要意义。近年来,深度学习技术在气象领域得到了广泛应用,其中长短期记忆网络(LSTM)因其在处理时间序列数据方面的优势,被广泛用于ENSO预测。2.数据准备数据来源包括NOAA(美国国家海洋和

- R语言的软件工程

BinaryBardC

包罗万象golang开发语言后端

R语言的软件工程1.引言随着数据科学的快速发展,R语言作为一种统计计算和图形绘制的编程语言,其在数据分析、可视化以及机器学习等领域的应用日益广泛。尽管R语言在数据处理上有其独特的优势,但要将其运用于大型项目和商业应用中,就需要遵循软件工程的原则。本篇文章将探讨R语言在软件工程中的应用,主要涵盖软件开发生命周期、代码规范、版本控制、测试和文档等方面。2.软件开发生命周期软件开发生命周期(SDLC)是

- Python中的Pipeline快速教学、

Coding Is Fun

python开发语言

在Python中,Pipeline通常指的是机器学习工作流中的流水线,尤其是在使用scikit-learn库时。Pipeline允许你将多个数据处理步骤和模型训练步骤串联起来,形成一个有序的工作流程。这不仅使代码更简洁,还能确保在训练和预测时一致的数据处理。以下是一个快速教学,帮助你掌握Python中Pipeline的核心概念和使用方法。目录安装和导入必要的库Pipeline的基本概念创建一个简单

- 大模型介绍

詹姆斯爱研究Java

spring

大模型(LargeModel)指的是拥有庞大参数量的机器学习模型。由于具有更多的参数,大模型能够更好地拟合复杂的数据和模式,从而提供更准确的预测和更好的性能。大模型的参数量通常远远超过常规模型,可以达到数百万甚至数十亿个参数。这些参数通常通过深度神经网络(DeepNeuralNetwork)来表示,包括多个隐藏层和大量的神经元。大模型的训练需要大量的计算资源和数据。通常,它们需要在多个GPU或TP

- Python从0到100(七十三):Python OpenCV-OpenCV实现手势虚拟拖拽

是Dream呀

pythonopencv开发语言

前言:零基础学Python:Python从0到100最新最全教程。想做这件事情很久了,这次我更新了自己所写过的所有博客,汇集成了Python从0到100,共一百节课,帮助大家一个月时间里从零基础到学习Python基础语法、Python爬虫、Web开发、计算机视觉、机器学习、神经网络以及人工智能相关知识,成为学习学习和学业的先行者!欢迎大家订阅专栏:零基础学Python:Python从0到100最新

- K-means聚类:解锁数据隐藏结构的钥匙

陈辰学长

kmeans聚类机器学习

K-means聚类:解锁数据隐藏结构的钥匙在机器学习的广阔领域中,无监督学习以其独特的魅力吸引了众多研究者和实践者。其中,K-means聚类作为一种经典且实用的无监督学习算法,以其简单高效的特点,广泛应用于市场细分、图像分割和基因聚类等领域。本文将深入探讨K-means聚类的工作原理、应用实例及其在这些领域中的具体应用,旨在揭示其如何智能划分数据,解锁隐藏结构,为相关领域提供精准导航。一、K-me

- 与机器学习的邂逅--自适应神经网络结构的深度解析

想成为高手499

机器学习与人工智能机器学习神经网络人工智能

引言随着人工智能的发展,神经网络已成为许多应用领域的重要工具。自适应神经网络(AdaptiveNeuralNetworks,ANN)因其出色的学习能力和灵活性,逐渐成为研究的热点。本文将详细探讨自适应神经网络的基本概念、工作原理、关键技术、C++实现示例及其应用案例,最后展望未来的发展趋势。自适应神经网络的基本概念什么是自适应神经网络?自适应神经网络是一种能够根据输入数据的变化和环境的动态特性自动

- PostgreSQL - pgvector 插件构建向量数据库并进行相似度查询

花千树-010

RAG数据库postgresqlAI编程

在现代的机器学习和人工智能应用中,向量相似度检索是一个非常重要的技术,尤其是在文本、图像或其他类型的嵌入向量的操作中。本文将介绍如何在PostgreSQL中安装pgvector插件,用于存储和检索向量数据,并展示如何通过Python脚本向数据库插入向量并执行相似度查询。一、安装PostgreSQL并配置pgvector插件1.安装PostgreSQL首先,确保你已经安装了PostgreSQL。可以

- 未来教育:AI知识库如何重塑学习体验

知识管理知识库知识库软件

在科技日新月异的今天,教育领域正经历着前所未有的变革。人工智能(AI)技术的快速发展,特别是AI知识库的广泛应用,正在重塑我们的学习体验,使之变得更加高效、个性化和智能化。本文将深入探讨AI知识库如何影响未来教育,以及它如何为学习者提供前所未有的学习体验。一、AI知识库:教育领域的智能助手AI知识库,作为结合了人工智能技术的知识管理系统,不仅能够存储和处理海量信息,还能通过自然语言处理、机器学习等

- 【TVM 教程】内联及数学函数

ApacheTVM是一个端到端的深度学习编译框架,适用于CPU、GPU和各种机器学习加速芯片。更多TVM中文文档可访问→https://tvm.hyper.ai/作者:TianqiChen尽管TVM支持基本的算术运算,但很多时候,也需要复杂的内置函数,例如exp取指函数。这些函数是依赖target系统的,并且在不同target平台中可能具有不同的名称。本教程会学习到如何调用这些target-spe

- mindspore编译报错

小乐快乐

深度学习神经网络

1、重新创建个工程后无法正常运行,2、使用代码为:华为提供的机器学习监督学习中的代码[quote][size=2][url=forum.php?mod=redirect&goto=findpost&pid=1364937&ptid=165780][color=#999999]回复:HS12发表于2021-10-3018:16[/color][/url][/size]报错信息

- ai照片放大python源码_AI新时代-大牛教你使用python+Opencv完成人脸解锁(附源码)...

weixin_39639505

ai照片放大python源码

好吧,伙计们,我回来了。说我拖更不写文章的可以过来用你的小拳拳狠命地捶我胸口....那么今天我们来讲关于使用python+opencv+face++来实现人脸验证及人脸解锁。代码量同样不多,你可以将这些代码运用在其它一些智能领域,如智能家居,进门的时候判断你是谁,也可以加入机器学习判断来的人是客人还是熟人。在讲之前我们会先适当的拓扑一下关于人脸识别的知识点。OK废话少说下面开始正是话题。解锁原理:

- 线性回归:从基础到进阶的全面解析

tester Jeffky

大模型线性回归机器学习算法

线性回归:从基础到进阶的全面解析线性回归是机器学习中最基本的算法之一,广泛应用于预测和分析。本文将详细介绍线性回归的基本概念、数学原理、实现方法以及在实际应用中的注意事项。我们将通过丰富的代码示例来展示如何从头开始构建一个简单的线性回归模型,并逐步深入到更复杂的场景。1.线性回归的基本概念1.1什么是线性回归?线性回归是一种用于建模两个或多个变量之间关系的统计方法。它假设因变量(目标变量)与一个或

- 什么是多模态机器学习:跨感知融合的智能前沿

非凡暖阳

人工智能神经网络

在人工智能的广阔天地里,多模态机器学习(MultimodalMachineLearning)作为一项前沿技术,正逐步解锁人机交互和信息理解的新境界。它超越了单一感官输入的限制,通过整合视觉、听觉、文本等多种数据类型,构建了一个更加丰富、立体的认知模型,为机器赋予了接近人类的综合感知与理解能力。本文将深入探讨多模态机器学习的定义、核心原理、关键技术、面临的挑战以及未来的应用前景,旨在为读者勾勒出这一

- AI大模型如何赋能电商行业,引领变革

虞书欣的C

人工智能开发语言

•个性化推荐:利用机器学习算法分析用户的历史购买记录、浏览行为和喜好,生成个性化的产品推荐列表,提升用户的购买意愿和满意度。•优化用户体验:•智能搜索引擎:运用自然语言处理技术,优化搜索引擎,让用户能够通过自然语言进行搜索。•虚拟客服:通过聊天机器人和语音助手,提供24/7的客户支持,快速解答用户咨询。•图像识别:利用计算机视觉技术,用户可以通过拍照识别商品,快速找到相似商品或进行排版搭配推荐。•

- 数学:机器学习的理论基石

每天五分钟玩转人工智能

机器学习人工智能

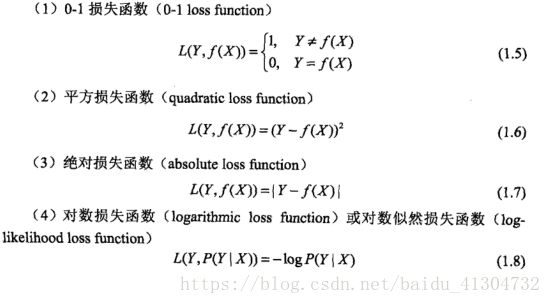

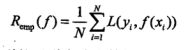

一、数学:机器学习的理论基石机器学习是一种通过数据学习模式和规律的科学。其核心目标是从数据中提取有用的信息,以便对未知数据进行预测和分类。为了实现这一目标,机器学习需要一种数学框架来描述和解决问题。数学在机器学习中起着至关重要的作用,它提供了一种数学模型来描述数据和模式,以及一种数学方法来优化模型。数学在机器学习中的应用非常广泛,涵盖了线性代数、概率论、统计学、微积分、优化等多个领域。这些数学方法

- 【机器学习:二十六、决策树】

KeyPan

机器学习机器学习决策树人工智能算法深度学习数据挖掘

1.决策树概述决策树是一种基于树状结构的监督学习算法,既可以用于分类任务,也可以用于回归任务。其主要通过递归地将数据划分为子集,从而生成一个具有条件结构的树模型。核心概念节点(Node):每个节点表示一个特定的决策条件。根节点(RootNode):树的起点,包含所有样本。分支(Branch):每个分支代表一个条件划分的结果。叶节点(LeafNode):终止节点,表示最终的决策结果。优点直观可解释:

- 机器学习数学基础-极值和最值

华东算法王(原聪明的小孩子

小孩哥解析宋浩微积分机器学习算法人工智能

极值和最值极值和最值是数学中关于函数变化的重要概念,它们描述了函数在某些点附近或在整个定义域内的“最大”或“最小”行为。理解极值和最值对优化问题、函数分析、物理建模等领域有重要的应用。1.极值(LocalExtrema)极值是指函数在某个区间内的某一点取得的局部最大值或最小值。(1)局部最大值(LocalMaximum)一个函数在某点(x=c)取得局部最大值,意味着存在一个包含(c)的小区间,使得

- 17-7 向量数据库之野望7 - PostgreSQL 和pgvector

拉达曼迪斯II

AIGC学习数据库管理工具AI创业数据库postgresql人工智能机器学习AIGC搜索引擎

PostgreSQL是一款功能强大的开源对象关系数据库系统,它已将其功能扩展到传统数据管理之外,通过pgvector扩展支持矢量数据。这一新增功能满足了对高效处理高维矢量数据日益增长的需求,这些数据通常用于机器学习、自然语言处理(NLP)和推荐系统等应用。https://github.com/mazzasaverio/find-your-opensource-project什么是pgvector?

- Dom

周华华

JavaScripthtml

<!DOCTYPE html PUBLIC "-//W3C//DTD XHTML 1.0 Transitional//EN" "http://www.w3.org/TR/xhtml1/DTD/xhtml1-transitional.dtd">

<html xmlns="http://www.w3.org/1999/xhtml&q

- 【Spark九十六】RDD API之combineByKey

bit1129

spark

1. combineByKey函数的运行机制

RDD提供了很多针对元素类型为(K,V)的API,这些API封装在PairRDDFunctions类中,通过Scala隐式转换使用。这些API实现上是借助于combineByKey实现的。combineByKey函数本身也是RDD开放给Spark开发人员使用的API之一

首先看一下combineByKey的方法说明:

- msyql设置密码报错:ERROR 1372 (HY000): 解决方法详解

daizj

mysql设置密码

MySql给用户设置权限同时指定访问密码时,会提示如下错误:

ERROR 1372 (HY000): Password hash should be a 41-digit hexadecimal number;

问题原因:你输入的密码是明文。不允许这么输入。

解决办法:用select password('你想输入的密码');查询出你的密码对应的字符串,

然后

- 路漫漫其修远兮 吾将上下而求索

周凡杨

学习 思索

王国维在他的《人间词话》中曾经概括了为学的三种境界古今之成大事业、大学问者,罔不经过三种之境界。“昨夜西风凋碧树。独上高楼,望尽天涯路。”此第一境界也。“衣带渐宽终不悔,为伊消得人憔悴。”此第二境界也。“众里寻他千百度,蓦然回首,那人却在灯火阑珊处。”此第三境界也。学习技术,这也是你必须经历的三种境界。第一层境界是说,学习的路是漫漫的,你必须做好充分的思想准备,如果半途而废还不如不要开始。这里,注

- Hadoop(二)对话单的操作

朱辉辉33

hadoop

Debug:

1、

A = LOAD '/user/hue/task.txt' USING PigStorage(' ')

AS (col1,col2,col3);

DUMP A;

//输出结果前几行示例:

(>ggsnPDPRecord(21),,)

(-->recordType(0),,)

(-->networkInitiation(1),,)

- web报表工具FineReport常用函数的用法总结(日期和时间函数)

老A不折腾

finereport报表工具web开发

web报表工具FineReport常用函数的用法总结(日期和时间函数)

说明:凡函数中以日期作为参数因子的,其中日期的形式都必须是yy/mm/dd。而且必须用英文环境下双引号(" ")引用。

DATE

DATE(year,month,day):返回一个表示某一特定日期的系列数。

Year:代表年,可为一到四位数。

Month:代表月份。

- c++ 宏定义中的##操作符

墙头上一根草

C++

#与##在宏定义中的--宏展开 #include <stdio.h> #define f(a,b) a##b #define g(a) #a #define h(a) g(a) int main() { &nbs

- 分析Spring源代码之,DI的实现

aijuans

springDI现源代码

(转)

分析Spring源代码之,DI的实现

2012/1/3 by tony

接着上次的讲,以下这个sample

[java]

view plain

copy

print

- for循环的进化

alxw4616

JavaScript

// for循环的进化

// 菜鸟

for (var i = 0; i < Things.length ; i++) {

// Things[i]

}

// 老鸟

for (var i = 0, len = Things.length; i < len; i++) {

// Things[i]

}

// 大师

for (var i = Things.le

- 网络编程Socket和ServerSocket简单的使用

百合不是茶

网络编程基础IP地址端口

网络编程;TCP/IP协议

网络:实现计算机之间的信息共享,数据资源的交换

协议:数据交换需要遵守的一种协议,按照约定的数据格式等写出去

端口:用于计算机之间的通信

每运行一个程序,系统会分配一个编号给该程序,作为和外界交换数据的唯一标识

0~65535

查看被使用的

- JDK1.5 生产消费者

bijian1013

javathread生产消费者java多线程

ArrayBlockingQueue:

一个由数组支持的有界阻塞队列。此队列按 FIFO(先进先出)原则对元素进行排序。队列的头部 是在队列中存在时间最长的元素。队列的尾部 是在队列中存在时间最短的元素。新元素插入到队列的尾部,队列检索操作则是从队列头部开始获得元素。

ArrayBlockingQueue的常用方法:

- JAVA版身份证获取性别、出生日期及年龄

bijian1013

java性别出生日期年龄

工作中需要根据身份证获取性别、出生日期及年龄,且要还要支持15位长度的身份证号码,网上搜索了一下,经过测试好像多少存在点问题,干脆自已写一个。

CertificateNo.java

package com.bijian.study;

import java.util.Calendar;

import

- 【Java范型六】范型与枚举

bit1129

java

首先,枚举类型的定义不能带有类型参数,所以,不能把枚举类型定义为范型枚举类,例如下面的枚举类定义是有编译错的

public enum EnumGenerics<T> { //编译错,提示枚举不能带有范型参数

OK, ERROR;

public <T> T get(T type) {

return null;

- 【Nginx五】Nginx常用日志格式含义

bit1129

nginx

1. log_format

1.1 log_format指令用于指定日志的格式,格式:

log_format name(格式名称) type(格式样式)

1.2 如下是一个常用的Nginx日志格式:

log_format main '[$time_local]|$request_time|$status|$body_bytes

- Lua 语言 15 分钟快速入门

ronin47

lua 基础

-

-

单行注释

-

-

[[

[多行注释]

-

-

]]

-

-

-

-

-

-

-

-

-

-

-

1.

变量 & 控制流

-

-

-

-

-

-

-

-

-

-

num

=

23

-

-

数字都是双精度

str

=

'aspythonstring'

- java-35.求一个矩阵中最大的二维矩阵 ( 元素和最大 )

bylijinnan

java

the idea is from:

http://blog.csdn.net/zhanxinhang/article/details/6731134

public class MaxSubMatrix {

/**see http://blog.csdn.net/zhanxinhang/article/details/6731134

* Q35

求一个矩阵中最大的二维

- mongoDB文档型数据库特点

开窍的石头

mongoDB文档型数据库特点

MongoDD: 文档型数据库存储的是Bson文档-->json的二进制

特点:内部是执行引擎是js解释器,把文档转成Bson结构,在查询时转换成js对象。

mongoDB传统型数据库对比

传统类型数据库:结构化数据,定好了表结构后每一个内容符合表结构的。也就是说每一行每一列的数据都是一样的

文档型数据库:不用定好数据结构,

- [毕业季节]欢迎广大毕业生加入JAVA程序员的行列

comsci

java

一年一度的毕业季来临了。。。。。。。。

正在投简历的学弟学妹们。。。如果觉得学校推荐的单位和公司不适合自己的兴趣和专业,可以考虑来我们软件行业,做一名职业程序员。。。

软件行业的开发工具中,对初学者最友好的就是JAVA语言了,网络上不仅仅有大量的

- PHP操作Excel – PHPExcel 基本用法详解

cuiyadll

PHPExcel

导出excel属性设置//Include classrequire_once('Classes/PHPExcel.php');require_once('Classes/PHPExcel/Writer/Excel2007.php');$objPHPExcel = new PHPExcel();//Set properties 设置文件属性$objPHPExcel->getProperties

- IBM Webshpere MQ Client User Issue (MCAUSER)

darrenzhu

IBMjmsuserMQMCAUSER

IBM MQ JMS Client去连接远端MQ Server的时候,需要提供User和Password吗?

答案是根据情况而定,取决于所定义的Channel里面的属性Message channel agent user identifier (MCAUSER)的设置。

http://stackoverflow.com/questions/20209429/how-mca-user-i

- 网线的接法

dcj3sjt126com

一、PC连HUB (直连线)A端:(标准568B):白橙,橙,白绿,蓝,白蓝,绿,白棕,棕。 B端:(标准568B):白橙,橙,白绿,蓝,白蓝,绿,白棕,棕。 二、PC连PC (交叉线)A端:(568A): 白绿,绿,白橙,蓝,白蓝,橙,白棕,棕; B端:(标准568B):白橙,橙,白绿,蓝,白蓝,绿,白棕,棕。 三、HUB连HUB&nb

- Vimium插件让键盘党像操作Vim一样操作Chrome

dcj3sjt126com

chromevim

什么是键盘党?

键盘党是指尽可能将所有电脑操作用键盘来完成,而不去动鼠标的人。鼠标应该说是新手们的最爱,很直观,指哪点哪,很听话!不过常常使用电脑的人,如果一直使用鼠标的话,手会发酸,因为操作鼠标的时候,手臂不是在一个自然的状态,臂肌会处于绷紧状态。而使用键盘则双手是放松状态,只有手指在动。而且尽量少的从鼠标移动到键盘来回操作,也省不少事。

在chrome里安装 vimium 插件

- MongoDB查询(2)——数组查询[六]

eksliang

mongodbMongoDB查询数组

MongoDB查询数组

转载请出自出处:http://eksliang.iteye.com/blog/2177292 一、概述

MongoDB查询数组与查询标量值是一样的,例如,有一个水果列表,如下所示:

> db.food.find()

{ "_id" : "001", "fruits" : [ "苹

- cordova读写文件(1)

gundumw100

JavaScriptCordova

使用cordova可以很方便的在手机sdcard中读写文件。

首先需要安装cordova插件:file

命令为:

cordova plugin add org.apache.cordova.file

然后就可以读写文件了,这里我先是写入一个文件,具体的JS代码为:

var datas=null;//datas need write

var directory=&

- HTML5 FormData 进行文件jquery ajax 上传 到又拍云

ileson

jqueryAjaxhtml5FormData

html5 新东西:FormData 可以提交二进制数据。

页面test.html

<!DOCTYPE>

<html>

<head>

<title> formdata file jquery ajax upload</title>

</head>

<body>

<

- swift appearanceWhenContainedIn:(version1.2 xcode6.4)

啸笑天

version

swift1.2中没有oc中对应的方法:

+ (instancetype)appearanceWhenContainedIn:(Class <UIAppearanceContainer>)ContainerClass, ... NS_REQUIRES_NIL_TERMINATION;

解决方法:

在swift项目中新建oc类如下:

#import &

- java实现SMTP邮件服务器

macroli

java编程

电子邮件传递可以由多种协议来实现。目前,在Internet 网上最流行的三种电子邮件协议是SMTP、POP3 和 IMAP,下面分别简单介绍。

◆ SMTP 协议

简单邮件传输协议(Simple Mail Transfer Protocol,SMTP)是一个运行在TCP/IP之上的协议,用它发送和接收电子邮件。SMTP 服务器在默认端口25上监听。SMTP客户使用一组简单的、基于文本的

- mongodb group by having where 查询sql

qiaolevip

每天进步一点点学习永无止境mongo纵观千象

SELECT cust_id,

SUM(price) as total

FROM orders

WHERE status = 'A'

GROUP BY cust_id

HAVING total > 250

db.orders.aggregate( [

{ $match: { status: 'A' } },

{

$group: {

- Struts2 Pojo(六)

Luob.

POJOstrust2

注意:附件中有完整案例

1.采用POJO对象的方法进行赋值和传值

2.web配置

<?xml version="1.0" encoding="UTF-8"?>

<web-app version="2.5"

xmlns="http://java.sun.com/xml/ns/javaee&q

- struts2步骤

wuai

struts

1、添加jar包

2、在web.xml中配置过滤器

<filter>

<filter-name>struts2</filter-name>

<filter-class>org.apache.st

![]() ,X和Y分别定义在为输入空间和输出空间上的变量。

,X和Y分别定义在为输入空间和输出空间上的变量。![]() ,参数向量的表达形式。

,参数向量的表达形式。![]() 或者

或者![]()