kubernetes存储 -- Volumes管理(一)emptyDir卷、hostpath卷、NFS卷

介绍

- 容器中的文件在磁盘上是临时存放的,这给容器中运行的特殊应用程序带来一些问题。首先,当容器崩溃时,kubelet 将重新启动容器,容器中的文件将会丢失,因为容器会以干净的状态重建。其次,当在一个 Pod 中同时运行多个容器时,常常需要在这些容器之间共享文件。 Kubernetes 抽象出 Volume 对象来解决这两个问题。

- Kubernetes 卷具有明确的生命周期,与包裹它的 Pod 相同。 因此,卷比 Pod 中运行的任何容器的存活期都长,在容器重新启动时数据也会得到保留。 当然,默认情况下当一个 Pod 不再存在时,卷也将不再存在,我们通也也可以做卷的持久化。也许更重要的是,Kubernetes 可以支持许多类型的卷,Pod 也能同时使用任意数量的卷。

- 卷不能挂载到其他卷,也不能与其他卷有硬链接。 Pod 中的每个容器必须独立地指定每个卷的挂载位置。

- 实质上就是把数据和镜像进行解耦,进行存储。

- Kubernetes 支持下列类型的卷:

- awsElasticBlockStore 、azureDisk、azureFile、cephfs、cinder、configMap、csi

- downwardAPI、emptyDir、fc (fibre channel)、flexVolume、flocker

- gcePersistentDisk、gitRepo (deprecated)、glusterfs、hostPath、iscsi、local、

- nfs、persistentVolumeClaim、projected、portworxVolume、quobyte、rbd

- scaleIO、secret、storageos、vsphereVolume

emptyDir卷

-

emptyDir卷- 当 Pod 指定到某个节点上时,首先创建的是一个 emptyDir 卷,并且只要 Pod 在该节点上运行,卷就一直存在。 就像它的名称表示的那样,卷最初是空的。 尽管Pod 中的容器挂载 emptyDir 卷的路径可能相同也可能不同,但是这些容器都可以读写 emptyDir 卷中相同的文件。 当 Pod 因为某些原因被从节点上删除时,emptyDir 卷中的数据也会永久删除。

-

emptyDir 的

使用场景:- 缓存空间,例如基于磁盘的归并排序。

- 为耗时较长的计算任务提供检查点,以便任务能方便地从崩溃前状态恢复执行。

- 在 Web 服务器容器服务数据时,保存内容管理器容器获取的文件。

-

默认情况下, emptyDir 卷存储在支持该节点所使用的介质上;这里的介质可以是磁盘或 SSD 或网络存储,这取决于您的环境。 但是,您可以将 emptyDir.medium 字段设置为 “Memory”,以告诉 Kubernetes 为您安装

tmpfs(基于内存的文件系统)。虽然tmpfs 速度非常快,但是要注意它与磁盘不同。 tmpfs 在节点重启时会被清除,并且您所写入的所有文件都会计入容器的内存消耗,受容器内存限制约束。

示例:

apiVersion: v1

kind: Pod

metadata:

name: vol1

spec:

containers:

- name: vm1

image: busyboxplus

command: ["sleep", "300"]

volumeMounts:

- mountPath: /cache

name: cache-volume //挂载

- name: vm2

image: nginx

volumeMounts:

- mountPath: /usr/share/nginx/html //挂载到nginx发布页面

name: cache-volume //挂载

volumes:

- name: cache-volume //卷名称

emptyDir:

medium: Memory //可以不指定使用内存,这两行可以省略

sizeLimit: 100Mi

//卷被一个pod的多个容器挂载到了不同的路径,但是他们数据是同步的

[root@server2 vol]# kubectl apply -f vol1.yml

pod/vol1 created

[root@server2 vol]# kubectl get pod -o wide

NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE READINESS GATES

my-nginx-7f45d597d5-9hk7h 1/1 Running 0 2m37s 10.244.141.221 server3

vol1 2/2 Running 0 31s 10.244.22.21 server4

[root@server2 vol]# curl 10.244.22.21

403 Forbidden

403 Forbidden

nginx/1.19.0

//说明服务是没有问题的

他们之间共享网络栈,而且共享卷,目前是空卷,所以我们去创建数据。

[root@server2 vol]# kubectl exec -it vol1 -c vm1 -- sh //登进pod的vm容器

Defaulting container name to vm1.

Use 'kubectl describe pod/vol1 -n default' to see all of the containers in this pod.

/ # cd cache/

/cache # ls

/cache # echo woaini > index.html /在容器一的挂载目录创建文件

/cache #

[root@server2 vol]# curl 10.244.22.21

woaini

却可以通过容器二的nginx服务访问到了。说明通过卷在做数据共享。

我们的卷使用的是物理内存,直接消耗系统当中的内存量。

当前pod挂载在server4上,它的内存还有:

[root@server4 ~]# free -m

total used free shared buff/cache available

Mem: 1999 368 832 18 797 1445 /还有这些

Swap: 0 0 0

我们现在测试刚才设置的内存限制。

[root@server2 vol]# kubectl exec -it vol1 -c vm1 -- sh

/ # cd cache/

/cache # dd if=/dev/zero of=bigfile bs=1M count=100

100+0 records in

100+0 records out

[root@server4 ~]# free -m

total used free shared buff/cache available

Mem: 1999 377 723 118 897 1336 /少了100M

Swap: 0 0 0

/cache # dd if=/dev/zero of=bigfile bs=1M count=200 /在截取200M

300+0 records in

300+0 records out

[root@server4 ~]# free -m

total used free shared buff/cache available

Mem: 1999 374 526 318 1098 1139 /少了200M

Swap: 0

竟然也能成功,我们不是设置了最多100M吗。

/cache # command terminated with exit code 137 这是我们的pod突然退出了

^C[root@server2 vol]# kubectl get pod

NAME READY STATUS RESTARTS AGE

my-nginx-7f45d597d5-9hk7h 1/1 Running 0 15m

vol1 0/2 Evicted 0 12m

[root@server4 ~]# free -m

total used free shared buff/cache available

Mem: 1999 352 850 17 796 1462 /内存归还了

Swap: 0

- 可以看到文件超过sizeLimit,则一段时间后(1-2分钟)会被kubelet evict掉。

- 之所以不是“立即”被evict,是因为kubelet是定期进行检查的,这里会有一个时间差。

- 一段时间后 kubelet 识别到它已经超出了内存限制,就把她驱逐了。

但是为什么这样的操作可以执行哪,我们发现刚才的操作已经跳过了k8s的监管,这就说明在使用内存当作卷的存储时,是具有风险的,做的限制也不是事时的。

- emptydir缺点:

- 不能及时禁止用户使用内存。虽然过1-2分钟kubelet会将Pod挤出,但是这个时间内,其实

对node还是有风险的; - 影响kubernetes调度,因为empty dir并不涉及node的resources,这样会造成Pod“偷偷”

使用了node的内存,但是调度器并不知晓; - 用户不能及时感知到内存不可用

- 不能及时禁止用户使用内存。虽然过1-2分钟kubelet会将Pod挤出,但是这个时间内,其实

hostPath卷

- hostPath 卷能将主机节点文件系统上的文件或目录挂载到您的 Pod 中。 虽然这不是大多数 Pod

需要的,但是它为一些应用程序提供了强大的逃生舱。

可以用于监控容器,把主机的文件挂接到pod中,通过pod中的监控进行识别。

-

hostPath 的一些用法有:

- 运行一个需要访问 Docker 引擎内部机制的容器,挂载 /var/lib/docker 路径。

- 在容器中运行 cAdvisor (监控)时,以 hostPath 方式挂载 /sys。

- 允许 Pod 指定给定的 hostPath 在运行 Pod 之前是否应该存在,是否应该创建以及应该以

什么方式存在。

-

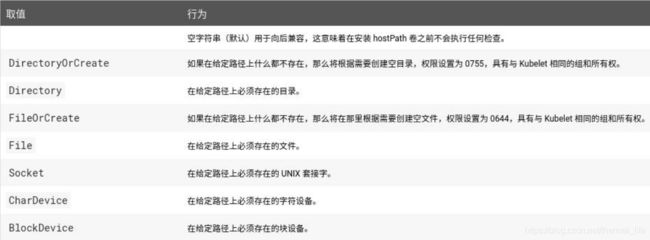

除了必需的 path 属性之外,用户可以选择性地为 hostPath 卷指定 type。

- 当使用这种类型的卷时要小心,因为:

- 具有相同配置(例如从 podTemplate 创建)的多个 Pod 会由于节点上文件的不同而在不同

节点上有不同的行为。 - 当 Kubernetes 按照计划添加资源感知的调度时,这类调度机制将无法考虑由 hostPath 使

用的资源。 - 基础主机上创建的文件或目录只能由 root 用户写入。您需要在 特权容器 中以 root 身份运

行进程,或者修改主机上的文件权限以便容器能够写入 hostPath 卷。

- 具有相同配置(例如从 podTemplate 创建)的多个 Pod 会由于节点上文件的不同而在不同

示例:

[root@server2 vol]# vim vol1.yml

apiVersion: v1

kind: Pod

metadata:

name: test-pd

spec:

containers:

- image: nginx

name: test-container

volumeMounts:

- mountPath: /usr/share/nginx/html /挂载到这里

name: test-volume

volumes:

- name: test-volume

hostPath:

path: /data /映射宿主机的data目录

type: DirectoryOrCreate /没有就创建

[root@server3 ~]# ll -d /data

ls: cannot access /data: No such file or directo

[root@server4 ~]# ll -d /data

ls: cannot access /data: No such file or directo

当前我们的结点上是都没/data 这个目录的。

[root@server2 vol]# kubectl apply -f vol1.yml

pod/test-pd created

[root@server2 vol]# kubectl get pod -owide

NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE READINESS GATES

test-pd 1/1 Running 0 59s 10.244.141.223 server3

/调度到了server3上

[root@server3 ~]# ll -d /data

drwxr-xr-x 2 root root 6 Jul 2 11:02 /data /创建了

[root@server3 data]# echo woaini >index.html /创建页面

[root@server3 data]# ll

total 4

-rw-r--r-- 1 root root 7 Jul 2 11:06 index.html

[root@server2 vol]# kubectl get pod -owide

NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE READINESS GATES

test-pd 1/1 Running 0 6s 10.244.141.224 server3

[root@server2 vol]# curl 10.244.141.224

woaini /就可以访问到了

我们现在在server4上手动创建 /data 目录,并编辑一个页面:

[root@server4 ~]# mkdir /data

[root@server4 ~]# cd /data/

[root@server4 data]# echo 666 > index.html

然后修改yaml文件,选择调度的结点在server4上:

apiVersion: v1

kind: Pod

metadata:

name: test-pd

spec:

nodeSelector:

kubernetes.io/hostname: server4 //这里

containers:

- image: nginx

name: test-container

volumeMounts:

- mountPath: /usr/share/nginx/html

name: test-volume

volumes:

- name: test-volume

hostPath:

path: /data

type: DirectoryOrCreate

[root@server2 vol]# kubectl apply -f vol1.yml

kubec get podpod/test-pd created

[root@server2 vol]# kubectl get pod -owide

NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE READINESS GATES

test-pd 1/1 Running 0 4s 10.244.22.23 server4

[root@server2 vol]# curl 10.244.22.23

666

现在访问的却是server4上的页面,我们只是改变了调度的结点,它却连页面都改变了,这就说明这种卷的方式会受宿主机的影响,有干扰。

那我们怎样让数据一致哪?就可以使用nfs类型的卷。

NFS卷

- nfs 卷能将 NFS (网络文件系统) 挂载到您的 Pod 中,让多个结点挂载一个存储。 不像 emptyDir 那样会在删除 Pod 的同时也会被删除,nfs 卷的内容在删除 Pod 时会被保存,卷只是被卸载掉了。 这意味着 nfs 卷可以被预先填充数据,并且这些数据可以在 Pod 之间"传递"。

[root@server1 ~]# yum install nfs-utils -y /安装工具

[root@server1 ~]# mkdir /nfsdata /建立nfs数据目录

[root@server1 ~]# vim /etc/exports

/nfsdata *(rw,sync) /将目录共享出去

[root@server1 ~]# chmod 777 /nfsdata/

[root@server1 ~]# systemctl enable --now nfs /启动服务

Created symlink from /etc/systemd/system/multi-user.target.wants/nfs-server.service to /usr/lib/systemd/system/nfs-server.service.

[root@server1 ~]# cd /nfsdata/

[root@server1 nfsdata]# echo 88888 > index.html /编辑一个页面

[root@server1 ~]# showmount -e

Export list for server1:

/nfsdata * /共享出去了

然后去各个结点安装nfs的支持:

[root@server3 ~]# yum insatll nfs-utils -y

[root@server4 ~]# yum insatll nfs-utils -y

[root@server4 data]# mount 172.25.254.1:/nfsdata /mnt/

[root@server4 data]# df

Filesystem 1K-blocks Used Available Use% Mounted on

/dev/mapper/rhel-root 17811456 4220508 13590948 24% /

devtmpfs 1011516 0 1011516 0% /dev

tmpfs 1023608 0 1023608 0% /dev/shm

tmpfs 1023608 17532 1006076 2% /run

tmpfs 1023608 0 1023608 0% /sys/fs/cgroup

/dev/sda1 1038336 135224 903112 14% /boot

tmpfs 204724 0 204724 0% /run/user/

172.25.254.1:/nfsdata 17811456 12813440 4998016 72% /mnt /可以挂载了

[root@server4 data]# umount /mnt/

[root@server2 vol]# vim vol1.yml

apiVersion: v1

kind: Pod

metadata:

name: test-pd

spec:

containers:

- image: nginx

name: test-container

volumeMounts:

- mountPath: /usr/share/nginx/html

name: test-volume

volumes:

- name: test-volume

nfs: /设置类型为nfs

server: 172.25.254.1 /指定ip和目录

path: /nfsdata

[root@server2 vol]# kubectl apply -f vol1.yml

pod/test-pd created

[root@server2 vol]# kubectl get pod -owide

NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE READINESS GATES

test-pd 1/1 Running 0 7s 10.244.141.225 server3

[root@server2 vol]# curl 10.244.141.225

88888

调度到server4上:

[root@server2 vol]# vim vol1.yml

apiVersion: v1

kind: Pod

metadata:

name: test-pd

spec:

nodeSelector:

kubernetes.io/hostname: server4 //指定标签

containers:

- image: nginx

name: test-container

volumeMounts:

- mountPath: /usr/share/nginx/html

name: test-volume

volumes:

- name: test-volume

nfs:

server: 172.25.254.1

path: /nfsdata

[root@server2 vol]# kubectl apply -f vol1.yml

pod/test-pd created

[root@server2 vol]# kubectl get pod -owide

NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE READINESS GATES

test-pd 1/1 Running 0 6s 10.244.22.24 server4

[root@server2 vol]# curl 10.244.22.24

88888

看出不论pod运行在那个结点,数据都是一致的。