2、Kafka安装配置、快速启动及基本操作教程

Kafka安装配置、快速启动及基本操作

- 1、Kafka下载

- 2、启动服务

- 扩展知识:进程守护方法和前后台进程切换

- 3、创建一个主题

- 扩展知识:bootstrap-server和zookeeper使用区别

- 4、删除主题

- 5、发送消息

- 6、消费消息

- 7、设置多个broker集群

- 8、使用Kafka connect来导入/导出数据

1、Kafka下载

下载Kafka:kafka官网下载

带src的是源文件,如:

Source download: kafka_2.11-2.3.0.tgz (asc, sha512)

应该下的是:

Scala 2.12 - kafka_2.11-2.3.0.tgz (asc, sha512)

本次下载使用的是Scala 2.12 - kafka_2.12-2.4.0.tgz

下载完成后,进行解码

> tar -xzf kafka_2.12-2.4.0.tgz

> cd kafka_2.12-2.4.0

如有启动过程的问题,可以看我的这篇文章:

kafka踩坑——java找不到kafka-run-class.sh: line 309: exec: java: not found

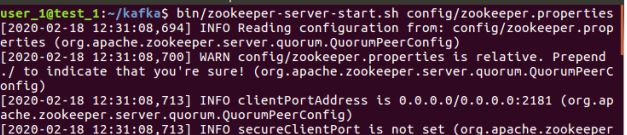

2、启动服务

运行kafka需要使用Zookeeper,所以你需要先启动Zookeeper,如果你没有Zookeeper,你可以使用kafka自带打包和配置好的Zookeeper。

> bin/zookeeper-server-start.sh config/zookeeper.properties

扩展知识:进程守护方法和前后台进程切换

- 如果想让该命令在后台运行,而保证可以继续用该命令终端进行操作的话

可以加在后面加“ &”,加在一个命令的最后,可以把这个命令放到后台执行,如root@Ubuntu$ ./tcpserv01 & - jobs命令

查看当前有多少在后台运行的命令

jobs -l选项可显示所有任务的PID,jobs的状态可以是running, stopped, Terminated。但是如果任务被终止了(kill),shell 从当前的shell环境已知的列表中删除任务的进程标识[kettle@4 data-integration]$ jobs -l - fg命令

将后台中的命令调至前台继续运行。如果后台中有多个命令,可以用fg %jobnumber(是命令编号,不是进程号)将选中的命令调出。cat@Ubuntu:~/unp/unpv13e/tcpcliserv$ fg %1 ./tcpserv01 - bg命令

将一个在后台暂停的命令,变成在后台继续执行。如果后台中有多个命令,可以用bg %jobnumber将选中的命令调出。cat@Ubuntu:~/unp/unpv13e/tcpcliserv$ bg %1 ./tcpserv01 - kill命令

方法1:通过jobs命令查看job号(假设为num),然后执行kill %num

方法2:通过ps命令查看job的进程号(PID,假设为pid),然后执行kill pid

前台进程的终止:Ctrl+ccat@Ubuntu:~/unp/unpv13e/tcpcliserv$ kill %1

扩展资料:Linux程序前台后台切换

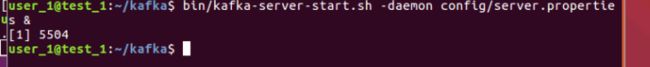

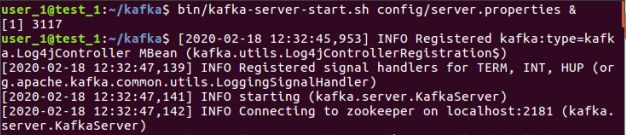

现在启动kafka服务,&:守护进程

> bin/kafka-server-start.sh config/server.properties &

也可以用加-daemon的方式加一个守护进程

> bin/kafka-server-start.sh -daemon config/server.properties

但发现还是出现信息,阻塞命令行界面

于是,突发奇想,来个二合一试试,两个进程守护

bin/kafka-server-start.sh -daemon config/server.properties &

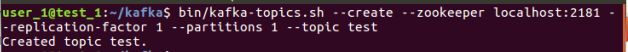

3、创建一个主题

创建一个名为“test”的Topic,只有一个分区和一个备份

bin/kafka-topics.sh --create --zookeeper localhost:2181 --replication-factor 1 --partitions 1 --topic test

bin/kafka-topics.sh --create --bootstrap-server localhost:2181 --replication-factor 1 --partitions 1 --topcis test

创建。

创建好之后,可以通过运行以下命令,查看已创建的topic信息:

bin/kafka-topics.sh --list --bootstrap-server localhost:2181

bin/kafka-topics.sh --list --bootstrap-server localhost:2181

或者,除了手工创建topic外,你也可以配置你的broker,当发布一个不存在的topic时自动创建topic。

扩展知识:bootstrap-server和zookeeper使用区别

0.8以前的kafka,消费的进度(offset)是写在zookeeper中的,所以consumer需要知道zk的地址。后来的版本都统一由broker管理,所以就用bootstrap-server了。

扩展知识:Kafka系列之broker-list,bootstrap-server以及zookeeper

4、删除主题

如果主题创建错误,或不想再用的话,可以用以下方式删除主题

bin/kafka-topics.sh --delete --bootstrap-server localhost:9092 --topic first

将地址为:localhost:2181,主题名为test的主题删除。

![]()

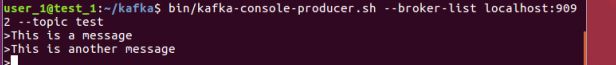

5、发送消息

再来用新的方式,创建一个地址为localhost:9092的新地址的主题

bin/kafka-topics.sh --create --bootstrap-server localhost:9092 --replication-factor 1 --partitions 1 --topic test

![]()

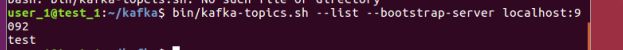

查看主题列表

bin/kafka-topics.sh --list --bootstrap-server localhost:9092

再来发送消息,Kafka提供了一个命令行的工具,可以从输入文件或者命令行中读取消息并发送给Kafka集群。每一行是一条消息。

运行producer(生产者),然后在控制台输入几条消息到服务器。

bin/kafka-console-producer.sh --broker-list localhost:9092 --topic test

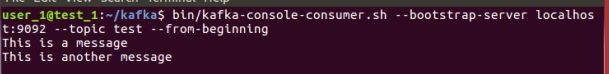

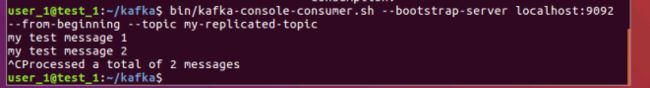

6、消费消息

Kafka也提供了一个消费消息的命令行工具,将存储的信息输出出来。

bin/kafka-console-consumer.sh --bootstrap-server localhost:9092 --topic test --from-beginning

如果你有2台不同的终端上运行上述命令,那么当你在运行生产者时,消费者就能消费到生产者发送的消息。

7、设置多个broker集群

到目前,我们只是单一的运行一个broker,没什么意思。对于Kafka,一个broker仅仅只是一个集群的大小,所以让我们多设几个broker。

首先为每个broker创建一个配置文件:

cp config/server.properties config/server-1.properties

cp config/server.properties config/server-2.properties

现在编辑这些新建的文件,设置以下属性:

config/server-1.properties:

broker.id=1

listeners=PLAINTEXT://:9093

log.dirs=/tmp/kafka-logs-1

config/server-2.properties:

broker.id=2

listeners=PLAINTEXT://:9094

log.dirs=/tmp/kafka-logs-2

注:log.dirs实际上是kafka中暂存数据的目录,而不是日志目录。

broker.id是集群中每个节点的唯一且永久的名称,我们修改端口和日志目录是因为我们现在在同一台机器上运行,我们要防止broker在同一端口上注册和覆盖对方的数据。

我们已经运行了zookeeper和刚才的一个kafka节点,所有我们只需要在启动2个新的kafka节点。

bin/kafka-server-start.sh config/server-1.properties &

...

bin/kafka-server-start.sh config/server-2.properties &

...

现在,我们创建一个新topic,把备份设置为:3

bin/kafka-topics.sh --create --bootstrap-server localhost:9092 --replication-factor 3 --partitions 1 --topic my-replicated-topic

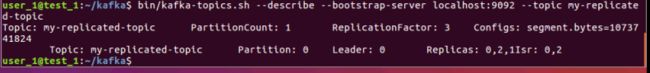

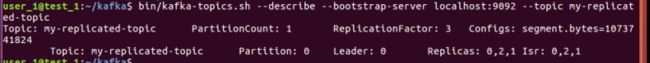

好了,现在我们已经有了一个集群了,我们怎么知道每个集群在做什么呢?运行命令“describe topics”

bin/kafka-topics.sh --describe --bootstrap-server localhost:9092 --topic my-replicated-topic

输出解释:第一行是所有分区的摘要,其次,每一行提供一个分区信息,因为我们只有一个分区,所以只有一行。

- “leader”:该节点负责该分区的所有的读和写,每个节点的leader都是随机选择的。

- “replicas”:备份的节点列表,无论该节点是否是leader或者目前是否还活着,只是显示。

- “isr”(in-sync replica set):“同步备份”的节点列表,也就是活着的节点并且正在同步leader。

我们运行这个命令,看看一开始我们创建的那个节点:

bin/kafka-topics.sh --describe --bootstrap-server localhost:9092 --topics test

这并不奇怪,刚才创建的主题没有Replicas,并且在服务器“0”上,我们创建它的时候,集群中只有一个服务器,所以是“0”。(“0”就是他的编号)

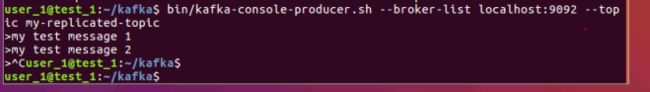

让我们来发布一些信息在新的topic上:

bin/kafka-console-producer.sh --broker-list localhost:9092 --topic my-replicated-topic

...

my test message 1

my test message 2

^C

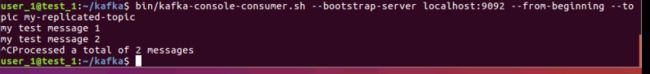

bin/kafka-console-consumer.sh --bootstrap-server localhost:9092 --from-beginning --topic my-replicated-topic

...

my test message 1

my test message 2

^C

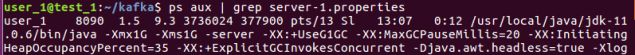

我们要测试集群的容错,kill掉leader,Broker1作为当前的leader,也就是kill掉Broker1。

ps aux | grep server-1.properties

kill -9 8090

在Windows上使用:

> wmic process where "caption = 'java.exe' and commandline like '%server-1.properties%'" get processid

ProcessId

6016

> taskkill /pid 6016 /f

备份节点之一成为新的leader,而broker1已经不在同步备份集合里了。

bin/kafka-topics.sh --bootstrap-server localhost:9092 --topic my-replicated-topic

bin/kafka-console-consumer.sh --bootstrap-server localhost:9092 --from-beginning --topic my-replicated-topic

8、使用Kafka connect来导入/导出数据

从控制台写入和写回数据是一个方便的开始,但你可能想要从其他来源导入或导出数据到其他系统。对于大多数系统,可以使用kafka Connect,而不需要编写自定义集成代码。

Kafka Connect是导入和导出数据的一个工具。它是一个可扩展的工具,运行连接器,实现与自定义的逻辑的外部系统交互。在这个快速入门里,我们将看到如何运行Kafka Connect用简单的连接器从文件导入数据到Kafka主题,再从Kafka主题导出数据到文件。

首先,我们首先创建一些“种子”数据用来测试:

echo -e "foo\nbar" > test.txt

windowns上:

echo foo> test.txt

echo bar>> test.txt

接下来,我们开始2个连接器运行在独立的模式,这意味着它们运行在一个单一的,本地的,专用的进程。我们提供3个配置文件作为参数。首先是Kafka Connect处理的配置,包含常见的配置,例如要连接的Kafka broker和数据的序列化格式。其余的配置文件都指定了要创建的连接器。包括连接器唯一名称,和要实例化的连接器类。以及连接器所需的任何其他配置。

kafka附带了这些示例的配置文件,并且使用了刚才我们搭建的本地集群配置并创建了2个连接器:第一个是源连接器,从输入文件中读取并发布到Kafka主题中,第二个是接收连接器,从kafka主题读取消息输出到外部文件。

在启动过程中,您将看到许多日志消息,其中包括一些表明正在实例化连接器的消息。Kafka Connect进程启动后,源连接器应开始从test.txt主题中读取行并将其生成到主题connect-test,而接收器连接器应开始从主题中读取消息connect-test 并将其写入文件test.sink.txt。我们可以通过检查输出文件的内容来验证数据已通过整个管道传递:

more test.sink.txt

foo

bar

请注意,数据存储在Kafka主题中connect-test,因此我们也可以运行控制台使用者以查看该主题中的数据(或使用自定义使用者代码进行处理):

bin/kafka-console-consumer.sh --bootstrap-server localhost:9092 --topic connect-test --from-beginning

{"schema":{"type":"string","optional":false},"payload":"foo"}

{"schema":{"type":"string","optional":false},"payload":"bar"}

...

连接器继续处理数据,因此我们可以将数据添加到文件中,并查看它在管道中的移动情况

echo Another line>> test.txt

查看到增加了一行信息

{"schema":{"type":"string","optional":false},"payload":"Anoter line"}

参考资料1:Apache Kafka官网教程

参考资料2:kafka安装和启动