大数据文摘编辑组出品

DeepMind又来搞事情了!而且这次的事情还搞上了Science杂志。

今天,Science杂志公开发表了一篇DeepMind的论文《神经场景表示和渲染(Neural scene representation and rendering)》。包括DeepMind老板Demis Hassabis在内,这篇论文共有22名作者。这也是DeepMind的新研究首次在Science杂志发布。

如此庞大的作者军团,po出的论文成果也非常有趣其重磅,具体来说就是,通过少量二维的局部图片,想象整个三维空间的立体结构。

通常来说,算法需要几百万张人类标注过的图片才能识别视觉传感器的数据。而GQN的工作原理类似人眼,是一种无监督学习方法,不依赖带标记的数据,而且能够推广到各种不同的场景中。

DeepMind自己的总结是:生成查询网络(Generative Query Network)在没有人为监督的情况下学习:(1)抽象地描述场景元素;(2)通过从任何摄像机角度渲染来“想象”场景中的未观察部分。

有点抽象?拿一个最常见的场景——走迷宫来举例。GQN能观察迷宫的片段截图,从多个视角推想出迷宫的整体构造。

尽管目前这一成果还仅限于受过合成场景的训练,但是,已经有不少业内人士开始想象其使用场景了。比如说,想象一下把这一网络应用在视频游戏甚至VR游戏中,你可以因此实时获取精准提炼各种视角的游戏场景,就像置身真实世界一样。

想想是不是有点激动,DeepMind创始人哈比萨斯也一样,今天他也难得发推特,介绍了这一成果:我一直着迷于大脑如何在大脑的眼睛中构建图像。我们新推出的Science论文介绍了GQN:一种新模型,能够从一些2D快照中重新创建各角度3D场景。

先来看看DeepMind这篇新论文到底在讲什么吧!

公众号后台回复“GQN”下载论文~

不想阅读论文的同学可以观看一下论文演示的视频哟~~~

一个可以“想象”场景的计算机程序

为了训练计算机“识别”由视觉传感器提供的场景的元素,计算机科学家通常使用数百万张人类煞费苦心地标记的图像。DeepMind开发了一种人工视觉系统,称为生成查询网络(GQN)。在这一网络下,不需要繁杂的标记数据即可创建场景。

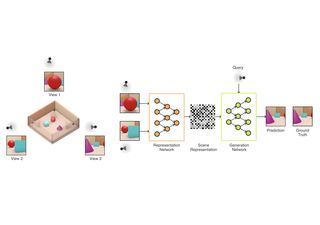

GQN首先使用从不同视点获取的图像,并创建一个场景的抽象描述,学习它的本质。接下来,基于这种表示,网络从一个新的、任意的视角来预测场景的样子。

一个计算机视觉系统可以从其他任意视点的几个2D视图中,预测一个3D场景。

当涉及到我们如何理解一个视觉场景时,我们的眼睛所能看到的不仅仅是直观的视觉,因为我们的大脑会运用头脑中的储备知识,将感性认识转化成理性认识。

例如,当你第一次进入一个房间时,你会立刻认出里面的物品以及它们的位置。如果你看到一张桌子的三条腿,你会推断桌子的第四条腿被藏了起来。即使你不能看到房间里的所有东西,你也很可能可以勾画出它的布局,或者想象从另一个角度看它会是什么样子。

这些视觉和认知任务对人类来说似乎毫不费力,但它们对我们的人工系统构成了重大挑战。

当前,最先进的视觉识别系统都是用人类产生的带注释图像的大数据集来训练的。

获取这些数据是一个代价高昂且耗时的过程,需要每个人对数据集中每个场景中的每个对象进行标记。因此,通常只有一小部分场景的总体内容被捕获,这限制了在这些数据上进行训练的人工视觉系统。当我们开发出在现实世界中运行的更复杂的机器时,我们希望它们充分了解它们的环境:最近的座位在哪里?这沙发是什么料子的?哪个光源产生了所有的阴影?电灯开关可能在哪里?

让机器学会脑补

学会去看

▼

论文作者之一Ali Eslami自述研究过程

在这项发表在Science上的成果中,DeepMind介绍了生成查询网络(GQN)。在这个框架内,机器学习只通过对他们在场景中移动时获得的数据进行训练来感知周围环境。 就像婴儿和动物一样,GQN尝试理解其观察到的周围世界,通过这种方式来学习。 通过这些,GQN学习了可能合理的场景及其几何属性,而不需要任何对场景内容的人为标注。

GQN模型由两部分组成:表示网络和生成网络。 表示网络将代理人的观察结果作为其输入并产生描述基础场景的表示(矢量)。 然后生成网络从以前未观察到的角度预测(“想像”)场景。

到底什么是GQN?

表征网络无法获知,生成网络将被要求预测哪些视角,因此,它必须尽可能准确地找到描述场景真实布局的有效方式。

通过简洁的分布式表征,其可以捕获最重要的特征(如对象位置、颜色和房间布局)来实现此目的。 在训练期间,生成器学习环境中的典型对象、特征、关系和规律。 这一共享的“概念集”使表征网络能够以高度压缩和抽象的方式描述场景,并将其留给生成网络,以在必要时填写详细信息。

例如,表示网络将简洁地将“蓝色立方体”表示为一小组数字,而生成网络将知道如何将其自身表现为来自特定视点的像素。

我们在模拟3D世界的一系列程序性生成环境中,对GQN进行了受控实验,其中包含随机位置、颜色、形状和纹理中的多个对象,并使用随机光源和重度遮挡。在对这些环境进行设置后,我们使用GQN的表示网络来形成新的、以前未观察到的场景的表示。 在实验中我们展示了GQN的几个重要特性:

GQN的生成网络可以以非常精确的方式,从新视角去“想象”以前未观测到的场景。当给出场景表征和新的摄像机视角时,它就可以生成非常清晰的图像,而不需要事先规定透视法、遮挡法或照明法。

因此我们可以说,这种生成网络是一个从数据中学习的渲染器:

GQN的表示网络可以学会对对象进行计数、本地化和分类,而无需任何对象级标签。 即使它的表示可能非常小,但GQN在查询视点处的预测具有高度的准确性,几乎无法与基本事实区分。

这意味着表示网络的准确感知,例如识别组成下面这个场景的方块的精确配置:

GQN能够表示、衡量和减少不确定性。 即使场景内容不完全可见,GQN也能够解释其信息的不确定性,并且可以将场景的多个局部视图组合起来,形成一个整体。

下图显示了它的第一人称和自上而下进行的场景预测。

该模型通过预测的多样性来表达其不确定性,这种不确定性随着它在迷宫中的移动而逐渐减小(灰色锥体指示观察位置,黄色锥体指示查询位置):

正如全文开头所说,GQN的这一特性,在游戏场景中可以完美应用。

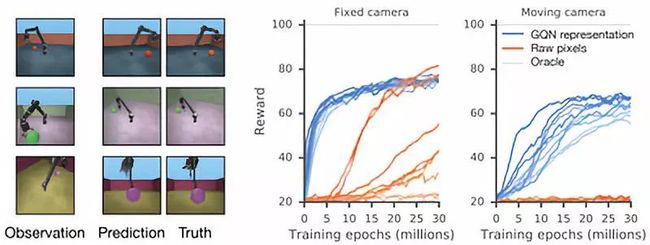

此外,GQN的表征允许鲁棒式的数据高效强化学习。 当给定GQN的紧凑表示时,与无模型基线智能体相比,最先进的深度强化学习智能体会以更高效的数据方式完成任务,如下图所示。 对于这些智能体,编码在生成网络中的信息可以被看作是对环境的“先天”知识:

使用GQN,我们可以观察到,与使用原始像素的标准方法相比,策略学习的迭代次数少了 4 倍,但收敛表现一致且有更加数据高效。

DeepMind表示,GQN的诞生基于近期在多视图几何、生成建模、无监督学习和预测学习方面的有关工作的大量成果。它演示了一种学习紧凑、基础的物理场景表示的新方法。更重要的是,这一方法不需要特定领域的工程或耗时的场景内容标记,它允许将相同的模型应用于各种不同的环境。它还可以使用一个强大的神经渲染器,能够从新的视角生成精确的场景图像。

与更传统的计算机视觉技术相比,DeepMind承认,这一新方法仍然有许多限制,且目前只接受过合成场景的训练。然而,随着新的数据源可用以及我们的硬件功能取得进展,DeepMind期望能够获取GQN框架在更高分辨率下,真实场景图像中的应用。

在未来的工作中,探索GQN在场景理解的更广泛方面的应用也很重要,例如通过跨空间和时间的查询来学习物理和运动的常识概念,以及在虚拟和增强现实中的应用。

尽管在方法准备付诸实践之前我们还有很多研究需要完成,但DeepMind相信,这项工作是迈向完全自主场景理解的一大步。