计算机视觉——基于BOW的图像检索

文章目录

- 一、实验原理

- (一)Bag of words模型

- (二)Bag of Feature 算法

- (三)Bag of Feature 算法过程

- (1)提取图像特征

- (2)训练字典

- (3)图片直方图表示

- (4)训练分类器

- 二、实验内容

- (一)数据集

- (二)sift提取特征并建立视觉词典

- (三)遍历所有的图像,将它们的特征投影到词汇并提交到数据库

- (四)进行查询匹配

- 三、实验总结

- (一)实验小结

- (二)安装pysqlite库

一、实验原理

(一)Bag of words模型

「Bag of Words」 是文本分类中一种通俗易懂的策略。一般来讲,如果我们要了解一段文本的主要内容,最行之有效的策略是抓取文本中的关键词,根据关键词出现的频率确定这段文本的中心思想。比如:如果一则新闻中经常出现「iraq」、「terrorists」,那么,我们可以认为这则新闻应该跟伊拉克的恐怖主义有关。而如果一则新闻中出现较多的关键词是「soviet」、「cuba」,我们又可以猜测这则新闻是关于冷战的。

这里所说的关键词,就是「Bag of words」中的 words ,它们是区分度较高的单词。根据这些 words ,我们可以很快地识别出文章的内容,并快速地对文章进行分类。

而「Bag of Feature」也是借鉴了这种思路,只不过在图像中,我们抽出的不再是一个个「word」,而是图像的关键特征「Feature」,所以研究人员将它更名为「Bag of Feature」。

(二)Bag of Feature 算法

「Bag of Feature」的本质是提出一种图像的特征表示方法。按照「Bag of Feature」算法的思想,首先我们要找到图像中的关键词,而且这些关键词必须具备较高的区分度。实际过程中,通常会采用「SIFT」特征。

有了特征之后,我们会将这些特征通过聚类算法得出很多聚类中心。这些聚类中心通常具有较高的代表性,比如,对于人脸来说,虽然不同人的眼睛、鼻子等特征都不尽相同,但它们往往具有共性,而这些聚类中心就代表了这类共性。我们将这些聚类中心组合在一起,形成一部字典(CodeBook)。

对于图像中的每个「SIFT」特征,我们能够在字典中找到最相似的聚类中心,统计这些聚类中心出现的次数,可以得到一个向量表示(有些文章称之为「直方图」)。这样,对于不同类别的图片,这个向量应该具有较大的区分度,基于此,我们可以训练出一些分类模型(SVM等),并用其对图片进行分类。

(三)Bag of Feature 算法过程

「Bag of Feature」大概分为四步:

1、提取图像特征;

2、对特征进行聚类,得到一部字典( visual vocabulary );

3、根据字典将图片表示成向量(直方图);

4、训练分类器或者用 KNN 进行检索(这一步严格来讲不属于「Bag of Feature」的范畴)。

(1)提取图像特征

特征必须具有较高的区分度,而且要满足旋转不变性以及尺寸不变性等,因此,我们通常都会采用「SIFT」特征(有时为了降低计算量,也会采用其他特征,如:SURF )。「SIFT」会从图片上提取出很多特征点,每个特征点都是 128 维的向量,因此,如果图片足够多的话,我们会提取出一个巨大的特征向量库。

(2)训练字典

提取完特征后,我们会采用一些聚类算法对这些特征向量进行聚类。最常用的聚类算法是 k-means。至于 k-means 中的 k 如何取,要根据具体情况来确定。另外,由于特征的数量可能非常庞大,这个聚类的过程也会非常漫长。聚类完成后,我们就得到了这 k 个向量组成的字典,这 k 个向量有一个通用的表达,叫 visual word。

(3)图片直方图表示

上一步训练得到的字典,是为了这一步对图像特征进行量化。对于一幅图像而言,我们可以提取出大量的「SIFT」特征点,但这些特征点仍然属于一种浅层(low level)的表达,缺乏代表性。因此,这一步的目标,是根据字典重新提取图像的高层特征。

具体做法是,对于图像中的每一个「SIFT」特征,都可以在字典中找到一个最相似的 visual word,这样,我们可以统计一个 k 维的直方图,代表该图像的「SIFT」特征在字典中的相似度频率。

(4)训练分类器

当我们得到每幅图片的直方图向量后,剩下的这一步跟以往的步骤是一样的。无非是根据数据库图片的向量以及图片的标签,训练分类器模型。然后对需要预测的图片,我们仍然按照上述方法,提取「SIFT」特征,再根据字典量化直方图向量,用分类器模型对直方图向量进行分类。当然,也可以直接根据 KNN 算法对直方图向量做相似性判断。

二、实验内容

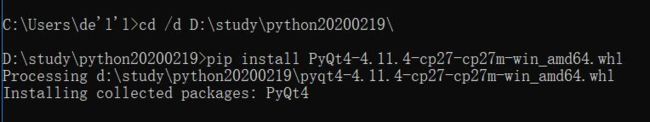

(一)数据集

(二)sift提取特征并建立视觉词典

要为我们的数据集里的图片创建视觉单词词汇,首先载入图像列表,利用SIFT提取特征描述子,获取特征列表,创建Vocabulary对象生成并保存词汇。

实现代码:

# -*- coding: utf-8 -*-

import pickle

from PCV.imagesearch import vocabulary

from PCV.tools.imtools import get_imlist

from PCV.localdescriptors import sift

# 获取图像列表

# imlist = get_imlist('E:/Python37_course/test7/first1000/')

imlist = get_imlist('F:\Pictures\one')

nbr_images = len(imlist)

# 获取特征列表

featlist = [imlist[i][:-3] + 'sift' for i in range(nbr_images)]

# 提取文件夹下图像的sift特征

for i in range(nbr_images):

sift.process_image(imlist[i], featlist[i])

# 生成词汇

# voc = vocabulary.Vocabulary('ukbenchtest')

# voc.train(featlist, 1000, 10)

voc = vocabulary.Vocabulary('test77_test')

voc.train(featlist, 100, 10)

# 保存词汇

# saving vocabulary

'''with open('E:/Python37_course/test7/first1000/vocabulary.pkl', 'wb') as f:

pickle.dump(voc, f)'''

with open('D:\dasan2\vocabulary', 'wb') as f:

pickle.dump(voc, f)

print ('vocabulary is:', voc.name, voc.nbr_words)

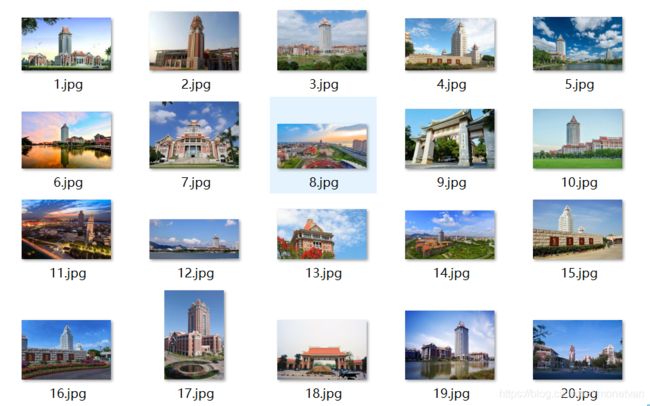

sift文件:

对每张图片生成相应的.sift文件,及视觉词汇,以便建立BOW模型。我所用的是图像集为100张。如果需要增加图像或减少只需要改代码里读取训练图像的数量。

pkl文件:

![]()

(三)遍历所有的图像,将它们的特征投影到词汇并提交到数据库

本部分主要实现目的是将模型数据导入数据库。照常先载入图像列表、特征列表及词汇,创建Indexer类对象利用数据库创建图像索引。

实现代码:

# -*- coding: utf-8 -*-

import pickle

from PCV.imagesearch import imagesearch

from PCV.localdescriptors import sift

from sqlite3 import dbapi2 as sqlite

from PCV.tools.imtools import get_imlist

#获取图像列表

imlist = get_imlist('F:/Pictures/one/')

nbr_images = len(imlist)

#获取特征列表

featlist = [imlist[i][:-3]+'sift' for i in range(nbr_images)]

# load vocabulary

#载入词汇

with open('D:/dasan2/vocabulary.pkl', 'rb') as f:

voc = pickle.load(f)

#创建索引

indx = imagesearch.Indexer('testImaAdd3.db',voc)

indx.create_tables()

# go through all images, project features on vocabulary and insert

#遍历所有的图像,并将它们的特征投影到词汇上

for i in range(nbr_images)[:1000]:

locs,descr = sift.read_features_from_file(featlist[i])

indx.add_to_index(imlist[i],descr)

# commit to database

#提交到数据库

indx.db_commit()

con = sqlite.connect('testImaAdd3.db')

print (con.execute('select count (filename) from imlist').fetchone())

print (con.execute('select * from imlist').fetchone())

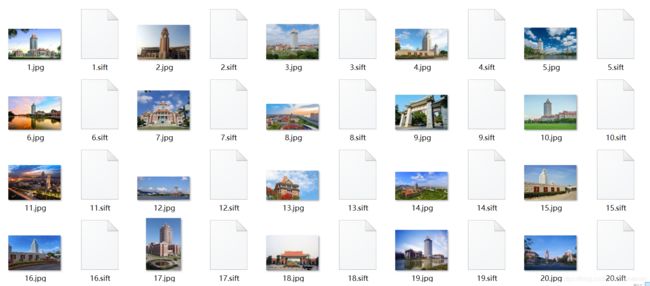

可得到一个数据库文件:

将上面得到的数据模型存放数据库testImaAdd3.db中,即运行下面代码会生成一个testImaAdd3.db数据库文件。

![]()

(四)进行查询匹配

在前面已经建立了图像索引,现在就可以在数据库中搜索相似的图像了。本部分创建了Searcher对象,执行定期查询,并将结果保存在res_reg列表中,然后载入res_reg列表中每一副图像的特征,并和查询图像进行匹配。最终获得排序好的检索结果图像。

实现代码:

# -*- coding: utf-8 -*-

import pickle

import sift

from PCV.imagesearch import imagesearch

from PCV.geometry import homography

from PCV.tools.imtools import get_imlist

# load image list and vocabulary

#载入图像列表

#imlist = get_imlist('E:/Python37_course/test7/first1000/')

imlist = get_imlist('E:/Python37_course/test7/images/')

nbr_images = len(imlist)

#载入特征列表

featlist = [imlist[i][:-3]+'sift' for i in range(nbr_images)]

#载入词汇

'''with open('E:/Python37_course/test7/first1000/vocabulary.pkl', 'rb') as f:

voc = pickle.load(f)'''

with open('E:/Python37_course/test7/images/vocabulary.pkl', 'rb') as f:

voc = pickle.load(f)

src = imagesearch.Searcher('testImaAdd.db',voc)

# index of query image and number of results to return

#查询图像索引和查询返回的图像数

q_ind = 0

nbr_results = 5

# regular query

# 常规查询(按欧式距离对结果排序)

res_reg = [w[1] for w in src.query(imlist[q_ind])[:nbr_results]]

print ('top matches (regular):', res_reg)

# load image features for query image

#载入查询图像特征

q_locs,q_descr = sift.read_features_from_file(featlist[q_ind])

fp = homography.make_homog(q_locs[:,:2].T)

# RANSAC model for homography fitting

#用单应性进行拟合建立RANSAC模型

model = homography.RansacModel()

rank = {}

# load image features for result

#载入候选图像的特征

for ndx in res_reg[1:]:

locs,descr = sift.read_features_from_file(featlist[ndx]) # because 'ndx' is a rowid of the DB that starts at 1

# get matches

matches = sift.match(q_descr,descr)

ind = matches.nonzero()[0]

ind2 = matches[ind]

tp = homography.make_homog(locs[:,:2].T)

# compute homography, count inliers. if not enough matches return empty list

try:

H,inliers = homography.H_from_ransac(fp[:,ind],tp[:,ind2],model,match_theshold=4)

except:

inliers = []

# store inlier count

rank[ndx] = len(inliers)

# sort dictionary to get the most inliers first

sorted_rank = sorted(rank.items(), key=lambda t: t[1], reverse=True)

res_geom = [res_reg[0]]+[s[0] for s in sorted_rank]

print ('top matches (homography):', res_geom)

# 显示查询结果

imagesearch.plot_results(src,res_reg[:8]) #常规查询

imagesearch.plot_results(src,res_geom[:8]) #重排后的结果

第一组:

常规查询结果:

重排后的查询结果:

第二组:

常规查询结果:

重排后查询结果:

第三组:

常规查询结果:

重排后的查询结果:

利用单词索引获得候选集,然后在候选集上进行逐一比较。对每个候选图像,都用标准的欧氏距离度量它和查询图像直方图的相似性,并按照相似性程度大小排序,返回排序后的距离及对应数据库ids大小,排在列表最前的是最好的匹配图像。

三、实验总结

(一)实验小结

1、实验结果中,第一张是查询图像,后面是按图像列表检索的前4幅图像。

2、图片尺寸越小运行速度越快,且图像清晰度也影响到最后的匹配结果。

3、三组对比实验中,第一组和第二组的检索结果相对准确,第三组检索结果中包含了其他建筑的图片,不过结果大致是准确。这可能是由于数据集不够大(此次实验数据集只含100张图片),可以继续扩大数据集,数据集越大准确度越高。

4、由实验结果可以看出,对于常规查询结果可重拍后的查询结果来说,重排后的查询结果会比常规查询结果更为准确些,重排用单应性进行拟合建立RANSAC模型,再导入候选图像特征进行排序查询;常规查询只是进行了简单的索引和查询,找到相似即可。

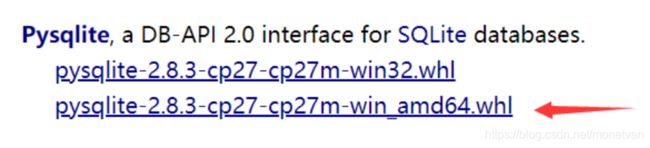

(二)安装pysqlite库

安装方法:

前往https://www.lfd.uci.edu/~gohlke/pythonlibs/#pyopengl里下载

下载完成后打开cmd,先进入pysqlite文件,再pip install: