常见数学建模方法学习总结及资料汇总

数学建模方法

- 前言

- 层次分析法(AHP)

- 多属性决策模型

- 模拟退火模型

- 种群竞争模型

- 遗传算法模型

- 线性规划模型

- 非线性规划模型

- PCA主成分分析

- 聚类分析

- 多元回归分析

前言

这是我在进行初级的数学建模时进行的一些原理学习,网上资料显得比较杂乱无章,这里我对一些数学建模方法的文档和视频资料进行了收集并汇总了以下写的好的,在学习时跟着这些资料学习并看看我的汇总就可以达到一个比较好的效果啦~

层次分析法(AHP)

应用:决策。(择优选择方案、优劣等级划分…)

原理:根据问题的性质,使问题归结为最低层(供决策的方案、措施)到中间层(指标),中间层到最高层(总目标)的相对权值,通过一系列计算,来确定优劣性。

其中,中间层到最高层的相对权值,表示考虑方案的不同指标对最终结果选择的权重。最底层到中间层的相对权值,表示单个指标下,表现多个方案的好坏对比的权重。

基本步骤:

1、划分层次(层次模型):分为目标——准则层(指标)——方案层。

2、构造判断矩阵(又称成对比较矩阵)。根据1~9尺度进行相应填写。

3、一致性检验与求权重矩阵 。CR(一致性比率)<0.1则成对比较矩阵通过。一致性检验是检验判断构造的矩阵是否合格。权重矩阵是用来计算最终方案权值的。

4、根据权重矩阵求最优方案。

视频学习:

先看:

链接: AHQ初步学习

后看: AHQ加深理解

多属性决策模型

应用:决策。

原理:类似于一般的加权求总分。主要思想是把量纲不同的数值转化为同一个量纲,然后构建权重矩阵,计算加权分值进行决策。

基本步骤:

加权算数平均算子,属性值类型归一化。

1、根据属性类型,划分为效益型、成本型等,对决策矩阵(属性值构成的矩阵)进行归一化。

2、构建成对比较矩阵,得到各个属性指标权重矩阵。(同AHP,也要进行一致性检验)

3、根据权值矩阵与归一化的决策矩阵确定每个方案的最终权值,进行决策。

文档资料:多属性决策模型

视频资料:多属性决策模型

层次分析法和多属性决策模型的区别:层次分析法针对于定性问题定量分析,多属性决策模型则不然。即如果“属性值”并不是一个能用“数值”很好地表示的值的话,采用AHP的1~9尺度是更优方案。如果“属性值”全都是适合的“数值”的话,就用多属性决策模型的方案。

模拟退火模型

应用:无法确定能否在规定时间内找到最优解的NP问题——旅行商问题(TSP,访问每一座城市并回到最初城市的最短回路);背包问题(在限定的总重量下,如何选择物品使总价值最高);最大流问题(充分利用管道能力,使总流量最大);图着色问题(用最少的颜色,对地图进行着色);…

原理:一种寻找最优解的算法,传统的算法可能被局限于局部最优解,模拟退火算法给出一定概率使计算中能够跳出局部最优解继续求解,当求出更优解时可以得到答案。

基本步骤:

1、初始化。(T温度,S初始解状态,迭代次数)

2、如果计算的最新状态趋近于最优解,则把这个最优解作为下一次计算的起点。

3、如果计算的最新状态趋远于最优解,则根据方案取一定概率,使新的状态作为下一次计算的起点。

4、重复1、2、3步骤,直至达到平衡状态并满足条件。

文档资料:

模拟退火模型通俗理解

模拟退火模型加深理解

种群竞争模型

应用:种群之间的竞争,优胜劣汰;产品的市场竞争模型…

原理:当两个物种共同生存,相互会起到阻滞作用时建立的模型。种群竞争设置的参数为【初始数量,自然增长率,环境容量,种群对资源的消耗量】。

基本步骤:无。这个模型的资料大多都很简略。

文档资料:种群竞争模型

遗传算法模型

应用:对于同一个物种,有着个体之间性能的差异,遗传算法针对的是物种内的优胜劣汰。

原理:建立遗传算法模型,通过N代的遗传、交叉、变异、复制,找到问题的最优解。

基本步骤:

1、根据初始化种群个体来初始化编码和数据。

2、评估个体的适应度,作为优胜劣汰的评价标准。

3、通过选择、交叉、变异、复制(为了保证最优个体能存活,对当代最优个体直接复制到下一代)来决定下一代的种群群体。

4、重复步骤1~3,最好的迭代结果次数是种群群体性能趋于稳定时。

文档资料:

遗传算法通俗理解

遗传算法加深理解

线性规划模型

应用:对于有线性限制的问题求最优解。

原理:根据限制建立线性关系,根据决策函数求最优解。高中的东西了。如果存在最优解,只能在可行域的边界找到(一般为顶点)。

基本步骤:

1、假设/寻找决策变量。(影响目标结果且有条件限制的变量)

2、建立目标函数。(需要求最优解的东西)

3、寻找约束条件。(变量之间的约束关系)

4、求解。

文档:线性规划

非线性规划模型

应用:对于有非线性限制的问题求最优解(约束函数或者目标函数含有非线性关系)。

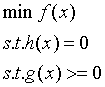

原理:解决非线性规划模型,这种模型没有通用的解决方案,各个方法都有自己适用的范围。最优解可能在可行域的任意一点找到。通常非线性规划模型可以概括为:

其含义为:优化目标为f(x),受限于一个等式h(x)与一个不等式g(x)。

基本步骤:

1、同线性规划,找出决策变量;建立目标函数;寻找约束条件。

2、求解过程中,选定初始点x,构建点x在趋于最优解的搜索方向,以该搜索方向为基础,设定搜索步长,找到下一个迭代点。

3、以新迭代点为初始点,重复进行2步骤。

文档资料(比较多,稍微看看就好):非线性规划

PCA主成分分析

应用:降维。

原理:在损失较少信息的基础上实现降维。周志华西瓜书上提到的最近重构性和最大可分性,实际上是关于协方差与方差的问题。协方差代表维度之间的相关性,方差可以表示维度可以保留的信息。故PCA降维的优化目标为:在N维中选择R维作为“主成分”,这R维之间两两之间协方差尽量小,方差尽量大。

基本步骤:涉及线性代数、矩阵分析。文档资料中有兴趣自行了解。

文档资料:

PCA理解与基本概念

PCA维度的选择

聚类分析

应用:无监督分类。

原理:对没有标示性的数据,按照算法,进行簇划分。

基本步骤:

聚类算法分很多类别。最常使用是基于距离和基于密度的聚类方案,具体方案选择结合实际。

在基于距离聚类中比较典型的是k-means聚类,通过多次迭代更新中心点,找到多个中心点(簇的中心)与多个簇,实现:簇内点紧凑,簇间分离程度高。需要设置K(簇数)的值,效率高。

基于密度的聚类有DBSCAN和MeanShift(均值漂移)等,主要思路是根据数据点的紧凑程度,将聚合程度较高的数据形成簇。

基于密度的聚类相比于基于距离的聚类,可以找到数据点分布呈不规则形状的簇,效率要差一些,相比之下,基于距离的聚类,同一个簇中各个数据点都不会太偏离中心点,效率高。

鸢尾花分类的聚类代码,用来辅助学习与理解。

from sklearn import datasets

from sklearn import model_selection

from sklearn.cluster import KMeans

import matplotlib.pyplot as plt

# step1.加载数据

iris = datasets.load_iris()

# 2.取特征空间中的4个维度

X = iris.data[:,:4]

# 3.搭建模型,构造KMeans聚类器

estimator = KMeans(n_clusters=3)

#开始聚类训练

estimator.fit(X)

# 获取聚类标签

label_pred = estimator.labels_

# 绘制数据分布图(以花萼长度和宽度为展示依据)

# plt.scatter(X[:, 0], X[:, 1], c="red", marker='o', label='see')

# print(X[:,0])

# plt.xlabel('calyx length')

# plt.ylabel('calyx width')

# plt.legend(loc=2)

# plt.show()

多元回归分析

应用:主要用于描述关系或进行预测。

原理:建立因变量和多个自变量之间的线性或者非线性关系。常见的回归分析是线性回归,在线性回归中因变量y也可以不作为结果,而作为另一个需要得到的结果g(x)的因变量,即:

![]() ,这样的的线性回归称为广义线性回归。

,这样的的线性回归称为广义线性回归。

基本步骤:主要分为线性回归和非线性回归。就不总结了大伙自己看看吧。

文档资料:挺多的不找了,大部分都是线性回归,非线性回归资料少。