MapReduce实例----数据去重

数据去重的

最终目标是让

原始数据中

出现次数超过一次的数据在输出文件中只出现一次。我们自然而然会想到将同一个数据的所有记录都交给一台reduce机器,无论这个数据出现多少次,只要在最终结果中输出一次就可以了。具体就是reduce的

输入应该以

数据作为

key,而对value-list则

没有要求。当reduce接收到一个时就

直接将key复制到输出的key中,并将value设置成

空值。

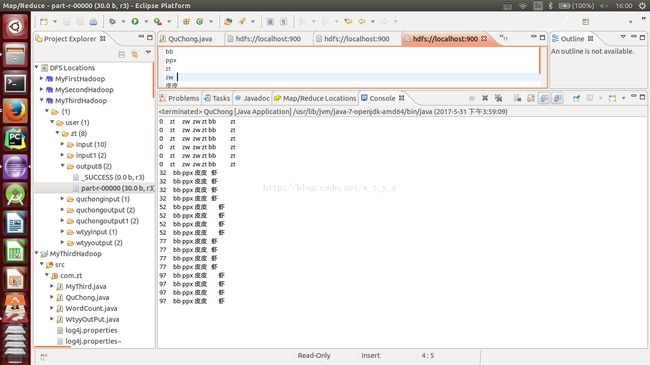

测试输出:

同时控制台输出如下:

测试输入:

file2:

输出:

在MapReduce流程中,map的输出

一、字符串去重代码如下:

package com.zt;

import java.io.IOException;

import java.util.StringTokenizer;

import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.Path;

import org.apache.hadoop.io.IntWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Job;

import org.apache.hadoop.mapreduce.Mapper;

import org.apache.hadoop.mapreduce.Reducer;

import org.apache.hadoop.mapreduce.lib.input.FileInputFormat;

import org.apache.hadoop.mapreduce.lib.output.FileOutputFormat;

import org.apache.hadoop.util.GenericOptionsParser;

public class QuChong {

//map将输入中的value复制到输出数据的key上,并直接输出

public static class Map extends Mapper{

private static Text line=new Text();//每个字符串

//实现map函数

public void map(Object key,Text value,Context context) //接收一个文件名作为key,该文件的每行内容作为value

throws IOException,InterruptedException{

String str=value.toString();

StringTokenizer stringTokenizer=new StringTokenizer(str);

while(stringTokenizer.hasMoreElements()){ //迭代得到每个字符串

line.set(stringTokenizer.nextToken());

System.out.println(key+" "+value);

context.write(line, new Text("")); //输出产生的中间键值对,键为这个字符串,值为空

}

}

}

//reduce将输入中的key复制到输出数据的key上,并直接输出

public static class Reduce extends Reducer{

//实现reduce函数

public void reduce(Text key,Iterable values,Context context) //将map函数输出的中间键值对作为输入值

throws IOException,InterruptedException{

context.write(key, new Text("")); //输出每个键,即字符串

}

}

public static void main(String[] args) throws Exception{

Configuration conf = new Configuration();

String[] otherArgs = new GenericOptionsParser(conf, args).getRemainingArgs();

if (otherArgs.length != 2) {

System.err.println("Usage: Data Deduplication ");

System.exit(2);

}

Job job = new Job(conf, "Data Deduplication");

job.setJarByClass(QuChong.class);

//设置Map、Combine和Reduce处理类

job.setMapperClass(Map.class);

job.setCombinerClass(Reduce.class);

job.setReducerClass(Reduce.class);

//设置输出类型

job.setOutputKeyClass(Text.class);

job.setOutputValueClass(Text.class);

//设置输入和输出目录

FileInputFormat.addInputPath(job, new Path(otherArgs[0]));

FileOutputFormat.setOutputPath(job, new Path(otherArgs[1]));

System.exit(job.waitForCompletion(true) ? 0 : 1);

}

} 测试输入:

zt zw zw zt bb zt

bb ppx 皮皮 虾

bb ppx 皮皮 虾

bb ppx 皮皮 虾

bb ppx 皮皮 虾测试输出:

bb

ppx

zt

zw

皮皮

虾 同时控制台输出如下:

二、上面是以字符串为单位去重,如果是以行为单位去重,则不需要迭代出每个字符串,代码如下:

package com.zt;

import java.io.IOException;

import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.Path;

import org.apache.hadoop.io.IntWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Job;

import org.apache.hadoop.mapreduce.Mapper;

import org.apache.hadoop.mapreduce.Reducer;

import org.apache.hadoop.mapreduce.lib.input.FileInputFormat;

import org.apache.hadoop.mapreduce.lib.output.FileOutputFormat;

import org.apache.hadoop.util.GenericOptionsParser;

public class MyThird {

//map将输入中的value复制到输出数据的key上,并直接输出

public static class Map extends Mapper{

private static Text line=new Text();//每行数据

//实现map函数

public void map(Object key,Text value,Context context)

throws IOException,InterruptedException{

line=value;

context.write(line, new Text(""));

}

}

//reduce将输入中的key复制到输出数据的key上,并直接输出

public static class Reduce extends Reducer{

//实现reduce函数

public void reduce(Text key,Iterable values,Context context)

throws IOException,InterruptedException{

context.write(key, new Text(""));

}

}

public static void main(String[] args) throws Exception{

Configuration conf = new Configuration();

//这句话很关键

// conf.set("mapred.job.tracker", "192.168.1.2:9001");

//String[] ioArgs=new String[]{"dedup_in","dedup_out"};

String[] otherArgs = new GenericOptionsParser(conf, args).getRemainingArgs();

if (otherArgs.length != 2) {

System.err.println("Usage: Data Deduplication ");

System.exit(2);

}

Job job = new Job(conf, "Data Deduplication");

job.setJarByClass(MyThird.class);

//设置Map、Combine和Reduce处理类

job.setMapperClass(Map.class);

job.setCombinerClass(Reduce.class);

job.setReducerClass(Reduce.class);

//设置输出类型

job.setOutputKeyClass(Text.class);

job.setOutputValueClass(Text.class);

//设置输入和输出目录

FileInputFormat.addInputPath(job, new Path(otherArgs[0]));

FileOutputFormat.setOutputPath(job, new Path(otherArgs[1]));

System.exit(job.waitForCompletion(true) ? 0 : 1);

}

} 测试输入:

file1:

2012-3-1 a

2012-3-2 b

2012-3-3 c

2012-3-4 d

2012-3-5 a

2012-3-6 b

2012-3-7 c

2012-3-3 cfile2:

2012-3-1 b

2012-3-2 a

2012-3-3 b

2012-3-4 d

2012-3-5 a

2012-3-6 c

2012-3-7 d

2012-3-3 c

输出:

2012-3-1 a

2012-3-1 b

2012-3-2 a

2012-3-2 b

2012-3-3 b

2012-3-3 c

2012-3-4 d

2012-3-5 a

2012-3-6 b

2012-3-6 c

2012-3-7 c

2012-3-7 d