清华大学团队:人脸识别爆出巨大丑闻,15分钟解锁19款手机

1 清华大学的RealAI 团队15分钟解锁19款手机

刚刚,清华大学的一条重大发现,利用人脸识别技术的漏洞,“ 15分钟解锁19个陌生智能国产手机 ”的事件,引发无数网友关注。

据悉,清华大学的RealAI 团队共选取了 20 款手机,其中1款是国外的,另外19款都是我们国产的智能手机,均来自排名前五的国产手机品牌,每一品牌下选取了 3-4 款不同价位的手机型号,覆盖低端机到旗舰机 。

1)测试步骤如下:

-

第一步,清华大学的测试人员,把19部国产手机,人脸识别全部绑定为旁边的“ 1号同学 ”;

-

第二步,让旁边的同学、同事,拿起他的手机,进行人脸识别。请注意,这里直接识别非绑定人员的面部是无法打开的;

-

第三步:将1号同学的照片,特别是眼睛部位图案打印并裁剪出来,贴到我们平时戴的眼镜上面。然后,奇迹发生了,解锁成功了!

据了解,研究团队选取了20款手机进行测试,除了一台iPhone 11外,其余安卓机型均在15分钟内破解。这19款手机覆盖排名前五的国产手机品牌的低端机到旗舰机型。其中一款是某品牌在去年12月发布的最新款旗舰机。

从被破解的程度上看,攻击这些手机的难度几乎没有任何区别,不管是低端机,还是售价4000以上的高端手机,全都解锁成功。

除了破解手机面部解锁系统,研究团队还通过对抗样本攻击,通过了一些政务、金融类的App人脸识别认证,甚至假冒机主,在线上完成银行开户。

据介绍,虽然开发出核心算法的难度很大,但如果有黑客恶意开源这一算法,就会极大降低破解的难度。研究人员建议,人脸识别应用方可通过在认证过程中增加检验对抗样本的模块,来防范此类风险。

2)那么新的攻击方式是如何实现的?

据介绍,RealAI 使用的整个破解过程物理上只用到三样东西:一台打印机、一张 A4 纸、一副眼镜框。

算法人员们介绍,他们在拿到被攻击者的照片后,通过算法在眼部区域生成干扰图案,然后打印出来裁剪为「眼镜」的形状贴到镜框上,测试人员戴上就可以实现破解,整个过程只花费 15 分钟左右。

左一为被攻击对象的眼部图像,右一、右二为生成的对抗样本图案。

与生成对抗网络 GAN 的对抗样本类似的是,「眼镜」上的花纹虽然很像复制了被攻击者的眼部图案,但其实并没有这么简单。算法人员表示,这是结合攻击者的图像与被攻击者的图像通过算法计算生成的扰动图案,在 AI 学界称为「对抗样本」。

将攻击者图像设定为输入值,被攻击者图像设定为输出值,算法会自动计算出最佳的对抗样本图案,保证两张图像相似度达到最高值。

看似粗糙的攻击手段,核心的对抗算法研发其实极具技术门槛。

但这也并不意味这一安全问题构不成威胁,RealAI 团队表示,「虽然开发出核心算法难度很大,但如果被黑客恶意开源的话,上手难度就大大降低了,剩下的工作就只是找张照片。」言外之意就是,只要能拿到被攻击对象的 1 张照片,大部分人都能很快制作出犯罪工具实现破解。

对抗样本攻击,从实验室走进现实

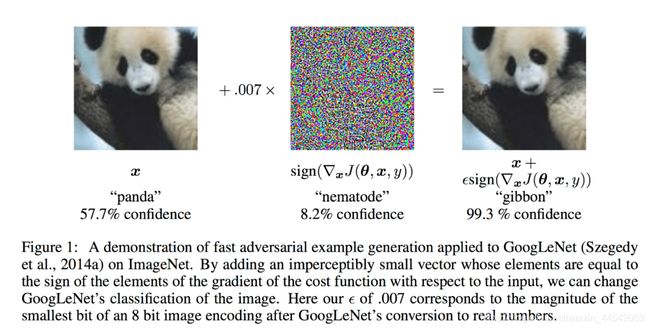

对抗样本攻击的概念其实并不新颖,2013 年,Google 研究员 Szegedy 等人发现机器学习容易遭受欺骗,通过故意在数据源上添加细微扰动,就可以让机器学习模型作出错误输出,对抗样本攻击也被视为 AI 安全领域的一大隐忧。

在某些神经网络中,这张图像被认为是熊猫的置信度是 57.7%,且其被分类为熊猫类别的置信度是所有类别中最高的,因此网络得出一个结论:图像中有一只熊猫。但是,只需要添加少量精心构造的噪声,可以得到一个这样的图像(右图):对于人类而言,它和左图几乎一模一样,但是网络却认为其被分类为「长臂猿」的置信度高达 99.3%。

2人脸识别风险问题屡屡发生

人脸识别到底存在哪些风险?风险又有多大?这些问题其实已经经常发生在社会里。

1) 董明珠闯红灯了?原来是大巴车上的广告被人脸识别搞错了

比如之前就发生过,交通摄像头把大巴车上的董明珠广告人像错当成横穿马路的行人进行了抓拍,还在旁边打出了“桥东违法闯红灯”的字样,该事件还上了热搜榜单;同样,在去年还发生了一起“小学生轻松破解丰巢刷脸取件”的热点事件,浙江小学生发现,用一张人像的打印照片即可轻松“破解”丰巢智能柜的“刷脸取件”,取出父母的快件。事件发酵后,丰巢紧急下线了该功能,并向公众回应称,“刷脸取件”是小范围推出的测试版本,已第一时间下线,并未造成用户损失。

2) 人脸识别安全吗?罪犯的初中文化水平让人脸识别被打脸

在很多人的眼里,苹果手机的安全性是要高于一般的安卓手机的。

但广西法院近日公开的一份刑事判决书,不得不让人重新审视这个安全性, 判决书显示,2019年6月8日19时许,被告人黄某到柳州市一家二手手机店,欲在此店选购手机。黄某挑选手机时,看到被害人陈某已出售在此店的一部苹果牌手机,后发现陈某的微信、支付宝账户并未退出,遂购买了该手机。

次日2时至9时期间,黄某在柳州市鱼峰区柳石路和九头山路路口处一树下,利用该手机内陈某的照片,制作了一张人脸识别动态图在支付认证时使用,以此方式分别从陈某的微信账户、支付宝账户内转款人民币9100元、7500元至其个人账户。

随后,黄某将该手机退还到原手机店,并将赃款挥霍。

值得一提的是,1996年出生于广西壮族自治区柳州市的黄某,初中文化,无职业。

3) 不能让“戴头盔看房”成为无奈

近期,一则“戴头盔看房”的视频在网上流传。买房者为何要戴着头盔买房呢?许多人首先想到的是,他是不是怕被熟人认出来。但是通过调查发现,买房人并不是怕被熟人认出来,而是为了躲避售楼处的人脸识别系统。安装人脸识别装置,在一些地方的售楼处成为“标配”,其目的就是为了配合房企的“分销模式”,锁定购房者的身份,避免房企销售人员和中介的扯皮。

乍听起来,售楼处的这个举措,能够避免客户群体划分不清导致的争端,但仔细想想,购房者的隐私谁来保障呢?更有甚者,一旦购房者因为人脸识别系统被判定为“自然到访客户”,就不能享受到渠道优惠,也难怪购买者要戴着头盔来看房子了。

人脸识别技术不能滥用,这在法律上已有明确的规定。在相关法律条款中都明确,信息收集者不仅要“明示收集、使用信息的目的、方式和范围”,而且必须“经被收集者同意”。就在近日,被称为“人脸识别第一案”的郭兵与杭州野生动物世界有限公司服务合同纠纷案一审宣判。在法律人士看来,宣判的结果意味着,当人们发现有单位或个人使用人脸识别设备且自己不愿意被识别,可以主动与对方沟通,要求其删除与自己相关的个人信息数据,必要时完全可以通过诉讼方式维护自己的合法权益。

2 大众点评:

2.1 新民快评: 有关部门对于滥用人脸识别不能“赤裸裸”地无视

必须评估其使用的正当性、必要性、安全性,不能等到问题大了之后,再进行约束,这样就可能会面临更大的阻力。只有靠前一步进行监管,才能让人脸识别技术更好地造福社会,避免对于个人隐私的伤害。

2.2 白岩松谈戴头盔看房:希望法律为我们戴头盔

2.3 支付产业网:刷脸支付存在着严峻的安全问题

支付产业网看到,在公、检、法严谨的办案流程下,判决书中并未出现第三人相助,黄某仅凭一己之力就可以用受害人的照片生成了动态图,顺利通过了微信支付宝的支付认证。

用户在微信支付和支付宝中的资金受到损失,无疑将会影响两者在用户心中安全性的评价。虽然微信支付和支付宝是调用了苹果手机的人脸识别接口,把身份认证交由苹果来确认,但丝毫不影响用户在支付机构的账户资金受损的事实。

这同时也说明了刷脸支付存在着严峻的安全问题,即使如市值过万亿美元的苹果公司也未能彻底防住动态图的欺诈。

![]()

2.4 央行科技司司长李伟

就在去年夏天,央行科技司司长李伟在一次会上表示,人脸是非常敏感的个人信息,一旦泄露或被盗取,会带来非常大的影响。现在有的技术在三公里之外可以识别人脸,如果人脸支付时,一刷脸钱就没了,一个场景不能表达客户的主观意愿是可怕的。所以有技术也不能滥用,有技术也不能任性。

2.5 媒体点评

上个月,有分析人士撰文对刷脸支付的几点担忧。由于人脸的暴露性、被动性(不能够主动发起交易)和非接触性(不需要和设备直接接触),怎么界定是顾客主动支付的,还是被动的。

过去,刷卡、扫码普遍有输入密码的过程,指纹至少也有去主动验证指纹的动作,这些行为都是客户交易意愿的诠释。

而刷脸支付则使这些主动行为无从放置,后果就是客户有可能在不具有交易意愿的情况下“无感”支付而蒙受损失。

2.6 技术专家点评

新昕科技的CTO刘光昕则认为:

- 刷脸支付并不安全,人脸作为公开的信息,拿人脸作为答案去验证的机制存在巨大问题,移动互联网时代不仅个人图片、甚至动态的视频在朋友圈分享, 如何保护我们的人脸是个巨大的问题。

- 指纹识别相对安全, 指纹被分享的可能性比较小, 但目前也存在被各中App恶意采集的可能。

- 短信验证则更安全, 由于短信验证码具有一次一码,所以短信验证还是作为支付、用户注册环节中的重要手段。

但短信验证本身也存在被盗刷的风险 , 所以出现了各种烦人的图片验证码及滑动、点按之类的多余操作。 新昕科技则研发了独特的全无感短信防火墙,在无图形验证码的前提下, 确保短信验证码的安全 。

相关阅读

用照片做成动态图能从苹果手机盗走微信支付宝里的钱?

支付宝风险控制怎么做到的 ?

支付宝风控揭秘-2-在线支付及风险防范实务

黑客想要转走你支付宝里的钱会怎样? AlphaRisk 如何对抗 ?

揭秘支付宝风控-1-复合事件处理