Hadoop入门——虚拟机集群搭建

一、Hadoop介绍

Hadoop是什么?

- Hadoop是一个由Apache基金会所开发的分布式系统基础架构

- 主要解决海量数据的存储和海量数据的分析计算问题

- 广义上来说,Hadoop通常是指一个更广泛的概念------Hadoop生态圈

Hadoop三大发行版本

-

Hadoop三大发行版本:Apache、Cloudera、Hortonworks

-

Apache Hadoop

Apache版本最原始(最基础)的版本,对于入门学习最好。

官网地址:http://hadoop.apache.org/releases.html

下载地址:https://archive.apache.org/dist/hadoop/common/>

-

Cloudera Hadoop

Cloudera内部集成了很多大数据框架。对应产品CDH。

官网地址:https://www.cloudera.com/downloads/cdh/5-10-0.html

下载地址:http://archive-primary.cloudera.com/cdh5/cdh/5/

-

Hortonworks Hadoop

Hortonworks文档较好。对应产品HDP。

官网地址:https://hortonworks.com/products/data-center/hdp/

下载地址:https://hortonworks.com/downloads/#data-platform

Hadoop的优势(四高)

- 高可靠性:Hadoop底层维护多个数据副本,所以即使Hadoop某个计算元素或存储出现故障,也不会导致数据的丢失。

- 高扩展性:在集群间分配任务数据,可方便地扩展数以千计的节点。

- 高效性:在MapReduce的思想下,Hadoop是并行工作的,以加快任务处理速度。

- 高容错性:能够自动将失败的任务重新分配。

Hadoop组成

- Hadoop1.x组成:MapReduce(计算+资源调度)、HDFS(数据存储)、Common(辅助工具)

- Hadoop2.x组成:MapReduce(计算)、Yarn(资源调度)、HDFS(数据存储)、Common(辅助工具)

在Hadoop2.x时代,MapReduce只负责计算,Yarn只负责资源调度。解耦后虽然计算效率有所降低,但是故障率降低,且可调度其他计算框架的资源。

HDFS架构的概述

-

NameNode(nn):存储文件的元数据,如文件名,文件目录结构,文件属性(生成时间、副本数、文件权限),以及每个文件的块列表和块所在的DataNode等。

可将此理解为目录

-

DataNode(dn):在本地文件系统存储文件块数据,以及块数据的校验和。

可将此理解为数据

-

Secondary NameNode(2nn):每隔一段时间对NameNode元数据备份

如果NameNode挂了,2nn并不能切换成NameNode。

**可理解为助手**Y

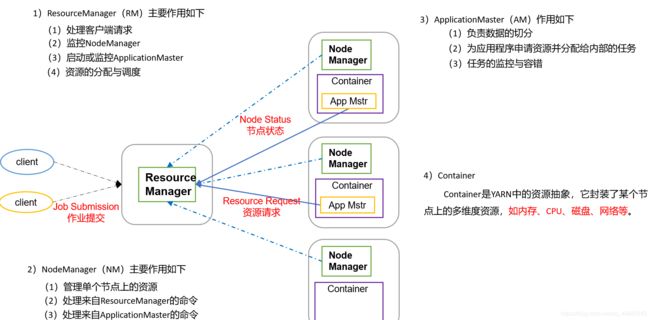

YARN架构概述

所有YARN资源的分配都是通过Container(容器)的形式分配的

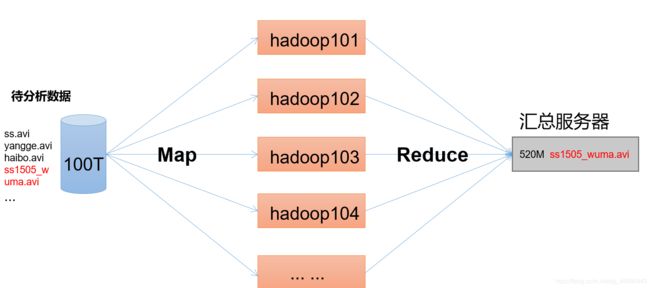

MapReduce架构概述

MapReduce将计算过程分为两个阶段:Map和Reduce

-

Map阶段并行处理输入数据

-

Reduce阶段对Map结果进行汇总

大数据技术生态体系

图中涉及的技术名词解释如下:

-

Sqoop:Sqoop是一款开源的工具,主要用于在Hadoop、Hive与传统的数据库(MySql)间进行数据的传递,可以将一个关系型数据库(例如 :MySQL,Oracle 等)中的数据导进到Hadoop的HDFS中,也可以将HDFS的数据导进到关系型数据库中。

-

Flume:Flume是一个高可用的,高可靠的,分布式的海量日志采集、聚合和传输的系统,Flume支持在日志系统中定制各类数据发送方,用于收集数据;

-

Kafka:Kafka是一种高吞吐量的分布式发布订阅消息系统;

-

Spark:Spark是当前最流行的开源大数据内存计算框架。可以基于Hadoop上存储的大数据进行计算。

-

Flink:Flink是当前最流行的开源大数据内存计算框架。用于实时计算的场景较多。

-

Oozie:Oozie是一个管理Hdoop作业(job)的工作流程调度管理系统。

-

Hbase:HBase是一个分布式的、面向列的开源数据库。HBase不同于一般的关系数据库,它是一个适合于非结构化数据存储的数据库。

-

Hive:Hive是基于Hadoop的一个数据仓库工具,可以将结构化的数据文件映射为一张数据库表,并提供简单的SQL查询功能,可以将SQL语句转换为MapReduce任务进行运行。 其优点是学习成本低,可以通过类SQL语句快速实现简单的MapReduce统计,不必开发专门的MapReduce应用,十分适合数据仓库的统计分析。

-

ZooKeeper:它是一个针对大型分布式系统的可靠协调系统,提供的功能包括:配置维护、名字服务、分布式同步、组服务等。

二、Hadoop运行环境的搭建(开发重点)

注:本文linux系统环境全部以CentOS-7.5-x86-1804为例说明

模板机器内存为4G,硬盘50G,使用最小安装

1.模板虚拟机环境准备

-

测试虚拟机是否可以正常上网

ping www.baidu.com

-

获取yum源

[root@hadoop100 ~]# yum install -y epel-release

[root@hadoop100 ~]# yum install -y psmisc nc net-tools rsync vim lrzsz ntp libzstd openssl-static tree iotop git

-

关闭防火墙,关闭防火墙开机自启

[root@hadoop100 ~]# systemctl stop firewalld

[root@hadoop100 ~]# systemctl disable firewalld

-

创建一个admin用户,并修改admin用户的密码

[root@hadoop100 ~]# useradd admin

[root@hadoop100 ~]# passwd admin

-

配置admin用户具有root权限,方便后期加sudo执行root权限的命令

[root@hadoop100 ~]# vim /etc/sudoers

修改/etc/sudoers文件,找到下面一行(91行),在root下面添加一行,如下所示:

## Allow root to run any commands anywhere

root ALL=(ALL) ALL

admin ALL=(ALL) NOPASSWD:ALL

-

在/opt目录下创建module、software文件夹

[root@hadoop100 ~]# mkdir /opt/module (module用来存放被解压的软件包)

[root@hadoop100 ~]# mkdir /opt/software (software用来存放软件解压包)

-

修改module、software文件夹的所有者和所属组均为admin用户

[root@hadoop100 ~]# chown admin:admin /opt/module

[root@hadoop100 ~]# chown admin:admin /opt/software

-

修改网络配置文件

[root@hadoop100 ~]# vim /etc/sysconfig/network-scripts/ifcfg-ens33

- 修改主机名

[root@hadoop100 ~]# vim /etc/hostname

修改完成后需要重启才能显示新的主机名

-

因为使用的是最小安装,故无需卸载虚拟机自带的 open JDK,若要删除,进行如下操作

[root@hadoop100 ~]# rpm -qa | grep -i java | xargs -n1 rpm -e --nodeps

-

修改linux克隆机主机名称映射hosts文件

[root@hadoop100 ~]# vim /etc/hosts

添加下列内容,注意IP地址中的网段保持一致,至少保证四台机器。

192.168.220.100 hadoop100 192.168.220.101 hadoop101 192.168.220.102 hadoop102 192.168.220.103 hadoop103 192.168.220.104 hadoop104 192.168.220.105 hadoop105 192.168.220.106 hadoop106 192.168.220.107 hadoop107 192.168.220.108 hadoop108 -

修改windows的主机名称映射hosts文件

进入C:\Windows\System32\drivers\etc路径,打开hosts文件添加如下内容

192.168.220.100 hadoop100 192.168.220.101 hadoop101 192.168.220.102 hadoop102 192.168.220.103 hadoop103 192.168.220.104 hadoop104 192.168.220.105 hadoop105 192.168.220.106 hadoop106 192.168.220.107 hadoop107 192.168.220.108 hadoop108到这一步我们的模板机就算是大功告成了。

2.克隆虚拟机

- 利用模板机hadoop100,克隆三台虚拟机:hadoop102 hadoop103 hadoop104(进行克隆操作时,务必将模板机关机,以防克隆出来的模板机出现内容缺失)

- 修改克隆机IP与其主机名

- 圈起来的数字是需要修改的地方,若机器取名为hadoop103,则将其改为103,若机器取名为hadoop104,则改为104。

- 之后将主机名修改即可。

3.在hadoop102上安装JDK与Hadoop

以下为JDK下载官网

https://www.oracle.com/java/technologies/javase/javase-jdk8-downloads.html

以下为Hadoop下载官网

https://hadoop.apache.org/releases.html

此处我们以JDK1.8与Hadoop3.1.3为例

- 在远程工具FinalShell上上传JDK与Hadoop的压缩包

-

在Linux系统下的opt目录下查看软件包是否导入成功

[admin@hadoop102 ~]$ ls /opt/software/

看到如下结果即为成功:

hadoop-3.1.3.tar.gz jdk-8u212-linux-x64.tar.gz

-

解压JDK与Hadoop到/opt/module目录下

[admin@hadoop102 software]$ tar -zxvf jdk-8u212-linux-x64.tar.gz -C /opt/module/

[admin@hadoop102 software]$ tar -zxvf hadoop-3.1.3.tar.gz -C /opt/module/

-

配置JDK与Hadoop环境变量

- 新建/etc/profile.d/my_env.sh文件

[admin@hadoop102 ~]$ sudo vim /etc/profile.d/my_env.sh

- 添加如下内容

#JAVA_HOME

export JAVA_HOME=/opt/module/jdk1.8.0_212

export PATH=$PATH:$JAVA_HOME/bin

#HADOOP_HOME

export HADOOP_HOME=/opt/module/hadoop-3.1.3

export PATH=$PATH:$HADOOP_HOME/bin

export PATH=$PATH:$HADOOP_HOME/sbin

- 保存退出,然后source一下/etc/profile文件,让新的环境变量PATH生效

[admin@hadoop102 ~]$ source /etc/profile

-

测试JDK与Hadoop是否安装成功

[admin@hadoop102 ~]$ java -version

[admin@hadoop102 hadoop-3.1.3]$ hadoop version

4.Hadoop的目录结构

-

查看Hadoop目录结构

[admin@hadoop102 hadoop-3.1.3]$ ll 总用量 52 drwxr-xr-x. 2 admin admin 4096 9月 3 2020 bin drwxr-xr-x. 3 admin admin 4096 9月 3 2020 etc drwxr-xr-x. 2 admin admin 4096 9月 3 2020 include drwxr-xr-x. 3 admin admin 4096 9月 3 2020 lib drwxr-xr-x. 2 admin admin 4096 9月 3 2020 libexec -rw-r--r--. 1 admin admin 15429 9月 3 2020 LICENSE.txt -rw-r--r--. 1 admin admin 101 9月 3 2020 NOTICE.txt -rw-r--r--. 1 admin admin 1366 9月 3 2020 README.txt drwxr-xr-x. 2 admin admin 4096 9月 3 2020 sbin drwxr-xr-x. 4 admin admin 4096 9月 3 2020 share -

重要目录

- bin目录:存放对Hadoop相关服务(HDFS,YARN)进行操作的脚本

- etc目录:Hadoop的配置文件目录,存放Hadoop的配置文件

- lib目录:存放Hadoop的本地库(对数据进行压缩解压缩功能)

- sbin目录:存放启动或停止Hadoop相关服务的脚本

- share目录:存放Hadoop的依赖jar包、文档、和官方案例

三、Hadoop运行模式

1.本地运行模式(官方wordcount)

-

在hadoop-3.1.3文件下面创建一个wcinput文件夹

[admin@hadoop102 hadoop-3.1.3]$ mkdir wcinput

-

在wcinput文件下创建一个word.txt文件

[admin@hadoop102 hadoop-3.1.3]$ cd wcinput

[admin@hadoop102 wcinput]$ vim word.txt

- 在文件中输入如下内容

hadoop yarn hadoop mapreduce admin admin -

回到Hadoop目录/opt/module/hadoop-3.1.3

-

执行程序

[admin@hadoop102 hadoop-3.1.3]$ hadoop jar share/hadoop/mapreduce/hadoop-mapreduce-examples-3.1.3.jar wordcount wcinput wcoutput

-

查看结果

[admin@hadoop102 hadoop-3.1.3]$ cat wcoutput/part-r-00000

看到如下结果:

admin 2 hadoop 2 mapreduce 1 yarn 1

2.完全分布式运行环境(开发重点)

- 准备好三台客户机

- 关闭防火墙、静态ip、主机名称

- 安装JDK,安装Hadoop

- 配置环境变量

- 配置集群

- 单点启动

- 配置ssh

- 群起并测试集群

在写xsync脚本前,我们先了解一下scp(secure copy)与rsync远程同步工具

-

scp可以实现服务器与服务器之间的数据拷贝

scp -r $pdir/$fname $user@hadoop$host:$pdir/$fname

命令 递归 要拷贝的文件路径/名称 目的用户@主机:目的路径/名称

-

rsync远程同步工具

rsync -av $pdir/$fname $user@hadoop$host:$pdir/$fname

命令 选项参数 要拷贝的文件路径/名称 目的用户@主机:目的路径/名称

- rsync主要用于备份和镜像。具有速度快、避免复制相同内容和支持符号链接的优点。

-

rsync和scp区别

- 用rsync做文件的复制要比scp的速度快,rsync只对差异文件做更新。scp是把所有文件都复制过去。

2.1编写集群分发脚本xsync

因为我们只配置好了hadoop102的JDK与Hadoop,还没有配置好其他两台虚拟机的。又因为不愿意重复操作,故编写此分发脚本。

-

需求:循环复制文件到所有节点的相同目录下

-

期望脚本:xsync 要同步的文件名称

-

在/home/atguigu/bin目录下创建xsync文件

[admin@hadoop102 ~]$ mkdir bin

[admin@hadoop102 ~]$ cd bin

[admin@hadoop102 bin]$ vim xsync

- 在该文件中编写如下代码

#!/bin/bash #1. 判断参数个数 if [ $# -lt 1 ] then echo Not Enough Arguement! exit; fi #2. 遍历集群所有机器 for host in hadoop102 hadoop103 hadoop104 do echo ==================== $host ==================== #3. 遍历所有目录,挨个发送 for file in $@ do #4. 判断文件是否存在 if [ -e $file ] then #5. 获取父目录 pdir=$(cd -P $(dirname $file); pwd) #6. 获取当前文件的名称 fname=$(basename $file) ssh $host "mkdir -p $pdir" rsync -av $pdir/$fname $host:$pdir else echo $file does not exists! fi done done -

修改脚本 xsync 具有执行权限

[admin@hadoop102 bin]$ chmod +x xsync

-

将脚本复制到/bin中,以便全局调用

[admin@hadoop102 bin]$ sudo cp xsync /bin/

-

测试脚本

[admin@hadoop102 ~]$ xsync /home/atguigu/bin

[admin@hadoop102 bin]$ sudo xsync /bin/xsync

2.2 SSH无密登录配置

-

免密登录原理

-

生成公钥和私钥:

[admin@hadoop102 .ssh]$ ssh-keygen -t rsa

然后敲(三个回车),就会生成两个文件id_rsa(私钥)、id_rsa.pub(公钥)

-

将公钥拷贝到要免密登录的目标机器上

[admin@hadoop102 .ssh]$ ssh-copy-id hadoop102

- 此处我只拷贝到hadoop102上,然后通过群发脚本发给其他两个虚拟机

-

通过分发脚本xsync给hadoop103、hadoop104发放公钥和私钥以及授权公钥

[admin@hadoop102 .ssh]$ xsync .ssh

-

.ssh文件夹下(~/.ssh)的文件功能解释

known_hosts 记录ssh访问过计算机的公钥(public key) id_rsa 生成的私钥 id_rsa.pub 生成的公钥 authorized_keys 存放授权过的无密登录服务器公钥

2.3集群配置

-

集群部署规划

因为我电脑运行内存有限,便按照下列部署

-

NameNode和SecondaryNameNode不要安装在同一台服务器

-

ResourceManager也很消耗内存,不要和NameNode、SecondaryNameNode配置在同一台机器上

hadoop102 hadoop103 hadoop104 HDFS NameNode DataNode DataNode SecondaryNameNode DataNode YARN NodeManager ResourceManager NodeManager NodeManager

-

-

配置文件说明

Hadoop配置文件分两类:默认配置文件和自定义配置文件,只有用户想修改某一默认配置值时,才需要修改自定义配置文件,更改相应属性值。

-

默认配置文件:

要获取的默认文件 文件存放在Hadoop的jar包中的位置 [core-default.xml] hadoop-common-3.1.3.jar/ core-default.xml [hdfs-default.xml] hadoop-hdfs-3.1.3.jar/ hdfs-default.xml [yarn-default.xml] hadoop-yarn-common-3.1.3.jar/ yarn-default.xml [mapred-default.xml] hadoop-mapreduce-client-core-3.1.3.jar/ mapred-default.xml -

自定义配置文件:**core-site.xml、hdfs-site.xml、yarn-site.xml、mapred-site.xml**四个配置文件存放在$HADOOP_HOME/etc/hadoop这个路径上,用户可以根据项目需求重新进行修改配置。

-

-

配置集群

-

核心配置文件core-site.xml

[admin@hadoop102 ~]$ cd $HADOOP_HOME/etc/hadoop

[admin@hadoop102 hadoop]$ vim core-site.xml

文件内容如下:

<?xml version="1.0" encoding="UTF-8"?> <?xml-stylesheet type="text/xsl" href="configuration.xsl"?> <configuration> <!-- 指定NameNode的地址 --> <property> <name>fs.defaultFS</name> <value>hdfs://hadoop102:9820</value> </property> <!-- 指定hadoop数据的存储目录 --> <property> <name>hadoop.tmp.dir</name> <value>/opt/module/hadoop-3.1.3/data</value> </property> <!-- 配置HDFS网页登录使用的静态用户为atguigu --> <property> <name>hadoop.http.staticuser.user</name> <value>admin</value> </property> <!-- 配置该admin(superUser)允许通过代理访问的主机节点 --> <property> <name>hadoop.proxyuser.admin.hosts</name> <value>*</value> </property> <!-- 配置该admin(superUser)允许通过代理用户所属组 --> <property> <name>hadoop.proxyuser.admin.groups</name> <value>*</value> </property> <!-- 配置该admin(superUser)允许通过代理的用户--> <property> <name>hadoop.proxyuser.admin.groups</name> <value>*</value> </property> </configuration> -

HDFS配置文件hdfs-site.xml

[admin@hadoop102 hadoop]$ vim hdfs-site.xml

文件内容如下:

<?xml version="1.0" encoding="UTF-8"?> <?xml-stylesheet type="text/xsl" href="configuration.xsl"?> <configuration> <!-- nn web端访问地址--> <property> <name>dfs.namenode.http-address</name> <value>hadoop102:9870</value> </property> <!-- 2nn web端访问地址--> <property> <name>dfs.namenode.secondary.http-address</name> <value>hadoop104:9868</value> </property> </configuration> -

YARN配置文件yarn-site.xml

[admin@hadoop102 hadoop]$ vim yarn-site.xml

文件内容如下:

<?xml version="1.0" encoding="UTF-8"?> <?xml-stylesheet type="text/xsl" href="configuration.xsl"?> <configuration> <!-- 指定MR走shuffle --> <property> <name>yarn.nodemanager.aux-services</name> <value>mapreduce_shuffle</value> </property> <!-- 指定ResourceManager的地址--> <property> <name>yarn.resourcemanager.hostname</name> <value>hadoop103</value> </property> <!-- 环境变量的继承 --> <property> <name>yarn.nodemanager.env-whitelist</name> <value>JAVA_HOME,HADOOP_COMMON_HOME,HADOOP_HDFS_HOME,HADOOP_CONF_DIR,CLASSPATH_PREPEND_DISTCACHE,HADOOP_YARN_HOME,HADOOP_MAPRED_HOME</value> </property> <!-- yarn容器允许分配的最大最小内存 --> <property> <name>yarn.scheduler.minimum-allocation-mb</name> <value>512</value> </property> <property> <name>yarn.scheduler.maximum-allocation-mb</name> <value>4096</value> </property> <!-- yarn容器允许管理的物理内存大小 --> <property> <name>yarn.nodemanager.resource.memory-mb</name> <value>4096</value> </property> <!-- 关闭yarn对物理内存和虚拟内存的限制检查 --> <property> <name>yarn.nodemanager.pmem-check-enabled</name> <value>false</value> </property> <property> <name>yarn.nodemanager.vmem-check-enabled</name> <value>false</value> </property> </configuration> -

MapReduce配置文件mapred-site.xml

[admin@hadoop102 hadoop]$ vim mapred-site.xml

<?xml version="1.0" encoding="UTF-8"?> <?xml-stylesheet type="text/xsl" href="configuration.xsl"?> <configuration> <!-- 指定MapReduce程序运行在Yarn上 --> <property> <name>mapreduce.framework.name</name> <value>yarn</value> </property> </configuration>

-

-

在集群上分发配置好的Hadoop配置文件

[admin@hadoop102 hadoop]$ xsync /opt/module/hadoop-3.1.3/etc/hadoop/

- 查看hadoop103和hadoop104上查看文件分发情况

[admin@hadoop103 ~]$ cat /opt/module/hadoop-3.1.3/etc/hadoop/

[admin@hadoop102 hadoop]$ ll

[admin@hadoop104 ~]$ cat /opt/module/hadoop-3.1.3/etc/hadoop/

[admin@hadoop102 hadoop]$ ll

2.4群起集群

-

配置workers

[admin@hadoop102 hadoop]$ vim /opt/module/hadoop-3.1.3/etc/hadoop/workers

在该文件中增加如下内容:

hadoop102 hadoop103 hadoop104注意:该文件中添加的内容结尾不允许有空格,文件中不允许有空行。

同步所有节点配置文件:

[admin@hadoop102 hadoop]$ xsync /opt/module/hadoop-3.1.3/etc

-

启动集群

-

如果集群是第一次启动,需要在hadoop102节点格式化NameNode(注意:格式化NameNode,会产生新的集群id,导致NameNode和DataNode的集群id不一致,集群找不到已往数据。如果集群在运行过程中报错,需要重新格式化NameNode的话,一定要先停止namenode和datanode进程,并且要删除所有机器的data和logs目录,然后再进行格式化。)

[admin@hadoop102 ~]$ hdfs namenode -format

-

在配置了NameNode节点(hadoop102)启动HDFS

[admin@hadoop102 hadoop-3.1.3]$ sbin/start-dfs.sh

-

在配置了ResourceManager的节点(hadoop103)启动YARN

[admin@hadoop103 hadoop-3.1.3]$ sbin/start-yarn.sh

-

Web端查看HDFS的NameNode

浏览器中输入:http://hadoop102:9870

查看HDFS上存储的数据信息

-

Web端查看YARN的ResourceManager

浏览器中输入:http://hadoop103:8088

-

查看YARN上运行的Job信息

-

各个服务组件逐一启动/停止

-

分别启动/停止HDFS组件

hdfs --daemon start/stop namenode/datanode/secondarynamenode

-

启动/停止YARN

yarn --daemon start/stop resourcemanager/nodemanager

-

2.5配置历史服务器

为了查看程序的历史运行情况,需要配置一下历史服务器。具体配置步骤如下:

-

配置mapred-site.xml

[admin@hadoop102 hadoop]$ vim mapred-site.xml

在该文件中增加如下配置:

<!-- 历史服务器端地址 --> <property> <name>mapreduce.jobhistory.address</name> <value>hadoop102:10020</value> </property> <!-- 历史服务器web端地址 --> <property> <name>mapreduce.jobhistory.webapp.address</name> <value>hadoop102:19888</value> </property> -

分发配置

[admin@hadoop102 hadoop]$ xsync $HADOOP_HOME/etc/hadoop/mapred-site.xml

-

在hadoop102启动历史服务器

[admin@hadoop102 hadoop]$ mapred --daemon start historyserver

-

查看JobHistory

http://hadoop102:19888/jobhistory

2.6配置日志的聚集

日志聚集概念:应用运行完成以后,将程序运行日志信息上传到HDFS系统上。

日志聚集功能好处:可以方便的查看到程序运行详情,方便开发调试。

注意:开启日志聚集功能,需要重新启动NodeManager 、ResourceManager和HistoryServer。

开启日志聚集功能具体步骤如下:

-

配置yarn-site.xml

[admin@hadoop102 hadoop]$ vim yarn-site.xml

在该文件里面增加如下配置:

<!-- 开启日志聚集功能 --> <property> <name>yarn.log-aggregation-enable</name> <value>true</value> </property> <!-- 设置日志聚集服务器地址 --> <property> <name>yarn.log.server.url</name> <value>http://hadoop102:19888/jobhistory/logs</value> </property> <!-- 设置日志保留时间为7天 --> <property> <name>yarn.log-aggregation.retain-seconds</name> <value>604800</value> </property> -

分发配置

[admin@hadoop102 hadoop]$ xsync $HADOOP_HOME/etc/hadoop/yarn-site.xml

-

查看日志

http://hadoop102:19888/jobhistory

四、编写hadoop集群的常用脚本(jpsall、myhadoop.sh)

- 查看三台服务器java进程脚本:jpsall

[admin@hadoop102 ~]$ cd /home/admin/bin

[admin@hadoop102 ~]$ vim jpsall

输入下面内容:

#!/bin/bash

for host in hadoop102 hadoop103 hadoop104

do

echo =============== $host ===============

ssh $host jps $@ | grep -v Jps

done

赋予脚本执行权限

[admin@hadoop102 bin]$ chmod +x jpsall

- hadoop集群启停脚本(包含hdfs,yarn,historyserver):myhadoop.sh

[admin@hadoop102 ~]$ cd /home/atguigu/bin

[admin@hadoop102 ~]$ vim myhadoop.sh

输入下面内容:

#!/bin/bash

if [ $# -lt 1 ]

then

echo "No Args Input..."

exit ;

fi

case $1 in

"start")

echo " =================== 启动 hadoop集群 ==================="

echo " --------------- 启动 hdfs ---------------"

ssh hadoop102 "/opt/module/hadoop-3.1.3/sbin/start-dfs.sh"

echo " --------------- 启动 yarn ---------------"

ssh hadoop103 "/opt/module/hadoop-3.1.3/sbin/start-yarn.sh"

echo " --------------- 启动 historyserver ---------------"

ssh hadoop102 "/opt/module/hadoop-3.1.3/bin/mapred --daemon start historyserver"

;;

"stop")

echo " =================== 关闭 hadoop集群 ==================="

echo " --------------- 关闭 historyserver ---------------"

ssh hadoop102 "/opt/module/hadoop-3.1.3/bin/mapred --daemon stop historyserver"

echo " --------------- 关闭 yarn ---------------"

ssh hadoop103 "/opt/module/hadoop-3.1.3/sbin/stop-yarn.sh"

echo " --------------- 关闭 hdfs ---------------"

ssh hadoop102 "/opt/module/hadoop-3.1.3/sbin/stop-dfs.sh"

;;

*)

echo "Input Args Error..."

;;

esac

赋予脚本执行权限

[admin@hadoop102 bin]$ chmod +x myhadoop.sh

-

分发/home/atguigu/bin目录,保证自定义脚本在三台机器上都可以使用

[admin@hadoop102 ~]$ xsync /home/atguigu/bin/

到这里为止,我们的集群就搭建完毕了,下面接着就是HDFS的具体介绍了!!!