新建虚拟机Ubuntu并安装Hadoop步骤

新建虚拟机Ubuntu并安装Hadoop步骤

(初学Hadoop可能会要多次重新安装虚拟机,所有写下来方便自己)

新建虚拟机,自定义安装,双处理机双内核,如果经常使用,尽可能给多的磁盘空间

软件包software update立即同意更新

默认为英文版,修改系统时间:

1.查看当前时间状态

查看当前时间状态 timedatectl status:

2.修改时区

所有的时区名称存储在/usr/share/zoneinfo文件中。

执行命令timedatectl set-timezone "Asia/Shanghai"就可以将时区设为上海时区。

修改完成~

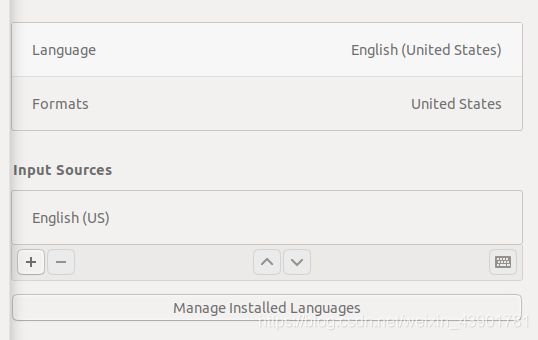

修改系统语言为中文:

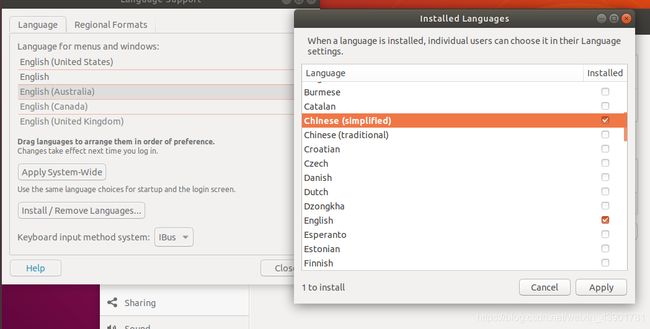

点击Manage Install Language

点击Install language 选择Chinese简体

下载完语言包后重启

之后系统语言就改为中文了~

更新apt: sudo apt-get update

下载vim: sudo apt-get install vim

安装ssh:

Ubuntu 默认已安装了 SSH client,此外还需要安装 SSH server:

sudo apt-get install openssh-server

安装后,可以使用如下命令登陆本机:ssh localhost

但每次登录都需要输入密码,所以接下来设置为无密码登录:

退出刚才登录的ssh

$ exit

$ cd ~/.ssh/

$ ssh-keygen -t rsa

$ cat ./id_rsa.pub >> ./authorized_keys

完成后便可以输入 ssh localhost 直接无密码登录。

安装jdk:

JDK1.8的安装包jdk-8u162-linux-x64.tar.gz放在了百度云盘,JDK安装包百度云盘网址,(提取码:6kmf)。请把压缩格式的文件jdk-8u162-linux-x64.tar.gz下载到虚拟机中,

1.cd /usr/lib

2.sudo mkdir jvm #创建/usr/lib/jvm目录用来存放JDK文件

3.cd ~ #进入hadoop用户的主目录

4.cd Downloads #注意区分大小写字母,刚才已经通过FTP软件把JDK安装包jdk-8u162-linux-x64.tar.gz上传到该目录下

5.sudo tar -zxvf ./jdk-8u162-linux-x64.tar.gz -C /usr/lib/jvm #把JDK文件解压到/usr/lib/jvm目录下

下面继续执行如下命令,设置环境变量:

1.cd ~

2.vim ~/.bashrc

上面命令使用vim编辑器,打开了hadoop这个用户的环境变量配置文件,请在这个文件的开头位置,添加如下几行内容:

export JAVA_HOME=/usr/lib/jvm/jdk1.8.0_162

export JRE_HOME=${

JAVA_HOME}/jre

export CLASSPATH=.:${

JAVA_HOME}/lib:${

JRE_HOME}/lib

export PATH=${

JAVA_HOME}/bin:$PATH

保存.bashrc文件并退出vim编辑器。然后,继续执行如下命令让.bashrc文件的配置立即生效:

source ~/.bashrc (Shell 命令)

这时,可以使用如下命令查看是否安装成功:

java -version

安装hadoop:

Hadoop 3 可以通过 http://mirror.bit.edu.cn/apache/hadoop/common/ 或者 http://mirrors.cnnic.cn/apache/hadoop/common/ 下载,一般选择下载最新的稳定版本,即下载 “stable” 下的 hadoop-3.x.y.tar.gz 这个格式的文件,这是编译好的,另一个包含 src 的则是 Hadoop 源代码,需要进行编译才可使用。

我们选择将 Hadoop 安装至 /usr/local/ 中:

1.sudo tar -zxf ~/下载/hadoop-3.2.1.tar.gz -C /usr/local # 解压到/usr/local中

2.cd /usr/local/

3.sudo mv ./hadoop-3.2.1/ ./hadoop # 将文件夹名改为hadoop

4.sudo chown -R hadoop ./hadoop # 修改文件权限

Hadoop 解压后即可使用。输入如下命令来检查 Hadoop 是否可用,成功则会显示 Hadoop 版本信息:

1.cd /usr/local/hadoop

2../bin/hadoop version

修改配置文件:

执行命令: gedit ./etc/hadoop/core-site.xml

1.<configuration>

2.<property>

3.<name>hadoop.tmp.dir</name>

4.<value>file:/usr/local/hadoop/tmp</value>

5.<description>Abase for other temporary directories.</description>

6.</property>

7.<property>

8.<name>fs.defaultFS</name>

9.<value>hdfs://localhost:9000</value>

10.</property>

11.</configuration>

执行命令: gedit ./etc/hadoop/hdfs-site.xml

1.<configuration>

2.<property>

3.<name>dfs.replication</name>

4.<value>1</value>

5.</property>

6.<property>

7.<name>dfs.namenode.name.dir</name>

8.<value>file:/usr/local/hadoop/tmp/dfs/name</value>

9.</property>

10.<property>

11.<name>dfs.datanode.data.dir</name>

12.<value>file:/usr/local/hadoop/tmp/dfs/data</value>

13.</property>

14.</configuration>

配置完成后,执行 NameNode 的格式化:

执行命令:./bin/hdfs namenode -format

这样hadoop就大致完成安装了

在Hadoop文件下执行启动命令: ./sbin/start-dfs sh

通过命令jps判断是否启动成功,如果成功则有四个输出:jps、SecondaryNameNode、NameNode、DataNode

关闭hadoop命令: ./sbin/stop-dfs.sh

这之中有些命令是在~目录下执行,有些是在/usr/local/hadoop目录下执行,请自行判断!

(其中很多内容取自林子雨老师的Hadoop安装教程:http://dblab.xmu.edu.cn/blog/install-hadoop/ 侵删)