slam特征点深度 svd_ICRA 2020 中的SLAM论文汇总(一)VSLAM

点击上方“计算机视觉life”,选择“星标”

快速获得最新干货

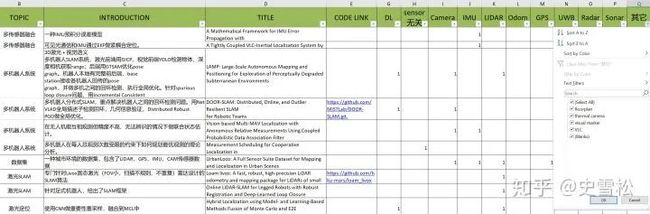

趁着 ICRA20 还没结束(在线论文集开放到8月底),我和高仙机器人的赵敏同学人肉扫描了一遍 SLAM 和 Localization 主题下的所有论文,每篇文章写了一点摘要,大致做了归类,希望能帮各位节省一点时间。虽然摘要基本不含主观评价,但摘取的信息必然受个人口味影响,仅供参考。一共84篇,人肉整理,不保证没有遗漏。原文请自行检索,我俩不负责提供pdf。

本文是第一部分,包含比较典型的VSLAM工作(包括VIO)。激光SLAM、多传感器融合、多机器人和其它脑洞SLAM留给第二部分。第三部分是深度学习专题。

(一)视觉SLAM:特征点法,结构特征,特殊特征,直接法,稠密SLAM,理论分析

(二)各种SLAM:激光,多传感器融合,多机器人,全局概率定位,active SLAM

(三)深度学习:CNN提特征,语义SLAM,运动物体,位姿/深度回归,重定位

Taxonomy是很tricky的事情。一项工作可以按问题分类,也可以按方法分类,还可以按传感器分类。我们的总体哲学是看每篇文章本质上在研究什么,其贡献主要可供哪个研究领域的人参考。

例如∇SLAM这个工作,虽然全文都是讲dense SLAM里的算法,但他的思路是把SLAM系统做成可微,从而能在未来实现端到端训练,dense SLAM只是一个例子。所以我们把它归到深度学习大类,尽管文中并没有用到深度学习。

再比如DeepTIO,表面上看做的是热成像和IMU的传感器融合,但他的方法明显是如何训练CNN来回归位姿那一派,跟多传感器融合常用的花式滤波没半毛钱关系。

如果就是关心某类传感器,也没关系,回头我们把xls放出来,里面有标记每篇paper用到的传感器(不一定对),可以自行筛选。

数据集和评测类的工作,跟哪部分相关度最高就放哪里了。比如下面第一篇,主要面向视觉SLAM,所以就放这了。(唉,其实是个广告位,本文题图也来自OpenLORIS,做数据集不易,且用且珍惜)

数据集

Are We Ready for Service Robots? The OpenLORIS-Scene Datasets for Lifelong SLAM

OpenLORIS-Scene数据集包含来自5个真实场景的22条轨迹,以轮式机器人采集,包含RGBD/双目鱼眼/IMU/里程计/激光数据,同一场景的所有轨迹提供同一世界坐标系下的真值,用于评估SLAM算法在动态场景中长期工作的能力。

https://lifelong-robotic-vision.github.io/dataset/scene

特征点法

Towards Noise Resilient SLAM

针对ORB-SLAM2框架中depth噪声引起的问题,提出两种应对,一是对每个landmark维护一组3D观测,以其中心作为估计值,以其一致性判断landmark好坏。二是针对depth噪声特点设计自适应的虚拟相机位置来抑制噪声影响。这些方法不仅能提高RGBD/stereo特征点法SLAM的精度,还由于排除了outlier而减少计算量,提高运行速度。

Voxel Map for Visual SLAM

keyframe-based SLAM在tracking时一般用共视keyframe中的关键点与当前帧做匹配,这是一种heuristic,查到的关键点未必符合当前视野,也没考虑遮挡关系。本文提出用voxel hashing来索引特征点,对每个预测视角,用预先采样的点做raycast,在每根ray上查询最近的特征点。

keyframe还是存在的,用于BA。本文的hashing方法与keyframe同步更新,仅用于查找当前视野下的特征点。

Redesigning SLAM for Arbitrary Multi-Camera Systems

为了让SLAM能更好适应任意多相机系统(更少的参数),做了三个改进:1. 自适应初始化,计算任意两个相机frustum之间的overlap(通过采样)判断是否形成stereo,来决定采用双目初始化还是5点法。2. 基于熵自动选择keyframe,通过一帧图像带来的信息增量。3. (见上一篇)把特征点同步存储在voxel map中(用hash table),这样每帧做PnP的时候就可以在voxel map里索引特征点,比在keyframe中索引得全面。

Hybrid Camera Pose Estimation with Online Partitioning for SLAM

对ORB-SLAM的改进,在tracking阶段,使用重叠区域进行Local BA

Estimation with Fast Feature Selection in Robot Visual Navigation

使用随机采样方法选择具有更多信息的特征点,同时保证了特征点的质量和计算复杂度

Practical Persistence Reasoning in Visual SLAM

对半动态环境进行建模,第一次工程化的使用persistence filter,跟踪特征点的去留

结构特征

Linear RGB-D SLAM for Atlanta World

在Atlanta World假设下,设计了一种完全利用平面信息的基于滤波的SLAM算法。

Lidar-Monocular Visual Odometry using Point and Line Features

基于点和线特征的单目SLAM,用LIDAR数据做点/线深度提取和scale矫正。

GPO: Global Plane Optimization for Fast and Accurate Monocular SLAM Initialization

使用平面信息进行初始化。

StructVIO: Visual-Inertial Odometry With Structural Regularity of Man-Made Environments

基于点和线特征,利用了Atlanta World假设的VIO系统设计。

特殊视觉特征

Ultra-High-Accuracy Visual Marker for Indoor Precise Positioning

设计了一种新的视觉marker,做室内定位,精度可以达到10cm

Ground Texture Based Localization Using Compact Binary Descriptors

针对地面纹理,设计一种特征提取和匹配的方式用于定位和全局重定位

VIO

Inertial-Only Optimization for Visual-Inertial Initialization

提出一种成功率更高、scale估计更准的VIO初始化方法。V和I分别优化(VO所给轨迹误差对IMU来说可以忽略),IMU优化过程中考虑了噪声分布,是MAP估计。已开源 ORB_SLAM3

Uncertainty-Based Adaptive Sensor Fusion for Visual-Inertial Odometry under Various Motion Characteristics

针对IMU测量存在退化的场景,设计了一种方法在纯图像模式和两种VIO模式(只用gyro和gyro+accel)之间自适应切换,避免低信噪比的IMU测量影响定位精度。

Hierarchical Quadtree Feature Optical Flow Tracking Based Sparse Pose-Graph Visual-Inertial SLAM

基于VINS-Mono开发了SPVIS,前端提出hierarchical quadtree方法提高optical flow feature tracking的性能,大幅降低需要的feature数量。后端采用固定时长的sliding window做全局优化,窗口之外仅保留pose graph。整个系统效率很高,从而支持长期运行。

Stereo Visual Inertial Odometry with Online Baseline Calibration

在S-MSCKF中加入对stereo baseline的在线估计。

OpenVINS: A Research Platform for Visual-Inertial Estimation

提出了一个VIO的综合性框架,包含了几乎所有的VSLAM的内容,EKF\cali\benchmark\VIO等。

直接法和稠密SLAM

FlowNorm: A Learning-based Method for Increasing Convergence Range of Direct Alignment

直接法优化中,当初始估计不好时很容易陷入局部最优。本文提出一种像素加权优化方法,通过比对每个像素的梯度方向和(CNN估计得到的)光流方向的一致性得到权重。在以DSO和BA-Net为基准的试验中能有效提升效果,可以容许更多的跳帧。

Robust RGB-D Camera Tracking using Optimal Key-frame Selection

基于RGBD的dense SLAM系统设计。前端有一个frame-to-model的tracking线程,自适应融合纹理定位(DVO)和结构定位(ICP)的结果输出初始pose;还有一个frame-to-frame的回环检测线程,用SIFT特征匹配和BOW检索得到当前帧与历史帧的关联输出给后端。后端在所有frame形成的pose graph中寻找一个子集进行优化(先当作set covering问题,找到邻域可以覆盖全部节点的最小节点子集,再用BFS添加节点使子集连通)。在TUM上定位精度不错。

Camera Tracking in Lighting Adaptable Maps of Indoor Environments

构造lighting adaptable map,估计光源的位姿,同时做tracking。

SLAM理论

Analysis of minima for geodesic and chordal cost for a minimal 2D pose-graph SLAM problem

作者发现SE2下,使用角度的残差,会引入周期性的local optim

The Complex-Step Derivative Approximation on Matrix Lie Groups

一种新的李群微分方法

SLAM评测

Closed-Loop Benchmarking of Stereo Visual-Inertial SLAM Systems: Understanding the Impact of Drift and Latency on Tracking Accuracy

在仿真环境中考察基于SLAM位姿估计进行控制的路径跟踪误差,称为闭环评测,其中位姿的精度和latency都会有影响。实验评估了五种算法,ORB等高延迟算法虽在开环评测中位姿精度很高,但闭环评测效果很差,作者先前提出的提升了latency的GF算法表现最稳定。

点击文末阅读链接,跳转至作者的知乎(id:史雪松),欢迎关注,留言。

视频专辑:最新计算机视觉应用/论文/开源

专辑:计算机视觉方向简介

专辑:视觉SLAM入门

专辑:最新SLAM/三维视觉论文/开源

专辑:三维视觉/SLAM公开课

专辑:深度相机原理及应用

专辑:手机双摄头技术解析与应用

专辑:相机标定

专辑:全景相机

从0到1学习SLAM,戳↓

视觉SLAM图文+视频+答疑+学习路线全规划!

交流群

欢迎加入公众号读者群一起和同行交流,目前有SLAM、三维视觉、传感器、自动驾驶、计算摄影、检测、分割、识别、医学影像、GAN、算法竞赛等微信群(以后会逐渐细分),请扫描下面微信号加群,备注:”昵称+学校/公司+研究方向“,例如:”张三 + 上海交大 + 视觉SLAM“。请按照格式备注,否则不予通过。添加成功后会根据研究方向邀请进入相关微信群。请勿在群内发送广告,否则会请出群,谢谢理解~

投稿、合作也欢迎联系:[email protected]

长按关注计算机视觉life