前言

本文的文字及图片来源于网络,仅供学习、交流使用,不具有任何商业用途,如有问题请及时联系我们以作处理。

Python爬虫、数据分析、网站开发等案例教程视频免费在线观看

https://space.bilibili.com/523606542

前文内容

Python爬虫新手入门教学(一):爬取豆瓣电影排行信息

Python爬虫新手入门教学(二):爬取小说

Python爬虫新手入门教学(三):爬取链家二手房数据

Python爬虫新手入门教学(四):爬取前程无忧招聘信息

Python爬虫新手入门教学(五):爬取B站视频弹幕

Python爬虫新手入门教学(六):制作词云图

基本开发环境

- Python 3.6

- Pycharm

相关模块的使用

- jieba

- wordcloud

安装Python并添加到环境变量,pip安装需要的相关模块即可。

一、明确需求

选择 <欢乐喜剧人 第七季> 爬取网友发送的弹幕信息

二、分析网页数据

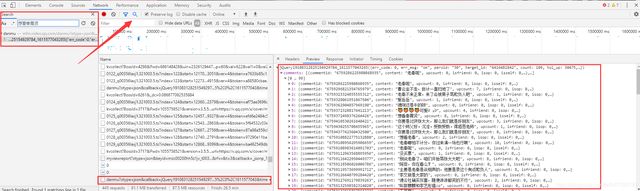

复制网页中的弹幕,再开发者工具里面进行搜索。

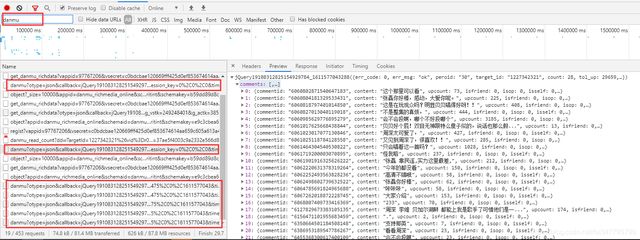

这里面就有对应的弹幕数据。这个url地址有一个小特点,链接包含着danmu 所以大胆尝试一下,过滤搜索一下 danmu 这个关键词,看一下是否有像类似的内容

通过链接的参数对比,可以看到每个url地址参数的变化

循环遍历就可以实现爬取整个视频的弹幕了。

三、解析数据

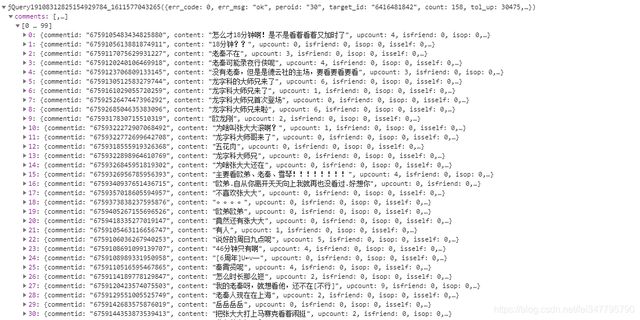

在这里想问一下,你觉得请求这个url地址给你返回的数据是什么样的数据?给大家三秒考虑时间。

1 …2…3…

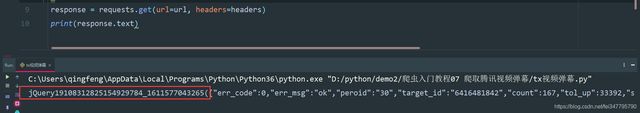

好的,现在公布答案了,它是一个 字符串 你没有听错。如果你直接获取 respons.json() 那你会出现报错

那如何才能让它编程json数据呢,毕竟json数据更好提取数据。

第一种方法

- 正则匹配提取中间的数据部分的数据

- 导入json模块,字符串转json数据

import requests

import re

import json

import pprint

url = 'https://mfm.video.qq.com/danmu?otype=json&callback=jQuery19108312825154929784_1611577043265&target_id=6416481842%26vid%3Dt0035rsjty9&session_key=30475%2C0%2C1611577043×tamp=105&_=1611577043296'

headers = {

'user-agent': 'Mozilla/5.0 (Windows NT 10.0; WOW64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/81.0.4044.138 Safari/537.36'

}

response = requests.get(url=url, headers=headers)

result = re.findall('jQuery19108312825154929784_1611577043265\((.*?)\)', response.text)[0]

json_data = json.loads(result)

pprint.pprint(json_data)

第二种方法

删除链接中的 callback=jQuery19108312825154929784_1611577043265 就可以直接使用 response.json()

import requests

import pprint

url = 'https://mfm.video.qq.com/danmu?otype=json&target_id=6416481842%26vid%3Dt0035rsjty9&session_key=30475%2C0%2C1611577043×tamp=105&_=1611577043296'

headers = {

'user-agent': 'Mozilla/5.0 (Windows NT 10.0; WOW64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/81.0.4044.138 Safari/537.36'

}

response = requests.get(url=url, headers=headers)

# result = re.findall('jQuery19108312825154929784_1611577043265\((.*?)\)', response.text)[0]

json_data = response.json()

pprint.pprint(json_data)

这样也可以,而且可以让代码更加简单。

小知识点:

pprint 是格式化输出模块,让类似json数据输出的效果更加好看

完整实现代码

import requests

for page in range(15, 150, 15):

url = 'https://mfm.video.qq.com/danmu'

params = {

'otype': 'json',

'target_id': '6416481842&vid=t0035rsjty9',

'session_key': '30475,0,1611577043',

'timestamp': page,

'_': '1611577043296',

}

headers = {

'user-agent': 'Mozilla/5.0 (Windows NT 10.0; WOW64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/81.0.4044.138 Safari/537.36'

}

response = requests.get(url=url, params=params, headers=headers)

json_data = response.json()

contents = json_data['comments']

for i in contents:

content = i['content']

with open('喜剧人弹幕.txt', mode='a', encoding='utf-8') as f:

f.write(content)

f.write('\n')

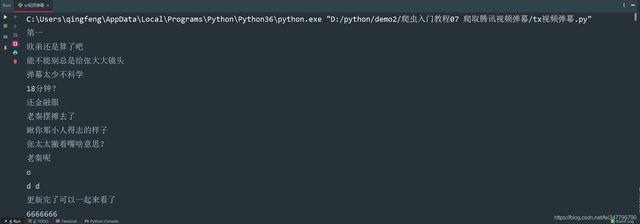

print(content)

代码还是比较简单的。没有什么特别的难度。