1-5 无监督学习

首先是一个鸡尾酒会的例子,在一个鸡尾酒会上,有两个人分别从不同的距离向两个位置不同的麦克风说话。

在第一批录音中,两个人同时对两台距离不同的麦克风从1到10用英语和另一种语言读数字

结果是,利用“鸡尾酒算法”算法可以将英语部分和外语部分的语音有效分开,并且形成单独增强的效果。

在第二批录音中,说话者开始单独说话,但是他们说话时背景会同时播放吵闹的音乐,以此观察算法对这样录音的处理效果。

出乎意料地,算法实现了将人和音乐的频段分开并增强。在分离人声时,还能依稀听到背景有一些音乐没有剔除干净,但是在分离音乐时可以非常漂亮地将人声祛除。

要设计这样算法其实非常复杂,但是现在能看见的简化代码仅仅只要一行

[W,s,v]=svd((repmat(sum(x.*x,1),size(x,1),1).*x)*x'); #奇异值分解

Andrew对工具的建议

注意,视频在11年,所以现在python用来实现算法第三方库比较方便了,以下建议比较过时

Andew Ng:在这门课中使用Octave编程环境,它是一个免费的开源环境,matlab和octave中实现代码只需要几行 在硅谷当中使用都是先用Octave开发出工程原型,然后在用其他语言移植,在Python中只会更复杂

在今天澄清这一点,会用matlab没有必要再去学octave,因为octave的语法和matlab大致相似,但是没有那么多的库和语法,而且据说Andrew本人已经改用了Python

课上给出的其他例子:

具有类似关键词的新闻分类、将你的客户进行市场分割都是无监督学习

自动给垃圾邮件贴上标签和利用训练集进行糖尿病的诊断是监督学习

2-1 线性回归

看到算法内核和算法部署的流程,回顾到回归模型是用来得到连续值的学习问题.

因为给出了正确答案,所以叫做监督学习,在监督学习当中有数据集,叫做训练集

训练集:正确的数据集叫做训练集

我们的任务就是从这个数据集当中学习如何预测房屋价格

现在给出符号定义

:训练案例数,也就是训练集的大小

:输入变量,特征

:输出变量,目标变量

用表示训练样本,用表示第i个样本,

监督学习流程

训练集将房价“喂食”feed到学习算法当中,输出一个函数,这个函数的功能就是:

再拿到新的房屋价格代进去能够求得一个全新的估计的价格

如何得到?

有时候假设函数省略掉的下标设成这样

以这样的假设函数的建构模型,这个模型就叫做单变量线性回归

2-2 代价函数

代价函数

在训练集当中我们会得到一定数量的样本,x表示卖出哪所房子,y代表卖出的价格,所以我们要尽量选择参数值使得,在训练集中,给出训练集的x能够尽可能准确地预测y值.

我们定义解决一个最小化问题

也就是最小化损失函数问题:

注意两点:除一个是为了数字更好看一点,平方误差的使用是解决大部分回归问题的常用方法

为了简化设定

故

有时被称为平方误差函数

2-3 线性回归的直观理解 Ⅰ

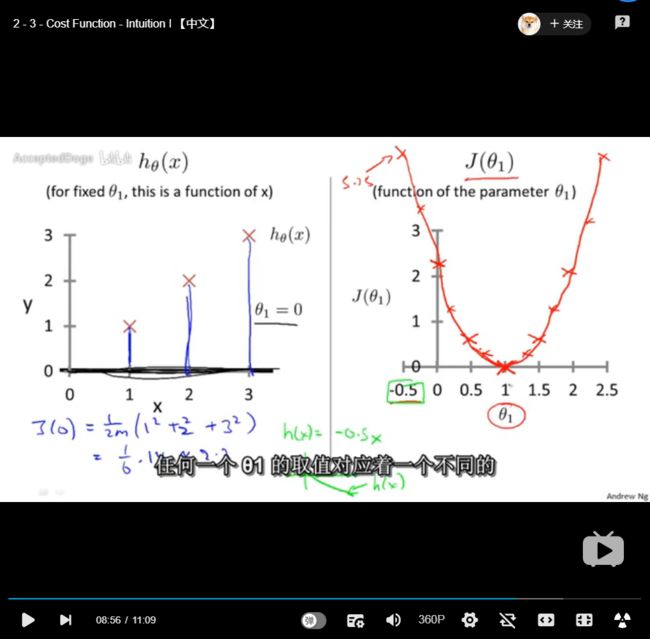

假设函数和代价函数进行比较

假设函数是关于特征的函数

而代价函数是关于参数, 的函数

可以看到损失函数已经慢慢变成了一个曲线,每次取定不同的都会算出不同的损失函数,也是对应着左边不同的拟合曲线, 还记得目标是找到使得能够得到目标

在本节中,我们使用了图形来理解代价函数,也就是一开始把了,下一课将看原来带有双变量的损失函数

2-4 线性回归的直观理解 Ⅱ

假设:假设你们已经熟悉等高线图Contour plot