第129天学习打卡(Elasticsearch kibana安装 ES核心概念 IK分词器插件)

Kibana安装

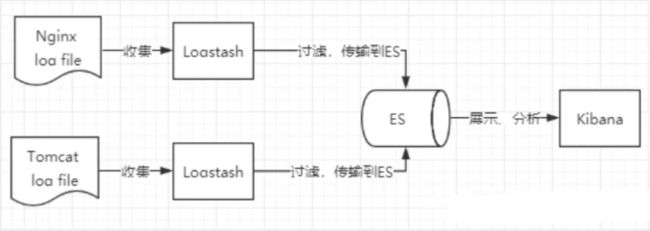

了解ELK

ELK是Elasticsearch 、Logstash、 Kibana三大开源框架首字母大写简称。市面上也被称为Elastic Stack.其中Elastic search是一个基于Lucene、分布式、通过Restful方式进行交互的近实时搜索平台。像类似百度、谷歌这种大数据全文搜索引擎的场景都可以使用Elasticsearcch作为底层支持框架,可见Elasticsearch提供的搜索能力确实强大,市面上很多时候我们简称Elasticsearch为es。Logstan是ELK的中央数据流引擎,用于从不同目标(文件/数据储存/MQ)收集的不同的格式数据,经过过滤后支持输出到不同目的地(文件/MQ/redis/elasticsearch/kafka等)。Kibana可以将elasticsearch的数据通过友好的页面展示出来,提供实时分析的功能。

ELK不仅仅适用于日志分析,它还可以支持其他任何数据分析和收集的场景,日志分析和收集只是更具有代表性。并非唯一性。

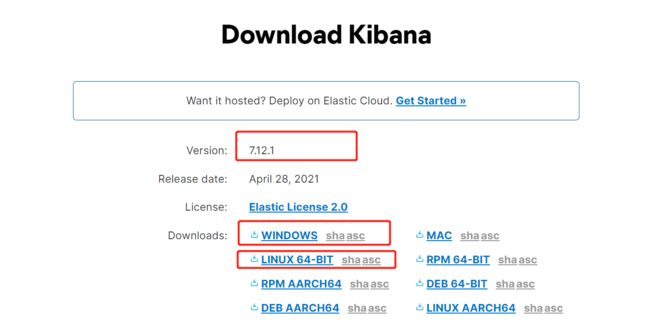

安装Kibana

Kibana是一个针对Elasticsearch的开源分析及可视化平台,用来搜索、查看交互存储在Elasticsearch索引中的数据。使用Kibana可以通过各种图标进行高级数据分析及展示。Kibana让海量数据更容易理解。它操作简单,基于浏览器的用户界面可以快速创建仪表板(dashbord)实时显示Elasticsearch查询状态。设置Kibana非常简单。无需编码或者额外的基础架构,几分钟内就可以完成Kibana安装并启动Elasticsearch索引监测。

官网下载地址:Download Kibana Free | Get Started Now | Elastic | Elastic

Kibana版本要和Es一致。

下载完毕之后,解压需要一些时间,这是一个标准的工程!

好处:ELK基本上都是拆箱即用。

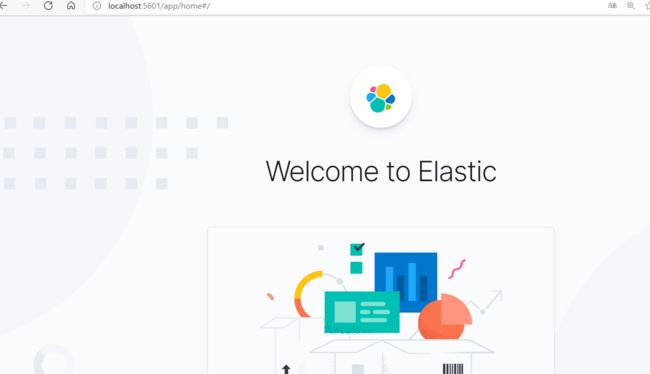

启动测试

1.解压后的目录

2注意:启动kibana.bat 需要先启动elasticsearch.bat

3.访问页面测试:

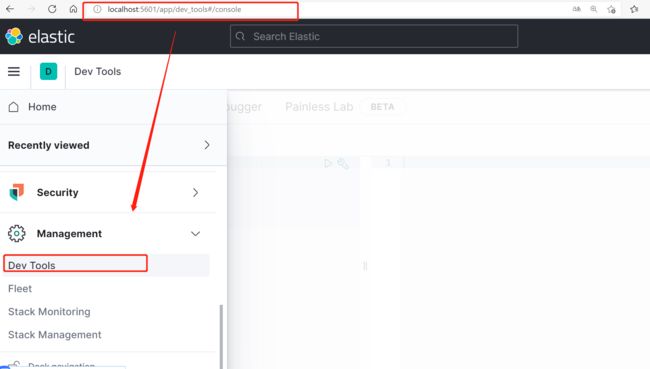

4.开发工具!(Post 、curl、 head、 谷歌浏览器插件测试)

Dev Tools - Elastic

之后的操作都在这里进行编写!

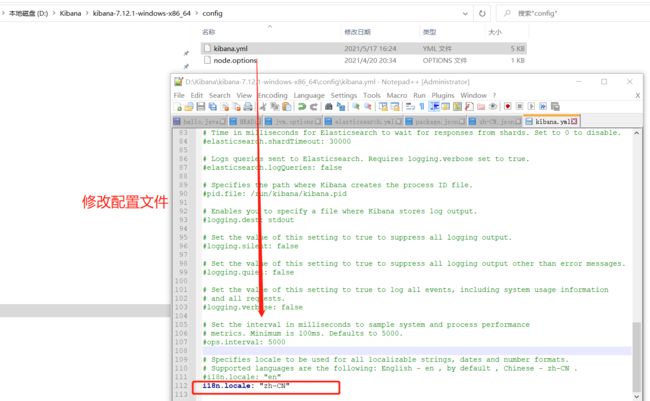

5.汉化,修改配置文件的kibana.yml

注意改完配置文件后要重启项目。

i18n.locale: "zh-CN"

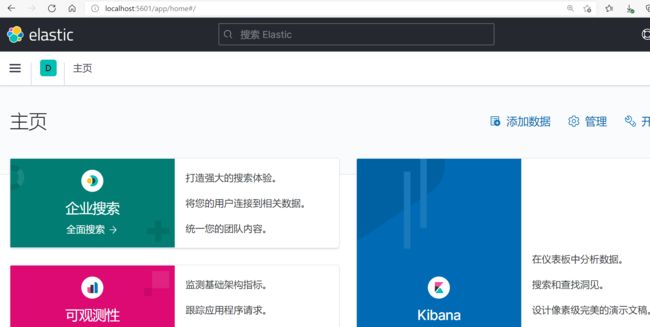

汉化的效果展示:

ES核心概念

1.索引

2.字段类型(mapping)

3.文档(documents)

概述

elasticsearch是面向文档编程

关系型数据库和elasticsearch客观的对比 一切都是json

| Relastional DB | Elasticsearch |

|---|---|

| 数据库(database) | 索引(indices) 就和数据库一样 |

| 表(tables) | types 慢慢会被弃用 |

| 行(row) 指具体的数据 | documents |

| 字段(columns) | fields |

elasticsearch(集群)中可以包含多个索引(数据库),每个索引中可以包含多个类型(表),每个类型下又包含多个文档(行),每个文档中又包含多个字段(列)。

物理设计:

elasticsearch 在后台把每个索引划分成多个分片,每分片可以在集群中的不同服务器间迁移。

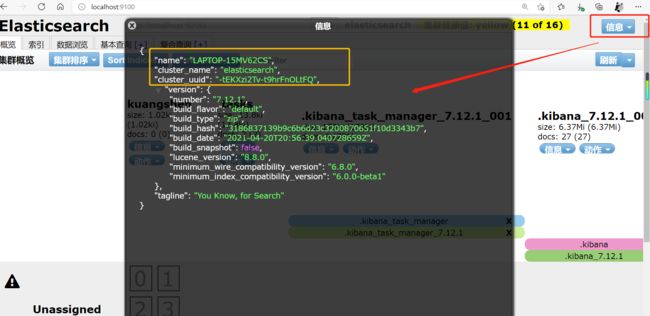

一个人就是一个集群!默认的集群名称就是elasticsearch

逻辑设计:

一个索引类型中,包含多个文档,比如说文档1,文档2,当我们索引一篇文档时,可以通过这样的顺序找到它: 索引 -> 类型 -> 文档id(注意:id不必是整数,实际是个字符串),通过这个组合我们就能索引到某个具体的文档。

文档

就是我们的一条条数据

user

1 zhangsan 18

2 kuangshen 3

es是面向文档的,意味着索引和搜索数据的最小单位是文档,es中,文档有几个重要的属性:

- 自我包含,一篇文档同时包含字段和对应的值,也就是同时包含key:value

- 可以是层次性的,一个文档中包含自文档,复杂的逻辑实体就是这么来的! {就是一个json对象!}

- 灵活的结构,文档不依赖预先定义的模式,我们知道关系型数据库中,要提前定义字段才能使用,在es中,对于字段是非常灵活的。有时候,我们可以忽略字段,或者动态的添加一个新的字段

尽管我们可以随意的添加或忽略某个字段,但是,每个字段的类型非常重要。因为es会保存字段和类型之间的映射以及其他的设置。这种映射具体到每个映射的每种类型,这也是为什么在es中,类型有时候也称为映射类型。

类型

类型是文档的逻辑容器,就像关系型数据库一样,表格是行的容器。类型中对于字段的定义称为映射,比如name映射为string类型.我们说文档是无模式的,他们不需要拥有映射中所定义的所有字段,当新增加一个字段时,es会自动的将新字段加入映射,但是这个字段不确定他是什么类型,所以最安全的方式是提前定义好所需要的映射。

索引

就是数据库!

索引是映射类型的容器,es的索引是一个非常大的文档集合。索引存储了了映射类型的字段和其他设置。然后他们被存储到了各个分片上。

物理设计:节点和分片工作

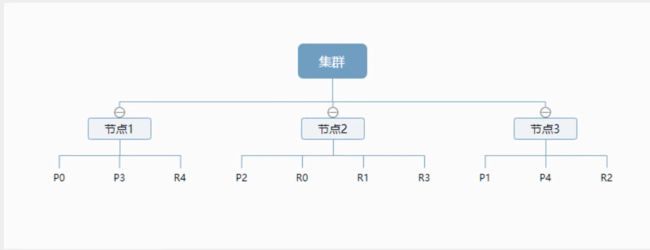

一个集群至少有一个节点,而一个节点就是一个es进程,节点可以有多个索引默认的,如果创建索引,索引将会有5个分片(primary shard ,又称主分片)构成的,每个主分片会有一个副本(replica shard,又称复制分片)

上图是一个有3个节点的集群,可以看到主分片和对应的复制分片都不会在同一个节点内,这样有利于某个节点挂掉了,数据也不至于丢失。实际上,一个分片是一个Lucene索引,一个包含倒排索引的文件目录,倒排索引的结构使得es在不扫描全部文档的情况下,就能告诉你哪些文档包含特定的关键字。

倒排索引

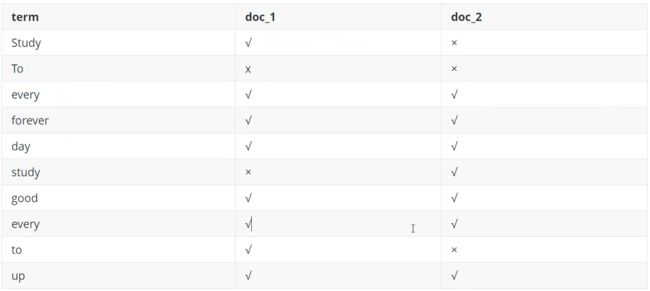

es使用的是一种称为倒排索引的结构,采用Lucene倒排作为底层。这种结构适用于快速的全文搜索,一个索引由文档中所有不重复的列表构成,对于每一个词,都有一个包含它的文档列表。例如,现在有两个文档,每个文档包含如下内容:

study every day, good good up to forver # 文档1包含的内容

To forever, study every day, good good up 文档2包含的内容

为了创建倒排索引,我们首先要将每个文档拆分成独立的词(或称为词条或者tokens),然后创建一个包含所有不重复的词条的排序列表,然后列出每个词条出现在哪个文档。

现在,我们试图搜索 to forever,只需要查看包含每个词条的文档

两个文档都匹配,但是第一个文档比第二个匹配程度(权重 score)高。如果没有别的条件,现在,这两个包含关键字的文档都将返回。

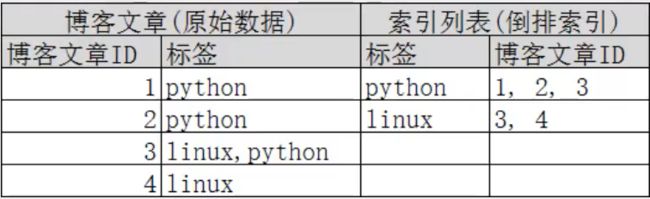

示例2,比如我们通过博客标签来搜索博客文章。那么倒排索引列表就是这样的一个结构:

如果要搜索含有python标签的文章,那相对于查找所有原始数据而言,查找倒排索引后的数据将会快的多。只需要查看标签这一栏,然后获取相关的文章id即可。完全过滤掉无关的所有数据,提高效率!

es索引和lucene的索引对比

在es中,索引(库)这个词被频繁使用,这就是术语的使用。在es中,索引被分为多个分片,每份分片是一个Lucene的索引。所以一个es索引是由多个Lucene索引组成的。

接下来的一切操作都在kibana中Dev Tools下的Console里完成。

IK分词器插件

什么是分词器

分词:即把一段中文或者别的划分成一个个关键字,我们在搜索时候会把自己的信息进行分词,会把数据库中或者索引库中的数据进行分词,然后进行一个匹配操作,默认的中文分词是将每个字看成一个词,比如“我爱学习“ 会被分为”我“,”爱“,”学“,“习”,这显然是不符合要求的,所以需要安装中文分词器ik来解决这个问题。

如果要使用中文,建议使用ik分词器。

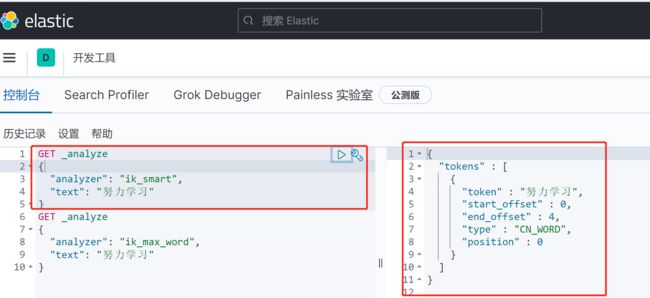

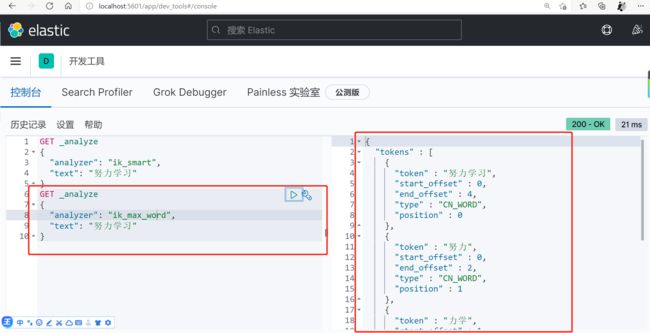

IK提高了两个分词算法:ik_smart和ik_max_word,其中ik_smart为最少切分,ik_max_word为最细粒度划分!

安装

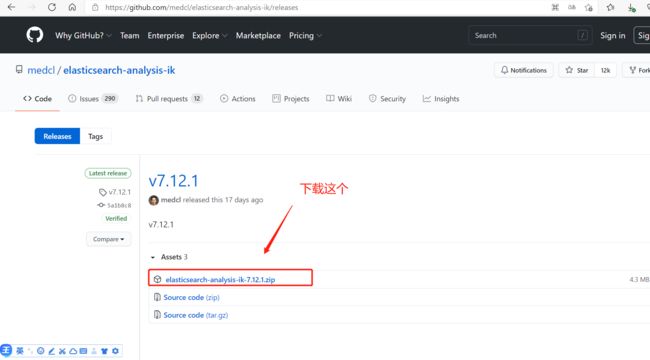

1.下载地址Releases · medcl/elasticsearch-analysis-ik · GitHub

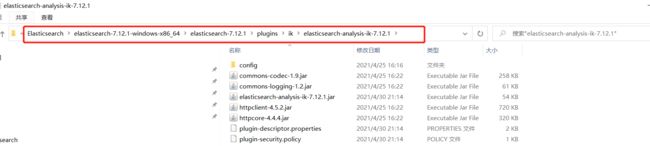

2.下载完毕之后,放入到elasticsearch中插件即可

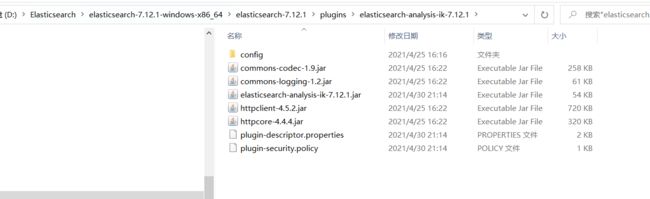

在plugins中创建一个ik文件夹:

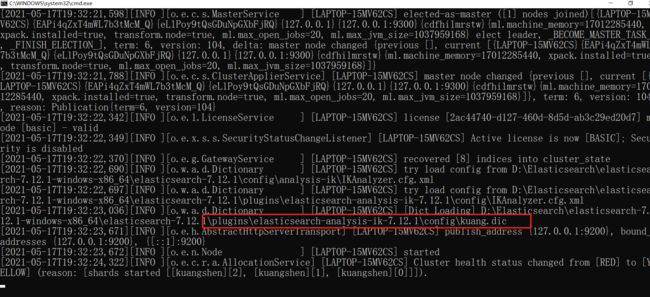

3 重启观察ES

重启遇到了es闪退的问题,(es 与分词器版本是一致的)两者的版本是一致的,按照网上将的把安装包删掉 也不能解决闪退问题,我把ik文件夹也删掉了,直接在plugins中解压分词器,然后把安装包删掉,然后重启es成功了

重启成功后,可以看到ik分词器被加载了!

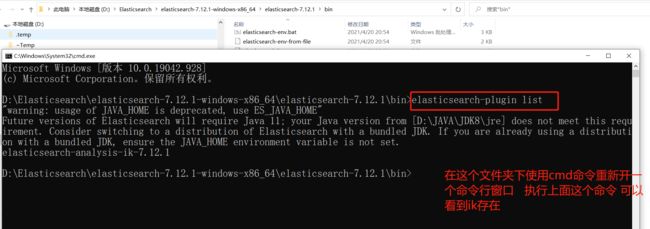

- elasticsearch-plugin list可以通过这个命令来查看加载进来的插件。

5.使用kibana测试!

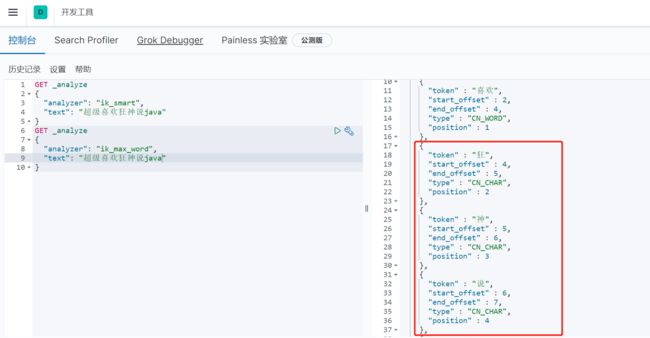

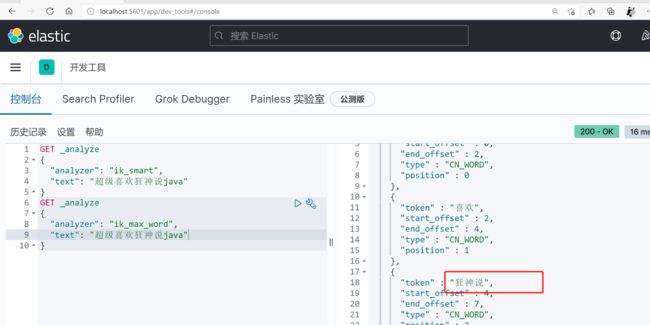

查看不同的分词器的效果

ik_max_word为最细粒度划分, 穷尽词库的可能。

发现问题:狂神说被拆开了!

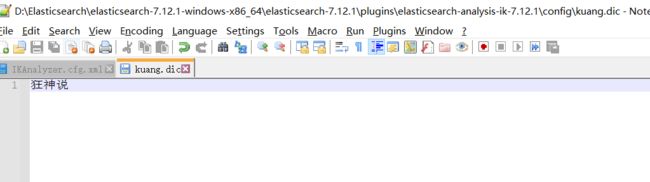

这种自己需要的词,需要自己加到我们的分词器的字典中!

ik分词器增加自己的配置

重启es

重启kibana

再次测试一些狂神说,看下效果。

以后需要自己配置分词就在自己定义的dic文件中配置即可!

B站学习网址:【狂神说Java】ElasticSearch7.6.x最新完整教程通俗易懂_哔哩哔哩 (゜-゜)つロ 干杯~-bilibili