kafka 2.13-2.8.0 单机 & 集群配置(zookeeper)

1、配置预安装环境,下载kafka

yum -y install java-1.8.0-openjdk.x86_64

wget https://archive.apache.org/dist/kafka/2.8.0/kafka_2.13-2.8.0.tgz

tar -xvf kafka_2.13-2.8.0.tgz

mv kafka_2.13-2.8.0 kafka

cd kafka/2、配置并启动zookeeper

mkdir zklogs

vim config/zookeeper.properties

# the directory where the snapshot is stored.

dataDir=/data/kafka/zklogs

# the port at which the clients will connect

clientPort=2181

# disable the per-ip limit on the number of connections since this is a non-production config

maxClientCnxns=0 #每个ip连接zookeeper时的连接数没有限制

# Disable the adminserver by default to avoid port conflicts.

# Set the port to something non-conflicting if choosing to enable this

admin.enableServer=false

# admin.serverPort=8080

/data/kafka/bin/zookeeper-server-start.sh /data/kafka/config/zookeeper.properties &3、配置并启动kafka

cd /data/kafka/

mkdir kafka-logs

vim config/server.properties

broker.id=0 #唯一标识

listeners=PLAINTEXT://10.2.33.94:9092

#advertised.listeners=PLAINTEXT://your.host.name:9092

num.network.threads=3 #broker处理消息的最大线程数

num.io.threads=8 #broker处理磁盘IO的线程数,应大于硬盘数

socket.send.buffer.bytes=102400 #发送缓冲区

socket.receive.buffer.bytes=102400 #接收缓冲区

socket.request.max.bytes=104857600 #请求的最大数值

log.dirs=/data/kafka/kafka-logs #数据存放位置,多个用逗号分隔

num.partitions=2 #每个topic的分区个数

num.recovery.threads.per.data.dir=1

offsets.topic.replication.factor=1

transaction.state.log.replication.factor=1

transaction.state.log.min.isr=1

log.retention.hours=168

log.segment.bytes=1073741824

log.retention.check.interval.ms=300000

zookeeper.connect=localhost:2181

zookeeper.connection.timeout.ms=18000

group.initial.rebalance.delay.ms=0

/data/kafka/bin/kafka-server-start.sh /data/kafka/config/server.properties &

| 参数 |

说明(解释) |

| broker.id =0 |

每一个broker在集群中的唯一表示,要求是正数,kafka及其根据id来识别broker机器。当该服务器的IP地址发生改变时,broker.id没有变化,则不会影响consumers的消息情况 |

| log.dirs=/kafka/kafka-logs |

kafka数据的存放地址,多个地址的话用逗号分割/kafka/kafka-logs-1,/kafka/kafka-logs-2 |

| port =9092 |

broker server服务端口 |

| message.max.bytes =6525000 |

表示消息体的最大大小,单位是字节 |

| num.network.threads =4 |

broker处理消息的最大线程数,一般情况下不需要去修改 |

| num.io.threads =8 |

broker处理磁盘IO的线程数,数值应该大于你的硬盘数 |

| background.threads =4 |

一些后台任务处理的线程数,例如过期消息文件的删除等,一般情况下不需要去做修改 |

| queued.max.requests =500 |

等待IO线程处理的请求队列最大数,若是等待IO的请求超过这个数值,那么会停止接受外部消息,应该是一种自我保护机制。 |

| host.name |

broker的主机地址,若是设置了,那么会绑定到这个地址上,若是没有,会绑定到所有的接口上,并将其中之一发送到ZK,一般不设置 |

| socket.send.buffer.bytes=100*1024 |

socket的发送缓冲区,socket的调优参数SO_SNDBUFF |

| socket.receive.buffer.bytes =100*1024 |

socket的接受缓冲区,socket的调优参数SO_RCVBUFF |

| socket.request.max.bytes =100*1024*1024 |

socket请求的最大数值,防止serverOOM,message.max.bytes必然要小于socket.request.max.bytes,会被topic创建时的指定参数覆盖 |

| Kafka中log日志的参数配置 | |

| log.segment.bytes =1024*1024*1024 |

topic的分区是以一堆segment文件存储的,这个控制每个segment的大小,会被topic创建时的指定参数覆盖 |

| log.roll.hours =24*7 |

这个参数会在日志segment没有达到log.segment.bytes设置的大小,也会强制新建一个segment会被 topic创建时的指定参数覆盖 |

| log.cleanup.policy = delete |

日志清理策略选择有:delete和compact主要针对过期数据的处理,或是日志文件达到限制的额度,会被 topic创建时的指定参数覆盖 |

| log.retention.minutes=3days |

数据存储的最大时间超过这个时间会根据log.cleanup.policy设置的策略处理数据,也就是消费端能够多久去消费数据 log.retention.bytes和log.retention.minutes任意一个达到要求,都会执行删除,会被topic创建时的指定参数覆盖 |

| log.retention.bytes=-1 | topic每个分区的最大文件大小,一个topic的大小限制 =分区数*log.retention.bytes。-1没有大小限log.retention.bytes和log.retention.minutes任意一个达到要求,都会执行删除,会被topic创建时的指定参数覆盖 |

| log.retention.check.interval.ms=5minutes |

文件大小检查的周期时间,是否处罚 log.cleanup.policy中设置的策略 |

| log.cleaner.enable=false |

是否开启日志压缩 |

| log.cleaner.threads = 2 |

日志压缩运行的线程数 |

| log.cleaner.io.max.bytes.per.second=None |

日志压缩时候处理的最大大小 |

| log.cleaner.dedupe.buffer.size=500*1024*1024 |

日志压缩去重时候的缓存空间,在空间允许的情况下,越大越好 |

| log.cleaner.io.buffer.size=512*1024 |

日志清理时候用到的IO块大小一般不需要修改 |

| log.cleaner.io.buffer.load.factor =0.9 |

日志清理中hash表的扩大因子一般不需要修改 |

| log.cleaner.backoff.ms =15000 |

检查是否处罚日志清理的间隔 |

| log.cleaner.min.cleanable.ratio=0.5 |

日志清理的频率控制,越大意味着更高效的清理,同时会存在一些空间上的浪费,会被topic创建时的指定参数覆盖 |

| log.cleaner.delete.retention.ms =1day |

对于压缩的日志保留的最长时间,也是客户端消费消息的最长时间,同log.retention.minutes的区别在于一个控制未压缩数据,一个控制压缩后的数据。会被topic创建时的指定参数覆盖 |

| log.index.size.max.bytes =10*1024*1024 |

对于segment日志的索引文件大小限制,会被topic创建时的指定参数覆盖 |

| log.index.interval.bytes =4096 |

当执行一个fetch操作后,需要一定的空间来扫描最近的offset大小,设置越大,代表扫描速度越快,但是也更好内存,一般情况下不需要搭理这个参数 |

| log.flush.interval.messages=None | log文件”sync”到磁盘之前累积的消息条数,因为磁盘IO操作是一个慢操作,但又是一个”数据可靠性"的必要手段,所以此参数的设置,需要在"数据可靠性"与"性能"之间做必要的权衡.如果此值过大,将会导致每次"fsync"的时间较长(IO阻塞),如果此值过小,将会导致"fsync"的次数较多,这也意味着整体的client请求有一定的延迟.物理server故障,将会导致没有fsync的消息丢失. |

| log.flush.scheduler.interval.ms =3000 | 检查是否需要固化到硬盘的时间间隔 |

| log.flush.interval.ms = None |

仅仅通过interval来控制消息的磁盘写入时机,是不足的.此参数用于控制"fsync"的时间间隔,如果消息量始终没有达到阀值,但是离上一次磁盘同步的时间间隔达到阀值,也将触发. |

| log.delete.delay.ms =60000 |

文件在索引中清除后保留的时间一般不需要去修改 |

| log.flush.offset.checkpoint.interval.ms =60000 |

控制上次固化硬盘的时间点,以便于数据恢复一般不需要去修改 |

| auto.create.topics.enable =true |

是否允许自动创建topic,若是false,就需要通过命令创建topic |

| default.replication.factor =1 |

是否允许自动创建topic,若是false,就需要通过命令创建topic |

| num.partitions =1 |

每个topic的分区个数,若是在topic创建时候没有指定的话会被topic创建时的指定参数覆盖 |

| Kafka中leader、replicas参数配置 | |

| controller.socket.timeout.ms =30000 |

partition leader与replicas之间通讯时,socket的超时时间 |

| controller.message.queue.size=10 |

partition leader与replicas数据同步时,消息的队列尺寸 |

| replica.lag.time.max.ms =10000 |

replicas响应partition leader的最长等待时间,若是超过这个时间,就将replicas列入ISR(in-sync replicas),并认为它是死的,不会再加入管理中 |

| replica.lag.max.messages =4000 |

如果follower落后与leader太多,将会认为此follower[或者说partition relicas]已经失效 ##通常,在follower与leader通讯时,因为网络延迟或者链接断开,总会导致replicas中消息同步滞后 ##如果消息之后太多,leader将认为此follower网络延迟较大或者消息吞吐能力有限,将会把此replicas迁移 ##到其他follower中. ##在broker数量较少,或者网络不足的环境中,建议提高此值. |

| replica.socket.timeout.ms=30*1000 |

follower与leader之间的socket超时时间 |

| replica.socket.receive.buffer.bytes=64*1024 |

leader复制时候的socket缓存大小 |

| replica.fetch.max.bytes =1024*1024 |

replicas每次获取数据的最大大小 |

| replica.fetch.wait.max.ms =500 |

replicas同leader之间通信的最大等待时间,失败了会重试 |

| replica.fetch.min.bytes =1 |

fetch的最小数据尺寸,如果leader中尚未同步的数据不足此值,将会阻塞,直到满足条件 |

| num.replica.fetchers=1 |

leader进行复制的线程数,增大这个数值会增加follower的IO |

| replica.high.watermark.checkpoint.interval.ms =5000 |

每个replica检查是否将最高水位进行固化的频率 |

| controlled.shutdown.enable =false |

是否允许控制器关闭broker ,若是设置为true,会关闭所有在这个broker上的leader,并转移到其他broker |

| controlled.shutdown.max.retries =3 |

控制器关闭的尝试次数 |

| controlled.shutdown.retry.backoff.ms =5000 |

每次关闭尝试的时间间隔 |

| leader.imbalance.per.broker.percentage =10 |

leader的不平衡比例,若是超过这个数值,会对分区进行重新的平衡 |

| leader.imbalance.check.interval.seconds =300 |

检查leader是否不平衡的时间间隔 |

| offset.metadata.max.bytes |

客户端保留offset信息的最大空间大小 |

| kafka中zookeeper的参数配置 | |

| zookeeper.connect = localhost:2181 |

必须配置项:::zookeeper集群的地址,可以是多个,多个之间用逗号分割,一般端口都为2181;hostname1:port1,hostname2:port2,hostname3:port3 |

| zookeeper.session.timeout.ms=6000 |

ZooKeeper的最大超时时间,就是心跳的间隔,若是没有反映,那么认为已经死了,不易过大 |

| zookeeper.connection.timeout.ms =6000 |

ZooKeeper的连接超时时间 |

| zookeeper.sync.time.ms =2000 |

ZooKeeper集群中leader和follower之间的同步实际那 |

4、kafka的基本概念

broker

kafka集群包含一个或多个服务器,这种服务器被称为broker

topic

每条发布到kafka集群的消息多会有一个类别,这个类别被称为topic

物理上不通topic的消息分开存储,逻辑上一个topic的消息虽然存于一个或多个broker上,单用户只需指定消息消息的topic即可生产或消费数据而不必关心数据存于何处

partition

物理上的概念,每个topic包含一个或多个partition

producer

负责发布消息到kafka broker

consumer

消息消费者,向kafka broker读取消息的客户端

consumer group

每个consumer属于一个特定的consumer group,可为其指定group name,不指定则默认5、事例命令:

已双节点的配置创建了一个叫 dblab01的topic

[root@10-2-33-94 config]# /data/kafka/bin/kafka-topics.sh --create --zookeeper 10.2.33.94:2181 --replication-factor 1 --partitions 2 --topic dblab01

Created topic dblab01.

[2021-11-10 15:15:27,461] INFO [ReplicaFetcherManager on broker 0] Removed fetcher for partitions Set(dblab01-0, dblab01-1) (kafka.server.ReplicaFetcherManager)

[2021-11-10 15:15:27,527] INFO [Log partition=dblab01-0, dir=/data/kafka/kafka-logs] Loading producer state till offset 0 with message format version 2 (kafka.log.Log)

[2021-11-10 15:15:27,531] INFO Created log for partition dblab01-0 in /data/kafka/kafka-logs/dblab01-0 with properties {compression.type -> producer, message.downconversion.enable -> true, min.insync.replicas -> 1, segment.jitter.ms -> 0, cleanup.policy -> [delete], flush.ms -> 9223372036854775807, segment.bytes -> 1073741824, retention.ms -> 604800000, flush.messages -> 9223372036854775807, message.format.version -> 2.8-IV1, file.delete.delay.ms -> 60000, max.compaction.lag.ms -> 9223372036854775807, max.message.bytes -> 1048588, min.compaction.lag.ms -> 0, message.timestamp.type -> CreateTime, preallocate -> false, min.cleanable.dirty.ratio -> 0.5, index.interval.bytes -> 4096, unclean.leader.election.enable -> false, retention.bytes -> -1, delete.retention.ms -> 86400000, segment.ms -> 604800000, message.timestamp.difference.max.ms -> 9223372036854775807, segment.index.bytes -> 10485760}. (kafka.log.LogManager)

[2021-11-10 15:15:27,532] INFO [Partition dblab01-0 broker=0] No checkpointed highwatermark is found for partition dblab01-0 (kafka.cluster.Partition)

[2021-11-10 15:15:27,533] INFO [Partition dblab01-0 broker=0] Log loaded for partition dblab01-0 with initial high watermark 0 (kafka.cluster.Partition)

[2021-11-10 15:15:27,545] INFO [Log partition=dblab01-1, dir=/data/kafka/kafka-logs] Loading producer state till offset 0 with message format version 2 (kafka.log.Log)

[2021-11-10 15:15:27,546] INFO Created log for partition dblab01-1 in /data/kafka/kafka-logs/dblab01-1 with properties {compression.type -> producer, message.downconversion.enable -> true, min.insync.replicas -> 1, segment.jitter.ms -> 0, cleanup.policy -> [delete], flush.ms -> 9223372036854775807, segment.bytes -> 1073741824, retention.ms -> 604800000, flush.messages -> 9223372036854775807, message.format.version -> 2.8-IV1, file.delete.delay.ms -> 60000, max.compaction.lag.ms -> 9223372036854775807, max.message.bytes -> 1048588, min.compaction.lag.ms -> 0, message.timestamp.type -> CreateTime, preallocate -> false, min.cleanable.dirty.ratio -> 0.5, index.interval.bytes -> 4096, unclean.leader.election.enable -> false, retention.bytes -> -1, delete.retention.ms -> 86400000, segment.ms -> 604800000, message.timestamp.difference.max.ms -> 9223372036854775807, segment.index.bytes -> 10485760}. (kafka.log.LogManager)

[2021-11-10 15:15:27,546] INFO [Partition dblab01-1 broker=0] No checkpointed highwatermark is found for partition dblab01-1 (kafka.cluster.Partition)

[2021-11-10 15:15:27,546] INFO [Partition dblab01-1 broker=0] Log loaded for partition dblab01-1 with initial high watermark 0 (kafka.cluster.Partition)

查看刚才创建的主体是否存在

[root@10-2-33-94 config]# /data/kafka/bin/kafka-topics.sh --describe --zookeeper 10.2.33.94:2181 --topic dblab01

Topic: dblab01 TopicId: NYHPJsYaQAOjnhmvrRLBkw PartitionCount: 2 ReplicationFactor: 1 Configs:

Topic: dblab01 Partition: 0 Leader: 0 Replicas: 0 Isr: 0

Topic: dblab01 Partition: 1 Leader: 0 Replicas: 0 Isr: 0

[root@10-2-33-94 config]# /data/kafka/bin/kafka-topics.sh --list --zookeeper 10.2.33.94:2181

dblab01

producer向其发布消息

[root@10-2-33-94 config]# /data/kafka/bin/kafka-console-producer.sh --broker-list 10.2.33.94:9092 --topic dblab01

>hello my first kafka

>bye

>^C

consumer获取消息

[root@10-2-33-94 config]# /data/kafka/bin/kafka-console-consumer.sh --bootstrap-server 10.2.33.94:9092 --topic dblab01 --from-beginning

bye

hello my first kafka

####可以查看到消息,说明安装成功

| 参数 | 值类型 | 说明 | 有效值 |

|---|---|---|---|

| --topic | string | 被消费的topic | |

| --whitelist | string | 正则表达式,指定要包含以供使用的主题的白名单 | |

| --partition | integer | 指定分区 除非指定’–offset’,否则从分区结束(latest)开始消费 |

|

| --offset | string | 执行消费的起始offset位置 默认值:latest |

latest earliest |

| --consumer-property | string | 将用户定义的属性以key=value的形式传递给使用者 | |

| --consumer.config | string | 消费者配置属性文件 请注意,[consumer-property]优先于此配置 |

|

| --formatter | string | 用于格式化kafka消息以供显示的类的名称 默认值:kafka.tools.DefaultMessageFormatter |

kafka.tools.DefaultMessageFormatter kafka.tools.LoggingMessageFormatter kafka.tools.NoOpMessageFormatter kafka.tools.ChecksumMessageFormatter |

| --property | string | 初始化消息格式化程序的属性 | print.timestamp=true|false print.key=true|false print.value=true|false key.separator= line.separator= key.deserializer= value.deserializer= |

| --from-beginning | 从存在的最早消息开始,而不是从最新消息开始 | ||

| --max-messages | integer | 消费的最大数据量,若不指定,则持续消费下去 | |

| --timeout-ms | integer | 在指定时间间隔内没有消息可用时退出 | |

| --skip-message-on-error | 如果处理消息时出错,请跳过它而不是暂停 | ||

| --bootstrap-server | string | 必需(除非使用旧版本的消费者),要连接的服务器 | |

| --key-deserializer | string | ||

| --value-deserializer | string | ||

| --enable-systest-events | 除记录消费的消息外,还记录消费者的生命周期 (用于系统测试) |

||

| --isolation-level | string | 设置为read_committed以过滤掉未提交的事务性消息 设置为read_uncommitted以读取所有消息 默认值:read_uncommitted |

|

| --group | string | 指定消费者所属组的ID | |

| --blacklist | string | 要从消费中排除的主题黑名单 | |

| --csv-reporter-enabled | 如果设置,将启用csv metrics报告器 | ||

| --delete-consumer-offsets | 如果指定,则启动时删除zookeeper中的消费者信息 | ||

| --metrics-dir | string | 输出csv度量值 需与[csv-reporter-enable]配合使用 |

|

| --zookeeper | string | 必需(仅当使用旧的使用者时)连接zookeeper的字符串。 可以给出多个URL以允许故障转移 |

|

6、安装kafka-manager

kafk-manager 3.0 需要jdk11+,服务器只装有jdk8,所以要安装2.0或者1.0

另kafka 2.0和1.0需要源码编译后才能用,所以就从网上找了个编译好的用(kafka-manager-1.3.3.23)

链接:https://pan.baidu.com/s/1-aCIlxI-OfMHjzC-BenodQ

提取码:72vi

上传,修改配置 conf/application.conf

kafka-manager.zkhosts="10.2.33.94:2181"

启动kafka-manager

kafka-manager默认端口是9000,可用如下换别的端口

/data/kafka-manager/bin/kafka-manager -Dconfig.file=/data/kafka-manager/conf/application.conf -Dhttp.port=2182 &

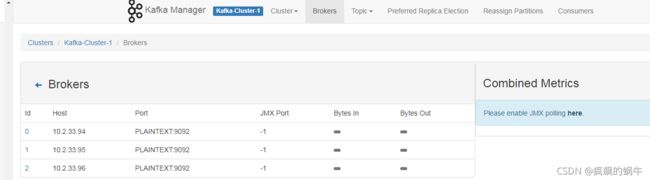

点击【Cluster】>【Add Cluster】打开如下添加集群配置界面:输入集群的名字(如Kafka-Cluster-1)和 Zookeeper 服务器地址(10.2.33.94:2181),选择最接近的Kafka版本,然后就可以用了

集群配置

| 10.2.33.94 | server1 |

| 10.2.33.95 | server2 |

| 10.2.33.96 | server3 |

一、说明:

1、Linux服务器一台、三台、五台、(2*n+1),Zookeeper集群的工作是超过半数才能对外提供服务,3台中超过两台超过半数,允许1台挂掉 ,是否可以用偶数,其实没必要。

如果有四台那么挂掉一台还剩下三台服务器,如果在挂掉一个就不行了,这里记住是超过半数。

2、Java jdk1.8 zookeeper是用java写的所以他的需要JAVA环境,java是运行在java虚拟机上的

3、Zookeeper的稳定版本apache-zookeeper-3.7.0-bin.tar.gz版本 ,kafka: kafka_2.13-2.8.0.tgz, manager: kafka-manager-1.3.3.23.zip

二、zookeeper配置&启动&验证

#首先要注意在生产环境中目录结构要定义好,防止在项目过多的时候找不到所需的项目

#我的目录统一放在/data/下面

cd /data/

mkdir zookeeper #项目目录

mkdir zookeeper/zkdata #存放快照日志

mkdir zookeeper/zkdatalog#存放事物日志

wget https://mirrors.cnnic.cn/apache/zookeeper/zookeeper-3.7.0/apache-zookeeper-3.7.0-bin.tar.gz

####注:下载有bin的包,否则会有异常

tar -zxvf apache-zookeeper-3.7.0-bin.tar.gz

mv apache-zookeeper-3.7.0-bin/ apache-zookeeper

cd apache-zookeeper/conf/

cp zoo_sample.cfg zoo.cfg

vim zoo.cfg

tickTime=2000

initLimit=10

syncLimit=5

dataDir=/data/zookeeper/zkdata

dataLogDir=/data/zookeeper/zkdatalog

clientPort=2181

server.1=10.2.33.94:2888:3888

server.2=10.2.33.95:2888:3888

server.3=10.2.33.96:2888:3888

####注:配置文件手动输入,不要多空格等,否则会有异常

cd /data/

scp -r apache-zookeeper [email protected]:/data/zookeeper/

scp -r apache-zookeeper [email protected]:/data/zookeeper/

#在第一台zookeeper节点上创建myid文件

echo '1' > /data/zookeeper/zkdata/myid

#在第二台zookeeper节点上创建myid文件

echo '2' > /data/zookeeper/zkdata/myid

#在第三台zookeeper节点上创建myid文件

echo '3' > /data/zookeeper/zkdata/myid

#启动三台zookeeper

/data/zookeeper/apache-zookeeper/bin/zkServer.sh start

/usr/bin/java

ZooKeeper JMX enabled by default

Using config: /data/zookeeper/apache-zookeeper/bin/../conf/zoo.cfg

Starting zookeeper ... STARTED

#验证集群

/data/zookeeper/apache-zookeeper/bin/zkServer.sh status

/usr/bin/java

ZooKeeper JMX enabled by default

Using config: /data/zookeeper/apache-zookeeper/bin/../conf/zoo.cfg

Client port found: 2181. Client address: localhost. Client SSL: false.

Mode: leader

####注:如果状态Mode中有follower或observer或leader表示搭建成功(leader只能有一台)

#错误总结

错误1、启动报错,没有日志,但是在/data/zookeeper/apache-zookeeper/logs/里有提示,

找不到或无法加载主类 org.apache.zookeeper.server.quorum.QuorumPeerMain

原因:下载的是未编译的 jar 包。

注:zookeeper 好像从 3.5 版本以后,命名就发生了改变,

如果是 apache-zookeeper-3.5.5.tar.gz 这般命名的,都是未编译的,

而 apache-zookeeper-3.5.5-bin.tar.gz 这般命名的,才是已编译的包。

注2:ZooKeeper server will not remove old snapshots and log files when using the default configuration (see autopurge below), this is the responsibility of the operator

zookeeper不会主动的清除旧的快照和日志文件,这个是操作者的责任

从3.4.0开始,zookeeper提供了自动清理snapshot和事务日志的功能,通过配置 autopurge.snapRetainCount 和 autopurge.purgeInterval 这两个参数能够实现定时清理了。这两个参数都是在zoo.cfg中配置的:

autopurge.purgeInterval 这个参数指定了清理频率,单位是小时,需要填写一个1或更大的整数,默认是0,表示不开启自己清理功能。

autopurge.snapRetainCount 这个参数和上面的参数搭配使用,这个参数指定了需要保留的文件数目。默认是保留3个。

三、kafka配置&启动&验证

文章的第一部分单机中已经涉及安装配置,修改以下即可

cat /data/kafka/config/server.properties #修改为集群格式:

zookeeper.connect=10.2.33.94:2181,10.2.33.95:2181,10.2.33.96:2181

hostname=10.2.33.94 ###可选添加

/data/kafka/bin/kafka-server-start.sh /data/kafka/config/server.properties & #启动三、kafka-manager配置&启动&验证

文章的第一部分单机中已经涉及安装配置,修改以下即可

cat /data/kafka-manager/conf/application.conf

kafka-manager.zkhosts="10.2.33.94:2181,10.2.33.95:2181,10.2.33.96:2181"

/data/kafka-manager/bin/kafka-manager -Dconfig.file=/data/kafka-manager/conf/application.conf -Dhttp.port=2182 & ##启动

访问http://10.2.33.94:2182/ 添加 hosts,需要填写集群信息