机器学习(一) K-近邻算法(KNN)

K-近邻算法(KNN)详解

- 机器学习(一):

-

- K-近邻算法(KNN)概述

- K-近邻算法的具体应用

- K-近邻算法的具体代码

- 使用K-邻近算法改进约会网站的配对效果

- 使用K-邻近算法实现手写识别系统

- 总结

机器学习(一):

K-近邻算法(KNN)概述

K-近邻算法采用测量不同特征值之间的距离方法进行分类。

优点:精度高、对异常值不灵敏、无数据输入假定

缺点:计算复杂度高、空间复杂度高

适用数据范围:数值型和标称型

其工作原理是:存在一个样本数据集合,也称作训练样本集,并且样本集中每个数据都存在标签 (lable),即我们知道样本集中每一位数据与所属分类的对应关系。输入没有标签的新数据后,将新数据的每个特征与样本集中数据对应的特征进行比较,然后算法提取样本集中特征最相似(最近邻)的分类标签。一般来说,我们只选择样本数据集中前k个最相似的数据,这就是k-近邻算法中k的出处,通常k是不大于20的整数。最后,选择k个最相似数据中出现次数最多的分类,作为新数据的分类。

K-近邻算法的一般流程:

(1)收集数据:可以使用任何方法。即获取样本。

(2)准备数据:距离计算所需要的数值,最好是结构化的数据格式。

(3)分析数据:可以使用任何方法。

(4)训练算法:此步骤不适用于k-近邻算法。即k-近邻算法不需要训练。

(5)测试算法:计算错误率。

(6)使用算法:首先需要输入样本数据和结构化的输出结果,然后运行k-近邻算法判定输入数据分别属于哪个分类,最后应用对计算出的分类执行后续的处理。

K-近邻算法的具体应用

下面有一个例子:

使用k-近邻算法去分类爱情片和动作片。图1-1显示了6部电影的打斗和接吻镜头数。那么我们要如何去区分这部新电影是爱情片还是动作片呢?我们可以尝试用k-近邻算法来解决这个问题。

具体接吻和打斗镜头数参见表1-1:

即使不知道未知的电影属于哪种类型,我们也可以通过某种方法计算出来。首先计算未知电影与样本集中其他电影的距离,如表1-2所示。(PS:Python实现电影分类应用时,会提供具体的算法)

现在我们已经得到了样本集中所有电影与未知电影的距离,按照距离递增排序,可以找到k个距离最近的电影(k一般不大于20)。假定k=3,则三个最靠近的电影依次为He’s Not Really into Dudes、Beautiful Woman和California Man。按照k-近邻算法,这三部电影都是爱情片,因此我们可以判定未知电影的类型是爱情片。

K-近邻算法的具体代码

def classify0(inX, dataSet, labels, k):

dataSetSize = dataSet.shape[0]

diffMat = tile(inX, (dataSetSize,1)) - dataSet

sqDiffMat = diffMat**2

sqDistances = sqDiffMat.sum(axis=1)

distances = sqDistances**0.5

sortedDistIndicies = distances.argsort()

classCount={}

for i in range(k):

voteIlabel = labels[sortedDistIndicies[i]]

classCount[voteIlabel] = classCount.get(voteIlabel,0) + 1

sortedClassCount = sorted(classCount.iteritems(),

key=operator.itemgetter(1), reverse=True)

return sortedClassCount[0][0]

classify0()函数有四个输入参数:用于分类的输入向量是inX,输入的训练样本级为dataSet,标签向量为lables,最后的参数k表示用于选择最近邻居的数目,其中标签向量的元素数目和矩阵dataSet的行数相同。

使用K-邻近算法改进约会网站的配对效果

这里有一个例子:一位名叫海伦的,想在约会网站寻找适合自己的约会对象。尽管约会网站一直在推荐不同的约会人选,但是海伦并不是很对这些人感兴趣。经过一番总结,发现她曾经交往过三种人:

第一种是不喜欢的人,第二种是魅力一般的人,第三种是极具魅力的人。

尽管有以上的数据,但是海伦依然无法将约会网站推荐的匹配对象归入恰当的分类。她觉得可以在周一到周五约会那些魅力一般的人,而周末则更喜欢和那些极具魅力的人为伴。那么问题来了:我们要如何更好地帮助她找到自己喜欢的类型呢?

以下是在约会网站上使用本算法的过程:

(1)收集数据:提供文本文件。

(2)准备数据:使用Python解析文本文件。

(3)分析数据:使用Matplotlib画二维扩散图。

(4)训练算法:k-近邻算法不需要训练。以下例子直接省略。

(5)测试算法:使用海伦提供的部分数据作为测试样本。

测试样本和非测试样本的区别在于:测试样本是已经完成分类的数据,如果预测分类和实际类别不同,则标记为一个错误。

(6)使用算法:产生简单的命令行程序,然后海伦可以输入一些特征以判断对方是否为自己喜欢的类型。

海伦的样本主要包含以下三种特征:

(1)每年获得的飞行常客里程数

(2)玩视频游戏所耗时间百分比

(3)每周消费的冰淇淋公升数

以下为具体的代码实现:

from numpy import *

import operator

# k-近邻算法

from pip._vendor.distlib.compat import raw_input

def classify0(inX, dataSet, labels, k): # 输入向量,训练数据,标签,参数k

dataSetSize = dataSet.shape[0] # 数据个数

diffMat = tile(inX, (dataSetSize, 1)) - dataSet # tile函数,求输入数据与训练数据对应值的相减

sqDiffMat = diffMat ** 2 # 平方

sqDistances = sqDiffMat.sum(axis=1) # 求和

distances = sqDistances ** 0.5 # 开根号

sortedDistIndicies = distances.argsort() # 返回数组值从小到大的索引

classCount = {} # 创建一个字典,用于记录每个实例对应的频数

for i in range(k):

voteIlabel = labels[sortedDistIndicies[i]] # 选择k个距离最小的点,对应标签

classCount[voteIlabel] = classCount.get(voteIlabel, 0) + 1 # 统计频数

sortedClassCount = sorted(classCount.items(), key=operator.itemgetter(1), reverse=True) # 排序,reverse=True降序

# python2中用iteritems

return sortedClassCount[0][0] # 返回最多的

# 将文本记录转换为Numpy

def file2matrix(filename):

fr = open(filename) # 打开文件

arrayOLines = fr.readlines()

numberOfLines = len(arrayOLines) # 得到文件行数

returnMat = zeros((numberOfLines, 3)) # 创建0填充的Numpy矩阵

classLabelVector = [] # 创建空列表

index = 0

for line in arrayOLines: # 循环处理文件中的每行数据

line = line.strip() # 使用strip函数,截取掉所有的回车字符

listFromLine = line.split('\t') # 将上一步得到的整行数据分割成一个元素列表

returnMat[index, :] = listFromLine[0:3] # 选取前3个元素,形成特征矩阵

classLabelVector.append(int(listFromLine[-1])) # 索引值-1选取列表中的最后一列,将其存储到classLabelVector中(必须明确告知存储元素值为整型)

index += 1

return returnMat, classLabelVector

# 测试

datingDataMat, datingLabels = file2matrix('D:/迅雷下载/machinelearninginaction/Ch02/datingTestSet2.txt')

# 归一化特征值

def autoNorm(dataSet):

minVals = dataSet.min(0) # 最小值 参数0是的函数可以从列中选取最小值

maxVals = dataSet.max(0) # 最大值

ranges = maxVals - minVals # 取值范围

normDateSet = zeros(shape(dataSet)) # 创建与dataSet同型的0填充矩阵

m = dataSet.shape[0] # 每列数据个数

normDateSet = dataSet - tile(minVals, (m, 1)) # 每列原来的数据减去没列最小值

normDateSet = normDateSet / tile(ranges, (m, 1)) # 除以取值范围

return normDateSet, ranges, minVals

# 测试

normMat, ranges, minVals = autoNorm(datingDataMat)

# 分类器针对约会网站的测试代码

def datingClassTest():

hoRatio = 0.10

datingDataMat, datingLabels = file2matrix('D:/迅雷下载/machinelearninginaction/Ch02/datingTestSet2.txt') # 读取数据

normMat, ranges, minVals = autoNorm(datingDataMat) # 归一化处理

m = normMat.shape[0]

numTestVecs = int(m * hoRatio) # 用于测试的数据

errorCount = 0

for i in range(numTestVecs):

classifierResult = classify0(normMat[i, :], normMat[numTestVecs:m, :], datingLabels[numTestVecs:m], 3) # 分类函数

print("the classifier came back with : %d, the real answer is : %d" % (classifierResult, datingLabels[i]))

if (classifierResult != datingLabels[i]):

errorCount += 1

print("the total error rate is : %f" % (errorCount / float(numTestVecs)))

# 测试

datingClassTest()

# 约会网站预测函数

def classifyPerson():

resultList = ['不喜欢的人', '魅力一般的人', '极具魅力的人']

percentTats = float(raw_input("玩视频游戏所耗时间百分比:"))

ffMiles = float(raw_input("每年获得的飞行常客里程数:"))

iceCream = float(raw_input("每年消费冰淇淋公升数:"))

datingDataMat, datingLabels = file2matrix("D:/迅雷下载/machinelearninginaction/Ch02/datingTestSet2.txt")

normMat, ranges, minVals = autoNorm(datingDataMat)

inArr = array([ffMiles, percentTats, iceCream])

classifierResult = classify0((inArr - minVals) / ranges, normMat, datingLabels, 3)

print("你对这个人的印象是:", resultList[classifierResult - 1])

# 测试

classifyPerson()

测试结果为:

最后一个函数为约会网站预测函数,手动输入10,10000,0.5即可看到预测结果,如下图所示:

使用K-邻近算法实现手写识别系统

(1)收集数据:准备手写数字的图片。

(2)准备数据:将图像转换为测试向量。

如图1-2所示,先将图像转化成32X32的二进制图像,然后再将其转换为1X1024的向量:

(3)测试算法:使用k-近邻算法识别手写数字。

具体代码为:

from numpy import *

import operator

from os import listdir

def classify0(inX, dataSet, labels, k): # 输入向量,训练数据,标签,参数k

dataSetSize = dataSet.shape[0] # 数据个数

diffMat = tile(inX, (dataSetSize, 1)) - dataSet # tile函数,求输入数据与训练数据对应值的相减

sqDiffMat = diffMat ** 2 # 平方

sqDistances = sqDiffMat.sum(axis=1) # 求和

distances = sqDistances ** 0.5 # 开根号

sortedDistIndicies = distances.argsort() # 返回数组值从小到大的索引

classCount = {} # 创建一个字典,用于记录每个实例对应的频数

for i in range(k):

voteIlabel = labels[sortedDistIndicies[i]] # 选择k个距离最小的点,对应标签

classCount[voteIlabel] = classCount.get(voteIlabel, 0) + 1 # 统计频数

sortedClassCount = sorted(classCount.items(), key=operator.itemgetter(1), reverse=True) # 排序,reverse=True降序

# python2中用iteritems

return sortedClassCount[0][0] # 返回最多的

def img2vector(filename):

returnVect = zeros((1,1024))

fr = open(filename)

for i in range(32):

lineStr = fr.readline()

for j in range(32):

returnVect[0,32*i+j] = int(lineStr[j])

return returnVect

def handwritingClassTest():

hwLabels = []

trainingFileList = listdir('D:\\迅雷下载\\machinelearninginaction\\Ch02\\trainingDigits') #此处为自己训练集的目录

m = len(trainingFileList)

trainingMat = zeros((m,1024))

for i in range(m):

fileNameStr = trainingFileList[i]

fileStr = fileNameStr.split('.')[0]

classNumStr = int(fileStr.split('_')[0])

hwLabels.append(classNumStr)

trainingMat[i,:] = img2vector('D:\\迅雷下载\\machinelearninginaction\\Ch02\\trainingDigits/%s' % fileNameStr)#此处为自己的文本数据目录

testFileList = listdir('D:\\迅雷下载\\machinelearninginaction\\Ch02\\testDigits') #此处为自己测试集的目录

errorCount = 0.0

mTest = len(testFileList)

for i in range(mTest):

fileNameStr = testFileList[i]

fileStr = fileNameStr.split('.')[0]

classNumStr = int(fileStr.split('_')[0])

vectorUnderTest = img2vector('D:\\迅雷下载\\machinelearninginaction\\Ch02\\testDigits/%s' % fileNameStr)#此处为自己测试集的目录

classifierResult = classify0(vectorUnderTest, trainingMat, hwLabels, 3)

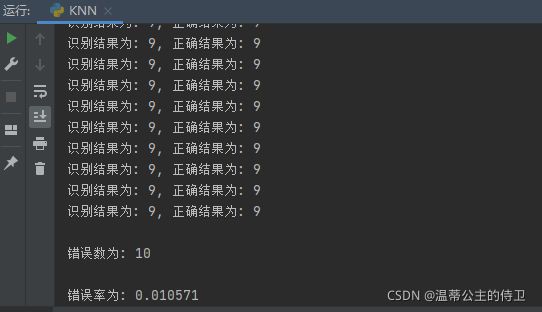

print ("识别结果为: %d, 正确结果为: %d"\

% (classifierResult, classNumStr))

if (classifierResult != classNumStr): errorCount += 1.0

print ("\n错误数为: %d" % errorCount)

print ("\n错误率为: %f" % (errorCount/float(mTest)))

if __name__ == '__main__':

handwritingClassTest()

运行结果为:

结果可见,错误率只有百分之一,还是非常可观的。

总结

k-近邻算法是分类数据最简单最有效的算法,本章通过两个例子讲述了如何使用k近邻算法构造分类器。k-近邻算法是基于实例的学习,使用算法时我们必须有接近实际数据的训练样本数据。k-近邻算法必须保存全部数据集,如果训练数据集的很大,必须使用大量的存储空间。此外,由于必须对数据集中的每个数据计算距离值,实际使用时可能非常耗时。

k-近邻算法的另一个缺陷是它无法给出任何数据的基础结构信息,因此我们也无法知晓平均实例样本和典型实例样本具有什么特征。