【20210305期AI简报】基于TensorRT完成NanoDet模型部署、Google AI发布TensorFlow 3D

导读:本期为 AI 简报 20210305 期,将为您带来 9 条相关新闻,新春过后第一弹,今日惊蛰,一侯桃始华~

本文一共 2900 字,通篇阅读结束需要 6~10 分钟

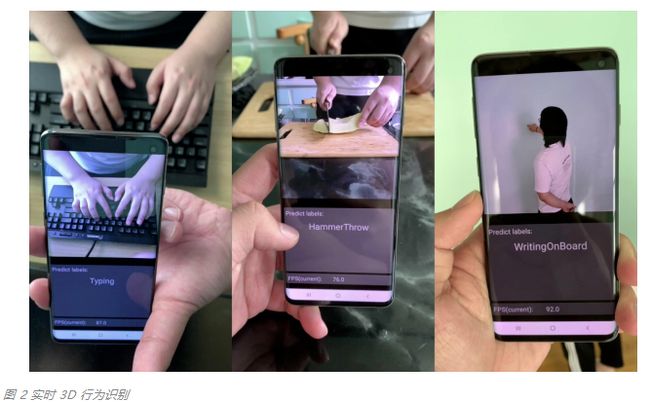

1. 每帧只需9ms,手机实时「三维动作识别」 | 机器之心

Model 与 codes 链接:

https://github.com/CoCoPIE-Pruning/CoCoPIE-ModelZoo

本文提出了一种用于三维卷积神经网络(3D CNN)的模型压缩和移动加速框架 RT3D,通过结合神经网络权重剪枝和编译器代码优化技术,使模型的端到端运行时间与目前支持 3D CNN 的移动框架相比速度提升高达 29.1 倍,准确性损失仅为 1%~1.5%。

当在手机上采用 C3D 或 R(2+1)D 模型时,可以在 150ms 内完成 16 帧视频的计算。

该工作由 CoCoPIE 团队:美国东北大学(Northeastern University)的王言治研究组、威廉与玛丽学院(William & Mary)的任彬研究组以及北卡罗来纳州立大学(North Carolina State University)的慎熙鹏研究组共同完成,发表于第 35 届美国人工智能协会年会(AAAI 2021)。

2. 前沿|这竟然不是阿汤哥?这个「真的吓人」视频火爆全网 |机器人大讲堂

图片项目地址:

https://github.com/iperov/DeepFaceLab/

近年来,人们对深度造假(deepfaking)既着迷又担忧。这项技术可以替换视频中的人脸,并利用机器学习使最终生成效果看起来非常逼真。

有些人用此创建了一些有趣的视频。

近日,一段有关好莱坞影星汤姆 · 克鲁斯打高尔夫球的深度造假视频在网络上迅速传播,第一眼看过去,很多人都认为是汤姆 · 克鲁斯本人。

这段视频的创建者为 TikTok 用户「deeptomcruise」。视频中的「阿汤哥」不仅长得极像,声音也几乎与本尊无异。这不是汤姆 · 克鲁斯第一次成为 deepfake 视频的主角,但这次依然让人惊艳。

火爆全网的「阿汤哥」视频使用的技术依然是我们熟悉的 DeepFaceLab。

DeepFaceLab 是制作 deepfake 视频时非常常用的软件,该 GitHub 项目目前已获得近 2.4 万颗星。DeepFaceLab 的特点是灵活、简单、扩展性强,并且具备 Windows、Colab、Linux 等多个版本。

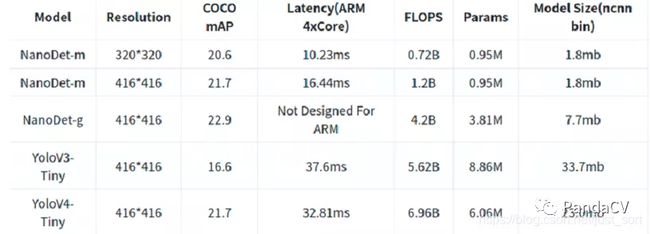

3. 基于TensorRT完成NanoDet模型部署 | PandaCV

本文为大家介绍了一个TensorRT int8 量化部署 NanoDet 模型的教程,并开源了全部代码。主要是教你如何搭建tensorrt环境,对pytorch模型做onnx格式转换,onnx模型做tensorrt int8量化,及对量化后的模型做推理,实测在1070显卡做到了2ms一帧!

NanoDet (https://github.com/RangiLyu/nanodet)是一个速度超快和轻量级的Anchor-free 目标检测模型;和yolov4 tiny作比较(如下图),精度相当,但速度却快了1倍;对于速度优先的场景,nanodet无疑是一个好的选择。

主要过程:

NanoDet 模型转换onnx

onnx模型转换为 int8 tensorrt引擎

tensorrt模型推理

4. 基于Caffe格式部署YOLOV5模型 | PandaCV

如果说目标检测落地最广的是哪个算法,yolo系列肯定有一席之地,本文为大家介绍yolov5s 4.0模型如何转换为caffe模型并推理,据我所知,华为海思NNIE只支持caffe模型的转换,所以yolov5模型要想在海思芯片上部署,转换为caffe模型是有必要的(在我的1070显卡上,yolov5s 4.0 的模型inference做到了11ms一帧!)

主要过程:

yolov5s模型转换onnx模型

onnx模型转换caffe模型

caffe模型推理

拓展:关于华为海思移植建议

5. 斯坦福连续发了四年的AI报告,今年讲了什么? |机器之心

报告下载地址:

https://aiindex.stanford.edu/report/

由斯坦福大学发起的人工智能指数(AI Index)是一个追踪 AI 动态和进展的非营利性项目,旨在全面研究 AI 行业状况,旨在促进基于数据的 AI 广泛交流和有效对话。

刚刚,AI Index 正式发布了 2021 年度报告。

2021 AI Index 报告极大地扩展了可用数据量,并与大量外部组织合作校准数据、深化该报告与 Stanford HAI 的联系。该报告还从多个方面展示了 COVID-19 对 AI 发展的影响。例如「技术表现」章节探讨了 AI 初创公司如何利用机器学习技术加速 COVID 相关药物研发;「经济」章节表明 AI 招聘和私人投资并未受到新冠大流行的严重影响,仍处于增长态势。

该报告共包括「研发」、「技术表现」、「经济」、「AI 教育」、「AI 应用的伦理挑战」、「AI 多样性」、「AI 政策与国家战略」七个部分。每个章节的核心内容请看原文。

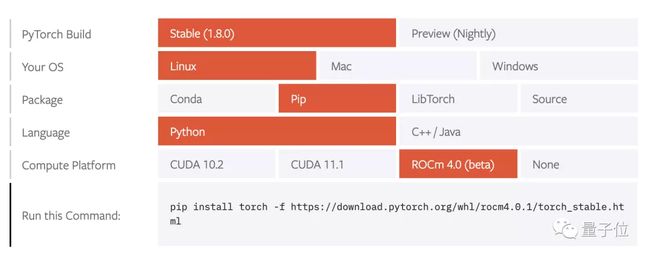

6. PyTorch 1.8来了!正式支持AMD GPU,炼丹不必NVIDIA | 量子位

原文链接:

https://pytorch.org/blog/pytorch-1.8-released/

1.8版本中,官方终于加入了对AMD ROCm的支持,可以方便的在原生环境下运行,不用去配置Docker了。

1.8版本集合了自2020年10月1.7发布以来的超过3000次GitHub提交。

此外,本次更新还有诸多亮点:

优化代码,更新编译器

Python内函数转换

增强分布式训练

新的移动端教程与演示

新的性能检测工具

相关的库TorchCSPRNG, TorchVision, TorchText和TorchAudio也会随之更新。

要注意的是,自1.6起,Pytorch新特性将分为Stable、Beta、Prototype三种版本。其中Prototype不会包含到稳定发行版中,需要从Nightly版本自行编译。

本次更新发布有图像分割模型DeepLabV3在安卓和IOS上的详细教程。

以及图像分割、目标检测、神经机器翻译等在安卓和IOS上的演示程序,方便大家更快上手。

7. 提速20倍!谷歌AI发布TensorFlow 3D,智能汽车场景亲测好用 | 新智元

Google AI发布了TensorFlow 3D,将3D深度学习能力引入TensorFlow,加入3D稀疏卷积网络,在Waymo Open数据集上的实验表明,这种实现比预先设计好的TensorFlow操作提速「20倍」。

近期,包括目标检测、透明目标检测等模型的3D场景理解方面取得了很大进展,但是由于3D数据可用的工具和资源有限,这个领域仍面临挑战。

为了进一步提高对3D场景的建模,简化研究人员的工作,Google AI发布了TensorFlow 3D (TF 3D) ,一个高度模块化、高效的库,旨在将3D深度学习能力引入TensorFlow.

TF 3D包含用于最先进的3D语义分割、3D目标检测和3D实例分割的培训和评估任务,还支持分布式训练。

另外,TF 3D还支持其他潜在的应用,如三维物体形状预测、点云配准和点云增密。此外,它提供了一个统一的数据集规范和训练、评价标准三维场景理解数据集的配置。

目前,TF 3D支持Waymo Open、 ScanNet和Rio数据集。

8. Transformer系列 | 更深、更强、更轻巧的Transformer,DeLighT | AI人工智能初学者

论文:DELIGHT: DEEP AND LIGHT-WEIGHT TRANSFORMER

github: https://github.com/sacmehta/delight

本文提出了一个更深更轻量的Transformer,DeLighT,DeLighT更有效地在每个Transformer Block中分配参数:

1)、使用DeLighT转换进行深度和轻量级的转换;

2)、使用Block-wise Scaling进行跨Block,允许在输入附近有较浅和较窄的DeLighT Block,以及在输出附近有较宽和较深的DeLighT Block。

总的来说,DeLighT网络的深度是标准Transformer的2.5到4倍,但参数和操作更少。在机器翻译和语言建模任务上的实验表明,DeLighT在提高了基准Transformer性能的基础上,平均减少了2到3倍的参数量。

9. 在家上名校——哈佛MIT等全套CS本科课程,为你备齐了! | 新智元

官方链接????:

https://github.com/ossu/computer-science#summary

参考链接:

https://github.com/ossu/computer-science#summary

想入门计算机科学?

想要系统的学习哈佛、普林斯顿、麻省理工的本科生拥有的顶尖课程资源?

还在为整理网上资源苦苦挣扎?

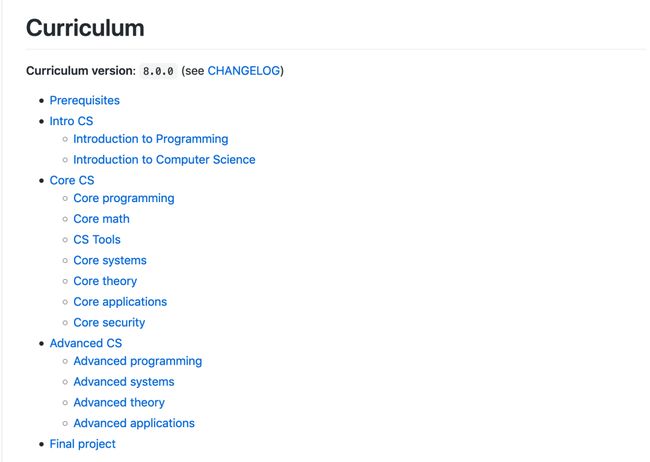

请看这,Github 上开源了一个「重磅项目」,OSSU(Open Source Society University),它提供了完整的计算机科学教育的在线材料,不仅仅是那些有着明确职业培训和职业发展的最强学习材料,还适用于那些想要在所有计算学科的基础概念上有一个适当、全面的基础的小伙伴。

全套计算机科学课程,是按照本科计算机科学专业的学位要求而设计的。

这些课程,都是世界上最好的课程之一,通常都来自于哈佛大学、普林斯顿大学、麻省理工大学等。

整门课的课程组织如下:

CS入门(Intro CS):让学生尝试CS,看看它是否适合他们

核心CS(Core CS):大致相当于计算机科学的前三年课程,均为必修课

高级CS(Advanced CS):大致相当于计算机科学课程的最后一年,均为选修课

毕业项目(Final Project):供学生验证、巩固和展示他们所学到的知识,并由世界各地的同来进行评估

其他

轻量级网络综述 — 主干网络篇

STM32 嵌入式机器学习(TinyML)实战教程-02

![]()

???????????? 点击阅读原文进入RT-Thread官网