HI3559算法移植之OpenCV图像拼接、配准和图像融合技术(三)

图像拼接比较经典的是SIFT、SURF、ORB等算法。其中SURF是SIFT的升级版,在实时性上要优于后者。本次先实现图片级的融合、拼接。

SURF的构建流程是:构建Hessian矩阵、H矩阵判别式、构建尺度空间、精确定位特征点、主方向确定、特征点描述子生成、误匹配点剔除、融合图像、优化连接处的图像。

//zjy 2021.7.19 周五 SURF图像融合

#include

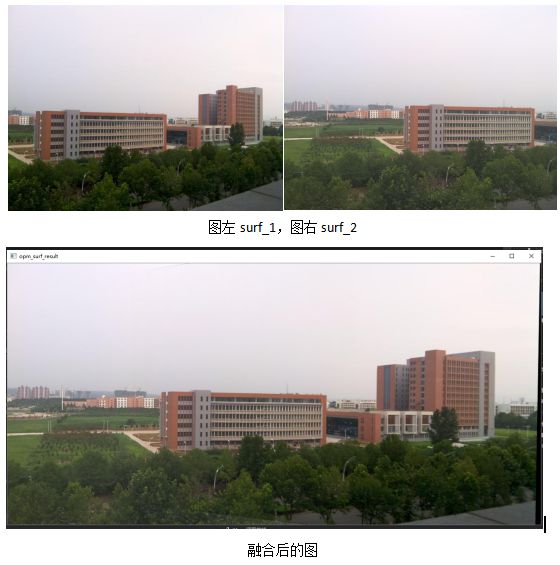

处理后的图片如上,图片是用别人的样本图片做的,自己采集时注意调整分辨率。做图像拼接的时候突然想到可能要往双目实时全景拼接上去做…增加难度。移植怎么搞???想到用定时采样的办法,也觉得不稳妥。

代码解析:

1、four_corners_t 这个结构:

这个结构是用来在后面进行图像拼接之前,实现图像的变换的时候使用的用来存放变换之后的图像的四个角的坐标。后面会有。

2、SURF特征检测和匹配的使用:

Ptr<SURF> surf; //创建方式和OpenCV2中的不一样,并且要加上命名空间xfreatures2d

//否则即使配置好了还是显示SURF为未声明的标识符

surf = SURF::create(800);

BFMatcher matcher; //实例化一个暴力匹配器

Mat c, d; //特征点描述矩阵

vector<KeyPoint> key1, key2; //特征点

vector<DMatch> matches; //DMatch是用来描述匹配好的一对特征点的类,包含这两个点之间的相关信息

//比如左图有个特征m,它和右图的特征点n最匹配,这个DMatch就记录它俩最匹配,并且还记录m和n的

//特征向量的距离和其他信息,这个距离在后面用来做筛选

//检测和计算图像的关键点和描述

surf->detectAndCompute(a, Mat(), key1, c);//输入图像,输入掩码用于屏蔽源图像中的特定区域,输入特征点矢量数组 ,存放所有特征点的描述向量

surf->detectAndCompute(b, Mat(), key2, d);//这个Mat行数为特征点的个数,列数为每个特征向量的尺寸,SURF是64(维)

定义一个surf,参数为门限值,调整这个可以调整检测精度,越大越高,不过相应的速度也会慢;detectAndCompute函数实现了检测特征点并计算特征描述矩阵存储到c, d中。

3、接下来的匹配类DMatch类:这个类存储了图像特征之间的匹配的信息:

CV_PROP_RW int queryIdx; // query descriptor index 查询Index

CV_PROP_RW int trainIdx; // train descriptor index 训练Index

CV_PROP_RW int imgIdx; // train image index label?

CV_PROP_RW float distance; //特征点之间的欧氏距离

对这个类还不是很理解,不过他这三个变量 queryIdx trainIdx distance还是比较重要的。distance不用说,两个特征点之间的距离,trainIdx应该是在训练分类器时输入训练的点的Index;queryIdx是在利用分类器做回归的时候对应的Index (两个不同的图片,一个用来训练,一个用来做测试,训练与测试(分类)的对应的特征点应该是对应的)。

根据欧氏距离选择匹配良好的点。

4、画出匹配结果

Mat outimg; //drawMatches这个函数直接画出摆在一起的图

drawMatches(b, key2, a, key1, good_matches, outimg, Scalar::all(-1), Scalar::all(-1), vector<char>(), DrawMatchesFlags::NOT_DRAW_SINGLE_POINTS); //绘制匹配点

imshow("combine", outimg);

5、提取到特征之后对2图像进行变换,投影到图像1下

首先在得到变换矩阵之前,先得到特征点的Point2f类型的坐标:

vector<Point2f> imagePoints1, imagePoints2;

for (int i = 0; i < good_matches.size(); i++)

{

imagePoints2.push_back(key2[good_matches[i].queryIdx].pt);

imagePoints1.push_back(key1[good_matches[i].trainIdx].pt);

}

6、

Mat homo = findHomography(imagePoints1, imagePoints2, RANSAC);//获取图像2到图像1的投影映射矩阵 3*3

//也可以使用getPerspectiveTransform方法获得透视变换矩阵,不过要求只能有4个点,效果稍差

//Mat homo=getPerspectiveTransform(imagePoints1,imagePoints2);

cout << "变换矩阵为:\n" << homo << endl << endl; //输出映射矩阵

//计算配准图的四个顶点坐标并输出

CalcCorners(homo, a);

cout << "left_top:" << corners.left_top << endl;

cout << "left_bottom:" << corners.left_bottom << endl;

cout << "right_top:" << corners.right_top << endl;

cout << "right_bottom:" << corners.right_bottom << endl;

//图像配准

Mat imageTransform1, imageTransform2;

warpPerspective(a, imageTransform1, homo, Size(MAX(corners.right_top.x, corners.right_bottom.x), b.rows));

//图像配准 warpPerspective 对图像进行透视变换 变换后矩阵的宽高都变化

//warpPerspective(a, imageTransform2, adjustMat*homo, Size(b.cols*1.3, b.rows*1.8));

imshow("orb_trans", imageTransform1);

imwrite("orb_trans.jpg", imageTransform1);

其中,calCorners利用的是齐次坐标系计算坐标面比较方便。warpPerspective是OpenCV自带的透视变换函数。

7、变换之后进行图像的复制,构成新的图片:

//创建拼接后的图,需提前计算图的大小

int dst_width = imageTransform1.cols; //取最右点的长度为拼接图的长度

int dst_height = b.rows;

Mat dst(dst_height, dst_width, CV_8UC3);

dst.setTo(0);

//构成图片

//复制img2到dist的右半部分 先复制transform2的图片(因为这个尺寸比较大,后来的图片可以覆盖到他)

imageTransform1.copyTo(dst(Rect(0, 0, imageTransform1.cols, imageTransform1.rows)));

b.copyTo(dst(Rect(0, 0, b.cols, b.rows)));

copyTo函数在不使用Mask参数时复制的话,将图片黑色部分忽略,仅复制有颜色的部分。也就是黑色会被替换掉。所以要先复制imgTransform2,这个里面会因为变换而产生许多黑色的部分,然后再复制img1(也就是在左边 ,没有变换的图像)过去覆盖掉黑色。反过来的话黑色会把它覆盖掉。

8、优化连接处

optimizeSeam函数来优化拼接,思想大概是alpha参数根据2图片(变化的图片,右侧的图片)与1重叠的位置来设置值,在重叠部分的值是由两个图片的像素值α加权得到的。注意下面的*3,因为RGB。

//优化两图的连接处,使得拼接自然

void OptimizeSeam(Mat& img1, Mat& trans, Mat& dst)

{

int start = MIN(corners.left_top.x, corners.left_bottom.x);//开始位置,即重叠区域的左边界

double processWidth = img1.cols - start;//重叠区域的宽度

int rows = dst.rows;

int cols = img1.cols; //注意,是列数*通道数

double alpha = 1; //img1中像素的权重

for (int i = 0; i < rows; i++)

{

uchar* p = img1.ptr<uchar>(i); //获取第i行的首地址

uchar* t = trans.ptr<uchar>(i);

uchar* d = dst.ptr<uchar>(i);

for (int j = start; j < cols; j++)

{

//如果遇到图像trans中无像素的黑点,则完全拷贝img1中的数据

if (t[j * 3] == 0 && t[j * 3 + 1] == 0 && t[j * 3 + 2] == 0)

{

alpha = 1;

}

else

{

//img1中像素的权重,与当前处理点距重叠区域左边界的距离成正比,实验证明,这种方法确实好

alpha = (processWidth - (j - start)) / processWidth;

}

d[j * 3] = p[j * 3] * alpha + t[j * 3] * (1 - alpha);

d[j * 3 + 1] = p[j * 3 + 1] * alpha + t[j * 3 + 1] * (1 - alpha);

d[j * 3 + 2] = p[j * 3 + 2] * alpha + t[j * 3 + 2] * (1 - alpha);

}

}

}

参考下面的博文比较多,要消化掉。

参考:https://blog.csdn.net/Architet_Yang/article/details/81274571