Unknown-Aware Object Detection:Learning What You Don’t Know from Videos in the Wild(未知目标检测)CVPR 2022

最前面是论文翻译,中间是背景+问题+方法步骤+实验过程,最后是文中的部分专业名词介绍(水平线分开,能力有限,部分翻译可能不太准确)

摘要:

构建能够检测出分布外(OOD)对象的可靠的目标检测器至关重要,但尚未得到充分的研究。关键的挑战之一是,模型缺乏来自未知数据的监督信号,导致对OOD对象的预测过于自信。我们提出了一种新的未知感知目标检测框架,通过时空未知蒸馏(STUD),从野生视频中提取未知对象,并有意义地规范化模型的决策边界。STUD首先在空间维度上识别未知的候选物体建议,然后将多个视频帧中的候选物体聚集起来,形成决策边界附近的多样化未知物体集。同时,我们采用了一种基于能量的不确定性正则化损失。它可以对比性地塑造内部分布和提炼的未知对象之间的不确定性空间。与之前的最佳方法相比,FPR95评分降低了10%以上。

1.引言

目标检测模型在已知的环境中已经取得了显著的成功。然而,他们经常与来自未知类的分布外(OOD)数据样本作斗争,网络在训练期间没有接触到这些数据,因此在测试中不应该被模型预测。教物体探测器识别未知物体对于建立可靠的视觉系统是至关重要的,特别是在安全关键的应用,如自动驾驶和医学分析。

虽然针对分类模型的OOD检测已经取得了很大的研究进展,但在目标检测方面的问题仍未得到充分的研究。与图像级OOD检测不同,检测未知对象需要对复杂场景有更细粒度的理解。在实践中,一个图像可以在特定区域是OOD,而在其他地方是分布中In-distribution (ID)。以自动驾驶为例,我们观察到一个训练来识别ID对象(如汽车、行人)的目标检测模型可以对一个看不见的对象(如鹿)产生高置信度的预测;见图1 (a)。当我们的目标检测器将其训练错误最小化而没有明确地考虑训练类别之外可能出现的不确定性时,就会发生这种情况。不幸的是,太多未知的方式在一个开放的世界中,可以出现无数的物体。它是在复杂的场景中注释大量的OOD对象是非常昂贵的—除了已经非常昂贵的ID数据收集过程。

(a) 过度自信的预测 (b) 视频中的未知对象

图1. (a) Vanilla物体检测器可以预测OOD物体(如鹿)为ID类(如行人),并具有很高的可信度。(b) 未知物体(在边界框内)自然存在于 视频数据集中自然存在,如广告牌、交通锥、天桥、路灯等。灯,等等。图片取自BDD100K数据集。

在本文中,我们提出了一种新的未知感知目标检测框架,通过时空未知蒸馏(STUD),从野外视频中提取未知对象,并有意义地正则化模型的决策边界。视频数据自然地捕获了模型运行的开放世界环境,并封装了已知和未知对象的混合物;见图1 (b)。例如,建筑和树木(OOD)可能出现在驾驶视频中,尽管它们没有明确标记用于训练车辆和行人的物体检测器(ID)。我们的方法类似于化学中的蒸馏概念,是指“从混合物中分离物质的过程”。虽然经典的目标检测模型主要使用标记的已知对象进行训练,我们试图通过联合优化目标检测和OOD检测性能,利用未知的模型正则化。

具体地说,我们的框架由两个部分组成,解决的挑战是(1)从视频中提取不同的未知对象,(2)用提取的未知对象正则化目标检测器。为了解决第一个问题,我们引入了一种新的时空未知提取方法,它可以自动构造各种未知对象(3.1节)。在空间维度上,对于一帧中的每个ID对象,我们基于OOD测量来识别参照系中的未知候选对象。然后,我们通过线性组合选定的目标在特征空间,加权提取未知目标通过差异度量。因此,与使用单个对象相比,提取的未知对象在多个对象上捕获了更多样化的分布。在时间维度上,我们提出从多个视频帧中聚集未知对象,从而获得额外的多样性时间维度上的未知。

利用提取出来的未知对象,我们进一步使用一个未知感知的训练目标(第3.2节)。与普通的目标检测不同,我们用不确定性正则化分支训练目标检测器。我们的正则化有助于学习ID和OOD对象之间更保守的决策边界,这有助于在推断期间标记不可见的OOD对象。为了实现这一点,正则化对比地塑造了不确定面,这为ID对象产生了更大的概率分数,反之亦然,使测试中有效的OOD检测成为可能。我们的主要贡献总结如下:

我们提出了一个新的框架STUD,解决了未知感知目标检测的一个具有挑战性的问题。据我们所知,我们是第一个利用视频中丰富的信息来实现OOD识别的目标检测模型。

STUD通过在空间和时间维度上提取不同的未知对象,而无需昂贵的OOD对象人工注释,从而有效地规范化目标检测器。此外,我们表明STUD比在高维像素空间合成未知量(例如,使用GAN)或使用负建议作为未知量更有优势。

我们在大规模BDD100K和Youtube-VIS数据集上广泛评估了拟议的STUD。STUD获得了最先进的结果,在很大程度上超过了最佳基线(FPR95在BDD100K上为10.88%),同时保持了对ID数据目标检测的准确性。

2. 问题设置

我们首先为目标检测任务制定OOD检测问题。大多数以前的OOD检测公式将整个图像视为异常,这可能会导致如图1(a)所示的模糊性。特别是,自然图像不是单一的实体,而是由许多对象和组件组成的。知道图像的哪些区域是异常的,可以安全处理不熟悉的物体。与图像级OOD检测相比,对象级OOD检测在现实感知系统中更相关,但也更具有挑战性,因为它需要在细粒度对象级上推理OOD的不确定性。我们设计了可靠的目标检测器,可以在测试中识别未知OOD对象。也就是说,在ID类别(如汽车、卡车)上训练的目标检测器可以识别不属于训练类别的测试时对象(如鹿),并且不能对它们做出自信的预测。

设置。我们分别用X=rd和Y={1,2,…,K}表示输入和标签空间。让x∈ X是输入图像,b∈ R 4是与图像中的对象相关联的边界框坐标,y∈ Y是对象的语义标签。在从未知联合分布P中提取的ID数据D={(x i,b i,y i)}M i=1上训练目标检测模型。我们使用带参数θ的神经网络来建模边界盒回归Pθ(b | x)和分类Pθ(y | x,b)。

面向目标检测用于目标检测。OOD检测可以表述为一个二元分类问题,区分分布内和分布外的对象。设px表示X上的边际概率分布。给定测试输入X∗ ∼ P X以及对象b∗ 由目标检测器预测,目标是预测pθ(g | x∗ ,b∗ )。我们使用g=1表示检测到的对象是ID,g=0表示OOD,语义不支持Y。

3.未知感知目标检测

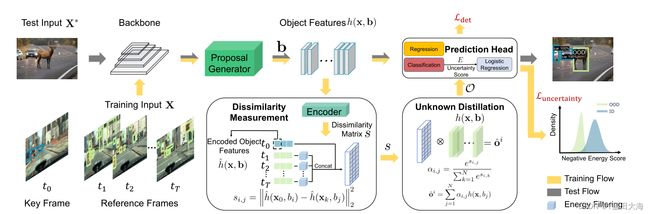

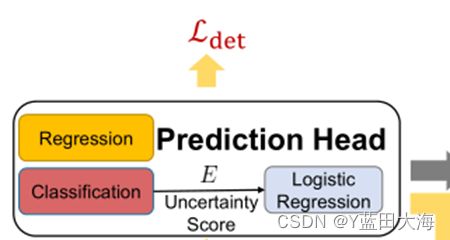

我们的未知感知目标检测框架与面向对象不确定性正则化分支一起训练目标检测器。两者共享特征提取器和预测头,并从头开始联合训练(见图2)。我们的框架包含两个新的组件,它们涉及:(1)如何在空间和时间维度提取各种未知对象(第3.1节),以及(2)如何利用未知对象进行有效的模型正则化(第3.2节)。

图2. 拟议的未知物体检测框架STUD概述。对于一个来自关键帧的ID对象编码为 ˆ h(x 0 ,b i ),我们进行能量过滤,以识别参考帧中的未知对象候选者。然后,我们通过线性组合特征空间中的未知对象来提炼出未知对象ô i,并以异同得分s i,j加权。蒸馏出来的未知物体和ID物体一起被用来训练不确定性正则化分支(L uncertainty )。L不确定性对比性地塑造了不确定性表面,对ID对象产生较大的分数,反之亦然。在测试过程中,我们使用逻辑回归的输出进行OOD检测。⊗表示方程(3)中的运算,1≤k≤T是参考框架的索引。

3.1时空未知蒸馏

我们的方法是在视频中丰富的时空信息的引导下提取未知对象,没有未知对象的明确监督信号。视频数据自然地封装了已知和未知对象的混合物。虽然经典的目标检测模型主要使用标记的已知对象进行训练,但我们试图利用未知对象进行模型正则化。因此,我们将我们的方法称为未知蒸馏,即用已知对象来提取未知对象。值得注意的是,我们的目标检测蒸馏过程是在目标级别执行的,而不是构造图像级别的异常值。也就是说,对于给定帧中的每个ID对象,我们构造了相应的OOD对应项。提取的未知数将用于模型正则化(第3.2节)。

虽然直觉很简单,但在以无监督的方式构造未知对象方面存在挑战。未知物体在高维空间中出现的方式数不胜数。以ID对象汽车为例(c.f.图3),广告牌、树木、建筑物等对象都可以被视为汽车的未知数。这不必要地增加了样本的复杂性,并要求观察各种未知对象。我们通过利用视频的时空维度中的丰富信息来提取各种未知对象来应对这一挑战。

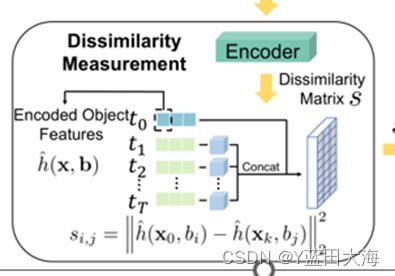

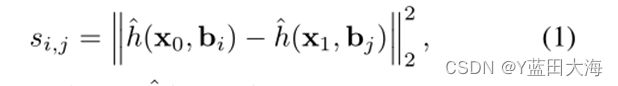

空间未知蒸馏。在空间维度上,对于给定帧中的每个ID对象,我们通过参考帧中的对象特征的线性组合,通过相异性度量加权,创建未知的对应对象。与使用单个对象相比,使用多个对象捕获的未知量分布更为多样。STUD对提案生成器的特征输出进行操作,以计算相异性。具体来说,我们考虑时间戳t 0和t 1处的一对帧x 0、x 1,分别指定为关键帧和参考帧。对于对象(x,b),我们将其特征表示为h(x,b)∈ R m,其中m是特征尺寸。我们收集了一组对象特征{h(x 0,b i)}N 0i=1和{h(x 1,b j)}N 1 j=1,客观评分高于阈值。我们使用L 2采用相异性测量两个特征之间的距离:

其中ˆh(x 0,b i)和ˆh(x 1,b j)是由使用对象特征h(x,b)作为输入的小型网络获得的编码特征向量。在我们的实验中,编码器由两个内核大小为3×3的卷积层和一个平均池层组成。s i,j越大,物体特征越不相似。相异性测量结果如图3所示。参考框架中的OOD对象,如路灯和广告牌,具有更显著的差异。

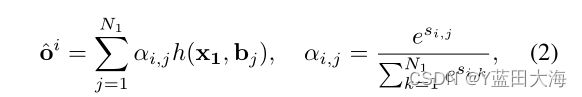

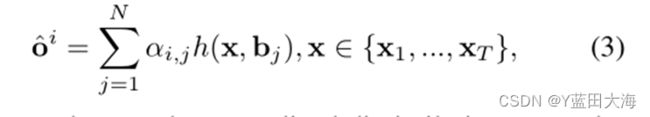

最后,我们对x 1帧中的对象特征进行加权平均。使用多个对象捕获未知量的不同分布。权重α定义为不相似性得分的归一化指数:

其中ôi是提取的未知对象(在特征空间中),对应于第x 0帧处的第i个对象。

时间未知蒸馏。我们的空间未知提取机制在单个参考帧上运行,该参考帧可以扩展到多个视频帧,以捕获时间维度中未知量的额外多样性。例如,假设一个汽车在高速公路上行驶的视频,我们观察到的帧越多,可以观察到的未知对象就越多,例如树木、建筑物和岩石。

给定时间戳为t 0的帧x 0,我们建议从多个帧x 1,…,x t中提取未知对象。我们在[t 0]范围内随机采样t帧−R、 t 0+R]。作为特例,T=1减少到先前的pairframe设置。为了提取时空未知对象,我们将T帧中的对象特征向量串联起来,然后通过等式(1)测量它们与x 0帧中的对象的相异性。对于第x 0帧中的第i个对象,未知对应物定义如下:

其中,αi,j表示等式2中定义的归一化不相似性分数。N=P T k=1 N k是跨越T个参考帧的对象总数。时间聚合机制允许在多个帧中搜索有意义和多样的未知发现。

在第4.3节的后面,我们对帧采样范围R和选定帧的数量T进行了全面的烧蚀研究,并展示了时间聚集对改进的OOD检测的好处。

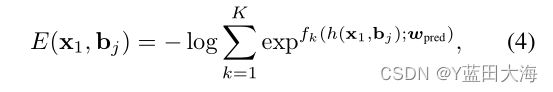

未知候选对象选择。未知提取的一个关键步骤是过滤参考坐标系x 1中的未知量,这些未知量可能是ID对象或简单背景。如果没有选择,模型可能会被混淆,从而将提取出的未知对象从ID对象中分离出来,或者在训练过程中快速记忆简单的OOD模式。为了防止这种情况,我们基于能量分数对提议进行预过滤,然后将选定的提议用于时空未知蒸馏。结果表明,能量分数是图像分类中面向对象数据的有效指标[36]。为了计算目标检测网络的能量分数,我们将目标特征{h(x 1,b j)}N 1 j=1馈送到预测头,并遵循以下定义:

式中,f k(h(x 1,b j);w pred)是kway分类分支的logit输出。能量越高,则表示能量越大,反之亦然。然后,我们选择能量分数较低的对象,即在特定百分比p%的对象≤ 秩(E(x 1,b j))/N 1≤ 所有对象中的q%。在多个帧x 1,x 2,…,x T的情况下,在时间聚集之前对每个单独的帧执行对象选择。烧蚀研究能量过滤和第4.3节提供了选择百分比。

3.2未知意识训练目标

利用第3.1节提取的未知对象,我们现在介绍未知感知目标检测的训练目标。我们的关键思想是在正则化模型的同时执行目标检测任务,以产生ID对象的低不确定性分数,以及高的不确定性分数未知项的不确定性分数。总体目标函数定义为:

其中,β是结合检测损失L det和不确定性正则化损失L不确定性时的标度权重。接下来,我们描述L不确定性的细节。

不确定性正则化。继Du等人之后,我们采用了一个损失函数,对比塑造了不确定性表面,放大了已知ID对象和未知OOD对象之间的可分性。为了测量不确定性,我们使用等式(4)中的能量分数,该分数来自分类分支的输出。在这里,我们计算ID对象和提取的未知对象特征E(ô)的能量分数E(x,b)。然后将不确定性分数传递到具有权重系数θu的logistic回归分类器,该分类器预测ID对象(x,b)的高概率和未知对象的低概率。正则化损失计算如下:

其中O包含所有未知物体特征(c.f.第3.1节)。在图4(a)中,我们显示了Youtube VIS数据集上训练过程中的不确定性正则化损失。收敛后,图4(b)显示了ID和提取的未知对象的能量分数分布。这表明STUD正确收敛,能够分离提取的未知对象和ID对象。

图4. (a) 训练期间的不确定性正则化损失。(b) 训练后ID和提炼的未知物体的负能量得分分布。

与普通目标检测器的L det相比,我们的损失旨在帮助学习ID和OOD对象之间更保守的决策边界,这有助于在测试中标记未看到的OOD对象。我们继续描述测试时OOD检测过程。

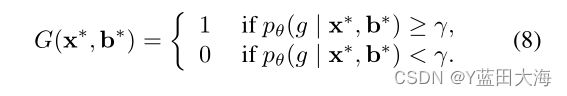

测试时间OOD检测。在推理过程中,我们使用logistic回归不确定性分支的输出进行OOD检测。特别是,给定测试输入x∗ , 物体检测器产生盒子预测b∗ . 预测对象的不确定性分数(x∗ ,b∗ ) 由以下公式得出:

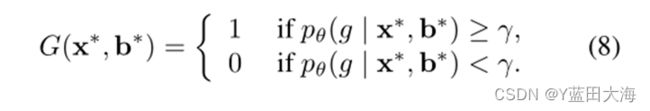

对于OOD检测,我们使用通用阈值机制来区分ID和OOD对象:

通常选择阈值γ,以便正确分类高比例的ID数据(例如95%)。对于分类为ID的对象,可以像往常一样使用预测头获得边界框和类预测。我们的方法研究总结在算法1中。

未知蒸馏和对比正则化之间的协同作用。STUD未知蒸馏(第3.1节)和对比正则化(第3.2节)的两个关键组件协同工作。首先,一组提取良好的未知对象可以改进基于能量的对比正则化,并帮助学习已知和未知对象之间更准确的决策边界。其次,由于对比不确定性损失扩大了已知对象和未知对象之间的能量差距,未知蒸馏模块可以受益于更准确的未知对象选择(通过基于能量的滤波)。当这两个部分的表现令人满意时,整个训练过程收敛。我们在第4节中的实验进一步证明了我们的框架的有效性。

4、实验

在本节中,我们提供了实证证据,以证明研究在两个大规模视频数据集上的有效性(第4.1节)。我们在第4.2节中表明,在检测OOD数据方面,STUD优于其他常用的OOD检测基线。第4.3节和第4.4节介绍了STUD的消融研究和定性分析。

4.1基准建设

数据集。我们使用两个大规模视频数据集作为ID数据:BDD100K和Youtube视频实例分割(Youtube VIS)2021。对于这两项任务,我们在两个包含不同视觉类别的OOD数据集上进行评估:MS-COCO和nuImages。我们仔细执行重复数据消除,以确保ID和OOD数据之间没有语义重叠。附录中描述了有关数据集的详细信息。

实施细节。我们采用更快的R-CNN作为基本目标检测器。我们使用Detectro2库,并使用ResNet-50[15]主干和默认超参数进行训练。对于BDD100K,我们将L不确定性的权重β设置为0.05,对于Youtube VIS数据集,我们将其设置为0.02。对于这两个数据集,我们使用T=3帧,并将采样范围R=9。我们将能量过滤的百分数设定为所有提案中的40%-60%。第4.3节详细介绍了不同超参数的烧蚀研究。

度量。为了评估OOD检测性能,我们报告:(1)当ID样本的真阳性率为95%时,OOD样本的假阳性率(FPR95);(2) 接收器工作特性曲线下的面积(AUROC)。为了评估ID任务上的目标检测性能,我们报告了mAP的通用度量。

4.2与基线的比较

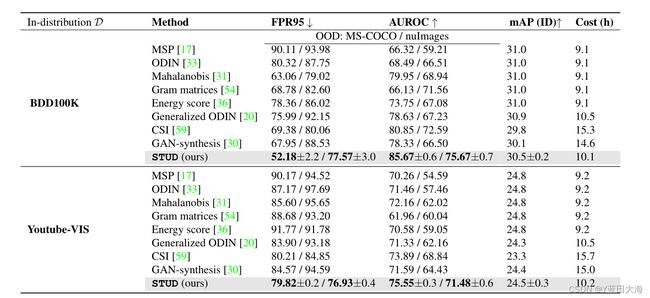

STUD建立SOTA性能。在表1中,我们将STUD与文献中有竞争力的OOD检测方法进行了比较,其中STUD在两个数据集上都显著优于基线。为了公平比较,所有方法都使用相同的ID训练数据,使用相同的历元数进行训练。我们的综合基线包括最大Softmax概率[17]、ODIN[33]、Mahalanobis距离[31]、广义ODIN[20]、能量分数[36]、Gram矩阵[54]和最新方法CSI[59]。这些基线依赖于分类输出或主干特征,因此可以在目标检测模型上无缝评估。

表1. 主要结果。与竞争性分布外检测方法的比较。所有基线方法都是基于一个模型使用ResNet-50作为主干,仅对ID数据进行训练。↑表示数值越大越好,↓表示数值越小越好。所有值都是百分比。粗体数字是卓越的结果。我们报告了在三次运行中估计的标准偏差。训练时间是 在 "成本 "一栏中报告了四个NVIDIA GeForce RTX 2080Ti GPU的训练时间。

结果表明,考虑到大多数基线依赖于仅基于ID数据训练的目标检测模型,而不受未知对象的正则化,因此STUD可以优于这些基线。这种训练方案容易对OOD数据产生过度自信的预测(图1),而STUD结合未知对象以更有效地正则化模型。

我们还与基于GAN的方法进行了比较,用于在像素空间中合成异常值,其中,在BDD100K(COCO作为OOD)上,STUD有效地将OOD检测性能(FPR95)提高了15.77%,在Youtube VIS(nuImages作为OOD)上提高了17.66%。此外,我们在表1中表明,在保持ID数据(通过mAP测量)的高目标检测精度的同时,STUD实现了更强的OOD检测性能。这与CSI相反,CSI显示出显著的退化,Youtube VIS上的地图减少了1.2%。复制基线的详细信息见附录D节。

4.3消融研究

本节提供了全面的消融研究,以了解STUD的效果了一致性,所有消融均在BDD100K数据集上进行,使用ResNet-50作为主干。有关使用不同主干架构的更多信息,请参阅附录E节。

不同未知蒸馏方法的烧蚀。我们将STUD与三种未知蒸馏方法进行了比较,即,(一)使用没有时空聚集的独立对象,(II)合成像素空间中的未知数,(III)使用噪声作为未知量。

对于I型,我们利用参考框架中的对象,而不在空间和时间维度上聚合多个对象,这是与STUD的关键区别。未知对象可以通过以下方式构建:使用参考框架中差异最大的对象,使用随机对象,使用[23]中的负数对象。以及使用参考框架中能量得分较低的对象(百分位数40%-60%)。

对于第二类,我们考虑了基于GAN的[30]和基于mixup的的方法。对于[30],合成图像中的物体的分类输出被强制为更接近于均匀分布。对于mixup,我们使用Beta(1)的β分布,并在参考帧的像素空间内插值ID对象。

对于第三类,我们在ID对象上添加固定的高斯噪声,以创造未知的对象特征。

结果总结在表2中,其中STUD优于其他方法。由于生成的未知数要么缺乏多样性(例如,使用相异性最大的对象或能量适中的对象),要么过于简单,无法有效地正则化ID和OOD之间的决策边界(例如,使用负或负)随机对象)。在像素空间中合成未知数(♣) 不稳定(GAN)或对目标检测性能有害(混合)。最后,作为未知数的高斯噪声相对简单,并不优于STUD。

表2. 不同的未知蒸馏方法的消融(以ResNet-50为骨干,COCO/nuImages为OOD数据)。

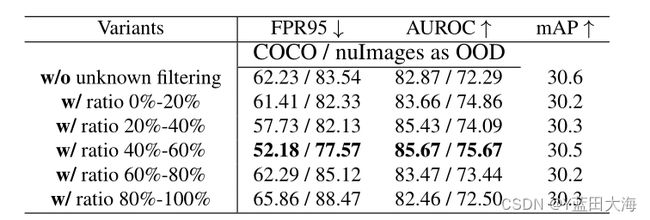

烧蚀对候选对象选择的影响。表3研究了基于能量分数过滤未知对象的重要性。我们通过删除过滤或使用不同的过滤百分比来对比性能(c.f.第3.1节)。在参考帧中使用能量分数较低的对象表现最好。该策略以适当的难度提取未知对象,在对比不确定性正则化过程中有效。

表3. 能量过滤模块的消融研究。这里我们设定T=3,R=9。

我们的空间-时间未知数蒸馏需要将T个参考帧中的物体连接起来。我们消除了在不同时间范围内随机选择T个框架对关键框架的影响,由采样范围R来调节。我们观察到,OOD检测得益于使用与关键帧略微接近的参考帧。这一趋势在COCO和nuImages OOD数据集上是一致的。更大的采样范围意味着更多的不同场景,导致相对更容易的未知数被提炼出来。当R变成无穷大时,STUD从整个视频中随机取样,在这种情况下,提炼未知数的效果要差得多,AUROC明显下降(从COCO的85.67%下降到80.35%)。

我们对比了不同参考帧数T下的性能,并在图5(c)-(d)中报告了OOD检测结果。这种消减表明,STUD确实从跨时间维度的多帧物体的聚集中获益。例如,与T=1相比,在BDD100K上训练的T=3的模型实现了5.24%的AUROC改善(COCO作为OOD)。这突出了 多帧的时间提炼的重要性。然而,较大的T损害了OOD的检测性能。我们假设这是因为在未知蒸馏过程中使用了许多冗余的物体特征。

图5. (a)-(b) 对取样范围R的消融研究。我们的范围从3到无穷大。衡量标准是AUROC。(c)-(d) 在未知蒸馏过程中对参考帧数T的消融研究。我们固定采样范围为R=9。

对不确定性正则化权重β的消融。表4报告了当我们改变L不确定性的权重β时的OOD检测结果。该模型在COCO和nuImages数据集上都被评估为OOD。结果表明,一个温和的权重是可取的。在大多数情况下。STUD在AUROC方面优于表1中的基线OOD检测方法。

表4。不确定性正则化损失的权重β烧蚀研究。在这种情况下,我们设置T=3,R=9。

对不确定的损失进行消融。我们对L不确定性的三种选择进行消减:(1)使用平方铰链损失,(2)在分类分支中将未知数分类为额外的K+1类,(3)去除L不确定性中的权重θ u。表5总结了这一比较。与铰链损失相比,我们的逻辑损失将AUROC提高了11.35%(COCO为OOD)。此外,将蒸馏出的未知数作为一个额外的类别,增加了对象分类的难度,这也没有超越其他的表现。此外,可学习的权重θ u调节了logistic函数的斜率,这使得学习一个更尖锐的二元决策边界以实现最佳的ID-OOD分离。这种消融证明了STUD所采用的不确定性损失的优越性。

表5.不确定性正则化损失的烧蚀研究。

4.4定性分析

这里我们进一步介绍对实例级OOD检测结果的定性分析。在图6中,我们可视化了对几张OOD图像的预测,使用没有蒸馏过的未知物体(顶部)和有STUD(底部)训练的物体检测模型。ID数据为BDD100K。与普通的物体检测器相比,STUD在识别OOD物体(绿色)方面表现得更好,并减少了检测到的物体中的假阳性。此外,STUD的假阳性物体的置信度得分低于虚构模型(例如,第三列中的岩石)。

图6. 通过vanilla Faster-RCN(顶部)和STUD(底部)在OOD图像(来自MS-COCO和nuImages)上检测物体的可视化。ID为BDD100K数据集。蓝色。OOD物体被分类为ID类之一。绿色。由STUD检测的OOD对象。探测到的对象中,减少假阳性。更多的可视化内容见附录F部分。

5、相关工作

用于分类的OOD检测大致可分为事后检测、基于生成的方法和基于离群点暴露(OE)的方法。对于事后方法,softmax置信度得分是一个常见的基线,对于OOD输入来说,它可以是任意高的。已经提出了一些改进方法,如ODIN、Mahalanobis、能量得分、Gram矩阵得分和GradNorm得分。离群点暴露方法利用自然图像或由GANs合成的图像进行正则化。然而,真正的离群点数据很难获得,特别是对于物体检测。相比之下,STUD从视频中自动提炼出未知数,这使其具有更大的灵活性。生成模型直接估计ID密度,这使它们成为OD检测的自然替代方案。然而,与基于判别的方法相比,它们通常没有竞争力,而且通常更难优化。最近,Sun等人表明,一个简单的激活整顿策略,即ReAct,可以显著提高测试时间的OOD检测。关于不同的事后检测方法的理论理解OOD检测方法的理论理解见[44]。[56,59] 应用自我监督学习进行OOD检测,我们在第4.2节进行了比较。

用于物体检测的OOD检测目前还没有得到充分的探索。Du等人提出在特征空间中合成虚拟离群点以实现有效的模型正则化,并证明了OOD检测在物体检测方面的前景。本文中,STUD专注于借助视频进行OOD检测,并采用了一种未知的训练损失。此外,[23]使用负面的物体作为未知样本,正如我们在表2中显示的那样,这是次优的。Harakeh等人专注于定位分支的不确定性估计,而不是分类问题的OOD检测。有几项工作使用了近似的贝叶斯方法,如MC-Dropout用于OOD检测。他们需要多个推理过程来生成不确定性分数,这在较大的数据集和模型上计算成本很高。对较大的数据集和模型来说是昂贵的。

开放世界的物体检测包括OOD泛化、零照物体检测和增量物体检测等。一般来说,他们开发了缓解灾难性遗忘的措施,或者使用辅助信息,如类属性,来对未见过的数据进行目标检测——这两点都与我们的OOD检测重点不同。Wang等人在循环前进步骤中采用了异同度测量,但他们的重点是OOD泛化(标签空间保持不变)而不是OOD检测。此外,它没有考虑聚合多帧的时间信息。

视频异常检测(VAD)旨在通过骨架轨迹建模、弱监督学习、注意力、时间姿态图、自我监督学习和自动编码器等技术来识别对象层面和帧层面的异常事件。与STUD相比,VAD中的异常点不一定与ID训练数据有不同的语义。此外,这些方法都没有考虑在视频或基于能量的模型正则化的帮助下合成未知数。

6、结论

在本文中,我们提出了STUD,一个用于OOD检测的未知目标检测框架。STUD通过利用视频中丰富的时空信息,在训练期间提炼出不同的未知物体。经过提炼的未知物体有意义地改善了ID和OOD数据之间的决策边界,从而在保留ID任务性能的同时获得了最先进的OOD检测性能。我们希望我们的工作将激励未来的研究,在现实世界的环境中实现未知的深度学习。

背景:

1.构建能够检测出分布外(OOD)对象的可靠的目标检测器至关重要,但尚未得到充分的研究。 关键的挑战之一是,模型缺乏来自未知数据的监督信号,导致对OOD对象的预测过于自信。

2.针对分类模型的OOD检测已经取得了很大的研究进展,在目标检测方面的问题仍未得到充分的研究。

问题:

模型缺乏来自未知数据的监督信号,导致对OOD对象的预测过于自信,(比如自动驾驶时将鹿自信的识别为人), OOD目标太多,标记价格昂贵。

OOD预测过于自信原因:目标检测器最小化训练误差却没有明确考虑训练类别之外出现的不确定性。

方法:

我们提出了一种新的未知感知目标检测框架,通过时空未知蒸馏(STUD),①通过在空间和时间维度上从野外视频提取(蒸馏)未知对象,②用不确定性正则化分支训练目标检测器,有意义地规范了模型的决策边界。③试图通过联合优化目标检测和OOD检测性能用于模型正则化。

整体:框架+损失函数。框架由两个部分组成,解决的挑战是1.从视频中提取不同的未知对象,2.用提取的未知对象正则化目标检测器。

挑战1解决办法:引入了一种新的时空未知提取方法,从空间和时间两个维度自动构造各种未知对象。

挑战2解决办法:进一步使用未知感知的训练目标。与普通的目标检测不同,我们用不确定性正则化分支训练目标检测器。

损失函数:由于对比不确定性损失扩大了已知对象和未知对象之间的能量差距,未知蒸馏模块可以受益于更准确的未知对象选择(通过基于能量的滤波)

步骤:

我们的未知感知目标检测框架与面向对象不确定性正则化分支一起训练目标检测器。两者共享特征提取器和预测头,并从头开始联合训练。我们的框架包含两个新的组件,它们涉及:(1)如何在空间和时间维度提取各种未知对象以及(2)如何利用未知对象进行有效的模型正则化。

对于一个来自关键帧的ID对象编码为 hˆ (x 0 ,b i ),我们进行能量过滤,以识别参考帧中的未知对象候选者。然后,我们通过线性组合特征空间中的未知对象来提炼出未知对象ô i,并以异同得分s i,j加权。蒸馏出来的未知物体和ID物体一起被用来训练不确定性正则化分支(L uncertainty )。L uncertainty对比性地塑造了不确定性表面,对ID对象产生较大的分数,反之亦然。在测试过程中,我们使用逻辑回归的输出进行OOD检测。⊗表示方程(3)中的运算,1≤k≤T是参考框架的索引。

采用相异性测量两个特征之间的距离, hˆ(x 0,b i)和ˆh(x 1,b j)是由使用对象特征h(x,b)作为输入的小型网络获得的编码特征向量

在空间维度上,对于给定帧中的每个ID对象,我们通过参考帧中的对象特征的线性组合,通过相异性度量加权,创建未知的对应对象

我们对x1帧中的对象特征进行加权平均。使用多个对象捕获未知量的不同分布。权重α定义为不相似性得分的归一化指数

其中ôi是提取的未知对象(在特征空间中),对应于第x 0帧处的第i个对象。

空间未知提取机制在单个参考帧上运行,该参考帧可以扩展到多个视频帧。

αi,j表示等式2中定义的归一化不相似性分数。N=P T k=1 N k是跨越T个参考帧的对象总数。时间聚合机制允许在多个帧中搜索有意义和多样的未知发现。

未知候选对象选择。基于能量分数对提议进行预过滤,然后将选定的提议用于时空未知蒸馏。

能量分数是图像分类中面向对象数据的有效指标。为了计算目标检测网络的能量分数,我们将目标特征{h(x 1,b j)}N 1 j=1馈送到预测头,并遵循式子定义:

f k(h(x 1,b j);w pred)是kway分类分支的logit输出。能量越高,则表示能量越大,反之亦然。

总体目标函数定义为越高,则表示能量越大,反之亦然。

不确定性正则化。我们采用了一个损失函数,对比塑造了不确定性表面,放大了已知ID对象和未知OOD对象之间的可分性。为了测量不确定性,我们使用等式(4)中的能量分数,该分数来自分类分支的输出。在这里,我们计算ID对象和提取的未知对象特征E(ô)的能量分数E(x,b)。然后将不确定性分数传递到具有权重系数θu的logistic回归分类器,该分类器预测ID对象(x,b)的高概率和未知对象的低概率。正则化损失计算如下:

O包含所有未知物体特征

使用logistic回归不确定性分支的输出进行OOD检测。特别是,给定测试输入x∗ , 物体检测器产生盒子预测b∗ 。预测对象的不确定性分数(x∗ ,b∗ ) 由以下公式得出:

对于OOD检测,我们使用通用阈值机制来区分ID和OOD对象: