【Hadoop高级应用课设】基于MindSpore框架端边云全流程开发一个人工智能--识别猫狗应用

摘要

随着近年来深度学习的兴起,卷积神经网络(convolutional neural networks,CNN)得到了广泛的应用。利用CNN对猫狗图像识别,虽然在特征提取以及识别速度方面具有优化性[3],但存在识别率低且计算量复杂、内存消耗大的问题。具体表现为CNN识别猫狗图像对于同一目标发生轻微朝向或位置变化时,识别效果变差,且容易在训练过程中丢失有价值信息,忽略了局部与整体之间的关联性;此外,图像的计算量大也会使得内存资源占有量变大,导致程序整体运行缓慢,影响速率。

因为自己具备一定的Python和安卓开发基础,也恰巧在今年参加了华为开发者大会,在当天的参观和学习中了解了华为开源自研的AI框架,于是选择了MindSpore来学习深度学习。一般开始使用别人的代码库,都会先跑一些demo,或者说Hello World的例子,就好像学习一门编程语言一样,第一行代码都是打印Hello World。但实际进行开发其实难度并不大,仅需要解决如何在个人电脑上安装MindSpore、如何训练出一个人工智能模型、如何把训练好的模型重训练得到想要的模型、如何在手机端进行推理和部署解决就行。

本文基于华为开源自研的AI框架MindSpore框架端边云全流程开发一个人工智能应用,来使手机识别猫和狗。下面就详细讲述下,利用MindSpore如何解决上述的四个问题。

关键词:猫狗图像识别 ; MindSpore; 图像预处理; 目标检测; 卷积神经网络;

1.涉及技术知识

1.1 人工神经网络

人 工 神 经 网 络(Artificial Neural Networks, 简 称ANN)以神经元作为基本的运算单元,会对输入数据先进行线性变换 z=wx+b,随后将变换后的数据进行非线性变换 a=g(z),其中 g() 函数为非线性函数,也叫做激活函数(activation function)。激活函数的选择有很多种,较常用的有 ReLu 和 leaky ReLu。激活函数的作用主要是对通过的信号进行筛选,选择让不让当前信号通过或者以多大通过,并且将数据变成非线性的。对于线性变换中使用的权重,越大的权重表示对神经元而言数据带来越大的影响,当权重取负数时,表示神经元对输入数据产生抑制效果。对权重的修改可以改变神经元的计算,对神经网络的训练就是通过反向传播算法来修改网络权重。从本质上而言,ANN 是对自然界中现存的一些算法的拟合。

1.2 卷积神经网络

卷积神经网络(Convolutional Neural Network) 是ANN 的一种典型结构,属于前馈神经网络,通常用来处理图片类型的数据。卷积神经网络向前传播计算输出的过程就是前馈的过程,这个过程只进行前向传播计算输出,前一层的输出作为后一层的输入,一直到最后一层得到输出结果,在前向传播过程中并不对网络参数进行调整。在神经网络的反向传播(Back Propagation)过程中,通过对损失函数的计算,将误差从最后一层向前传播,对每一层的参数进行修改,调整整个网络的权值参数。

从本质上来说,CNN 能够将输入映射到输出,给定输入和损失函数,构建好网络结构之后,卷积神经网络能够自动进行权重的更新学习。和 ANN 类似,CNN 也是多层结构,每个卷积层可以看作由很多个二维平面类型的卷积核构成,每个卷积核由多个神经元构成。CNN 中的每个卷积层通常设置 n 个卷积核,使得特征图可以共享权重,相对于全连接的神经网络大大减小了参数数目,加快了运算速度 [3]。典型的 CNN 结构由特征抽取器(filter)和池化层(pooling layer)构成。pooling layer 有两种类型,均值池化(mean pooling) 和最大池化(max pooling)。Pooling 操作类似于卷积操作,对划分区域的数据进行特定的运算。

1.3 Fine Tune(微调)模型

Fine Tune:基于预训练模型进行训练,可以理解为“站在自己的嘴上”进行训练。有一个模型可以识别花,你可以通过少量的图片,在模型上进行Fine Tune,可以识别出树。这样训练的训练是模仿与从头,可以节省大量的计算时间和时间,同时对计算用的数据集要求。在深度学习领域,大量的任务可能基于已有的模型进行微调。

补充:预训练模型:顾名思义,选择是训练良好的模型。很多框架会使用大数据集预训练好模型,这样的预训练模型可以有很好的通用性,工程师在预选训练好的基础上进行微调(微调),以赋予模型以特殊要求和能力。而MindSpore Hub也有官方及社区提供训练好的模型可以之间使用。

3.实现过程

Step1:搭建Python环境;

我用的是Python3.7.5版本,在下载好Python并配置好环境变量,完成在命令行的输出helloworid即可。

Step2:安装MindSpore

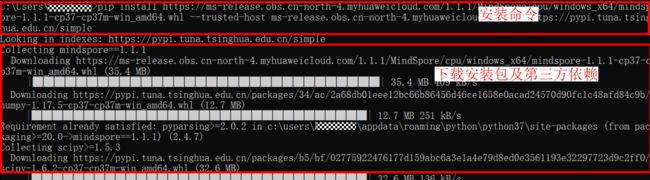

使用pip命令安装MindSpore,分两步即可快捷快捷地完成整个安装过程。

pip方式安装

- 复制下面的命令,并输入到cmd窗口中,回车运行。

- 届时,安装的pip工具会在电脑上安装MindSpore 1.1.1版本及其运行过程所需的需要软件。整个网络速度,一般在10~20可能出现。

pip install https://ms-release.obs.cn-north-4.myhuaweicloud.com/1.1.1/MindSpore/cpu/windows_x64/mindspore-1.1.1-cp37-cp37m-win_amd64.whl --trusted-host ms-release.obs.cn-north-4.myhuaweicloud.com -i https://pypi.tuna.tsinghua.edu.cn/simple

安装过程如下图所示:

注意:由于网络完成的原因导致安装失败,请实验再次输入安装命令。

安装完成如下图所示:

最后会有警告信息,查了一下是pip工具的版本可以升级到最新版本,不影响使用。

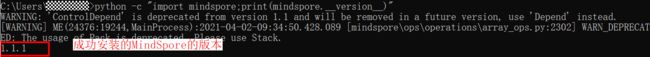

安装验证

拷贝并输入下面的命令,打印MindSpore安装的版本。

python -c "import mindspore;print(mindspore.__version__)"

如果输出为 1.1.1,则说明我们电脑上成功安装了 MindSpore。

安装成功如下图所示:

Step3:Fine Tune(微调)模型

基于MindSpore在本地进行Fine Tune,对训练模型进行重训练

1.工程文件,点击这里可下载,文件大小40M左右。

2.下载完后解压到电脑本地(建议D盘根目录),其中包括以下内容:

注意:解压的路径不能含有中文,且路径中包含的那个名字不能有空格。

D:\1小时入门AI开发工程师(X)

D:\MindSporePetClassification(√)

MindSporePetClassification

├──ADB //支持手机与电脑传递文件工具

|

├──code //Fine tune训练代码

| |

| ├──mobilenetV2.ckpt //模型文件

| |

| ├──preprocessing_dataset.py //预先处理数据集脚本

| |

| ├──requirements.txt //需要的依赖软件包

| |

| ├──src //训练脚本调用的配置、数据处理等脚本

| |

| └──train.py //主训练脚本

│

└──converter //转换工具MindSpore Lite Converter

\3. 下载开源的官方数据集来体验本课程,点击这里可下载,送文件准备解压的工程文件夹MindSporePetClassification中。

\4. 拷贝并输入下面命令,把工作路径切换到Fine tune训练代码目录目录。

cd /d d:\MindSporePetClassification\code

其中,d:\MindSporePetClassification是解压工程代码文件夹路径。

5.如果使用开源的官方数据集体验,拷贝并输入如下命令,执行收集处理数据集脚本preprocessing_dataset.py,对不符合要求的图片进行处理。

python preprocessing_dataset.py D:\MindSporePetClassification\kagglecatsanddogs_3367a.zip

其中D:\MindSporePetClassification\kagglecatsanddogs_3367a.zip是数据集文件所在位置。

\6. 拷贝并输入如下命令,执行Fine tune脚本train.py ,开始生成模型文件。

python train.py

训练过程如下:

脚本会自动安装需要的依赖包:opencv-python和matplotlib,用于图形处理,下面会用到,安装完成图所示,整个过程视网络速度,一般在1~2分钟。

脚本会在正式训练前从爆弹6张图片载入当前模型文件,对猫狗进行判别,如下,部分猫狗明确数据图不预期,点击图片关闭图片,使脚本正式进入微调训练。

先对数据进行特征采集,如下图所示,可能数据集大,我花费20-30分钟,耐心等待。

![]()

训练时模拟模型的精确进行测试,当训练的模型精度超过当前模型时,就会将图模型抑制下来,如下。

训练完成,脚本会再调用之前的图片对微调后的模型进行验证,如下图所示,所有图片分类预期,说明模型精确满足要求,点击图片关闭图片,使脚本继续运行完成文件转换。

训练后将Fine tune后的模型文件转换为mindir文件,并在代码文件夹下生成mobilenetv2.mindir文件。

微调总结

训练是不断重复的过程,通过循环批数据的输入,进行可以计算,逼近损失/最小的那个模型。阅读训练中打印信息增加对深度学习的理解。

...

epoch[1/30], iter[696] cost: 2047.780, per step time: 2.942, avg loss: 0.364, acc: 0.986, train acc: 0.988

update best acc: 0.9866997360484405

epoch[2/30], iter[696] cost: 1710.441, per step time: 2.458, avg loss: 0.354, acc: 0.988, train acc: 0.988

update best acc: 0.9880012390984098

epoch[3/30], iter[696] cost: 1729.818, per step time: 2.485, avg loss: 0.352, acc: 0.991, train acc: 0.990

update best acc: 0.9906043902691896

...

epoch是指训练的迭代数,可以随着迭代数的增加,增加平均损失函数(avg loss)逐步降低,精确(acc)逐步提高。

...

early stop! the best epoch is 2

train total cost 1093.3910 s

export mobilenetv2 MINDIR file at d:\MindSporePetClassification\code\mobilenetv2.mindir

...

训练最后,达到设置的最高阈值,或者训练最大训练数,训练停止。1分钟,其中包括处理数据和重训练两个漫长的时间,重训练只需要1分钟左右,效率非常高,同时高精度得到了98%+,可以满足日常生活的基本使用。所以Fine Tune对于中国AI工程师开发者来说是一个非常快速生成模型的一种手段。

Step4:手机端推理和部署

打开APP选择一个Demo中的任何一个Demo图片,如下图所示,由于目前应用还没有启动好,识别结果不准确的,需要导入模型训练好的模型才能准确识别猫狗。

注意:打开APP会在手机中自动生成“ PetClassification ”文件夹,可在文件管理类应用中查看。

如何训练出一个人工智能模型。

- 在个人电脑上根据之前的MobileNetV2预训练模型+猫狗数据集进行模型的微调(Fine-tune);

- 通过MindSpore Lite的工具链,将模型进行转换并部署到手机上。

部署到手机

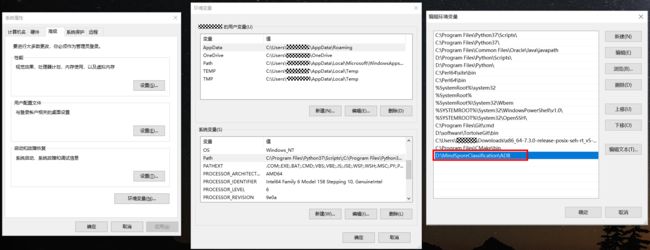

将训练模型好部署到手机,需要把文件导入手机宠物分类文件夹中,有很多方法可以完成这个步骤,有两种方法:亚行方式或导入方式,我采用前面一种。

1.亚行方式

需使用ADB工具(之前已下载解压可直接使用)在电脑与手机之间传递文件,将adb.exe所在路径添加到环境变量path中,如下图所示。

- 手机通过数据线连接电脑,手机需要开启“USB调试模式”。

注意:华为手机一般在设置->系统和更新->开发人员选项->USB调试中打开“USB调试模式”,如果是第一次打开,需要先打开设置->关于手机,连续点击版本号7次以上,会提示“处于开发者模式”,再去打开USB调试模式。

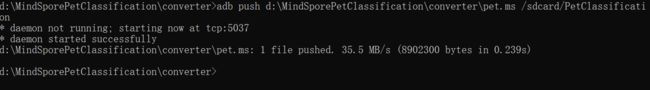

复制输入如下命令,导入文件。

adb push d:\MindSporePetClassification\converter\pet.ms /sdcard/PetClassification

其中, d:\MindSporePetClassification\converter\pet.ms 代表ms文件所在位置。

导入成功,如下图所示。

手机打开APP-宠物分类,就可以体验猫狗识别了,如下图所示。

APP支持如下功能:

\1. 图片:选择相册中的猫狗照片识别;

2.相机:打开相机拍照识别;

\3. 预览:打开摄像头扫描识别:

4.选择一个案例:选择以下任意一张猫狗图片识别。

结 论

经过多天的努力,这个深度学习图像识别的论文终于完成。在这个过程中,我接触了许多新的知识与技术,其中包括深度学习的概念与特点、实战开发、Python开发、安卓开发、数据集的基础用法、如何训练自己的数据集等。

对于整个庞大的深度学习生态来说,所用到的技术部分仅仅是其中的冰山一角都可能算不上。但这也已经足以实现所需要的基本的功能了,足见以上各种技术的强大之处。从中也学习到了很多新知识,旧知识也得到了巩固。

图像识别的核心要点在于模型的训练、这次实现的算法模型基本上都能够识别准确。由于时间仓促等各种客观因素以及个人对于技术的掌握程度、对概念上的理解可能难免也出现偏差。无论怎样,本实验作为正面或反面教材都能够具备一定的作用。

个人认为,深度学习的出现能够将我们社会的资源的利用率极大提高,在整体的上提高人民的生活水平。如此富有潜力的领域对于推动社会发展将会是非常有利的,而这些都应该建立在我们对深度学习的探索与正确的认识上面。因此,希望未来的深度学习的相关领域能够迎来更好的发展。

参考文献

[1]孙彦,丁学文,雷雨婷,陈静,孔祥鑫.基于SSD_MobileNet_v1网络的猫狗图像识别[J].天津职业技术师范大学学报,2020,30(01):38-44.

[2]徐奕哲.基于Resnet-50的猫狗图像识别[J].电子制作,2019(16):44-45+55.

[3]柯研 , 王希龙 , 郑钰辉 卷积神经网络图像处理 [J/OL] 电子技术与软件工程 ,2018(22):72-73[2018-12-08]

[4]刘健 , 袁谦 , 吴广 , 喻晓 卷积神经网络综述 [J] 计算机代 ,2018(11):19-23