分类算法-k近邻算法

目录

- 分类算法-k近邻算法(KNN)

-

- 基本概念:

- K近邻算法实例--预测入住位置

- k近邻算法的问题:

- k近邻算法的优缺点及使用场景

分类算法的判定依据:目标值为离散型

分类算法-k近邻算法(KNN)

基本概念:

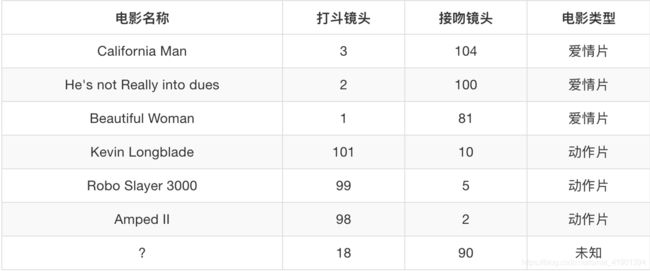

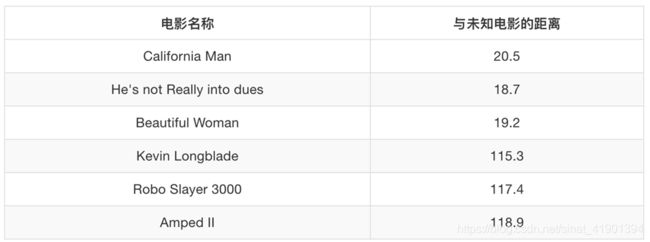

举例:

根据特征判断:

以上可以通过与未知电影的距离得出一个未知电影的类型。

k近邻算法定义: 如果一个样本在特征空间中的k个最相似(即特征空间中最邻近)的样本中的大多数属于某一个类别,则该样本也属于这个类别。

来源: KNN算法最早是由Cover和Hart提出的一种分类算法

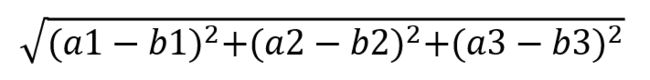

计算距离公式: 两个样本的距离可以通过如下公式计算,又叫欧式距离

比如说,a(a1,a2,a3),b(b1,b2,b3)

sklearn k-近邻算法API

sklearn.neighbors.KNeighborsClassifier(n_neighbors=5,algorithm='auto')

n_neighbors:int,可选(默认= 5),k_neighbors查询默认使用的邻居数

algorithm:{‘auto’,‘ball_tree’,‘kd_tree’,‘brute’},可选用于

计算最近邻居的算法:‘ball_tree’将会使用 BallTree,‘kd_tree’将使

用 KDTree。‘auto’将尝试根据传递给fit方法的值来决定最合适的算法。

(不同实现方式影响效率)

K近邻算法实例–预测入住位置

- train.csv 、 test.csv

- row_id:登记时间的ID

- xy:坐标

- 准确性:定位准确性

- 时间:时间戳

- place_id:业务的ID,这是您预测的目标

分析过程:

这是一个分类问题

特征值:x,y坐标,定位准确性,时间

处理:

1.数据太多了,缩小数据集范围,省时间

DataFrame.query()

2.时间戳进行(年月日周时分秒),当作新的特征,处理日期数据

pd.to_datetime

pd.DatetimeIndex

3.将签到位置少于n个用户的删除

place_count =data.groupby('place_id').aggregate(np.count_nonzero)tf = place_count[place_count.row_id > 3].reset_index()

data = data[data['place_id'].isin(tf.place_id)]

代码实现:

from sklearn.neighbors import KNeighborsClassifier

from sklearn.model_selection import train_test_split, GridSearchCV

import pandas as pd

from sklearn.preprocessing import StandardScaler

def knncls():

"""

K-近邻预测用户签到位置

:return:None

"""

# 读取数据

data = pd.read_csv(r"D:\研究生学习\机器学习\机器学习算法基础\数据集\facebook-v-predicting-check-ins(1)\train.csv")

print(data.head(10))

# 处理数据

# 1、缩小数据,查询数据筛选

data = data.query("x > 1.0 & x < 1.25 & y > 2.5 & y < 2.75")#query里可以直接查询

# 处理时间的数据,把时间戳转换到时间年月日

time_value = pd.to_datetime(data['time'], unit='s')#unit是默认转换的最小单位。

print(time_value)

# 把日期格式转换成 字典格式

time_value = pd.DatetimeIndex(time_value)

# 构造一些特征

data['day'] = time_value.day #把所有样本的day,构成新的特征加入到data里面

data['hour'] = time_value.hour

data['weekday'] = time_value.weekday

# 把时间戳特征删除

data = data.drop(['time'], axis=1)#前面已经把时间戳转化成三个新的特征了,这里就可以把时间戳删除了。sklearn里面1表示列

print(data)

# 把签到数量少于n个目标位置删除

place_count = data.groupby('place_id').count()#以place_id 分组

tf = place_count[place_count.row_id > 3].reset_index()#保留了大于三次的目标值,reset_index就把第一列变成一列索引

data = data[data['place_id'].isin(tf.place_id)]#只保留大于3次的place_id

#把row_id删除

data =data.drop(['row_id'], axis=1)

print(data)

# 取出数据当中的特征值和目标值

y = data['place_id']#把place_id取出来当作目标值

x = data.drop(['place_id'], axis=1)#删除掉place_id,剩下的就都是特征值,按列删除

# 进行数据的分割,分割成训练集和测试集

x_train, x_test, y_train, y_test = train_test_split(x, y, test_size=0.25)

# 特征工程(标准化)

std = StandardScaler()

# 对测试集和训练集的特征值进行标准化

x_train = std.fit_transform(x_train)

x_test = std.transform(x_test)

# 进行算法流程 # 超参数

knn = KNeighborsClassifier(n_neighbors=10)

# fit, predict,score

knn.fit(x_train, y_train)#把训练集传进去

# 得出预测结果

y_predict = knn.predict(x_test)#用测试集预测

print("预测的目标签到位置为:", y_predict)

# 得出准确率

print("预测的准确率:", knn.score(x_test, y_test))

# 构造一些参数的值进行搜索

param = {"n_neighbors": [3, 5, 10]}

# 进行网格搜索

gc = GridSearchCV(knn, param_grid=param, cv=2)

gc.fit(x_train, y_train)

# 预测准确率

print("在测试集上准确率:", gc.score(x_test, y_test))

print("在交叉验证当中最好的结果:", gc.best_score_)

print("选择最好的模型是:", gc.best_estimator_)

print("每个超参数每次交叉验证的结果:", gc.cv_results_)

return None

if __name__ == "__main__":

knncls()

k近邻算法的问题:

1.k值取多大?有什么影响?

k值取很小:容易受异常点影响

k值取很大:容易受最近数据太多导致比例变化

2.性能问题:时间复杂度很高

k近邻算法的优缺点及使用场景

优点:

简单,易于理解,易于实现,无需估计参数,无需训练

缺点:

懒惰算法,对测试样本分类时的计算量大,内存开销大

必须指定K值,K值选择不当则分类精度不能保证

使用场景: 小数据场景,几千~几万样本,具体场景具体业务

去测试