序列推荐阅读指南,从MC到Attention,附所有论文PDF~

前言

本文是对序列推荐从MC到RNN、CNN再到Attention、GNN的总结。 整理了自己阅读过的或放着忘了看的论文,希望可以给其他人一个参考。所有论文整理见「参考文献」部分和GitHub(持续更新~)。

序列推荐指南

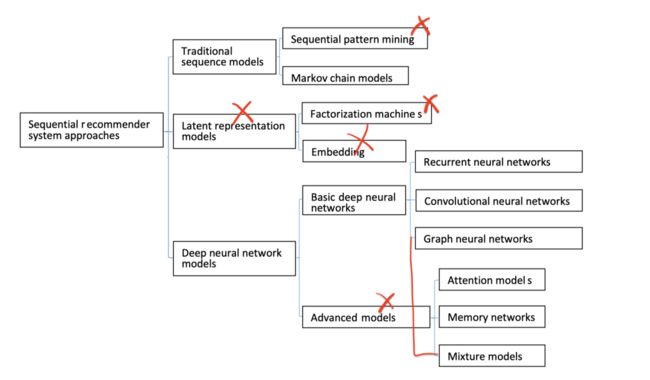

整本文主要的分类标准参考“序列推荐的挑战、进程和前景”[1]。

论文(1): Sequential recommender systems: challenges, progress and prospects

结构如下所示(个人对其进行了删减和补充):

其中[2-4]为MC模型,[5-6]为RNN,[7]为CNN,[8]为GNN,[9-14]为self-attention,[15-17]为attention+timestamp,[18-19]为multi-interest,[20]为memory networks,[21]是一个混合的方法。

传统序列模型

传统的序列模型,包括「序列模式挖掘」和「马尔可夫链模型」,它们在建模一个序列中用户-物品交互之间的序列依赖关系方面的天然优势,是对SRSs的直观解决方案。由于序列模式挖掘文献内容较少且缺陷较大,因此不进行展开。

马尔可夫链

基于马尔可夫链的推荐系统采用马尔可夫链模型对序列中user-item交互的转换进行建模,以预测下一次交互。

在当前一些序列推荐论文中,经常拿来比较的baseline是1阶MC和2010年在WWW会议上提出的FPMC模型[2]:

论文(2): Factorizing Personalized Markov Chains for Next-Basket Recommendation

❝FPMC使用矩阵分解和分解的一阶马尔可夫链的组合作为它的推荐器,它捕获用户的长期偏好以及商品到商品的转换。

❞

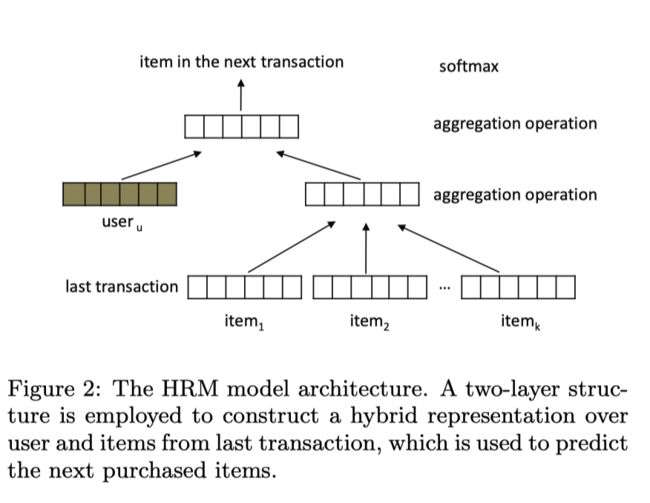

另外,还有对FPMC的改进,例如2015年的HRM[3] 模型,本质上是在FPMC中加入了非线性转换:

论文(3): General factorization framework for context-aware recommendations

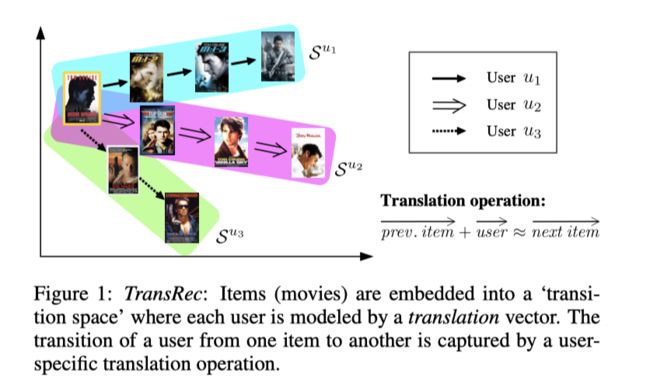

2018年TransRec[4]模型也属于马尔可夫链模型,但是它在度量空间中应用了一种新颖的基于转换的结构(转换空间),具有可解释性。

论文(4): Translation-based recommendation: A scalable method for modeling sequential behavior

以上是基于马尔可夫链比较经典的3篇序列推荐论文,但它们的缺点也是显而易见:

由于马尔可夫属性假设当前的交互只依赖于最近的一个或几个交互,因此只能捕获短期的依赖,而忽略了长期的依赖;

它们只能捕获点依赖关系(point-wise dependencies),而忽略

user-item交互的集体依赖关系;

【注】在[1]中,将HRM与TransRec放在了隐因子表示模型【预训练】中的Embedding部分,因为两个模型就是对用户表示和物品表示的学习,但基于深度学习的模型本质也是Embedding的学习,Latent representation models的划分可能有些模糊,所以将其去除。

深度神经网络模型

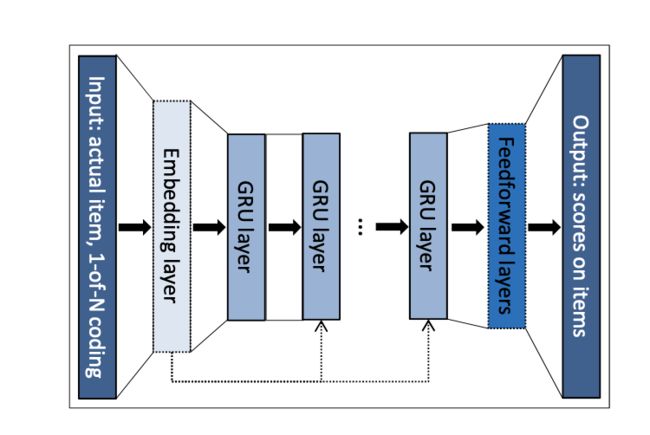

RNN

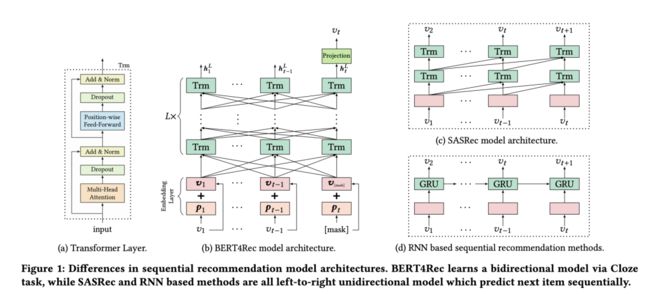

给定一个历史user-item交互序列,基于循环神经网络(RNN)的序列推荐通过对给定交互的顺序依赖关系建模来预测下一个可能的交互。其中,比较经典的模型是GRU4Rec[5]和GRU4Rec+[6]。

论文(5): Session-based recommendations with recurrent neural networks

论文(6): Recurrent neural networks with top-k gains for session-based recommendations

CNN

给定用户历史行为序列,与基于RNN的模型不同,基于CNN的模型首先将历史行为的Embedding向量构造成一个矩阵,然后将这个矩阵作为时间和潜在空间中的“图像”,最后通过卷积操作得到用户的短期表示。最经典的模式2018年发表在WSDM的Caser模型[7]。

论文(7): Personalized Top-N Sequential Recommendation via Convolutional Sequence Embedding

GNN

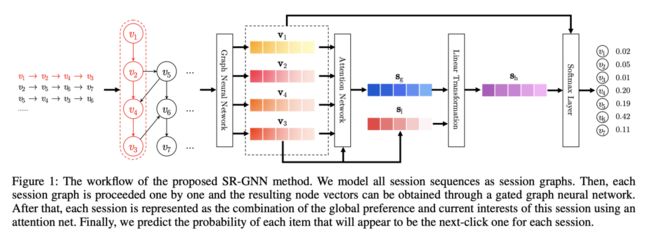

基于GNN的方法是利用GNN对序列中user-item交互的复杂转换进行建模和捕获。通常,有向图首先建立在序列数据之上,将每个交互作为图中的节点,同时将每个序列映射到一条路径。然后,学习图上用户或物品的Embedding,在整个图上嵌入更复杂的关系。比较经典的模型为SR-GNN[8]。

论文(8): Session-based recommendation with graph neural networks

【注】我个人对这方面了解甚少,所以将其放在前面部分,但GNN相关的序列推荐前沿研究有很多。

Attention

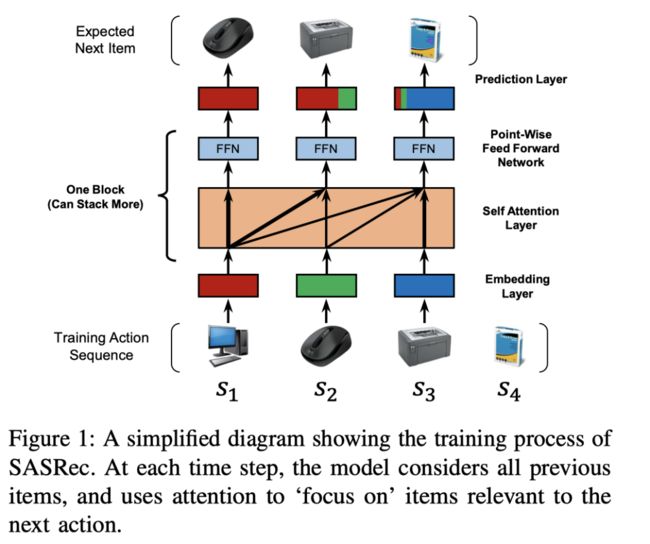

可以说Transformer的出现,让self-attention机制成为了序列推荐主流的建模方式。首先是最经典的SASRec模型[9],将Transformer引入序列推荐,目前很多模型都是对SASRec的改进。

论文(9):Self-Attentive Sequential Recommendation

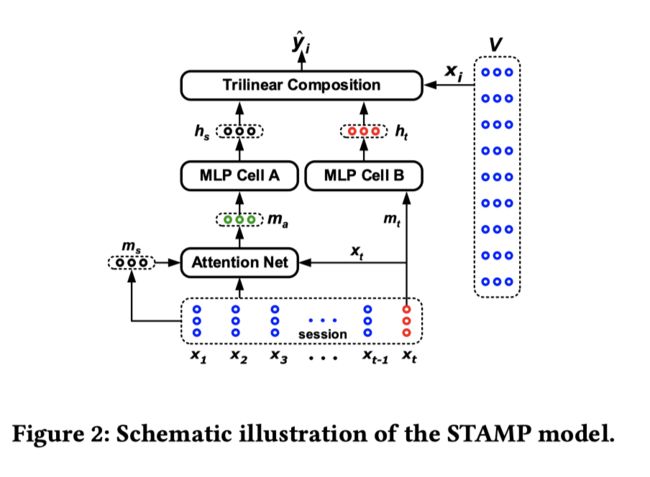

STAMP模型[10]将用户表示拆分为长短期兴趣(也有很多人这样做),将最后一个交互的物品表示作为短期,采用注意力机制赋予长期兴趣中短期的,联合进行预测。

论文(10): STAMP: short-term attention/memory priority model for session-based recommendation

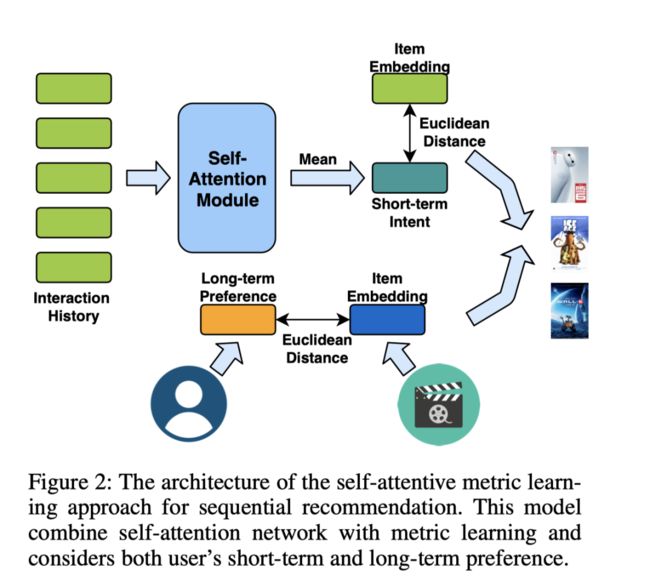

AttRec模型[11]采用self-attention提取短期兴趣,度量学习获得长期偏好:

论文(11): Next Item Recommendation with Self-Attentive Metric Learning

BERT4Rec模型[12]采用双向Transformer:

论文(12): BERT4Rec: Sequential Recommendation with Bidirectional Encoder Representations from Transformer

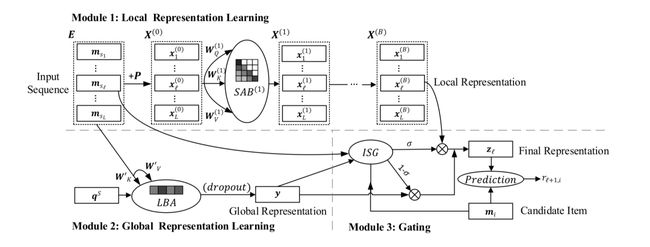

FISSA模型[13]:

论文(13): FISSA: Fusing Item Similarity Models with Self-Attention Networks for Sequential Recommendation

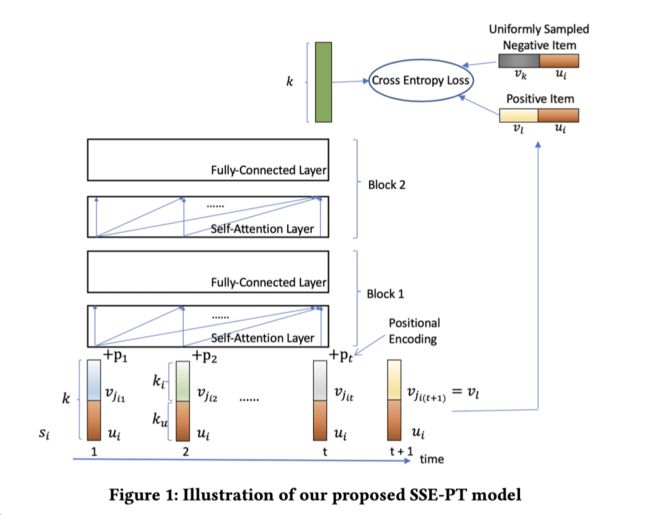

SSE-PT[14]是对SASRec的改进:

论文(14):SSE-PT: Sequential Recommendation Via Personalized Transformer

TiSASRec[15]、CTA[16]、MEANTIME[17]模型都是融入了时间戳,

论文(15): Time Interval Aware Self-Attention for Sequential Recommendation

论文(16): Déjà vu: A Contextualized Temporal Attention Mechanism for Sequential Recommendation

论文(17): MEANTIME: Mixture of Attention Mechanisms with Multi-temporal Embeddings for Sequential Recommendation

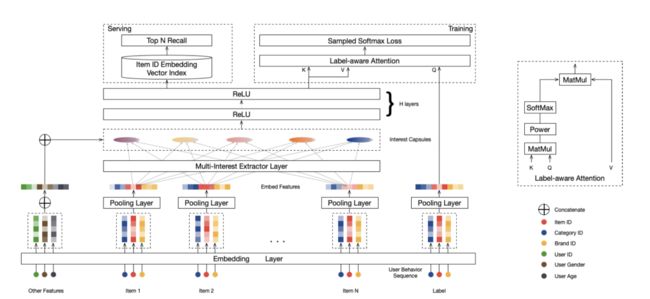

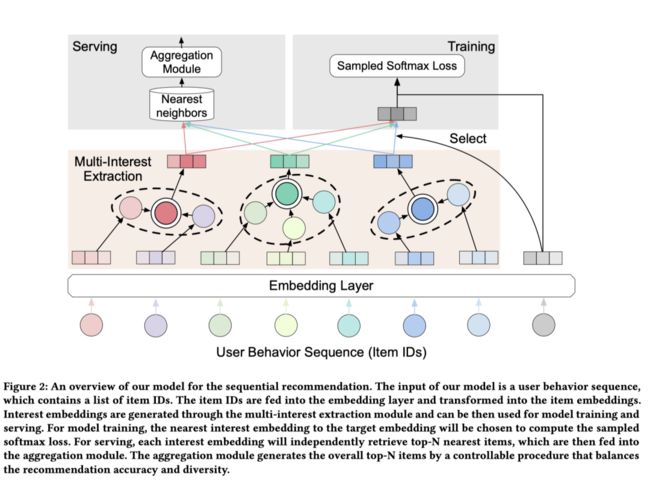

Dynamic Routing

采用胶囊网络的动态路由算法来抽象出用户的多兴趣,目前相应的论文有MIND模型[18]和ComiRec模型[19]。

论文(18): Multi-Interest Network with Dynamic Routing for Recommendation at Tmall

论文(19):Controllable Multi-Interest Framework for Recommendation

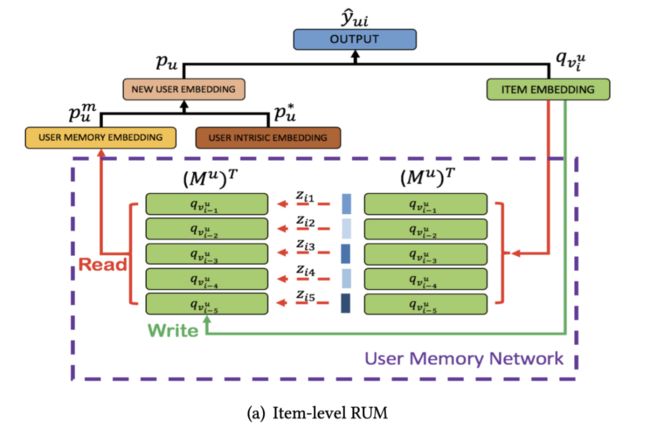

Memory Networks

在推荐系统中引入了记忆网络,通过合并外部记忆矩阵来直接捕获任何历史user-item交互之间的依赖关系。这样的矩阵可以更明确、更动态地将历史交互以序列的方式存储和更新,从而提高模型的表达能力,减少那些无关的交互的干扰,例如MANN模型[20]。

论文(20): Sequential recommendation with user memory networks

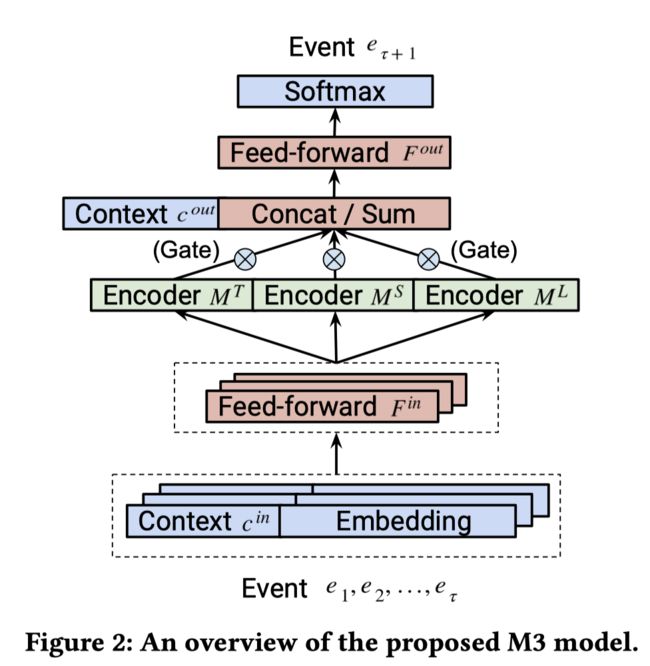

Mixture Model

混合的推荐是指结合了不同类型的模型,一个典型的例子是M3模型[21],它结合了不同种类的编码器,分别适应于短期和长期依赖。

论文(21): Towards Neural Mixture Recommender for Long Range Dependent User Sequences

总结

以上便是部分序列推荐值得阅读的论文,公众号“推荐算法的小齿轮”后台回复“序列推荐”即可获得所有论文的压缩包。

也可以关注github:“https://github.com/ZiyaoGeng/RSpaper-read”,有更多更详细的论文整理,欢迎Star。

参考文献

[1] Wang S, Hu L, Wang Y, et al. Sequential recommender systems: challenges, progress and prospects[J]. arXiv preprint arXiv:2001.04830, 2019.

MC

[2] Rendle S, Freudenthaler C, Schmidt-Thieme L. Factorizing personalized markov chains for next-basket recommendation, Proceedings of the 19th international conference on World wide web. 2010: 811-820.

[3] Wang P, Guo J, Lan Y, et al. Learning hierarchical representation model for nextbasket recommendation, Proceedings of the 38th International ACM SIGIR conference on Research and Development in Information Retrieval. 2015: 403-412.

[4] He R, Kang W C, McAuley J J. Translation-based Recommendation: A Scalable Method for Modeling Sequential Behavior, IJCAI. 2018: 5264-5268.

RNN

[5] B. Hidasi, A. Karatzoglou, L. Baltrunas, and D. Tikk, “Session-based recommendations with recurrent neural networks,” in ICLR, 2016.

[6] B. Hidasi and A. Karatzoglou, “Recurrent neural networks with top-k gains for session-based recommendations,” CoRR, vol. abs/1706.03847, 2017.

CNN

[7] J. Tang and K. Wang, “Personalized top-n sequential recommendation via convolutional sequence embedding,” in WSDM, 2018.

GNN

[8] Wu, Shu, et al. "Session-based recommendation with graph neural networks." Proceedings of the AAAI Conference on Artificial Intelligence. Vol. 33. 2019.

Attention

[9] Kang, Wang-Cheng, and Julian McAuley. "Self-attentive sequential recommendation." 2018 IEEE International Conference on Data Mining (ICDM). IEEE, 2018.

[10] Liu, Qiao, et al. "STAMP: short-term attention/memory priority model for session-based recommendation." Proceedings of the 24th ACM SIGKDD International Conference on Knowledge Discovery & Data Mining. 2018.

[11] Zhang, Shuai, et al. "Next item recommendation with self-attentive metric learning." Thirty-Third AAAI Conference on Artificial Intelligence. Vol. 9. 2019.

[12] Sun, Fei, et al. "BERT4Rec: Sequential recommendation with bidirectional encoder representations from transformer." Proceedings of the 28th ACM International Conference on Information and Knowledge Management. 2019.

[13] Lin, Jing, Weike Pan, and Zhong Ming. "FISSA: fusing item similarity models with self-attention networks for sequential recommendation." Fourteenth ACM Conference on Recommender Systems. 2020.

[14] Wu, Liwei, et al. "SSE-PT: Sequential recommendation via personalized transformer." Fourteenth ACM Conference on Recommender Systems. 2020.

Attention + timestamp

[15] Li, Jiacheng, Yujie Wang, and Julian McAuley. "Time Interval Aware Self-Attention for Sequential Recommendation." Proceedings of the 13th International Conference on Web Search and Data Mining. 2020.

[16] Wu, Jibang, Renqin Cai, and Hongning Wang. "Déjà vu: A Contextualized Temporal Attention Mechanism for Sequential Recommendation." Proceedings of The Web Conference 2020. 2020.

[17] Cho, Sung Min, Eunhyeok Park, and Sungjoo Yoo. "MEANTIME: Mixture of Attention Mechanisms with Multi-temporal Embeddings for Sequential Recommendation." Fourteenth ACM Conference on Recommender Systems. 2020.

Dynamic Routing

[18] Li, Chao, et al. "Multi-interest network with dynamic routing for recommendation at Tmall." Proceedings of the 28th ACM International Conference on Information and Knowledge Management. 2019.

[19] Cen, Yukuo, et al. "Controllable Multi-Interest Framework for Recommendation." arXiv preprint arXiv:2005.09347 (2020).

「Memory Netowks」

[20] Chen, Xu, et al. "Sequential recommendation with user memory networks." Proceedings of the eleventh ACM international conference on web search and data mining. 2018.

「Mixture」

[21] Tang, Jiaxi, et al. "Towards neural mixture recommender for long range dependent user sequences." The World Wide Web Conference. 2019.

![]()

往期精彩回顾

【序列推荐】RecSys2020|MEANTIME---如何有效的结合Temporal Embeddings?

【序列推荐】RecSys2020|FISSA---融合物品相似度模型和自注意力网络的推荐

【序列推荐】CIKM2019|BERT4Rec---BERT在序列推荐中的应用

【序列推荐】RecSys2020|SSE-PT---个性化的Transformer推荐模型

【序列推荐】WSDM2018|Caser---非常有趣的采用卷积提取短期偏好的序列推荐模型

【序列推荐】AAAI2019|AttRec---采用度量学习来建模用户的长期偏好

【序列推荐】KDD2018|STAMP---基于注意力的短期记忆优先的推荐

【论文导读】ICDM2018|SASRec---基于自注意力机制的序列推荐(召回)

扫码关注更多精彩

![]()

![]()

![]()