MMdetection优化、训练Coco格式数据集、实现labelImg/xml/yolo转coco数据集格式转换

整合了xml转coco脚本、修改数据集配置文件等文件,实现导入所有图片和xml数据集即可自动完成格式转换、配置修改等步骤。

工程名为mmdetection。

首先将coco文件夹复制到/yuml/data/下

为了实现mmdetection自动导入coco数据集中的类名,以yolox_s为例,需要分别修改mmdetection/configs/yolox/中的yolox_s_8x8_300e_coco.py文件

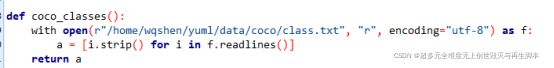

/mmdetection/mmdet/core/evaluation/中class_names.py

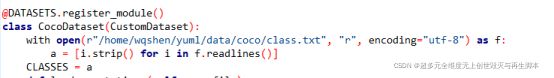

/mmdetection/mmdet/datasets/中的coco.py

具体修改为:

Coco文件夹说明:

annotations:存放coco数据集三个json文件的地方,json文件由labelImg_coco.py自动生成。

Images:存放需要训练的所有图片的地方,需要自己手动导入。

Labels_before:存放所有yolo格式的txt标签文件的地方,需要手动导入。

Labels_next:存放所有xml标签文件的地方,需要手动导入或通过label_eva.py转换labels_before中yolo数据集后自动生成

Test2017:存放coco格式的测试集图片,由labelImg_coco.py自动生成。

Train2017:存放coco格式的训练集图片,由labelImg_coco.py自动生成

Val2017:存放coco格式的验证集图片,由labelImg_coco.py自动生成

Tmp:存放所有需要训练的图片和xml标签文件的地方,需要手动导入。

Class.txt:存放数据集的类名,一行一个类,如果需要使用label_eva.py,需要提前手动导入类名,如果不需要转换格式,该文件由class_txt.py或labelImg_coco.py自动生成。

Class_txt.py:功能为遍历labels_next中的所有xml文件,以txt格式输出所有类名。

Instances_test2017.json:coco格式json文件,由labelImg_coco.py自动生成。

Instances_train2017.json:coco格式json文件,由labelImg_coco.py自动生成。

Instances_val2017.json:coco格式json文件,由labelImg_coco.py自动生成。

Label_eva.py:功能为读取labels_before中的所有yolo格式的txt文件以及images中的所有图片,并转换为coco格式的xml文件。

--image_dir:存放所有图片的文件夹路径,默认为coco/image/

--image_type:所有图片的格式

--label_dir:存放所有标签文件的文件夹路径,默认为coco/labels_before/

--label_type:所有标签文件的格式,默认为txt,可选xml

--class_path:存放class.txt文件的路径,默认为coco/class.txt

--output_label_type:输出转换后的标签文件的格式,默认为xml,可选txt

--output_label_dir:输出转换后的标签文件的路径,默认为labels_next/

labelImg_coco.py:功能为读取tmp中的所有xml文件以及所有图片,并生成coco格式的数据集,生成的文件包括annotations、Test2017、Train2017、Val2017、Class.txt、Instances_test2017.json、Instances_train2017.json、Instances_val2017.json。

Remove_all.py:功能为清除coco中所有文件夹的内容,方便下一次的数据集导入。

Test.txt:自动生成,包含对应图片名。

Train.txt:自动生成,包含对应图片名。

Val.txt:自动生成,包含对应图片名。

Coco文件夹使用说明,在导入数据集之前,cd到mmdetection/data/coco目录下,运行python remove_all.py清除数据。

如果已经准备好了xml格式标签的数据集,则将所有图片和所有xml标签文件导入tmp文件夹中,所有图片导入images中,所有xml标签文件导入labels_next中,运行python labelImg_coco.py后,即可生成coco数据集,然后运行python tools/trains.py config/yolox/yolox_xxxxxx.py 即可训练模型。

如果只有yolo格式的txt标签文件数据集,则需要分别将所有图片放入images文件夹中,所有txt标签文件放入labels_before文件夹中,运行python label_eva.py后,在labels_next中自动生成xml文件,接着将生成的所有xml文件和所有的图片都导入到tmp文件夹中,运行python labelImg_coco.py后,即可生成coco数据集,然后运行python tools/trains.py config/yolox/yolox_xxxxxx.py 即可训练模型。

labelImg_coco.py

#coding:utf-8

# pip install lxml

import os

import glob

import json

import shutil

import numpy as np

import xml.etree.ElementTree as ET

path2 = "."

image_geshi = ".png"

START_BOUNDING_BOX_ID = 1

def get(root, name):

return root.findall(name)

def get_and_check(root, name, length):

vars = root.findall(name)

if len(vars) == 0:

raise NotImplementedError('Can not find %s in %s.'%(name, root.tag))

if length > 0 and len(vars) != length:

raise NotImplementedError('The size of %s is supposed to be %d, but is %d.'%(name, length, len(vars)))

if length == 1:

vars = vars[0]

return vars

def convert(xml_list, json_file):

json_dict = {"images": [], "type": "instances", "annotations": [], "categories": []}

categories = pre_define_categories.copy()

bnd_id = START_BOUNDING_BOX_ID

all_categories = {}

for index, line in enumerate(xml_list):

# print("Processing %s"%(line))

xml_f = line

tree = ET.parse(xml_f)

root = tree.getroot()

filename = os.path.basename(xml_f)[:-4] + image_geshi

image_id = 20190000001 + index

size = get_and_check(root, 'size', 1)

width = int(get_and_check(size, 'width', 1).text)

height = int(get_and_check(size, 'height', 1).text)

image = {'file_name': filename, 'height': height, 'width': width, 'id':image_id}

json_dict['images'].append(image)

## Cruuently we do not support segmentation

# segmented = get_and_check(root, 'segmented', 1).text

# assert segmented == '0'

for obj in get(root, 'object'):

category = get_and_check(obj, 'name', 1).text

if category in all_categories:

all_categories[category] += 1

else:

all_categories[category] = 1

if category not in categories:

if only_care_pre_define_categories:

continue

new_id = len(categories) + 1

print("[warning] category '{}' not in 'pre_define_categories'({}), create new id: {} automatically".format(category, pre_define_categories, new_id))

categories[category] = new_id

category_id = categories[category]

bndbox = get_and_check(obj, 'bndbox', 1)

xmin = int(float(get_and_check(bndbox, 'xmin', 1).text))

ymin = int(float(get_and_check(bndbox, 'ymin', 1).text))

xmax = int(float(get_and_check(bndbox, 'xmax', 1).text))

ymax = int(float(get_and_check(bndbox, 'ymax', 1).text))

assert(xmax > xmin), "xmax <= xmin, {}".format(line)

assert(ymax > ymin), "ymax <= ymin, {}".format(line)

o_width = abs(xmax - xmin)

o_height = abs(ymax - ymin)

ann = {'area': o_width*o_height, 'iscrowd': 0, 'image_id':

image_id, 'bbox':[xmin, ymin, o_width, o_height],

'category_id': category_id, 'id': bnd_id, 'ignore': 0,

'segmentation': []}

json_dict['annotations'].append(ann)

bnd_id = bnd_id + 1

for cate, cid in categories.items():

cat = {'supercategory': 'none', 'id': cid, 'name': cate}

json_dict['categories'].append(cat)

json_fp = open(json_file, 'w')

json_str = json.dumps(json_dict)

json_fp.write(json_str)

json_fp.close()

print("------------create {} done--------------".format(json_file))

print("find {} categories: {} -->>> your pre_define_categories {}: {}".format(len(all_categories), all_categories.keys(), len(pre_define_categories), pre_define_categories.keys()))

print("category: id --> {}".format(categories))

print(categories.keys())

print(categories.values())

if __name__ == '__main__':

with open(r"class.txt", "r", encoding="utf-8") as f:

a = [i.strip() for i in f.readlines()]

classes = a

pre_define_categories = {}

for i, cls in enumerate(classes):

pre_define_categories[cls] = i + 1

# pre_define_categories = {'a1': 1, 'a3': 2, 'a6': 3, 'a9': 4, "a10": 5}

only_care_pre_define_categories = True

# only_care_pre_define_categories = False

train_ratio = 0.7

val_ratio = 0.2

test_ratio = 0.1

save_json_train = 'instances_train2017.json'

save_json_val = 'instances_val2017.json'

save_json_test = 'instances_test2017.json'

xml_dir = "./dx_coco_sf60_crop_np/tmp/"

xml_list = glob.glob(xml_dir + "/*.xml")

xml_list = np.sort(xml_list)

np.random.seed(100)

np.random.shuffle(xml_list)

train_num = int(len(xml_list)*train_ratio)

val_num = int(len(xml_list) * val_ratio)

xml_list_train = xml_list[:train_num]

xml_list_val = xml_list[train_num:train_num+val_num]

xml_list_test = xml_list[train_num+val_num:]

convert(xml_list_train, save_json_train)

convert(xml_list_val, save_json_val)

convert(xml_list_test, save_json_test)

if os.path.exists(path2 + "/annotations"):

shutil.rmtree(path2 + "/annotations")

os.makedirs(path2 + "/annotations")

if os.path.exists(path2 + "/train2017"):

shutil.rmtree(path2 + "/train2017")

os.makedirs(path2 + "/train2017")

if os.path.exists(path2 + "/val2017"):

shutil.rmtree(path2 +"/val2017")

os.makedirs(path2 + "/val2017")

if os.path.exists(path2 + "/test2017"):

shutil.rmtree(path2 + "/test2017")

os.makedirs(path2 + "/test2017")

f1 = open("train.txt", "w")

for xml in xml_list_train:

img = xml[:-4] + image_geshi

f1.write(os.path.basename(xml)[:-4] + "\n")

shutil.copyfile(img, path2 + "/train2017/" + os.path.basename(img))

f2 = open("val.txt", "w")

for xml in xml_list_val:

img = xml[:-4] + image_geshi

f2.write(os.path.basename(xml)[:-4] + "\n")

shutil.copyfile(img, path2 + "/val2017/" + os.path.basename(img))

f3 = open("test.txt", "w")

for xml in xml_list_test:

img = xml[:-4] + image_geshi

f3.write(os.path.basename(xml)[:-4] + "\n")

shutil.copyfile(img, path2 + "/test2017/" + os.path.basename(img))

f1.close()

f2.close()

f3.close()

print("-------------------------------")

print("train number:", len(xml_list_train))

print("val number:", len(xml_list_val))

print("test number:", len(xml_list_test))