Tabby连接服务器运行模型代码

Tabby连接服务器运行模型代码

- 零、写在前面

- 一、准备事项

- 二、连接服务器

- 三、配置python环境

-

- 1、知识点(环境和解释器)

-

- (1)环境

-

- 1)base环境

- 2)虚拟环境

- (2)解释器

- 2、在服务器中配置环境和解释器

-

- (1)安装Anaconda

- (2)创建虚拟环境

-

- 1)PyTorch-GPU

- 2)TensorFlow-GPU

- (3)安装所项目运行所需要的包

-

- 1)pip和conda的区别

- 2)使用pip或conda下载

- 3)使用pip或conda下载

- 3.1)验证是否安装成功了包(1方法)

- 3.2)查看安装了哪些包(2方法)

- 3.3)pip和conda之间仍然有一定的区别

- 四、运行代码

-

- 1、发送代码到服务器

- 2、激活虚拟环境

- 3、进入指定文件夹

- 4、运行代码

- 5、保存结果

- 五、琐碎知识点

零、写在前面

因为最近一项大作业需要复现知识追踪的经典模型,所以要跑DKT等深度学习的模型,而自己的电脑性能又不够强大,所以需要连接导师的服务器跑模型,前后用了两三天去处理,中间也遇到了很多弯路,就权当是记录下自己学习的心路历程。

一、准备事项

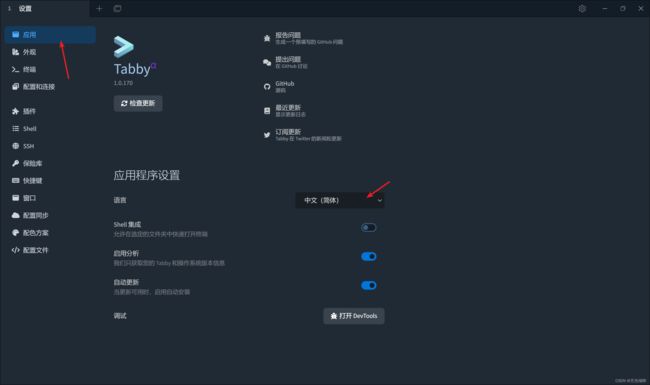

1、一款终端工具,我选用的是Tabby Terminal,应该各种工具都差不太多,安装过程比较简单应该是全程傻瓜式操作,也可以参考如下csdn博客:

https://blog.csdn.net/Xminyang/article/details/124516865

2、服务器的IP地址以及连接老师服务器的用户名和密码,这部分应该导师或者是师兄师姐会帮忙建立好。

3、模型代码,就从Github上面搜索即可,语言一般是python。我跑的这部分DKT的csdn博客和GitHub地址如下:

https://blog.csdn.net/qq_40282662/article/details/108896373

https://github.com/YAO0747/study/tree/master/DKT

二、连接服务器

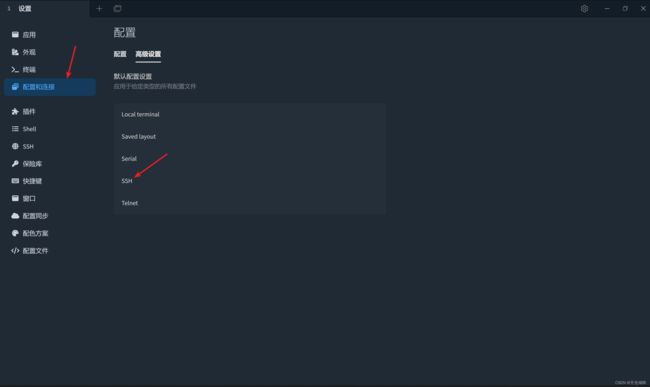

2、如下点击。

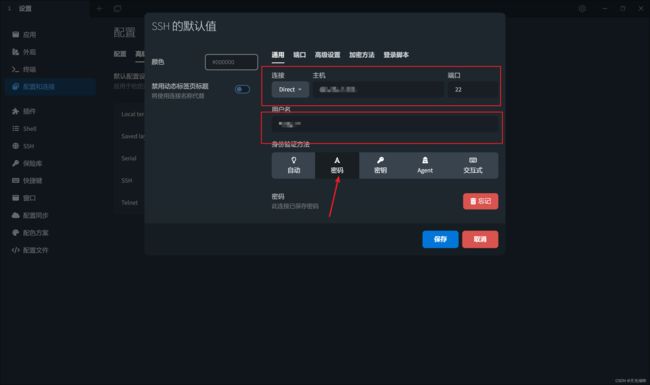

3、输入服务器ip地址以及自己的用户名,且同时选择以密码的方式连接。

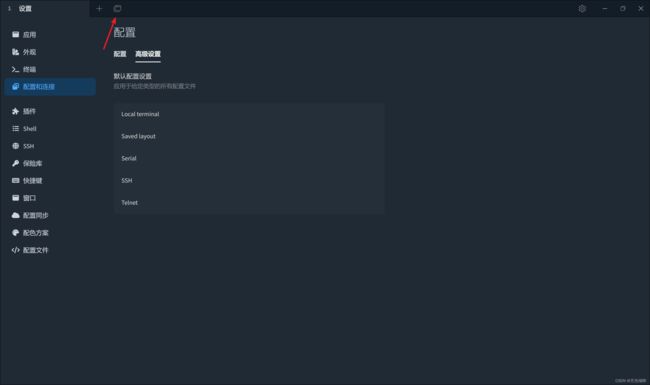

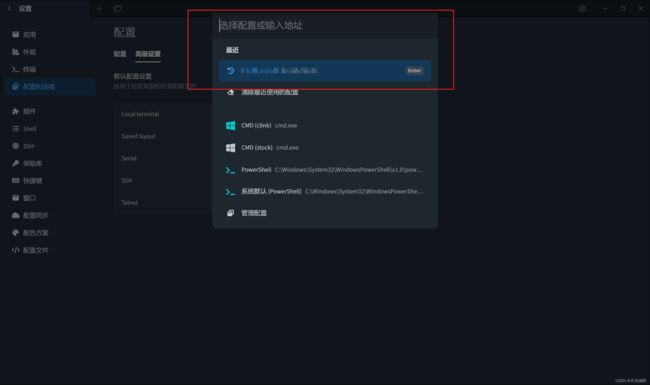

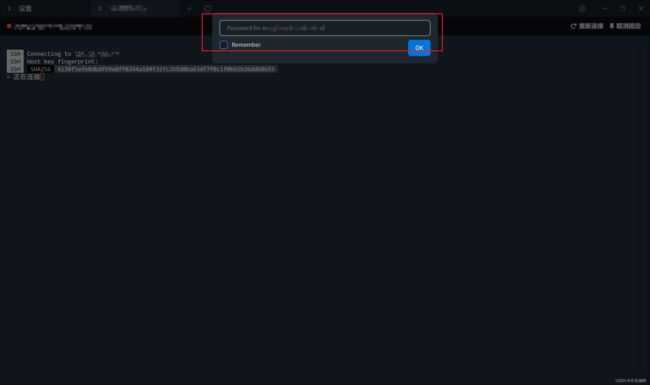

4、开始连接,输入地址并点击enter。

5、输入密码并连接。

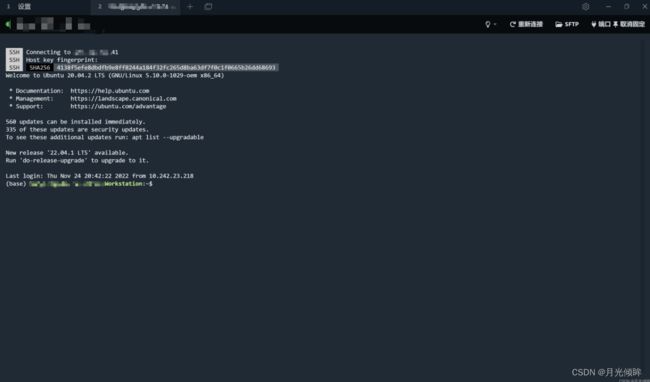

6、连接成功

三、配置python环境

1、知识点(环境和解释器)

之前学习python的时候一直也马马虎虎的,因为没有涉及到大的项目,也就没有用到很多包。这两天在学习的过程中才发觉这样的知识点:python程序的运行,需要环境和解释器。

(1)环境

环境用于加载各种包,也就是python中import的内容,环境分为base环境和虚拟环境。

1)base环境

是默认的环境,import的内容可以安装在环境之中,这样程序才能调用运行。

2)虚拟环境

但是最好是不要用哪个包就把哪个包安装在base环境中(默认环境),因为有的项目之间使用的包是互相排斥(或者说互相影响),而这样的排斥(影响)会给编码者带来很多困扰,要多走很多弯路,那么又不能使用完某一个包就卸载掉,那么如何解决这种问题呢?虚拟环境就应运而生了,我们可以为不同的项目设置不同的虚拟环境,一个项目对应一个虚拟环境,某个项目需要哪些包,就在对应的虚拟环境安装哪些包。这样就完美解决了包之间互相排斥(影响)的难题。

(2)解释器

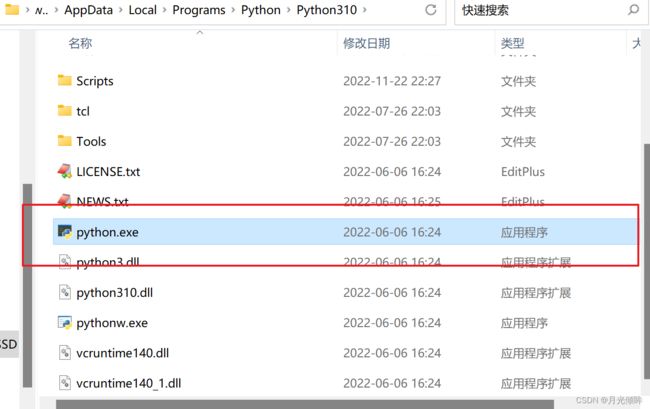

解释器就是python.exe,每个电脑中都会安装python,python的版本可能是不同的,一台电脑中可能安装了很多版本的python,比如python2.7,python3.6,python3.8,python3.10等版本,有的项目代码是python3.x写的,所以如果使用安装在电脑里的python2.7就无法运行。这个时候就需要找到电脑中安装python3.x(如果安装了的话,没有安装就去安装)的位置,找到python.exe(如下图)作为本项目代码的解释器。

不过一般最好是只在电脑中安装一个高版本的python就够了。

2、在服务器中配置环境和解释器

(1)安装Anaconda

一般来说,一部已经被师兄师姐使用的服务器应该已经安装过了Anaconda,所以一般来说这一步骤可以忽略,如果没有安装,那么按照如下步骤(因为服务器中已经安装了Anaconda,所以这段是复制的,并没有实操)。

1)下载安装文件

2)安装:

$ bash Anaconda3-2021.05-Linux-x86_64.sh

3)配置环境变量

在/etc/profile文件的未尾添加如下语句(第一行的“=”后面是Anaconda的安装地址):

export ANACONDA_HOME=/usr/local/anaconda3

export PATH=$ANACONDA_HOME/bin:$PATH

(2)创建虚拟环境

一般来讲,深度学习创建两种环境就够了,一种是PyTorch-GPU;另一种是TensorFlow-GPU。这两个最好不要同时安装,可能会产生一些冲突(影响),详见如下链接:

https://www.zhihu.com/question/353248304?ivk_sa=1024320u

其实我也没有将二者(PyTorch和TensorFlow)安装到一起,只是师兄建议我不要这样做,我也自己好奇查了一下,大意(个人理解)应该是TensorFlow会将整个GPU占满,所以Pytorch就算安装了也无法使用。

1)PyTorch-GPU

(a)创建虚拟环境(name后面的“pytorch_gpu”为虚拟环境的名字,建议加上自己的名字作为前缀以用来区分)

$ conda create --name pytorch_gpu python=3.8

(b)激活虚拟环境

$ conda activate pytorch_gpu

(c)安装pytorch_gpu包

$ conda install pytorch_gpu

2)TensorFlow-GPU

(a)创建虚拟环境(name后面的“tensorflow_gpu”为虚拟环境的名字,建议加上自己的名字作为前缀以用来区分)

$ conda create --name tensorflow_gpu python=3.8

(b)激活虚拟环境

$ conda activate tensorflow_gpu

(c)安装tensorflow-gpu包

$ conda install tensorflow-gpu

(3)安装所项目运行所需要的包

1)pip和conda的区别

详见以下博客:

https://blog.csdn.net/qq_36408250/article/details/115457096

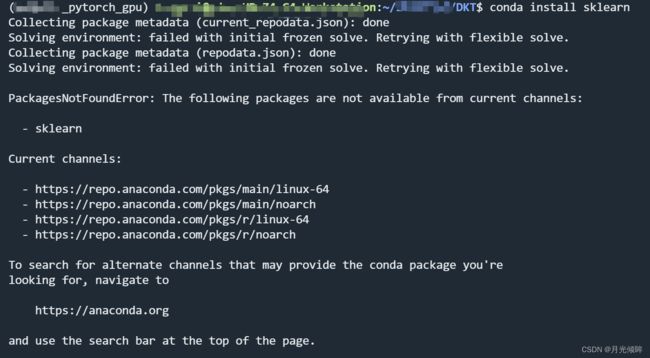

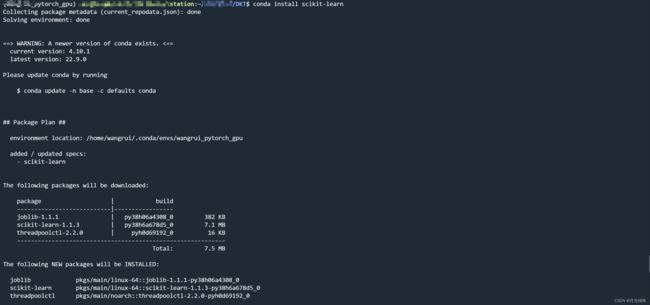

我自己的感受就是conda有时候报错了就是用pip,个人感觉pip的速度要慢很多,我自己安装sklearn库的时候就会报错,搜索了很多方法,也没有解决。

见如下博客:

https://blog.csdn.net/Angeldream123/article/details/126767827

https://segmentfault.com/q/1010000041659110?bd_source_light=4746641

后来使用pip命令就成功下载了,但是速度很慢。

2)使用pip或conda下载

安装包的时候有一个小坑,就是我运行某个文件,报错说我缺少某个包

但是其实不一定要安装这个名字的包,因为1)中我conda install sklearn 就会报错,但是如果我安装scikit-learn就不会报错,所以如果有的时候安装包出错了,看一看是不是这个包有其他的名字

3)使用pip或conda下载

按照项目中所需要的包,使用pip或conda下载即可。

3.1)验证是否安装成功了包(1方法)

(a)进入python编辑器

$ python

(b)输入本行代码,import后面的为自己要安装的包,如果安装成功了那么不会报错,否则会报错。

import torch

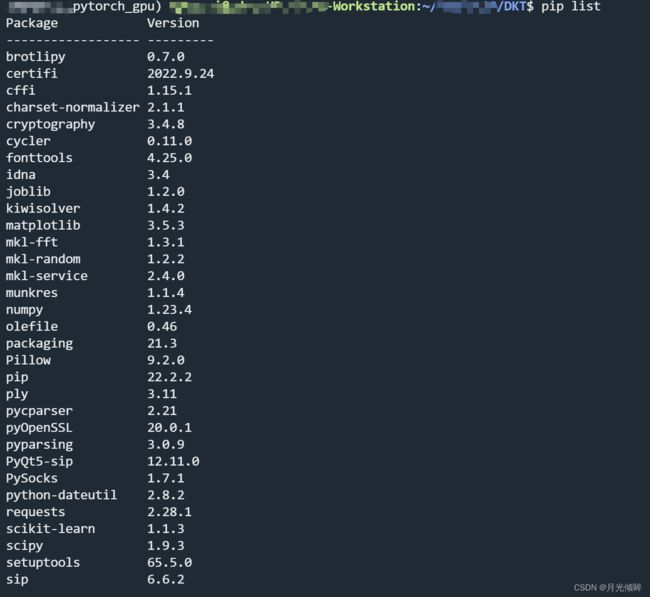

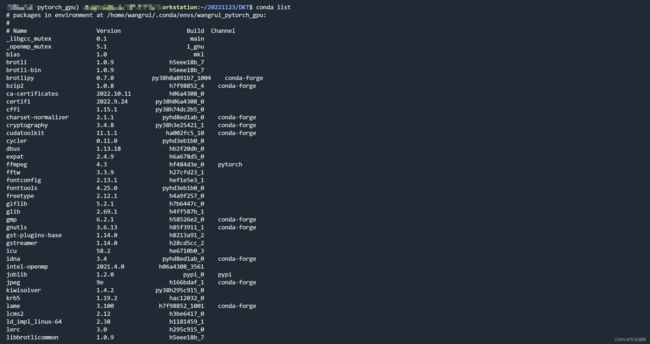

3.2)查看安装了哪些包(2方法)

使用以下两种命令之一查看自己安装了哪些包

pip list

conda list

3.3)pip和conda之间仍然有一定的区别

详见以下博客

https://blog.csdn.net/itigoitie/article/details/126938742?spm=1001.2101.3001.6661.1&utm_medium=distribute.pc_relevant_t0.none-task-blog-2%7Edefault%7EBlogCommendFromBaidu%7ERate-1-126938742-blog-125595201.pc_relevant_3mothn_strategy_recovery&depth_1-utm_source=distribute.pc_relevant_t0.none-task-blog-2%7Edefault%7EBlogCommendFromBaidu%7ERate-1-126938742-blog-125595201.pc_relevant_3mothn_strategy_recovery&utm_relevant_index=1

四、运行代码

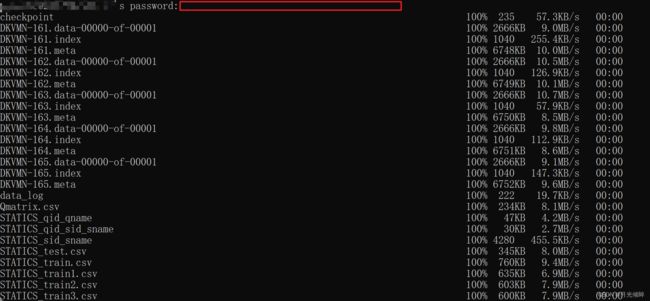

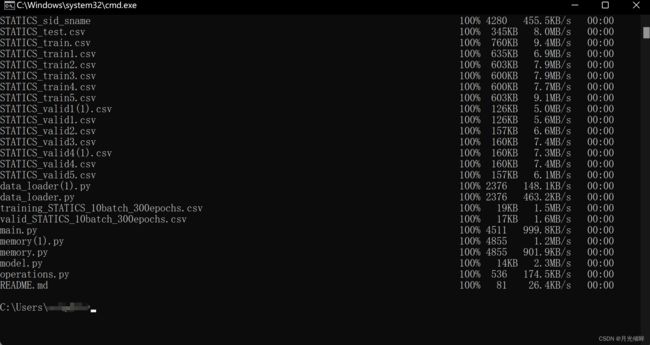

1、发送代码到服务器

(1)在自己电脑的终端输入以下命令:

scp -r /home/melody/PycharmProjects/Salicon_pytorch-master yang@125.216.241.203:/home/yang/projects

/home/melody/PycharmProjects/Salicon_pytorch-master:是本机的项目文件地址

yang:为自己在服务器上的用户名

125.216.241.203:服务器的ip地址

/home/yang/projects:服务器中要保存文件的位置

参考了以下博客

https://blog.csdn.net/Dabria1999/article/details/109855129

(2)输入密码

这里有个小坑是,终端输入密码是不显示的,连*号都不显示

(3)完成

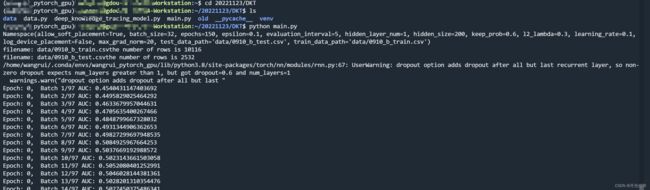

2、激活虚拟环境

3、进入指定文件夹

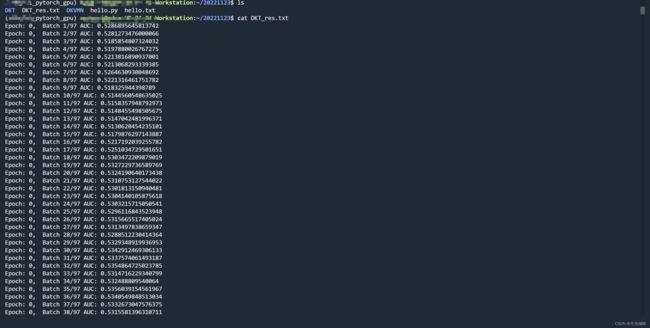

cd 20221123/DKT

4、运行代码

5、保存结果

光标放在结果的最后,用侧边滚轮一直找到头部,按住shift,再左键点击结果的最前,cirl+c复制,可以选择粘贴到自己的电脑里,也可以在服务器的相应文件夹内建立一个txt文档,使用vim编辑器保存结果。

运行结果是真的很长

五、琐碎知识点

主要是一些Linux的命令,死去的本科记忆又开始攻击我了。

1、ls:当前目录下的文件都有哪些

2、cd: 进入到某个文件路径

3、cd … :返回上一级

4、mkdir 文件夹名称:新建文件夹

5、vim编辑器的一些操作

(1)vi 文件名称:编辑该文件(若是不存在则会帮助我们建立)

(2)(1)命令之后,会进入到该文件中,默认是命令窗口,此时敲击键盘是命令,而不是保存内容,敲击i键进入到insert模式开始编辑

(3)编辑好后,点击ESC键退出编辑模式,敲:wq,是三个字符,冒号和wq,为保存退出。:w!是不保存退出。

vim编辑器的一些操作可以学习观看如下视频

https://www.bilibili.com/video/BV1Yt411X7mu/?spm_id_from=333.999.0.0&vd_source=af33f889c908f0b23226dc4a0cda4125