LSTM网络中各层解读

构建深度神经网络最关键的部分之一是——当数据流经不同的层时,要对其有一个清晰的视图,这些层经历了维度的变化、形状的改变、扁平化和重新塑造……

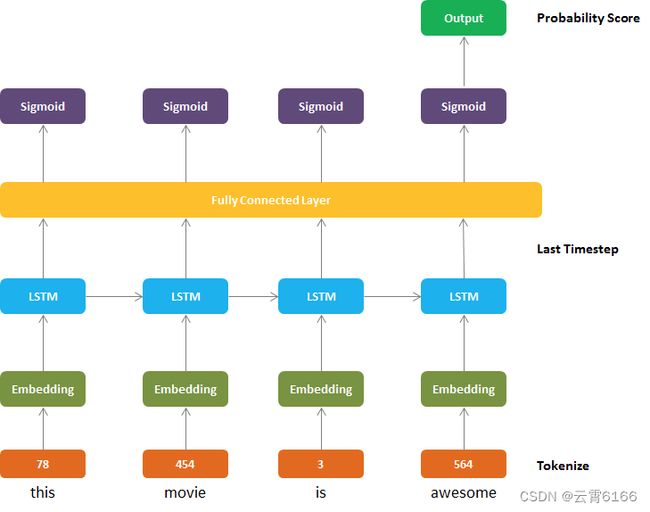

结构顺序

每层解读:

- 把单词变为tokens;

- embedding 把每个token变成特定大小的embedding;

- LSTM 由隐藏状态维度和层数决定;

- 全连接层;

- 激活函数;

- 输出;

预处理

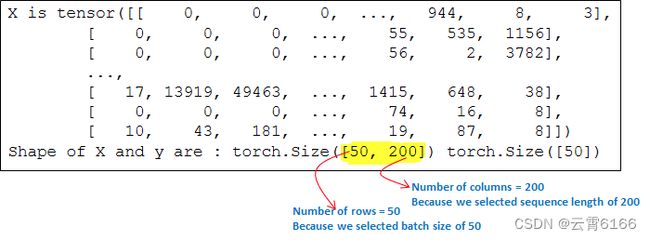

对数据进行了预处理,使得batch_size=50, 序列长度为200

dataiter = iter(train_loader)

x, y = dataiter.next()

x = x.type(torch.LongTensor)

print ('X is', x)

print ('Shape of X and y are :', x.shape, y.shape)

从X的形状可以看出,X是一个张量,为50行(=batch size)和200列(=sequence length)。

这个X将作为嵌入层的输入

Embedding layer

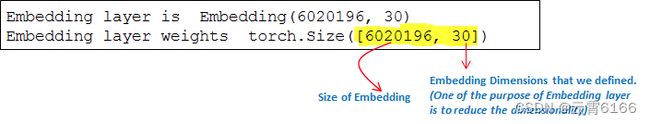

使用torch.nn.Embedding模块作嵌入。它需要两个参数:词汇表大小和嵌入的维数

from torch import nn

vocab_size = len(words)

embedding_dim = 30

embeds = nn.Embedding(vocab_size, embedding_dim)

print ('Embedding layer is ', embeds)

print ('Embedding layer weights ', embeds.weight.shape)

embeds_out = embeds(x)

print ('Embedding layer output shape', embeds_out.shape)

print ('Embedding layer output ', embeds_out)

从嵌入层的输出可以看出,它作为嵌入权值的结果创建了一个三维张量。现在它有50行,200列和30个嵌入维,也就是说,在我们的审查中,我们为每个标记化的单词添加了嵌入维。该数据现在将进入LSTM层

LSTM Layer

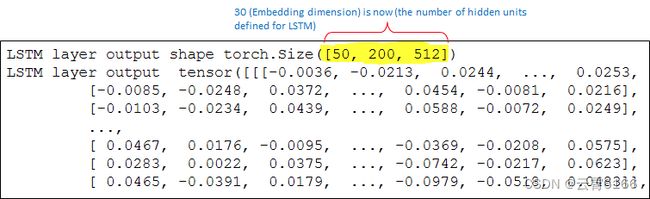

在定义LSTM层时,我们保持Batch First = True和隐藏单元的数量= 512。

# initializing the hidden state to 0

hidden=None

lstm = nn.LSTM(input_size=embedding_dim, hidden_size=512, num_layers=1, batch_first=True)

lstm_out, h = lstm(embeds_out, hidden)

print ('LSTM layer output shape', lstm_out.shape)

print ('LSTM layer output ', lstm_out)

通过查看LSTM层的输出,我们可以看到张量现在有50行,200列和512个LSTM节点。接下来,该数据被提取到全连接层

LSTM层的输出包括三个:Outputs: output, (h_n, c_n)

Outputs是整个模型的所有h参数的输出,张量大小为(N,L,D∗H)

h_n代表最后一个h的输出,张量大小为(D∗num_layers,N,H)

c_n代表最后一个c的输出,张量大小为(D∗num_layers,N,H)

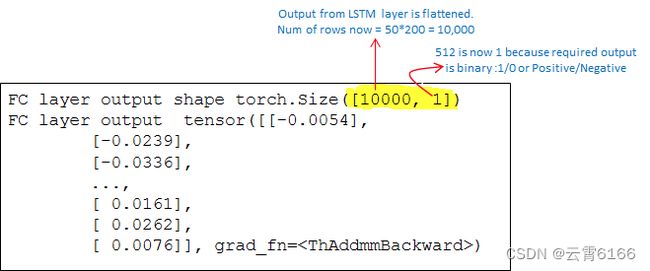

Fully Connected Layer

对于全连通层,输入特征数= LSTM中隐藏单元数。输出大小= 1,因为我们只有二进制结果(1/0;正和负)

fc = nn.Linear(in_features=512, out_features=1)

fc_out = fc(lstm_out.contiguous().view(-1, 512))

print ('FC layer output shape', fc_out.shape)

print ('FC layer output ', fc_out)

注意,在将lstm输出放入fc层之前,必须将其压平。

fc = nn.Linear(in_features=512, out_features=1)

fc_out = fc(lstm_out.contiguous().view(-1, 512))

print ('FC layer output shape', fc_out.shape)

print ('FC layer output ', fc_out)

Sigmoid Activation Layer

这只是为了将所有的输出值从完全连接的层转换为0到1之间的值

sigm = nn.Sigmoid()

sigm_out = sigm(fc_out)

print ('Sigmoid layer output shape', sigm_out.shape)

print ('Sigmoid layer output ', sigm_out)

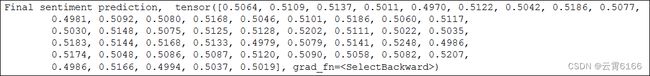

Final Output

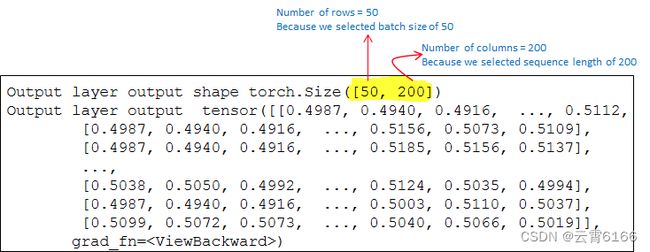

这包括两个步骤:首先,重塑输出,使rows = batch大小

batch_size = x.shape[0]

out = sigm_out.view(batch_size, -1)

print ('Output layer output shape', out.shape)

print ('Output layer output ', out)

正如我们在网络体系结构中看到的那样——我们只希望在最后一个序列之后进行输出(在最后一个时间步之后)

print ('Final sentiment prediction, ', out[:,-1])

这些输出来自未经训练的网络,因此这些值可能还不表示任何内容。这只是为了说明,我们将使用这些知识来正确定义模型。