《MATLAB 神经网络43个案例分析》:第36章 遗传算法优化计算——建模自变量降维

《MATLAB 神经网络43个案例分析》:第36章 遗传算法优化计算——建模自变量降维

- 1. 前言

- 2. MATLAB 仿真示例

- 3. 小结

1. 前言

《MATLAB 神经网络43个案例分析》是MATLAB技术论坛(www.matlabsky.com)策划,由王小川老师主导,2013年北京航空航天大学出版社出版的关于MATLAB为工具的一本MATLAB实例教学书籍,是在《MATLAB神经网络30个案例分析》的基础上修改、补充而成的,秉承着“理论讲解—案例分析—应用扩展”这一特色,帮助读者更加直观、生动地学习神经网络。

《MATLAB神经网络43个案例分析》共有43章,内容涵盖常见的神经网络(BP、RBF、SOM、Hopfield、Elman、LVQ、Kohonen、GRNN、NARX等)以及相关智能算法(SVM、决策树、随机森林、极限学习机等)。同时,部分章节也涉及了常见的优化算法(遗传算法、蚁群算法等)与神经网络的结合问题。此外,《MATLAB神经网络43个案例分析》还介绍了MATLAB R2012b中神经网络工具箱的新增功能与特性,如神经网络并行计算、定制神经网络、神经网络高效编程等。

近年来随着人工智能研究的兴起,神经网络这个相关方向也迎来了又一阵研究热潮,由于其在信号处理领域中的不俗表现,神经网络方法也在不断深入应用到语音和图像方向的各种应用当中,本文结合书中案例,对其进行仿真实现,也算是进行一次重新学习,希望可以温故知新,加强并提升自己对神经网络这一方法在各领域中应用的理解与实践。自己正好在多抓鱼上入手了这本书,下面开始进行仿真示例,主要以介绍各章节中源码应用示例为主,本文主要基于MATLAB2015b(32位)平台仿真实现,这是本书第三十六章遗传算法优化计算实例,话不多说,开始!

2. MATLAB 仿真示例

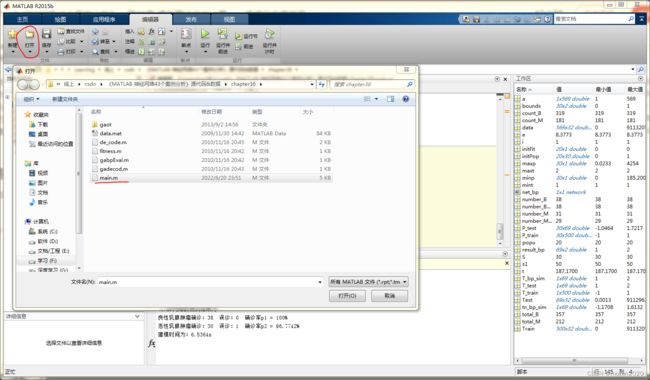

打开MATLAB,点击“主页”,点击“打开”,找到示例文件

选中main.m,点击“打开”

main.m源码如下:

%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%

%功能: 遗传算法的优化计算——输入自变量降维

%环境:Win7,Matlab2015b

%Modi: C.S

%时间:2022-06-20

%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%

%% 遗传算法的优化计算——输入自变量降维

%% 清空环境变量

clear all

clc

warning off

%% 声明全局变量

tic

global P_train T_train P_test T_test mint maxt S s1

S = 30;

s1 = 50;

%% 导入数据

load data.mat

a = randperm(569);

Train = data(a(1:500),:);

Test = data(a(501:end),:);

% 训练数据

P_train = Train(:,3:end)';

T_train = Train(:,2)';

% 测试数据

P_test = Test(:,3:end)';

T_test = Test(:,2)';

% 显示实验条件

total_B = length(find(data(:,2) == 1));

total_M = length(find(data(:,2) == 2));

count_B = length(find(T_train == 1));

count_M = length(find(T_train == 2));

number_B = length(find(T_test == 1));

number_M = length(find(T_test == 2));

disp('实验条件为:');

disp(['病例总数:' num2str(569)...

' 良性:' num2str(total_B)...

' 恶性:' num2str(total_M)]);

disp(['训练集病例总数:' num2str(500)...

' 良性:' num2str(count_B)...

' 恶性:' num2str(count_M)]);

disp(['测试集病例总数:' num2str(69)...

' 良性:' num2str(number_B)...

' 恶性:' num2str(number_M)]);

%% 数据归一化

[P_train,minp,maxp,T_train,mint,maxt] = premnmx(P_train,T_train);

P_test = tramnmx(P_test,minp,maxp);

%% 创建单BP网络

t = cputime;

net_bp = newff(minmax(P_train),[s1,1],{'tansig','purelin'},'trainlm');

% 设置训练参数

net_bp.trainParam.epochs = 1000;

net_bp.trainParam.show = 10;

net_bp.trainParam.goal = 0.1;

net_bp.trainParam.lr = 0.1;

net_bp.trainParam.showwindow = 0;

%% 训练单BP网络

net_bp = train(net_bp,P_train,T_train);

%% 仿真测试单BP网络

tn_bp_sim = sim(net_bp,P_test);

% 反归一化

T_bp_sim = postmnmx(tn_bp_sim,mint,maxt);

e = cputime - t;

T_bp_sim(T_bp_sim > 1.5) = 2;

T_bp_sim(T_bp_sim < 1.5) = 1;

result_bp = [T_bp_sim' T_test'];

%% 结果显示(单BP网络)

number_B_sim = length(find(T_bp_sim == 1 & T_test == 1));

number_M_sim = length(find(T_bp_sim == 2 &T_test == 2));

disp('(1)BP网络的测试结果为:');

disp(['良性乳腺肿瘤确诊:' num2str(number_B_sim)...

' 误诊:' num2str(number_B - number_B_sim)...

' 确诊率p1 = ' num2str(number_B_sim/number_B*100) '%']);

disp(['恶性乳腺肿瘤确诊:' num2str(number_M_sim)...

' 误诊:' num2str(number_M - number_M_sim)...

' 确诊率p2 = ' num2str(number_M_sim/number_M*100) '%']);

disp(['建模时间为:' num2str(e) 's'] );

%% 遗传算法优化

popu = 20;

bounds = ones(S,1)*[0,1];

% 产生初始种群

initPop = randint(popu,S,[0 1]);

% 计算初始种群适应度

initFit = zeros(popu,1);

for i = 1:size(initPop,1)

initFit(i) = de_code(initPop(i,:));

end

initPop = [initPop initFit];

gen = 100;

% 优化计算

[X,EndPop,BPop,Trace] = ga(bounds,'fitness',[],initPop,[1e-6 1 0],'maxGenTerm',...

gen,'normGeomSelect',0.09,'simpleXover',2,'boundaryMutation',[2 gen 3]);

[m,n] = find(X == 1);

disp(['优化筛选后的输入自变量编号为:' num2str(n)]);

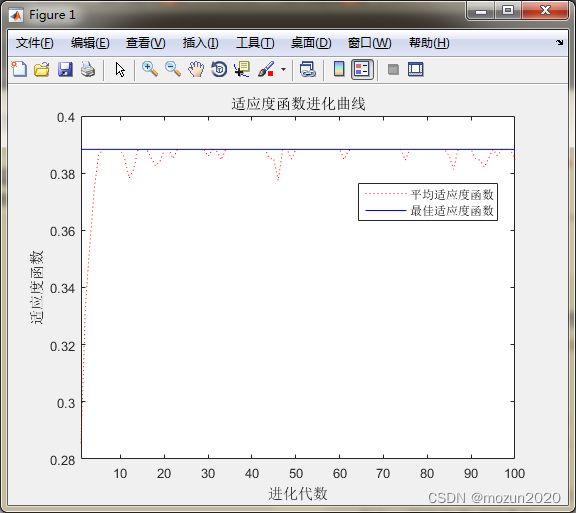

% 绘制适应度函数进化曲线

figure

plot(Trace(:,1),Trace(:,3),'r:')

hold on

plot(Trace(:,1),Trace(:,2),'b')

xlabel('进化代数')

ylabel('适应度函数')

title('适应度函数进化曲线')

legend('平均适应度函数','最佳适应度函数')

xlim([1 gen])

%% 新训练集/测试集数据提取

p_train = zeros(size(n,2),size(T_train,2));

p_test = zeros(size(n,2),size(T_test,2));

for i = 1:length(n)

p_train(i,:) = P_train(n(i),:);

p_test(i,:) = P_test(n(i),:);

end

t_train = T_train;

%% 创建优化BP网络

t = cputime;

net_ga = newff(minmax(p_train),[s1,1],{'tansig','purelin'},'trainlm');

% 训练参数设置

net_ga.trainParam.epochs = 1000;

net_ga.trainParam.show = 10;

net_ga.trainParam.goal = 0.1;

net_ga.trainParam.lr = 0.1;

net_ga.trainParam.showwindow = 0;

%% 训练优化BP网络

net_ga = train(net_ga,p_train,t_train);

%% 仿真测试优化BP网络

tn_ga_sim = sim(net_ga,p_test);

% 反归一化

T_ga_sim = postmnmx(tn_ga_sim,mint,maxt);

e = cputime - t;

T_ga_sim(T_ga_sim > 1.5) = 2;

T_ga_sim(T_ga_sim < 1.5) = 1;

result_ga = [T_ga_sim' T_test'];

%% 结果显示(优化BP网络)

number_b_sim = length(find(T_ga_sim == 1 & T_test == 1));

number_m_sim = length(find(T_ga_sim == 2 &T_test == 2));

disp('(2)优化BP网络的测试结果为:');

disp(['良性乳腺肿瘤确诊:' num2str(number_b_sim)...

' 误诊:' num2str(number_B - number_b_sim)...

' 确诊率p1=' num2str(number_b_sim/number_B*100) '%']);

disp(['恶性乳腺肿瘤确诊:' num2str(number_m_sim)...

' 误诊:' num2str(number_M - number_m_sim)...

' 确诊率p2=' num2str(number_m_sim/number_M*100) '%']);

disp(['建模时间为:' num2str(e) 's'] );

toc

将goat设置为包含路径(需调用文件夹中函数进行仿真),添加完毕,点击“运行”,开始仿真,输出仿真结果如下:

实验条件为:

病例总数:569 良性:357 恶性:212

训练集病例总数:500 良性:310 恶性:190

测试集病例总数:69 良性:47 恶性:22

(1)BP网络的测试结果为:

良性乳腺肿瘤确诊:46 误诊:1 确诊率p1 = 97.8723%

恶性乳腺肿瘤确诊:19 误诊:3 确诊率p2 = 86.3636%

建模时间为:7.3164s

优化筛选后的输入自变量编号为:1 2 3 4 5 7 10 12 13 14 16 17 18 20 23 26 28 29 30

(2)优化BP网络的测试结果为:

良性乳腺肿瘤确诊:47 误诊:0 确诊率p1=100%

恶性乳腺肿瘤确诊:19 误诊:3 确诊率p2=86.3636%

建模时间为:2.3088s

时间已过 153.074566 秒。

3. 小结

遗传算法(Genetic Algorithm,GA)最早是由美国的 John holland于20世纪70年代提出,该算法是根据大自然中生物体进化规律而设计提出的。是模拟达尔文生物进化论的自然选择和遗传学机理的生物进化过程的计算模型,是一种通过模拟自然进化过程搜索最优解的方法。该算法通过数学的方式,利用计算机仿真运算,将问题的求解过程转换成类似生物进化中的染色体基因的交叉、变异等过程。在求解较为复杂的组合优化问题时,相对一些常规的优化算法,通常能够较快地获得较好的优化结果。遗传算法已被人们广泛地应用于组合优化、机器学习、信号处理、自适应控制和人工生命等领域。在视觉机器学习20讲专栏中也有遗传算法相关的实例应用,以及本专栏第三章遗传算法优化BP神经网络的实例,第四章神经网络遗传算法函数极值寻优示例,具体见文末链接。对本章内容感兴趣或者想充分学习了解的,建议去研习书中第三十六章节的内容。后期会对其中一些知识点在自己理解的基础上进行补充,欢迎大家一起学习交流。

视觉机器学习20讲-MATLAB源码示例(19)-遗传算法

《MATLAB 神经网络43个案例分析》:第3章 遗传算法优化BP神经网络——非线性函数拟合

[《MATLAB 神经网络43个案例分析》:第4章 神经网络遗传算法函数极值寻优——非线性函数极值寻优]