“跨次元”检测模型hold住各种画风,真人赛博,在线Demo可玩

来源:量子位

目标检测种类多达20000+种的AI,你见过吗?

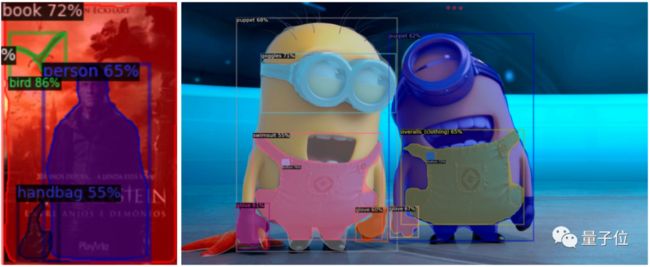

不仅准确“揪出”每个物体所在的位置,分类效果非常准确:

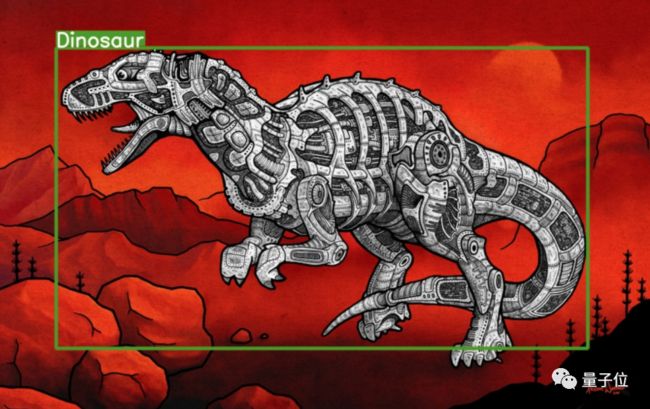

插画版赛博恐龙也没问题:

甚至还能检测杂志封面甚至漫画中的物体!

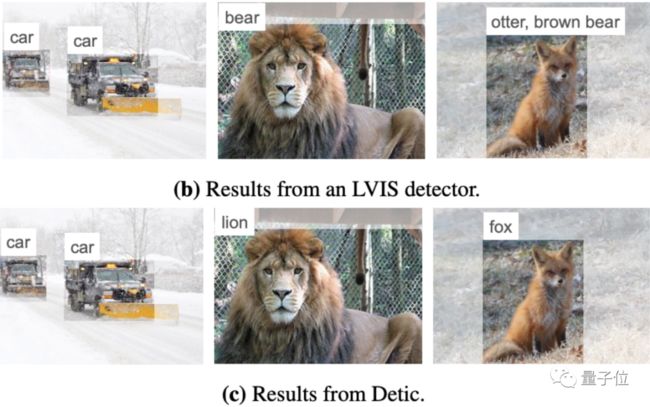

这也是把目标检测给玩出花来了,据作者表示模型在长尾问题等细节上的处理非常好,像狮子和狐狸这种少样本也能准确识别:

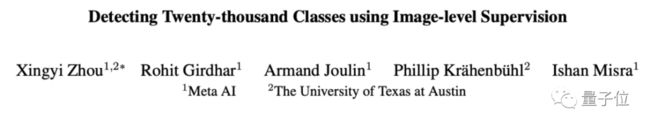

这项研究来自Meta AI和德克萨斯大学奥斯汀分校,一作是著名目标检测框架CenterNet的作者、复旦校友Xingyi Zhou。

一起来看看。

可识别“跨次元”物体

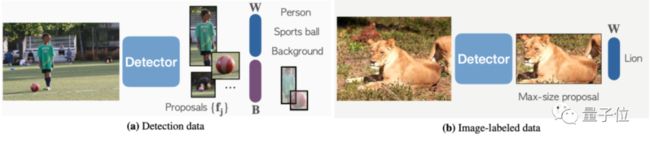

这篇论文提出了一种新的名为Detic的方法,用来解决目标检测无法用到图像级标签(给一整张图打标签,标注里面有什么物体)的问题。

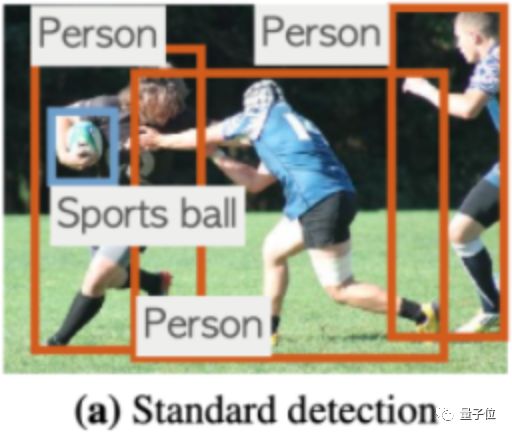

此前的目标检测方法,通常是一个检测框里一个物体:

这种方法有一个问题,就是没办法利用整个图像级标签,只能用单个物体的图片进行训练。

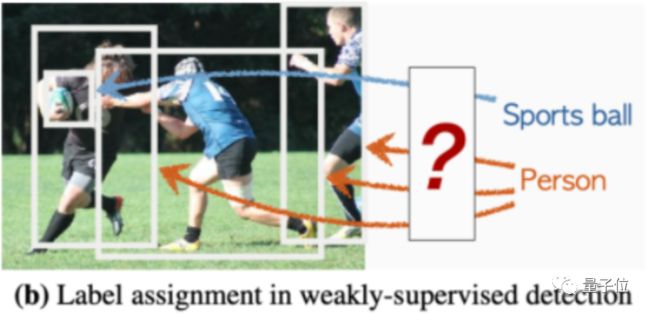

也有一些研究想出了一种新方法,搞个弱监督学习,试图让AI自己学会将图像级的标签,去对应锚定框里面有什么物体,但实际上这种方法的效果也不太好。

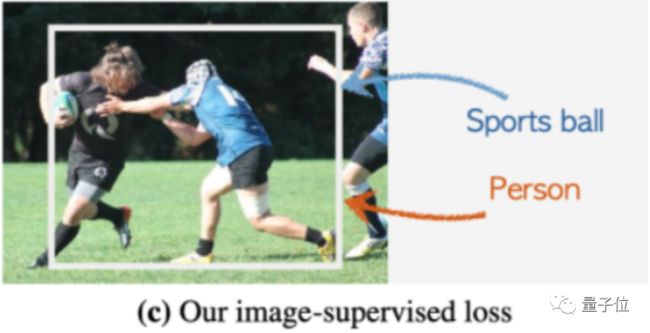

Detic的方法是采用目标检测数据(a)和图像标签数据(b)对Detic进行混合训练。

其中,在用目标检测数据训练Detic时,同时对图像分类模块W和目标检测模块B进行训练,但只用标签数据对图像分类模块W进行训练。

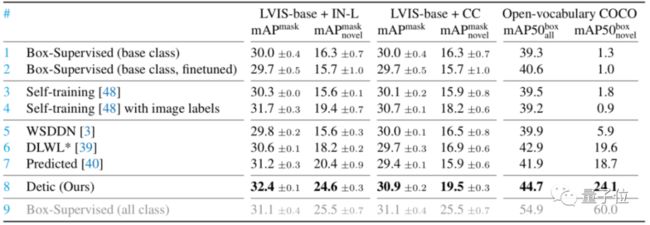

训练的数据集采用的是ImageNet,事实证明模型在训练后无需微调,就能很好地适应到LVIS等数据集,相对之前的一些模型都达到了不错的效果:

论文表示,Detic能分类的图片类型也是多种多样,从真实照片到赛博恐龙插画这样的“跨次元”作品都能识别:

这立刻吸引了不少网友来玩。

在线Demo可玩

有网友用梵高的世界名画试了试。

放大一点来看,艺术加工后的椅子、人和桌子也能被识别:

还有用二次元的龙猫进行识别的,除了龙猫本身被错认成猫头鹰以外,其他的雨伞和靴子都认得不错:

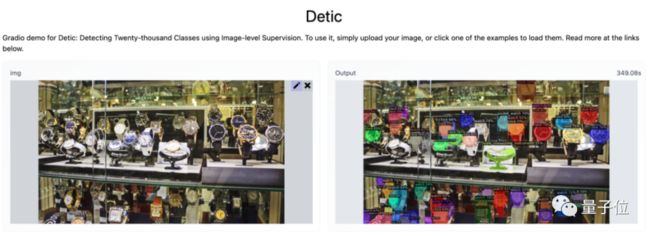

我们也随便用一个钟表柜的照片试了试,在线Demo的检测时间稍微有点久,大约需要6分钟左右,但效果还不错:

细看的话还是能发现一些瑕疵,例如把部分手表误认成转速计、以及怀表和时钟,以及也有一两块手表没有被检测出来。

不过,即使在二次元和插画中,这个AI能识别的物体,至少也需要在真实世界出现过。

例如,超出20000个分类的物体,如喷火龙和皮卡丘,就不在AI的监测范围内了,全部被认成了猴子(狗头):

将这些二次元角色也加入AI训练数据集中,不知能否取得同样的检测效果。

作者介绍

△这张照片是“女朋友拍的”

论文一作Xingyi Zhou,目前在德克萨斯大学奥斯汀分校读博,本科就读于复旦大学计算机系,之前也是CenterNet论文的第一作者,项目在GitHub上目前已经收获6.1k Star。

Rohit Girdhar、Armand Joulin和Ishan Misra,Meta AI的研究科学家,主要研究方向是机器学习和计算机视觉,此前Armand Joulin曾经在李飞飞的实验室进行博士后工作。

Philipp Krähenbühl,德克萨斯大学奥斯汀分校助理教授,Xingyi Zhou的导师,研究方向是计算机视觉、机器学习和计算机图形学。

感兴趣的小伙伴,赶紧试试你想玩的漫画、或是杂志插画吧~

Demo地址:

https://huggingface.co/spaces/akhaliq/Detic

论文地址:

https://arxiv.org/abs/2201.02605

参考链接:

[1]https://www.cs.utexas.edu/~zhouxy/

[2]https://twitter.com/ak92501/status/1480704961101148162

推荐阅读

【重磅】斯坦福李飞飞《注意力与Transformer》总结,84页ppt开放下载!

苏黎世联邦理工学院SML课题组招收统计机器学习全奖博士生

读博五年,我总结出了7条帮你「少走弯路」的真理

仅需12层网络,在ImageNet上准确率达到80.7%!普林斯顿大学最新提出ParNet!

MobileViT: 一种更小,更快,高精度的轻量级Transformer端侧网络架构(附代码实现)

【移动端最强架构】LCNet吊打现有主流轻量型网络(附代码实现)

基于Attention机制的轻量级网络架构以及代码实现

深度学习中的轻量级网络架构总结与代码实现

一文详解Inception家族的前世今生(从InceptionV1-V4、Xception)附全部代码实现

华为2012实验室诺亚方舟实验室招聘视觉感知算法实习生

欢迎大家加入DLer-计算机视觉&Transformer群!

大家好,这是计算机视觉&Transformer论文分享群里,群里会第一时间发布最新的Transformer前沿论文解读及交流分享会,主要设计方向有:图像分类、Transformer、目标检测、目标跟踪、点云与语义分割、GAN、超分辨率、视频超分、人脸检测与识别、动作行为与时空运动、模型压缩和量化剪枝、迁移学习、人体姿态估计等内容。

进群请备注:研究方向+学校/公司+昵称(如Transformer+上交+小明)

长按识别,邀请您进群!