BERT、RoBERTa、DistilBERT、XLNet,我们到底该如何选择?

BERT

BERT是一种双向transformer,旨在利用大量未标记文本数据进行预训练,从而学习并掌握某种语言表达形式。更重要的是,这种表达形式还可以针对特定机器学习任务进行进一步调优。虽然BERT在多项任务中都带来了超越以往最强NLP技术的实际表现,但其性能的提升,主要还是归功于双向transformer、掩蔽语言模型与下一结构预测(Next Structure Prediction),外加谷歌本身强大的数据资源与计算能力。

最近,NLP业界又出现了多种旨在改进BERT预测指标或计算速度的新方法,但却始终难以同时达成这两大提升目标。其中XLNet与RoBERTa推动性能更上一层楼,而DistilBERT则改善了推理速度。下表为各种方法之间的特性比对:

BERT及近期几种相关方法的改进效果比对: GPU时间为估算值(使用4个TPU Pod进行周期为4天的初始训练);使用大量小批次数据,在较长的训练周期内,各方法的学习速度、步长以及掩蔽过程都有所不同; 除特殊说明,相关数据来自原始论文。

XLNet

XLNet是一种大型双向transformer,采用的是一种经过改进的训练方法。这种训练方法能够利用规模更大的数据集与更强的计算能力在20项语言任务中获得优于BERT的预测指标。

为了改进训练方法,XLNet还引入了转换语言建模,其中所有标记都按照随机顺序进行预测。这就与BERT的掩蔽语言模型形成了鲜明对比。具体来讲,BERT只预测文本中的掩蔽部分(占比仅为15%)。这种方法也颠覆了传统语言模型当中,所有标记皆按顺序进行预测的惯例。新的方法帮助模型掌握了双向关系,从而更好地处理单词之间的关联与衔接方式。此外该方法还采用Transformer XL作为基础架构,以便在非排序训练场景下同样带来良好的性能表现。

XLMet已经利用超过130 GB文本数据配合512块TPU芯片进行了两天半的训练,这两项指标在规模上都超过了BERT。

RoBERTa

RoBERTa是Facebook公司推出的,经过健壮性优化的BERT改进方案。从本质上讲,RobERTa在BERT的基础上进行了再次训练,并在改善训练方法之余将数据总量与计算资源提升了10倍。

为了优化训练过程,RoBERTa移除了BERT预训练中的下一语句预测(NSP)任务,转而采用动态掩蔽以实现训练轮次中的掩蔽标记变更。此外,Facebook还证实,更大批准的训练规模确实能够提升模型性能。

更重要的是,RoBERTa利用160 GB文本进行预训练,其中包括16 GB文本语料库以及BERT所使用的英文版维基百科。其余部分则包括CommonCrawl News数据集(包含6300万篇文章,总计76 GB)、Web文本语料库(38 GB)以及来自Common Crawl的故事素材(31 GB)。这一素材组合在1024个V100 Tesla上运行了整整一天,共同为RoBERTa提供了坚实的预训练基础。

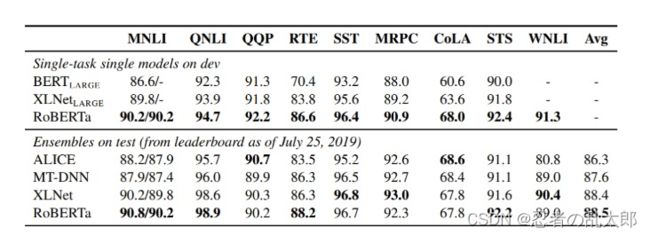

如此一来,RoBERTa在GLUE基准测试当中顺利带来优于BERT与XLNet的性能结果:

RoBERTa性能比较结果。

在另一方面,为了缩短BERT及相关模型的计算(训练、预测)时长,合乎逻辑的尝试自然是选择规模较小的网络以获得类似的性能。目前的剪枝、蒸馏与量化方法都能实现这种效果,但也都会在一定程度上降低预测性能。

DistilBERT

DistilBERT对BERT的一套蒸馏(近似)版本进行学习,性能可达BERT的约95%,但所使用的参数总量仅为BERT的一半。具体来讲,DistilBERT放弃了其中的标记类型与池化层,因此总层数仅相当于谷歌BERT的一半。DistilBER采用了蒸馏技术,即利用多个较小的神经网络共同构成大型神经网络。其中的原理在于,如果要训练一套大型神经网络,不妨先利用小型神经网络预估其完整的输出分布。这种方式有点类似于后验近似。正因为存在这样的相似性,DistilBERT自然也用到了贝叶斯统计中用于后验近似的关键优化函数之一——Kulback Leiber散度。

那么,到底该用哪种方法?

如果大家希望获得更快的推理速度,并能够接受在预测精度方面的一点点妥协,那么DistilBERT应该是最合适的选项。但是,如果各位高度关注预测性能,那么Facebook的RoBERTa无疑才是理想方案。

从理论角度看,XLNet基于排序的训练方法应该能够更好地处理依赖关系,并有望在长期运行中带来更好的性能表现。

然而谷歌BERT本身已经拥有相当强大的基准性能,因此如果各位没有特别的需求,那么继续使用原始BERT模型也是个好主意。

总结

可以看到,大多数性能提升方式(包括BERT自身)都专注于增加数据量、计算能力或者训练过程。虽然这些方法确有价值,但往往要求我们在计算与预测性能之间做出权衡。目前,我们真正需要探索的,显然是如何利用更少的数据与计算资源,帮助模型实现性能提升。

参考资料:

BERT, RoBERTa, DistilBERT, XLNet — which one to use?

BERT、RoBERTa、DistilBERT与XLNet,我们到底该如何选择?