数据预处理-案例

@数据预处理-案例

数据集来源:https://www.kaggle.com/artemskakun/snsdata

无标签数据

1、导包

import pandas as pd

import numpy as np

from pandas import cut #等距离散化

from pandas import qcut #等频离散化

from sklearn.preprocessing import Binarizer #二值化

from sklearn.impute import SimpleImputer #缺失值处理

from sklearn.neighbors import LocalOutlierFactor #离群处理

from sklearn.preprocessing import StandardScaler #标准化Z-score

from sklearn.preprocessing import MinMaxScaler #标准化

from sklearn.preprocessing import RobustScaler #标准化-离群值

from sklearn.preprocessing import OneHotEncoder #特征编码

from sklearn.preprocessing import LabelEncoder #特征编码

import matplotlib.pyplot as plt #画图工具

import warnings

warnings.filterwarnings("ignore") #不显示warning

2、读入数据

data=pd.read_csv("d:/datasets/snsdata.csv") #美国高中生的社交数据

data1=data.copy() #备份不同方法的练习需要

3、探索性分析

data.head() #前5行

data.tail(8) #后8行

data.sample(10) #随机取10行

data.info()

RangeIndex: 30000 entries, 0 to 29999 #样本总数

Data columns (total 40 columns): #特征总数

#Column Non-Null Count Dtype

0 gradyear 30000 non-null int64

#index 特征名 有效值 类型

1 gender 27276 non-null object

非数值型

2 age 24914 non-null float64

…

注:

有效值小于样本总数,有缺失。类型为object ,非数值需要编码

data.describe()

注:

显示数值类型列的统计特征(样本数、均值、标准差、最小、最大、分位数)。

非数值类型不显示

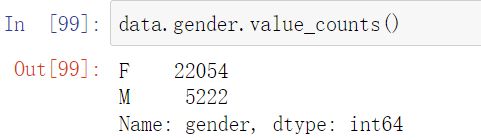

data.gender.value_counts()

注:显示非数值型特征的取值以及各值的个数。(F:有22054个样本。M:有5222个样本)

4、缺失值处理

删除

特征有效样本数少或对结果的影响很小可以考虑

data_new=data.dropna(axis=1,thresh=len(data)*.9) #删除特征(其样本数小于数据集样本总数的90%)

data_new=data.dropna() #删除有缺失值的样本

填充

对数值型数据可以采用均值填充、非数值型数据可以采用众数填充

imp_mean=SimpleImputer(missing_values=np.nan,strategy="mean") #实例化SimpleImputer对象,均值填充

data["age_imp"]=imp_mean.fit_transform(data[["age"]]) #拟合填充,结果保存在数据集的新列上

imp_mode=SimpleImputer(missing_values=np.nan,strategy="most_frequent") ##实例化SimpleImputer对象,众数填充

data["gender_imp"]=imp_mode.fit_transform(data[["gender"]]) #拟合填充,结果保存在数据集的新列上

或

data_new2=data.fillna(method="bfill")

5、离群值检测

3σ

mean_=data.friends.mean()

std_=data.friends.std()

data_n3=data[data.friends<mean_+3*std_][data.friends>mean_-3*std_] #保留3西格玛内的样本

箱线图

data[["age"]].plot(kind="box",figsize=(5,6))

`

data[["drunk","shopping"]].plot(kind="box",figsize=(5,6))`

plt.boxplot(data[["drunk","shopping"]])

LocalOutlierFactor

from sklearn.neighbors import LocalOutlierFactor

lout=LocalOutlierFactor(n_neighbors=30,

algorithm="auto", #auto,ball_tree kd_tree brute

leaf_size=20,

metric="minkowski",

p=2,

metric_params=None,

contamination=0.1,

n_jobs=1,

novelty=True

)

lout.fit(data[["friends"]])

data["friends_IO"]=lout.predict(data[["friends"]])

data[["friends_IO"]].value_counts() #查看离群值数量

data["nof"]=-lout.negative_outlier_factor_ #保存离群因子

data[["nof","friends","friends_IO"]][data["nof"]>1].sample(10)

#删除LOF>1.5的所有行

rows = [x for x in data.index if data.loc[x]['nof']>1.5]

data2 = data.drop(rows, axis=0)

#data2=data[data['nof']<1.5]

6、标准化

Z分数标准化

from sklearn.preprocessing import StandardScaler #Z分数标准化

scaler1 = StandardScaler(copy=True)

scaler1.fit(data[["friends"]])

data["friends_Zstd"] = scaler.transform(data[["friends"]])

plt.hist(data[["friends"]],bins=25)#未标准化的friends数量分布

import seaborn as sns

sns.distplot(data["friends"])#未标准化的friends数量分布

sns.distplot(data["friends_StandardScaled"])#标准化后friends数量分布

#or

#data[["friends_StandardScaled"]].plot(kind="hist",bins=25,figsize=(25,5))

MinMaxScaler标准化

from sklearn.preprocessing import MinMaxScaler

filtered_columns = ["friends"]

scaler = MinMaxScaler(copy=False)

scaler.fit(data[["friends"]])

data["friends_MM"]=scaler.transform(data[["friends"]])

data[["friends_MM"]] .plot(kind="hist",bins=25,figsize=(5,6))

RobustScaler标准化

from sklearn.preprocessing import RobustScaler

rob=RobustScaler(

with_centering=True, #如果为True,则在标准化之前将数据居中

with_scaling=True, #如果为True,则将数据缩放到分位数范围

quantile_range=(25.0, 75.0), #用于计算scale_的分位数范围

copy=True #如果为False,请尝试避免复制并改为直接替换

)

rob.fit(data[[“friends”]])

data[“rob”]=rob.transform(data[[“friends”]])

data[“rob”].plot(kind=“hist”,bins=25,figsize=(5,5))

7、编码

map

data["gender"]=data.gender.map({"F":0,"M":1,np.nan:0})

#data["gender"]=data.gender.map({"F":0,"M":1}) #无缺失数据或已处理

LabelEncoder

data=data1.copy()

from sklearn.preprocessing import LabelEncoder

le = LabelEncoder()

data["gender_le"]=le.fit_transform(data["gender"])) #编码

print(le.classes_)

get_dummy

df = pd.get_dummies(data, columns=['gender'])

df.head()

onehot

from sklearn.preprocessing import OneHotEncoder

OHE = OneHotEncoder(sparse=False) #不压缩稀疏矩阵

data_gender=OHE.fit_transform(data[['gender']]) #对性别用OneHotEncoder进行编码

8、离散化

二值化

from sklearn.preprocessing import Binarizer

#二值化,阈值设置为10,返回值为二值化后的数据

Bir = Binarizer(threshold=10)

data["friends_Binarized"] = Bir.fit_transform(data[["friends"]])

data[["friends_Binarized","friends"]].head()

等距离散化

#等距离散化,各个类比依次命名Friends_Number_Label_0...

n=2

d1 = pd.cut(data["friends"], n, labels =["Friends_Number_Label_"+str(i) for i in range(n)])

等频离散化

n=2

d1 = pd.qcut(data["friends"], n, labels =["Friends_Number_Label_"+str(i) for i in range(n)])

K-means离散化

data_f = data[['friends']].copy().dropna()

n = 4

from sklearn.cluster import KMeans

kmodel = KMeans(n_clusters = n) #实例化

kmodel.fit(data_f) #fit模型

center_ = pd.DataFrame(kmodel.cluster_centers_).sort_values(0) #输出聚类中心,并排序(按“0”特征升序)

l_ = center_.rolling(2).mean().iloc[1:] #移动平均求相邻两项中点,作为分界点

l_ = [data.min()[0]] + list(w[0]) + [data.max()[0]] #附加边界点

d2 = pd.cut(data_f["friends"], l_, labels = ['friends_0','friends_1','friends_2','friends_3'],,include_lowest=True)