【arXiv2022】GroupTransNet: Group Transformer Network for RGB-D Salient Object Detection

paper:https://arxiv.org/abs/2203.10785

目录

一 动机

二 方法

三 网络框架

3.1 模态纯化模块(MPM)

3.2 尺度统一模块 (SUM)

3.3 多 Transformer 解码器 (MTE)

3.4 聚类集成单元 (CIU)

3.5 损失函数

性能

总结

一 动机

The locality of convolutional neural network requires that the model has a sufficiently deep global receptive field, which always leads to the loss of local details.

卷积神经网络的局部性要求模型有足够深的全局感受野,这经常会导致局部细节丢失。

二 方法

To address the challenge, we propose a novel Group Transformer Network (GroupTransNet) for RGBD salient object detection.

为了解决这个挑战,作者提出一个新的网络,Group Transformer Network (GroupTransNet)。

This method is good at learning the long-range dependencies of cross layer features to promote more perfect feature expression.

这个方法擅长学习跨层特征的远距离依赖,来促进更优化的特征表征。

At the beginning, the features of the slightly higher classes of the middle three levels and the latter three levels are soft grouped to absorb the advantages of the high-level features.

最开始,特征中三级和后三级的稍高层次特征被软分组,来吸收高级特征的优点。

The input features are repeatedly purified and enhanced by the attention mechanism to purify the cross modal features of color modal and depth modal.

通过注意力机制纯化彩模态和深度模态的跨模态特征,输入特征被反复的纯化和增强。

The features of the intermediate process are first fused by the features of different layers, and then processed by several transformers in multiple groups, which not only makes the size of the features of each scale unified and interrelated, but also achieves the effect of sharing the weight of the features within the group.

中间过程的特征先由不同层的特征融合,再由多组中的几个transformer处理,不仅使特征的每个级别的尺寸统一和相关联,而且实现了在没有分组的情况下,特征分享权重的有效性

The output features in different groups complete the clustering staggered by two owing to the level difference, and combine with the low-level features.

不同组的输出特征由于层次的不同完成了两步交错的聚类,并与低层次的特征相结合。

三 网络框架

总共四个部分组成:模态纯化模块(MPM),尺度统一模块 (SUM),多transformer编码器 (MTE),聚类集成单元 (CIU)。在整个过程中,这些从RGB和深度提取的不同尺寸的特征f1,f2,f3,f4,f5,他们被软分组为2组,G1={f2,f3,f4},G2={f3,f4,f4}

首先,所有输入特征经过MPM模块纯化来获得跨模态特征

其次,将两个分组特征送到SUM模块使得每个特征尺寸统一和相关

接着,中间特征学习这些组的中公共信息,通过MTE模块来获得更具有鉴别性的特征表示

最后,在CIU模块,连接高级特征到低级特征来产生输出特征

最终的显著图由聚合这些获得 特征图计算得到

3.1 模态纯化模块(MPM)

在RGB-D显著性检测中,有两种图像信息的表达形式。RGB模态和深度模态,RGB模态提供图像的外观信息,深度图像提供图像的距离信息。他们为不同模型的检测提供有用的信息。然而,不同模态的特征在一定程度上是不兼容的,这是由于不同模态固有的差异性所造成的。如果我们简单使用这两种模态,比如直接拼接,这将会给特征带来一系列的噪声,MPM模块被设计用来解决这个问题。

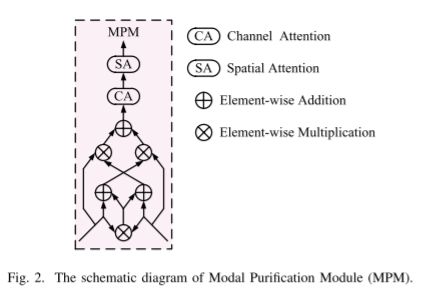

MPM 的示意图如图2所示,MPM首先通过重复的元素级联进行特征纯化,然后通过注意力机制进行特征增强,其中,注意力机制指的是通道注意力和空间注意力,在CBAM中有说明。

对于5个层RGB特征![]() 和深度特征

和深度特征![]() ,i=1,2,3,4,5。特征提纯和特征增强可以纯化RGB模态和深度模态的跨模态特征,获得组合特征

,i=1,2,3,4,5。特征提纯和特征增强可以纯化RGB模态和深度模态的跨模态特征,获得组合特征![]() 。

。

纯化过程可定义为:

增强过程为:

3.2 尺度统一模块 (SUM)

在网络中,由于几次下采样,每个尺度的特征有不同的分辨率。 除此之外, 每个尺度特征所包含的语义信息和细节信息也非常不同。 一方面,不同尺寸的特征不能被某一模块自适应处理。其次,所有尺度的特征交互从始至终也是非常重要的。尺度统一模块 (SUM)用来解决这些问题。

在此之前,融合之后的5个层次特征首先通过过渡层 T 将通道全部统一为64通道,T 包含一个 3×3 卷积层和一个 ReLU 激活函数。

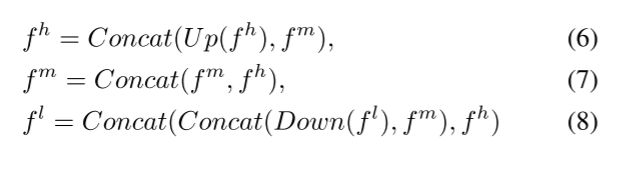

将高三层的特征送到SUMH ,中三层送到SUMM,他们都对高层和低层进行上采样或下采样到中间层的尺度,然后进行一系列对称的拼接操作。过程如下:

!!!注:在这里我觉得这个公式有点问题,在公式8,此时的fm特征已经是公式7进行拼接之后的了……下面的好像也有点问题(可能作者写的有点急叭 ^_^)

3.3 多 Transformer 解码器 (MTE)

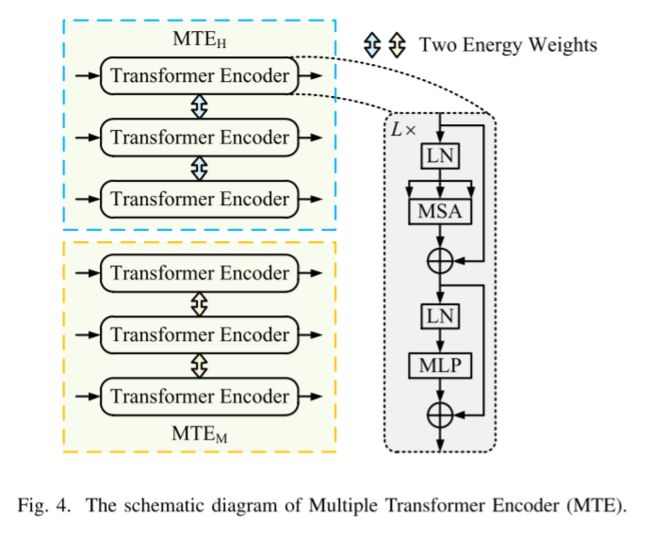

经过了通道统一和两个组内部的尺度统一,64x16x16,64x32x32,产生的两个组的特征送到这一模块。transformer这一块不是很懂,暂时不进行研究了…………大概意思就是transformer这个东西好,学习的特征也更具有鉴别性。

3.4 聚类集成单元 (CIU)

将经过transformer的两个组的特征又分为3类,即 C1 = {h’f5,m’f4}, C2 = {h’f4,m‘f3} 和 C3 = {h‘f3,m’f2}。

在第一类C1中,h‘f5包含相等的第四层和第五层的特征信息,而m’f4包含相等的第二层和第四层以及更多第三层的特征信息。因此,它从第二层到第五层具有丰富的信息,该属性适用于有偏差的无损特征。类似地,在第二类C2中,h'f4包含相等的第五层和更多第四层的特征信息,而m'f3包含相等的第二层和更多第三层的特征信息。 同时,在第三类C3中,h'f3包含相等的第三层和第五层以及更多第四层的特征信息,m'f2包含相等的第二层和第三层的特征信息。 因此,它们也满足与第一类相同的性质。

(上面这段话为什么这么说呢?? ?不是很理解,可能是SUM和Transformer的作用ba)

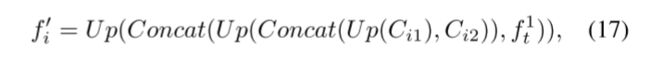

这三个类关注除第一层外的特征信息,重点不同,因此需要将它们分别与包含第一层信息的特征ft1结合起来。 所有要组合的特征的集成过程可以定义为:

CIU的作用就是串联不同层的特征,识别同层的特征,它是一种级联方式,将聚类特征按从高到低的顺序进行整合,首先对高层特征进行上采样,然后与低层特征进行拼接。

3.5 损失函数

3个侧边输出监督,加权二元交叉熵 (wBCE) 损失和加权交叉联合 (wIoU) 损失。【weighted Binary Cross Entropy (wBCE) loss and weighted Intersection over Union (wIoU) loss. 】

性能

总结

大致的流程就是:骨干网络提取特征,进行跨模态融合,通道统一,尺度统一,再送到transformer这个好东西里面,最后把一直没用过的第一层特征引到中高层特征里面去解码。