NNDL 作业3:分别使用numpy和pytorch实现FNN例题

目录

过程推导 - 了解BP原理

数值计算 - 手动计算,掌握细节

代码实现 - numpy手推 + pytorch自动

1、对比【numpy】和【pytorch】程序,总结并陈述。

numpy程序

pytorch程序

2、激活函数Sigmoid用PyTorch自带函数torch.sigmoid(),观察、总结并陈述。

3、激活函数Sigmoid改变为Relu,观察、总结并陈述。

4、损失函数MSE用PyTorch自带函数 t.nn.MSELoss()替代,观察、总结并陈述。

5、损失函数MSE改变为交叉熵,观察、总结并陈述。

6、改变步长,训练次数,观察、总结并陈述

7、权值w1-w8初始值换为随机数,对比“指定权值”的结果,观察、总结并陈述。

8、权值w1-w8初始值换为0,观察、总结并陈述。

9、全面总结反向传播原理和编码实现,认真写心得体会。

参考文献:

过程推导 - 了解BP原理

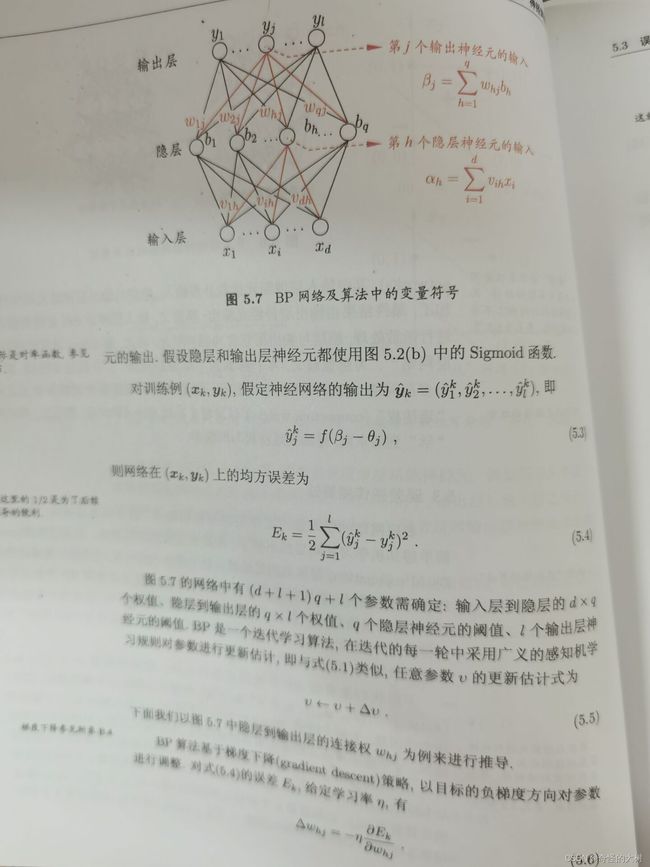

因为上学期学过机器学习,对西瓜书比较了解,下图是周志华老师的西瓜书上边关于bp原理的说明,

数值计算 - 手动计算,掌握细节

下边带上自己手写的推导

代码实现 - numpy手推 + pytorch自动

1、对比【numpy】和【pytorch】程序,总结并陈述。

numpy程序

import numpy as np

w1, w2, w3, w4, w5, w6, w7, w8 = 0.2, -0.4, 0.5, 0.6, 0.1, -0.5, -0.3, 0.8

x1, x2 = 0.5, 0.3

y1, y2 = 0.23, -0.07

print("输入值 x0, x1:", x1, x2)

print("输出值 y0, y1:", y1, y2)

def sigmoid(z):

a = 1 / (1 + np.exp(-z))

return a

def forward_propagate(x1, x2, y1, y2, w1, w2, w3, w4, w5, w6, w7, w8):

in_h1 = w1 * x1 + w3 * x2

out_h1 = sigmoid(in_h1)

in_h2 = w2 * x1 + w4 * x2

out_h2 = sigmoid(in_h2)

in_o1 = w5 * out_h1 + w7 * out_h2

out_o1 = sigmoid(in_o1)

in_o2 = w6 * out_h1 + w8 * out_h2

out_o2 = sigmoid(in_o2)

print("正向计算,隐藏层h1 ,h2:", end="")

print(round(out_h1, 5), round(out_h2, 5))

print("正向计算,预测值o1 ,o2:", end="")

print(round(out_o1, 5), round(out_o2, 5))

error = (1 / 2) * (out_o1 - y1) ** 2 + (1 / 2) * (out_o2 - y2) ** 2

print("损失函数(均方误差):",round(error, 5))

return out_o1, out_o2, out_h1, out_h2

def back_propagate(out_o1, out_o2, out_h1, out_h2):

# 反向传播

d_o1 = out_o1 - y1

d_o2 = out_o2 - y2

d_w5 = d_o1 * out_o1 * (1 - out_o1) * out_h1

d_w7 = d_o1 * out_o1 * (1 - out_o1) * out_h2

d_w6 = d_o2 * out_o2 * (1 - out_o2) * out_h1

d_w8 = d_o2 * out_o2 * (1 - out_o2) * out_h2

d_w1 = (d_o1 * out_h1 * (1 - out_h1) * w5 + d_o2 * out_o2 * (1 - out_o2) * w6) * out_h1 * (1 - out_h1) * x1

d_w3 = (d_o1 * out_h1 * (1 - out_h1) * w5 + d_o2 * out_o2 * (1 - out_o2) * w6) * out_h1 * (1 - out_h1) * x2

d_w2 = (d_o1 * out_h1 * (1 - out_h1) * w7 + d_o2 * out_o2 * (1 - out_o2) * w8) * out_h2 * (1 - out_h2) * x1

d_w4 = (d_o1 * out_h1 * (1 - out_h1) * w7 + d_o2 * out_o2 * (1 - out_o2) * w8) * out_h2 * (1 - out_h2) * x2

print("w的梯度:",round(d_w1, 2), round(d_w2, 2), round(d_w3, 2), round(d_w4, 2), round(d_w5, 2), round(d_w6, 2),

round(d_w7, 2), round(d_w8, 2))

return d_w1, d_w2, d_w3, d_w4, d_w5, d_w6, d_w7, d_w8

def update_w(w1, w2, w3, w4, w5, w6, w7, w8):

# 步长

step = 1

w1 = w1 - step * d_w1

w2 = w2 - step * d_w2

w3 = w3 - step * d_w3

w4 = w4 - step * d_w4

w5 = w5 - step * d_w5

w6 = w6 - step * d_w6

w7 = w7 - step * d_w7

w8 = w8 - step * d_w8

return w1, w2, w3, w4, w5, w6, w7, w8

if __name__ == "__main__":

print("权值w0-w7:",round(w1, 2), round(w2, 2), round(w3, 2), round(w4, 2), round(w5, 2), round(w6, 2), round(w7, 2),

round(w8, 2))

for i in range(5):

print("=====第" + str(i+1) + "轮=====")

out_o1, out_o2, out_h1, out_h2 = forward_propagate(x1, x2, y1, y2, w1, w2, w3, w4, w5, w6, w7, w8)

d_w1, d_w2, d_w3, d_w4, d_w5, d_w6, d_w7, d_w8 = back_propagate(out_o1, out_o2, out_h1, out_h2)

w1, w2, w3, w4, w5, w6, w7, w8 = update_w(w1, w2, w3, w4, w5, w6, w7, w8)

print("更新后的权值w:",round(w1, 2), round(w2, 2), round(w3, 2), round(w4, 2), round(w5, 2), round(w6, 2), round(w7, 2),

round(w8, 2))

输入值 x0, x1: 0.5 0.3

输出值 y0, y1: 0.23 -0.07

权值w0-w7: 0.2 -0.4 0.5 0.6 0.1 -0.5 -0.3 0.8

=====第1轮=====

正向计算,隐藏层h1 ,h2:0.56218 0.495

正向计算,预测值o1 ,o2:0.47695 0.5287

损失函数(均方误差): 0.20971

w的梯度: -0.01 0.01 -0.01 0.01 0.03 0.08 0.03 0.07

=====第2轮=====

正向计算,隐藏层h1 ,h2:0.56359 0.49285

正向计算,预测值o1 ,o2:0.46853 0.50721

损失函数(均方误差): 0.19503

w的梯度: -0.01 0.01 -0.01 0.01 0.03 0.08 0.03 0.07

=====第3轮=====

正向计算,隐藏层h1 ,h2:0.56524 0.49104

正向计算,预测值o1 ,o2:0.46042 0.48642

损失函数(均方误差): 0.18135

w的梯度: -0.01 0.01 -0.01 0.01 0.03 0.08 0.03 0.07

=====第4轮=====

正向计算,隐藏层h1 ,h2:0.5671 0.48954

正向计算,预测值o1 ,o2:0.45261 0.46642

损失函数(均方误差): 0.16865

w的梯度: -0.01 0.01 -0.01 0.0 0.03 0.08 0.03 0.07

=====第5轮=====

正向计算,隐藏层h1 ,h2:0.56913 0.48832

正向计算,预测值o1 ,o2:0.44506 0.44726

损失函数(均方误差): 0.1569

w的梯度: -0.01 0.01 -0.01 0.0 0.03 0.07 0.03 0.06

更新后的权值w: 0.25 -0.44 0.53 0.57 -0.06 -0.89 -0.44 0.46

进程已结束,退出代码为 0

pytorch程序

import torch

x = [0.5, 0.3] # x0, x1 = 0.5, 0.3

y = [0.23, -0.07] # y0, y1 = 0.23, -0.07

print("输入值 x0, x1:", x[0], x[1])

print("输出值 y0, y1:", y[0], y[1])

w = [torch.Tensor([0.2]), torch.Tensor([-0.4]), torch.Tensor([0.5]), torch.Tensor(

[0.6]), torch.Tensor([0.1]), torch.Tensor([-0.5]), torch.Tensor([-0.3]), torch.Tensor([0.8])] # 权重初始值

for i in range(0, 8):

w[i].requires_grad = True

print("权值w0-w7:")

for i in range(0, 8):

print(w[i].data, end=" ")

def forward_propagate(x): # 计算图

in_h1 = w[0] * x[0] + w[2] * x[1]

out_h1 = torch.sigmoid(in_h1)

in_h2 = w[1] * x[0] + w[3] * x[1]

out_h2 = torch.sigmoid(in_h2)

in_o1 = w[4] * out_h1 + w[6] * out_h2

out_o1 = torch.sigmoid(in_o1)

in_o2 = w[5] * out_h1 + w[7] * out_h2

out_o2 = torch.sigmoid(in_o2)

print("正向计算,隐藏层h1 ,h2:", end="")

print(out_h1.data, out_h2.data)

print("正向计算,预测值o1 ,o2:", end="")

print(out_o1.data, out_o2.data)

return out_o1, out_o2

def loss(x, y): # 损失函数

y_pre = forward_propagate(x) # 前向传播

loss_mse = (1 / 2) * (y_pre[0] - y[0]) ** 2 + (1 / 2) * (y_pre[1] - y[1]) ** 2 # 考虑 : t.nn.MSELoss()

print("损失函数(均方误差):", loss_mse.item())

return loss_mse

if __name__ == "__main__":

for k in range(1):

print("\n=====第" + str(k+1) + "轮=====")

l = loss(x, y) # 前向传播,求 Loss,构建计算图

l.backward() # 反向传播,求出计算图中所有梯度存入w中. 自动求梯度,不需要人工编程实现。

print("w的梯度: ", end=" ")

for i in range(0, 8):

print(round(w[i].grad.item(), 2), end=" ") # 查看梯度

step = 1 # 步长

for i in range(0, 8):

w[i].data = w[i].data - step * w[i].grad.data # 更新权值

w[i].grad.data.zero_() # 注意:将w中所有梯度清零

print("\n更新后的权值w:")

for i in range(0, 8):

print(w[i].data, end=" ")

输入值 x0, x1: 0.5 0.3

输出值 y0, y1: 0.23 -0.07

权值w0-w7:

tensor([0.2000]) tensor([-0.4000]) tensor([0.5000]) tensor([0.6000]) tensor([0.1000]) tensor([-0.5000]) tensor([-0.3000]) tensor([0.8000])

=====第1轮=====

正向计算,隐藏层h1 ,h2:tensor([0.5622]) tensor([0.4950])

正向计算,预测值o1 ,o2:tensor([0.4769]) tensor([0.5287])

损失函数(均方误差): 0.2097097933292389

w的梯度: -0.01 0.01 -0.01 0.01 0.03 0.08 0.03 0.07

更新后的权值w:

tensor([0.2084]) tensor([-0.4126]) tensor([0.5051]) tensor([0.5924]) tensor([0.0654]) tensor([-0.5839]) tensor([-0.3305]) tensor([0.7262]) 通过运行结果可以看出numpy和torch运行结果都差不多,运行到最后loss都一样,说明达到最优解。

2、激活函数Sigmoid用PyTorch自带函数torch.sigmoid(),观察、总结并陈述。

out_h1 = torch.sigmoid(in_h1) out_h2 = torch.sigmoid(in_h2)两种激活函数是在对神经元进行非线性处理时候用到,通过对比两个函数,Sigmoid函数和使用Pytorch自带的函数torch.sigmoid()无明显差距。

3、激活函数Sigmoid改变为Relu,观察、总结并陈述。

1轮

输入值 x0, x1: 0.5 0.3

输出值 y0, y1: 0.23 -0.07

权值w0-w7:

tensor([0.2000]) tensor([-0.4000]) tensor([0.5000]) tensor([0.6000]) tensor([0.1000]) tensor([-0.5000]) tensor([-0.3000]) tensor([0.8000])

=====第1轮=====

正向计算,隐藏层h1 ,h2:tensor([0.2500]) tensor([0.])

正向计算,预测值o1 ,o2:tensor([0.0250]) tensor([0.])

损失函数(均方误差): 0.023462500423192978

w的梯度: -0.01 0.0 -0.01 0.0 -0.05 0.0 -0.0 0.0

更新后的权值w:

tensor([0.2103]) tensor([-0.4000]) tensor([0.5062]) tensor([0.6000]) tensor([0.1513]) tensor([-0.5000]) tensor([-0.3000]) tensor([0.8000]) 100轮

=====第100轮=====

正向计算,隐藏层h1 ,h2:tensor([0.4055]) tensor([0.])

正向计算,预测值o1 ,o2:tensor([0.2300]) tensor([0.])

损失函数(均方误差): 0.0024500000290572643

w的梯度: -0.0 0.0 -0.0 0.0 -0.0 0.0 0.0 0.0

更新后的权值w:

tensor([0.4287]) tensor([-0.4000]) tensor([0.6372]) tensor([0.6000]) tensor([0.5672]) tensor([-0.5000]) tensor([-0.3000]) tensor([0.8000]) 500轮

正向计算,隐藏层h1 ,h2:tensor([0.4055]) tensor([0.])

正向计算,预测值o1 ,o2:tensor([0.2300]) tensor([0.])

损失函数(均方误差): 0.0024500000290572643

w的梯度: -0.0 0.0 -0.0 0.0 -0.0 0.0 0.0 0.0

更新后的权值w:1000轮

=====第1000轮=====

正向计算,隐藏层h1 ,h2:tensor([0.4055]) tensor([0.])

正向计算,预测值o1 ,o2:tensor([0.2300]) tensor([0.])

损失函数(均方误差): 0.0024500000290572643

w的梯度: -0.0 0.0 -0.0 0.0 -0.0 0.0 0.0 0.0

更新后的权值w:

tensor([0.4287]) tensor([-0.4000]) tensor([0.6372]) tensor([0.6000]) tensor([0.5672]) tensor([-0.5000]) tensor([-0.3000]) tensor([0.8000]) 从上边可以看出

sigmoid激活函数涉及到指数运算,计算量大,并且反向传播求误差梯度时,求导涉及除法,所以运算量的不同会导致上述训练收敛速度的不同。

relu函数计算比sigmoid函数简单,计算速度更快,计算量也比较小。

4、损失函数MSE用PyTorch自带函数 t.nn.MSELoss()替代,观察、总结并陈述。

将激活函数进行修改得到如下代码;

def loss(x, y): # 损失函数

y_pre = forward_propagate(x) # 前向传播

# loss_mse = (1 / 2) * (y_pre[0] - y[0]) ** 2 + (1 / 2) * (y_pre[1] - y[1]) ** 2 # 考虑 : t.nn.MSELoss()

mse = torch.nn.MSELoss()

loss_mse = mse(torch.tensor(y_pre[0]),torch.tensor(y[0])) + mse(torch.tensor(y_pre[1]),torch.tensor(y[1]))

print("损失函数(均方误差):", loss_mse.item())

return loss_mse

1轮

正向计算:o1 ,o2

tensor([0.4769]) tensor([0.5287])

损失函数(均方误差): 0.4194195866584778

grad W: -0.02 0.03 -0.01 0.02 0.07 0.17 0.06 0.15

更新后的权值

tensor([0.2168]) tensor([-0.4252]) tensor([0.5101]) tensor([0.5849]) tensor([0.0307]) tensor([-0.6677]) tensor([-0.3610]) tensor([0.6523])50轮

正向计算:o1 ,o2

tensor([0.2376]) tensor([0.0736])

损失函数(均方误差): 0.02068198285996914

grad W: -0.01 -0.0 -0.0 -0.0 0.0 0.01 0.0 0.01

更新后的权值

tensor([0.9834]) tensor([-0.2099]) tensor([0.9701]) tensor([0.7141]) tensor([-0.8661]) tensor([-2.8555]) tensor([-1.0899]) tensor([-1.1204])100轮

正向计算:o1 ,o2

tensor([0.2280]) tensor([0.0412])

损失函数(均方误差): 0.012363419868052006

grad W: -0.0 -0.0 -0.0 -0.0 -0.0 0.01 -0.0 0.0

更新后的权值

tensor([1.1885]) tensor([-0.1073]) tensor([1.0931]) tensor([0.7756]) tensor([-0.8715]) tensor([-3.3002]) tensor([-1.0941]) tensor([-1.4604])不难发现激活函数改变了,运行结果也有很大的差异

5、损失函数MSE改变为交叉熵,观察、总结并陈述。

修改激活函数为

def loss_fuction(x1, x2, y1, y2):

y1_pred, y2_pred = forward_propagate(x1, x2)

loss_func = torch.nn.CrossEntropyLoss() # 创建交叉熵损失函数

y_pred = torch.stack([y1_pred, y2_pred], dim=1)

y = torch.stack([y1, y2], dim=1)

loss = loss_func(y_pred, y) # 计算

print("损失函数(交叉熵损失):", loss.item())

return loss

1轮

正向计算:o1 ,o2

tensor([0.4769]) tensor([0.5287])

损失函数(交叉熵损失): 0.11871970444917679

grad W: -0.0 0.01 -0.0 0.0 -0.02 0.02 -0.02 0.02

更新后的权值

tensor([0.2028]) tensor([-0.4052]) tensor([0.5017]) tensor([0.5969]) tensor([0.1213]) tensor([-0.5213]) tensor([-0.2812]) tensor([0.7812])100轮

正向计算:o1 ,o2

tensor([0.8455]) tensor([0.1529])

损失函数(交叉熵损失): 0.016428470611572266

grad W: -0.01 -0.0 -0.0 -0.0 -0.01 0.01 -0.01 0.01

更新后的权值

tensor([0.9026]) tensor([-0.3255]) tensor([0.9216]) tensor([0.6447]) tensor([1.7590]) tensor([-2.1559]) tensor([1.0382]) tensor([-0.5358])500轮

正向计算:o1 ,o2

tensor([0.9827]) tensor([0.0174])

损失函数(交叉熵损失): -0.01593960076570511

grad W: -0.0 -0.0 -0.0 -0.0 -0.0 0.0 -0.0 0.0

更新后的权值

tensor([1.9505]) tensor([0.3587]) tensor([1.5503]) tensor([1.0552]) tensor([3.3073]) tensor([-3.6951]) tensor([2.2004]) tensor([-1.6912])有负数的出现

6、改变步长,训练次数,观察、总结并陈述

改变步长为2训练100轮

正向计算:o1 ,o2

tensor([0.9382]) tensor([0.0612])

损失函数(交叉熵损失): -0.005729638040065765

grad W: -0.0 -0.0 -0.0 -0.0 -0.01 0.0 -0.0 0.0

更新后的权值

tensor([1.3933]) tensor([-0.0570]) tensor([1.2160]) tensor([0.8058]) tensor([2.4980]) tensor([-2.8880]) tensor([1.5902]) tensor([-1.0827])改变步长为5训练100轮

正向计算:o1 ,o2

tensor([0.9827]) tensor([0.0174])

损失函数(交叉熵损失): -0.015939436852931976

grad W: -0.0 -0.0 -0.0 -0.0 -0.0 0.0 -0.0 0.0

更新后的权值

tensor([1.9486]) tensor([0.3483]) tensor([1.5492]) tensor([1.0490]) tensor([3.3190]) tensor([-3.7062]) tensor([2.2093]) tensor([-1.6997])当训练次数一定时,步长越大,均方误差下降越快,收敛越快。

改变步长为5训练50轮

正向计算:o1 ,o2

tensor([0.9547]) tensor([0.0450])

损失函数(交叉熵损失): -0.009541265666484833

grad W: -0.0 -0.0 -0.0 -0.0 -0.0 0.0 -0.0 0.0

更新后的权值

tensor([1.5416]) tensor([0.0349]) tensor([1.3050]) tensor([0.8610]) tensor([2.7260]) tensor([-3.1141]) tensor([1.7615]) tensor([-1.2526])改变步长为5训练100轮

正向计算:o1 ,o2

tensor([0.9827]) tensor([0.0174])

损失函数(交叉熵损失): -0.015939436852931976

grad W: -0.0 -0.0 -0.0 -0.0 -0.0 0.0 -0.0 0.0

更新后的权值

tensor([1.9486]) tensor([0.3483]) tensor([1.5492]) tensor([1.0490]) tensor([3.3190]) tensor([-3.7062]) tensor([2.2093]) tensor([-1.6997])步长一定时,随着训练次数增加,均方误差下降速度也在逐渐降低,收敛速度也下降了。

7、权值w1-w8初始值换为随机数,对比“指定权值”的结果,观察、总结并陈述。

更改初始权重:

w1, w2, w3, w4, w5, w6, w7, w8 =torch.rand(1), torch.rand(1), torch.rand(1), torch.rand(1), torch.rand(

1),torch.rand(1), torch.rand(1), torch.rand(1)1轮

正向计算:o1 ,o2

tensor([0.7541]) tensor([0.6021])

损失函数(交叉熵损失): 0.08856570720672607

grad W: -0.0 -0.0 -0.0 -0.0 -0.02 0.02 -0.02 0.02

更新后的权值

tensor([0.9299]) tensor([0.8555]) tensor([0.9413]) tensor([0.7544]) tensor([0.7036]) tensor([0.3886]) tensor([1.0139]) tensor([0.1818])100轮

正向计算:o1 ,o2

tensor([0.9064]) tensor([0.2066])

损失函数(交叉熵损失): 0.015541687607765198

grad W: -0.0 -0.0 -0.0 -0.0 -0.01 0.01 -0.01 0.01

更新后的权值

tensor([1.1692]) tensor([0.7000]) tensor([0.9344]) tensor([0.1963]) tensor([2.0019]) tensor([-1.2656]) tensor([1.4525]) tensor([-0.7877])1000轮

正向计算:o1 ,o2

tensor([0.9938]) tensor([0.0069])

损失函数(交叉熵损失): -0.018397122621536255

grad W: -0.0 -0.0 -0.0 -0.0 -0.0 0.0 -0.0 0.0

更新后的权值

tensor([2.2406]) tensor([1.6900]) tensor([1.4354]) tensor([1.3155]) tensor([3.6107]) tensor([-3.2414]) tensor([2.7017]) tensor([-2.9695])通过改变轮数,可以简单观察到权重的初始化不会影响收敛的结果,只会影响收敛的速度。

8、权值w1-w8初始值换为0,观察、总结并陈述。

更改初始权重:

w1, w2, w3, w4, w5, w6, w7, w8 = torch.Tensor([0]), torch.Tensor([0]), torch.Tensor([0]), torch.Tensor(

[0]), torch.Tensor([0]), torch.Tensor([0]), torch.Tensor([0]), torch.Tensor([0])1轮

正向计算:o1 ,o2

tensor([0.5000]) tensor([0.5000])

损失函数(交叉熵损失): 0.1109035536646843

grad W: 0.0 0.0 0.0 0.0 -0.02 0.02 -0.02 0.02

更新后的权值

tensor([0.]) tensor([0.]) tensor([0.]) tensor([0.]) tensor([0.0188]) tensor([-0.0188]) tensor([0.0188]) tensor([-0.0188])100轮

正向计算:o1 ,o2

tensor([0.8406]) tensor([0.1594])

损失函数(交叉熵损失): 0.01783166080713272

grad W: -0.01 -0.01 -0.0 -0.0 -0.01 0.01 -0.01 0.01

更新后的权值

tensor([0.4746]) tensor([0.4746]) tensor([0.2848]) tensor([0.2848]) tensor([1.4453]) tensor([-1.4453]) tensor([1.4453]) tensor([-1.4453])1000轮

正向计算:o1 ,o2

tensor([0.9932]) tensor([0.0068])

损失函数(交叉熵损失): -0.018344268202781677

grad W: -0.0 -0.0 -0.0 -0.0 -0.0 0.0 -0.0 0.0

更新后的权值

tensor([1.7782]) tensor([1.7782]) tensor([1.0669]) tensor([1.0669]) tensor([3.2392]) tensor([-3.2392]) tensor([3.2392]) tensor([-3.2392])前50轮Loss变大,也就是收敛速度慢,最终1000轮后收敛结果相同,即权重初始值只绘影响网络收敛速度,并不会影响或微小影响网络的收敛结果。

9、全面总结反向传播原理和编码实现,认真写心得体会。

反向传播和编码实现在我上学起的机器学习中就有涉及到,第一遍学习是特别懵的,这一次在接触是很深刻的理解了,同样的还有bp算法。

在激活函数这里,我深刻的理解到了,不同的激活函数变现出来的性能是不一样的,并且激活函数

也有可能出现负数的情况,例如上边。

参考文献:

周志华 《西瓜书》

邱锡鹏 《神经网络与深度学习》