机器学习实战——logistic回归

目录

一、Logistic回归介绍

1.Logistic回归的一般过程

2.Logistic回归的特点

二、基于Logistic回归和Sigmoid函数的分类

三、基于最优化方法的最佳回归系数确定

1.梯度上升法

2.梯度下降法

四、训练算法:使用梯度上升找到最佳参数

1.数据准备

2.训练算法

3.绘制决策边界

4.随机梯度上升算法

5.改进的随机梯度上升算法

6.回归系数与迭代次数的关系

五、使用逻辑回归进行MNIST数据集分类

一、Logistic回归介绍

假设现在有一些数据点,我们用一条直线对这些点进行拟合(该线称为最佳拟合直线),这个拟合过程就称作回归。利用Logistic回归进行分类的主要思想是:根据现有数据对分类边界线建立回归公式,以此进行分类。这里的“回归”一词源于最佳拟合,表示要找到最佳拟合参数集。训练分类器时的做法就是寻找最佳拟合参数,使用的是最优化算法。

1.Logistic回归的一般过程

- 收集数据:采用任意方法收集数据。

- 准备数据:由于需要进行距离计算,因此要求数据类型为数值型。另外,结构化数据格式则最佳。

- 分析数据:采用任意方法对数据进行分析。

- 训练算法:大部分时间将用于训练,训练的目的是为了找到最佳的分类回归系数。

- 测试算法:一旦训练步骤完成,分类将会很快。

- 使用算法:首先,我们需要输入一些数据,并将其转换成对应的结构化数值;接着,基于训练好的回归系数就可以对这些数值进行简单的回归计算,判定它们属于哪个类别;在这之后,我们就可以在输出的类别上做一些其他分析工作。

2.Logistic回归的特点

优点:计算代价不高,易于理解和实现。

缺点:容易欠拟合,分类精度可能不高。

适用数据类型:数值型和标称型数据。

二、基于Logistic回归和Sigmoid函数的分类

我们想要的函数应该是,能接受所有的输入然后预测出类别。例如,在两个类的情况下,上述函数输出0或1。Sigmoid函数(Logistic函数)拥有这样的性质。Sigmoid函数具体的计算公式如下:

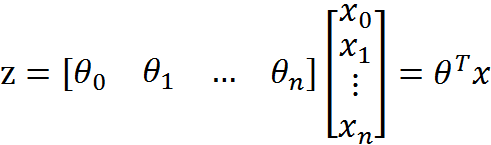

整合成一个公式,就变成了如下公式:

z是一个矩阵,θ是参数列向量(要求解的),x是样本列向量(给定的数据集)。θ^T表示θ的转置。g(z)函数实现了任意实数到[0,1]的映射,这样我们的数据集([x0,x1,…,xn]),不管是大于1或者小于0,都可以映射到[0,1]区间进行分类。

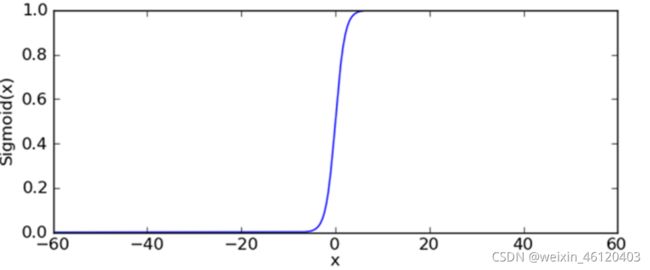

下图是Sigmoid函数在不同坐标尺度下的两条曲线图:

当x为0时,Sigmoid函数值为0.5,随着x的增大,对应的Sigmoid值将逼近于1;而随着x的减小,Sigmoid值将逼近与0。如果横坐标足够大,Sigmoid函数将看起来像一个阶跃函数。

三、基于最优化方法的最佳回归系数确定

Sigmoid函数的输入记为z,由下面公式得出:

![]()

根据向量的写法,上述公式写成![]() ,其中,x是分类器的输入数据,向量w就是我们要找的最佳参数(系数),为了寻找最优化w值,还需要用到最优化理论。

,其中,x是分类器的输入数据,向量w就是我们要找的最佳参数(系数),为了寻找最优化w值,还需要用到最优化理论。

1.梯度上升法

梯度上升法基于的思想是:要找到某函数的最大值,最好的方法是沿着该函数的梯度方向探寻。如果梯度记为∇,则函数f(x,y)的梯度由下式表示:

这个梯度意味着要沿x的方向移动 ,沿y的方向移动

,沿y的方向移动 。其中,函数f(x,y)必须要在待计算的点上有定义并且可微。一个具体的函数例子见下图。

。其中,函数f(x,y)必须要在待计算的点上有定义并且可微。一个具体的函数例子见下图。

梯度上升算法到达每个点后都会重新估计移动的方向。从P0开始,计算完该点的梯度,函数就根据梯度移动到下一点P1。在P1点,梯度再次被重新计算,并沿新的梯度方向移动到P2.如此循环迭代,知道满足通知条件。迭代的过程中,梯度算子总是保证我们能选取到最佳的移动方向

上图中的梯度上升算法沿梯度方向移动了一步。可以看到,梯度算子总是指向函数值增长最快的方向。这里所说的是移动方向,而未提到移动量的大小。该量值称为步长,记作α。用向量来表示的话,梯度上升算法的迭代公式如下:

该公式将一直迭代执行,直至达到某个停止条件为止,b比如迭代次数达到某个值或者算法达到某个可以允许的误差范围。

2.梯度下降法

如果是梯度下降法,那就是按梯度上升的反方向迭代公式即可,对应的公式如下:

梯度上升算法用来求函数的最大值,而梯度下降算法用来求函数的最小值。

四、训练算法:使用梯度上升找到最佳参数

1.数据准备

对课本中的例子进行实现,有100个样本点,这些数据有两维特征,因此可以将数据在一个二维平面上展示出来。我们可以将第一列数据(X1)看作x轴上的值,第二列数据(X2)看作y轴上的值。而最后一列数据即为分类标签。根据标签的不同,对这些点进行分类。

import matplotlib.pyplot as plt

import numpy as np

# 加载数据

def loadDataSet():

dataMat = [] #创建数据列表

labelMat = [] #创建标签列表

fr = open('testSet.txt') #打开文件

for line in fr.readlines(): #逐行读取

lineArr = line.strip().split() #去回车,放入列表

dataMat.append([1.0, float(lineArr[0]), float(lineArr[1])]) #添加数据

labelMat.append(int(lineArr[2])) #添加标签

fr.close() #关闭文件

return dataMat, labelMat #返回

# 绘制数据集

def plotDataSet():

dataMat, labelMat = loadDataSet() #加载数据集

dataArr = np.array(dataMat) #转换成numpy的array数组

n = np.shape(dataMat)[0] #数据个数

xcord1 = []; ycord1 = [] #正样本

xcord2 = []; ycord2 = [] #负样本

for i in range(n): #根据数据集标签进行分类

if int(labelMat[i]) == 1:

xcord1.append(dataArr[i,1]); ycord1.append(dataArr[i,2]) #1为正样本

else:

xcord2.append(dataArr[i,1]); ycord2.append(dataArr[i,2]) #0为负样本

fig = plt.figure()

ax = fig.add_subplot(111) #添加subplot

ax.scatter(xcord1, ycord1, s = 20, c = 'red', marker = 's',alpha=.5)#绘制正样本

ax.scatter(xcord2, ycord2, s = 20, c = 'green',alpha=.5) #绘制负样本

plt.title('DataSet') #绘制title

plt.xlabel('x'); plt.ylabel('y') #绘制label

plt.show() #显示

if __name__ == '__main__':

plotDataSet()结果如下:

从上图可以看出数据的分布情况。假设Sigmoid函数的输入记为z,那么z=w0x0 + w1x1 + w2x2,即可将数据分割开。其中,x0为全是1的向量,x1为数据集的第一列数据,x2为数据集的第二列数据。另z=0,则0=w0 + w1x1 + w2x2。横坐标为x1,纵坐标为x2。这个方程未知的参数为w0,w1,w2,也就是我们需要求的回归系数(最优参数)。

2.训练算法

#sigmoid函数

def sigmoid(inX):

return 1.0 / (1 + np.exp(-inX))

#梯度上升算法

def gradAscent(dataMatIn, classLabels):

dataMatrix = np.mat(dataMatIn) #转换成numpy的mat

labelMat = np.mat(classLabels).transpose() #转换成numpy的mat,并进行转置

m, n = np.shape(dataMatrix) #返回dataMatrix的大小。m为行数,n为列数。

alpha = 0.001 #移动步长,也就是学习速率,控制更新的幅度。

maxCycles = 500 #最大迭代次数

weights = np.ones((n,1))

for k in range(maxCycles):

h = sigmoid(dataMatrix * weights) #梯度上升矢量化公式

error = labelMat - h

weights = weights + alpha * dataMatrix.transpose() * error

return weights.getA()运行结果:

可以看出,我们已经求解出回归系数[w0,w1,w2]。

通过求解出的参数,我们就可以确定不同类别数据之间的分隔线,画出决策边界。

3.绘制决策边界

#绘制数据集

def plotBestFit(weights):

dataMat, labelMat = loadDataSet() #加载数据集

dataArr = np.array(dataMat) #转换成numpy的array数组

n = np.shape(dataMat)[0] #数据个数

xcord1 = []; ycord1 = [] #正样本

xcord2 = []; ycord2 = [] #负样本

for i in range(n): #根据数据集标签进行分类

if int(labelMat[i]) == 1:

xcord1.append(dataArr[i,1]); ycord1.append(dataArr[i,2]) #1为正样本

else:

xcord2.append(dataArr[i,1]); ycord2.append(dataArr[i,2]) #0为负样本

fig = plt.figure()

ax = fig.add_subplot(111) #添加subplot

ax.scatter(xcord1, ycord1, s = 20, c = 'red', marker = 's',alpha=.5)#绘制正样本

ax.scatter(xcord2, ycord2, s = 20, c = 'green',alpha=.5) #绘制负样本

x = np.arange(-3.0, 3.0, 0.1)

y = (-weights[0] - weights[1] * x) / weights[2]

ax.plot(x, y)

plt.title('BestFit') #绘制title

plt.xlabel('X1'); plt.ylabel('X2') #绘制label

plt.show()运行结果:

虽然此算法的结果只分错了几个点,但是这个方法却需要大量的计算。

4.随机梯度上升算法

一种改进方法是一次只用一个样本点来更新回归系数,这样就可以大大减少计算量了,该方法称为随机梯度上升算法。

# 初始随机梯度上升法

def stocGradAscent0(dataMatrix, classLabels):

m, n = np.shape(dataMatrix)

alpha = 0.01

weights = np.ones(n)

for i in range(m):

h = sigmoid(sum(dataMatrix[i] * weights))

error = classLabels[i] - h

weights = weights + alpha * error * dataMatrix[i]

return weights运行结果:

通过上图可以看出,大约有三分之一的点被分错,这是由于一些样本点不能被正确的分类(数据集并非线性可分),在每次迭代时会引发系数的剧烈改变。我们期望该算法能避免来回波动,从而收敛到某个值,收敛速度也需要加快。下面将对算法进行改进。

5.改进的随机梯度上升算法

#改进的随机梯度上升法

def stocGradAscent1(dataMatrix, classLabels, numIter=150):

m,n = np.shape(dataMatrix) #返回dataMatrix的大小。m为行数,n为列数。

weights = np.ones(n) #参数初始化

for j in range(numIter):

dataIndex = list(range(m))

for i in range(m):

alpha = 4/(1.0+j+i)+0.01 #降低alpha的大小,每次减小1/(j+i)。

randIndex = int(random.uniform(0,len(dataIndex))) #随机选取样本

h = sigmoid(sum(dataMatrix[randIndex]*weights)) #选择随机选取的一个样本,计算h

error = classLabels[randIndex] - h #计算误差

weights = weights + alpha * error * dataMatrix[randIndex] #更新回归系数

del(dataIndex[randIndex]) #删除已经使用的样本

return weights #返回结果为:

- alpha在每次迭代的时候都会调整,并且,虽然alpha会随着迭代次数不断减小,但永远不会减小到0。因为这里还存在一个常数项。必须这样做的原因是为了保证在多次迭代之后新数据仍然具有一定的影响。如果需要处理的问题是动态变化的,那么可以适当加大上述常数项,来确保新的值获得更大的回归系数。另一点值得注意的是,在降低alpha的函数中,alpha每次减少1/(j+i),其中j是迭代次数,i是样本点的下标。

- 更新回归系数(最优参数)时,只使用一个样本点,并且选择的样本点是随机的,每次迭代不使用已经用过的样本点。这样的方法,就有效地减少了计算量,并保证了回归效果。

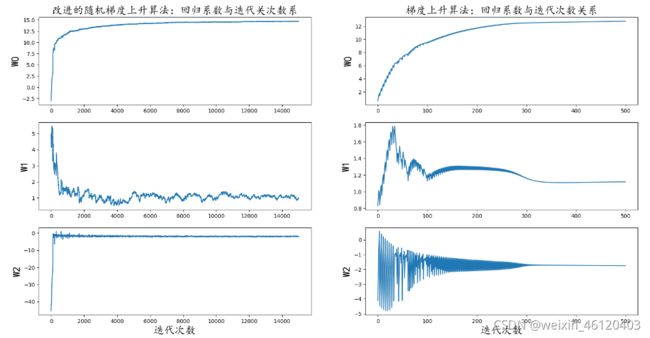

6.回归系数与迭代次数的关系

#绘制回归系数与迭代次数的关系

def plotWeights(weights_array1, weights_array2):

font = matplotlib.font_manager.FontProperties(fname='C:/Windows/Fonts/simkai.ttf') #中文字体,不然会出现乱码

# 将fig画布分隔成1行1列,不共享x轴和y轴,fig画布的大小为(13,8)

# 当nrow=3,nclos=2时,代表fig画布被分为六个区域,axs[0][0]

fig, axs = plt.subplots(nrows=3, ncols=2, sharex=False, sharey=False, figsize=(20, 10))

x1 = np.arange(0, len(weights_array1), 1)

# 绘制w0与迭代次数的关系

axs[0][0].plot(x1, weights_array1[:, 0])

axs0_title_text = axs[0][0].set_title(u'改进的随机梯度上升算法:回归系数与迭代关次数系', FontProperties=font)

axs0_ylabel_text = axs[0][0].set_ylabel(u'W0', FontProperties=font)

plt.setp(axs0_title_text, size=20, weight='bold', color='black')

plt.setp(axs0_ylabel_text, size=20, weight='bold', color='black')

# 绘制w1与迭代次数的关系

axs[1][0].plot(x1, weights_array1[:, 1])

axs1_ylabel_text = axs[1][0].set_ylabel(u'W1', FontProperties=font)

plt.setp(axs1_ylabel_text, size=20, weight='bold', color='black')

# 绘制w2与迭代次数的关系

axs[2][0].plot(x1, weights_array1[:, 2])

axs2_xlabel_text = axs[2][0].set_xlabel(u'迭代次数', FontProperties=font)

axs2_ylabel_text = axs[2][0].set_ylabel(u'W2', FontProperties=font)

plt.setp(axs2_xlabel_text, size=20, weight='bold', color='black')

plt.setp(axs2_ylabel_text, size=20, weight='bold', color='black')

x2 = np.arange(0, len(weights_array2), 1)

# 绘制w0与迭代次数的关系

axs[0][1].plot(x2, weights_array2[:, 0])

axs0_title_text = axs[0][1].set_title(u'梯度上升算法:回归系数与迭代次数关系', FontProperties=font)

axs0_ylabel_text = axs[0][1].set_ylabel(u'W0', FontProperties=font)

plt.setp(axs0_title_text, size=20, weight='bold', color='black')

plt.setp(axs0_ylabel_text, size=20, weight='bold', color='black')

# 绘制w1与迭代次数的关系

axs[1][1].plot(x2, weights_array2[:, 1])

axs1_ylabel_text = axs[1][1].set_ylabel(u'W1', FontProperties=font)

plt.setp(axs1_ylabel_text, size=20, weight='bold', color='black')

# 绘制w2与迭代次数的关系

axs[2][1].plot(x2, weights_array2[:, 2])

axs2_xlabel_text = axs[2][1].set_xlabel(u'迭代次数', FontProperties=font)

axs2_ylabel_text = axs[2][1].set_ylabel(u'W2', FontProperties=font)

plt.setp(axs2_xlabel_text, size=20, weight='bold', color='black')

plt.setp(axs2_ylabel_text, size=20, weight='bold', color='black')

plt.show()

结果为:

从上图可以看出,改进的随机梯度上升算法收敛效果更好。一共有100个样本点,改进的随机梯度上升算法迭代次数为150。而上图显示15000次迭代次数的原因是,使用一次样本就更新一下回归系数。因此,迭代150次,相当于更新回归系数150*100=15000次。简而言之,迭代150次,更新1.5万次回归参数。从上图左侧的改进随机梯度上升算法回归效果中可以看出,其实在更新2000次回归系数的时候,已经收敛了。相当于遍历整个数据集20次的时候,回归系数已收敛。训练已完成。

上图右侧的梯度上升算法回归效果,梯度上升算法每次更新回归系数都要遍历整个数据集。从图中可以看出,当迭代次数为300多次的时候,回归系数才收敛。

在大的波动停止后,都会有一些小的周期性波动。因为存在一些不能正确分类的样本点,在每次迭代时引发系数的剧烈改变。而改进的随机梯度上升算法可以减少周期性的波动。

五、使用逻辑回归进行MNIST数据集分类

MNIST数据集是机器学习领域中非常经典的一个数据集,由60000个训练样本和10000个测试样本组成,每个样本都是一张28 * 28像素的灰度手写数字图片。

import time

import numpy as np

import matplotlib.pyplot as plt

from sklearn.model_selection import train_test_split

from sklearn.linear_model import LogisticRegression

from sklearn import datasets

from sklearn.preprocessing import StandardScaler

from sklearn.datasets import fetch_openml #从openml.org网站导入数据

from sklearn.utils import check_random_state

t0=time.time()

train_samples=5000

#载入数据集

X, y = fetch_openml('mnist_784', version=1, return_X_y=True)

print(X.shape,y.shape)

#可视化样本,图形化显示前6个数据

fig,ax=plt.subplots(nrows=2,ncols=3,sharex='all',sharey='all')

ax = ax.flatten()

for i in range(6):

img=X[i].reshape(28,28)

ax[i].matshow(img)

plt.show()random_state = check_random_state(0)

permutation = random_state.permutation(X.shape[0]) #随机排序序列

X = X[permutation]

y = y[permutation]

X = X.reshape((X.shape[0], -1))

X_train,X_test,y_train,y_test=train_test_split(X,y,train_size=train_samples,test_size=10000)

#数据进行标准化处理

scaler=StandardScaler()

X_train=scaler.fit_transform(X_train)

X_test=scaler.transform(X_test)

#训练模型

clf=LogisticRegression(C=50. / train_samples, penalty='l1', solver='saga', tol=0.1)

clf.fit(X_train,y_train)

score=clf.score(X_test,y_test)

sparsity = np.mean(clf.coef_ == 0) * 100 #稀疏性

print("Sparsity with L1 penalty: %.2f%%" % sparsity)

print("Test score with L1 penalty: %.4f" % score)

#画图

coef = clf.coef_.copy()

print(coef.shape)

plt.figure(figsize=(10, 5))

scale = np.abs(coef).max()

for i in range(10):

l1_plot = plt.subplot(2, 5, i + 1)

l1_plot.imshow(coef[i].reshape(28, 28), interpolation='nearest',

cmap=plt.cm.RdBu, vmin=-scale, vmax=scale)

l1_plot.set_xticks(())

l1_plot.set_yticks(())

l1_plot.set_xlabel('Class %i' % i)

plt.suptitle('Classification vector for...')

run_time = time.time() - t0

print('Example run in %.3f s' % run_time)

plt.show()运行结果:

Sparsity with L1 penalty: 58.00%

Test score with L1 penalty: 0.7915

(10, 784)

Example run in 646.503 s