《PyTorch深度学习实践》自学记录 第二讲

第2讲 linear_model 源代码和课后题。

B站 刘二大人 ,传送门 PyTorch深度学习实践——线性模型

参考错错莫课代表的PyTorch 深度学习实践 第2讲

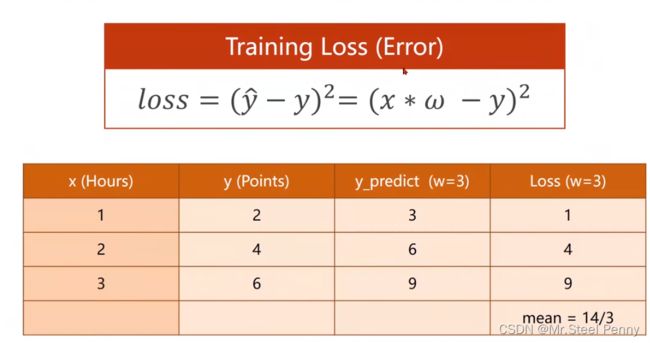

任务模型如下

代码如下

import numpy as np

import matplotlib.pyplot as plt

x_data = [1.0, 2.0 ,3.0]

y_data = [2.0, 4.0 ,6.0]

def forward(x):

return x*w

def loss(x, y):

y_pred = forward(x)

return (y_pred - y)**2

w_list = []

mse_list = []

for w in np.arange(0.0, 4.1, 0.1):

print("w=",w)

l_sum = 0

for x_val,y_val in zip(x_data,y_data):

y_pred_val = forward(x_val)

loss_val = loss(x_val, y_val)

l_sum += loss_val

print('\t', x_val, y_val, y_pred_val, loss_val)

print('MSE=', l_sum/3)

w_list.append(w)

mse_list.append(l_sum/3)

#draw the graph

plt.plot(w_list,mse_list)

plt.ylabel('Loss')

plt.xlabel('w')

plt.show()可视化结果,将来可用到visdom

注意:X, Y = np.meshgrid(x, y) 代表的是将x中每一个数据和y中每一个数据组合生成很多点,然后将这些点的x坐标放入到X中,y坐标放入Y中,并且相应位置是对应的。

3D画图参考Python绘制3D图形:Axes3D

import numpy as np

import matplotlib.pyplot as plt

from mpl_toolkits.mplot3d import Axes3D

fig = plt.figure()

ax=Axes3D(fig)

#我们需要自己设定w=2,b=3,即y=2x+3

x_data = [1.0, 2.0 ,3.0]

y_data = [5.0, 7.0 ,9.0]

def forward(x):

return x * w + b #这里需要修改一下

def loss(x, y):

y_pred = forward(x)

return (y_pred - y)**2

W=np.arange(0.0,4.1,0.1) #生成数据

B=np.arange(0.0,4.1,0.1)

[w,b]=np.meshgrid(W,B)#生成x,y轴数据

mse_list = []

l_sum = 0

for x_val,y_val in zip(x_data,y_data):

y_pred_val = forward(x_val)

loss_val = loss(x_val, y_val)

l_sum += loss_val

z=l_sum/3

ax.plot_surface(w,b,z,rstride=1,cstride=1)

ax.contourf(w,b,z,zdir='z',offset=-2)

plt.xlabel('w')

plt.ylabel('b')

ax.set_zlabel('Loss')

plt.show()可视化结果