【小样本分割】MSANet: Multi-Similarity and Attention Guidance for Boosting Few-Shot Segmentation

摘要

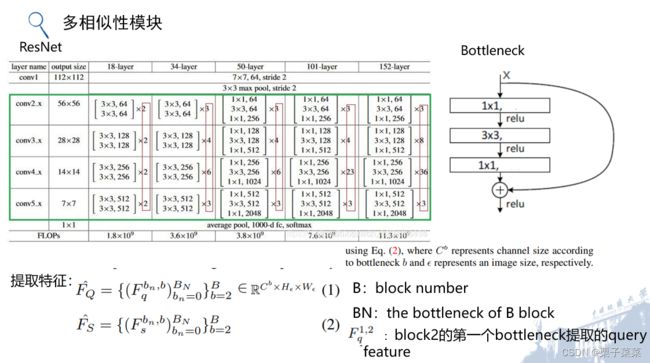

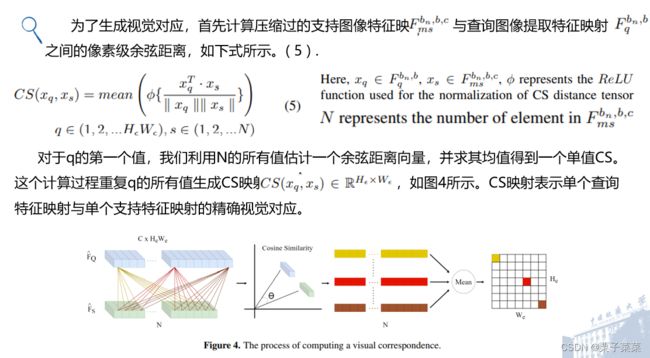

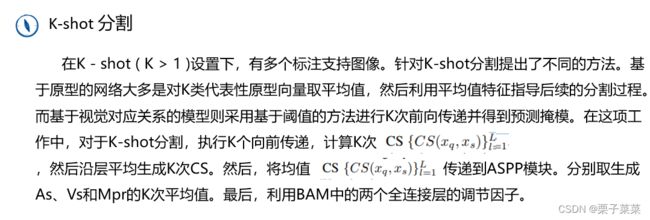

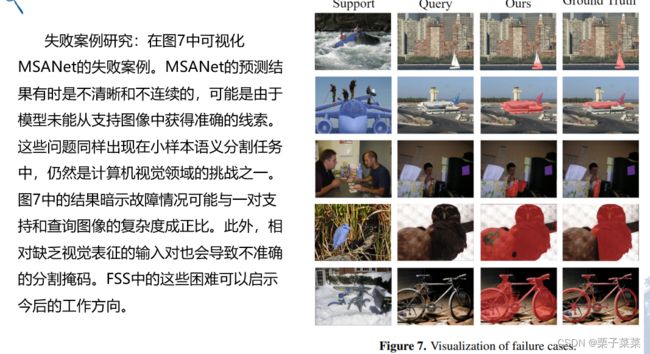

小样本分割的目的是在只有少量密集标记样本的情况下分割看不见的类对象。原型学习,即从支持图像中提取的特征通过平均全局和局部对象信息生成单个或多个原型,已广泛应用于FSS。然而,仅利用原型向量可能不足以表示所有支持图像的特征。为了提取丰富的特征并进行更精确的预测,我们提出了一种多相似性和注意力网络(MSANet),包括两个新模块,一个多相似性模块和一个注意力模块。多相似度模块利用支持图像和查询图像的多个特征图来估计准确的语义关系。注意力模块指示MSANet专注于与类别相关的信息。

介绍

随着成熟的大规模数据集[9,10,13,26]的开发,一系列监督卷积神经网络(CNN)在语义分割任务[1,34,40,41,49]方面显示出巨大的潜力。这些有监督的神经网络的性能在很大程度上取决于训练数据集的质量和数量,例如注释良好的数据的数量、类分布的平衡以及样本表示。然而,在实际应用中,很难得到大量带注释的数据,尤其是在密集预测任务中[2,3,14,21,57,59]。此外,传统的监督神经网络可能难以对具有不可见类的图像进行泛化。受人类仅使用少量输入数据来区分对象的认知能力的启发,开发了小样本学习(FSL)技术[8,42,53,56]。该技术构建了一个网络,可以将其推广到具有很少有可用的注释样本。小样本分割(FSS)[27-29,31,32,35,36,45,46,48,51,54,58,60,61,63,64]是小样本学习的应用之一,尤其侧重于语义分割。FSS的目标是使用相应的注释掩码分割查询图像中选定类别的目标区域。FSS最流行的方法是基于度量的原型学习[51]。参考图1的上半部分),通过屏蔽平均池(MAP)生成单个或多个类代表性原型向量[67]。特征处理网络利用类代表性原型向量分割查询图像中的目标对象。许多研究人员试图从采用不同机制的原型向量中获得更多指导,例如,PANet[55]、PFENet[51]、SG One Net[67]、CANet[65]、ASGNet[22]。然而,由于屏蔽平均池操作,此类原型网络可能会丢失图像的详细空间信息。在这种情况下,我们提出了一种由两个引导模块组成的多相似性和注意力网络(MSANet)。参考图1的下半部分,该网络包括多层相似性模块和注意力模块。预计这两个模块将支持原型学习范式,并引导MSANet进行精细分割。最近的研究表明,可以通过利用支持图像和查询图像的视觉对应[12]来升级FSS网络。为了建立更有意义的对应关系,采用了密集中间层[33,37,38]和相关张量学习[24,43,52]技术。Juhong Minet等人设计了HSNet[36],提出了一种基于4D张量的具有多层密集特征相关的超相关挤压网络。此外,我们提出了一个多相似性模块,该模块从主干网络中提取多层特征相关性,并对特征应用简单的卷积块。我们还提出了一种轻量级的CNN注意力块,用于更加关注图像的目标类内容。遵循BAM[20]的架构,我们使用了一个基础学习器和集成模块来细化分割结果。我们将我们对FSS挑战的主要贡献总结如下:

提出了一个多层相似性模块,以获得支持图像和查询图像之间的信息视觉对应。

我们提出了一个简单但有效的注意力模块,利用支持图像及其对应的掩码来更好地理解类相关信息。

相关工作

语义分割

语义分割是将给定图像上的每个像素在指定类别内进行分类的计算机视觉任务之一。得益于全卷积网络( FCNs ) 的进步,许多模型结构如基于编码器-解码器的UNet 、基于金字塔池模块( PPM )的PSPNet 和基于Atrous Spatial金字塔池( ASPP )的Deeplab 等被提出来用于提高分割性能。此外,还提出了一系列视觉技术,包括扩张型卷积、多层次特征聚合和注意机制。然而,传统的分割模型需要足够的标注数据,难以在不进行微调的情况下预测不可视类别,从而在一定程度上阻碍了实际应用。

小样本学习

为了解决这些问题,引入了FSL,其目的是用少量注释的样本来理解看不见的类别。FSL方法可进一步细分为三个分支:( i )基于优化的[ 11、 19、 42 ]、( ii )基于增强的[ 6,7 ]和( iii )基于度量的[ 23,48,50 ]。基于优化的方法提出了梯度更新策略,以克服数据偏差,提高模型的泛化能力。基于增强的方法通过生成合成训练图像来解决数据的不足。我们的工作与基于度量的方法密切相关,这些方法旨在学习一个通用的度量函数来计算查询图像与支持图像之间的距离。这些基于度量的方法取得了突出的进展。作为其中之一,匹配网络利用一种称为集的特殊小批量来匹配训练和测试环境。关系网络将查询和支持图像转换为1x1向量然后基于余弦相似度( CS )进行分类。此外,还提出了原型网络,它直接利用通过全局平均池操作计算的特征表示( 即原型 )

小样本语义分割

:Shaban等人提出OSLSM,作为FSS的开创性工作之一,用于生成查询图像分割的分类器权值。第一个分支以支持图像为输入,产生一个参数向量,第二个分支将这些参数和查询图像一起,分割掩码作为输出。随后,为了更好地从支持图像和查询图像中提取信息,引入了原型学习范式。SG-One 为计算类代表原型向量引入了掩蔽平均池操作,生成了空间相似图。CANet 提出了两个带迭代细化模块的稠密比较网络。PFENet 在没有可训练参数的情况下计算了高层特性的余弦相似度(CS),以创建一个先验掩模并输入还介绍了一种特征丰富模块。ASGNet 没有进行原型扩展,而是提出了一种超像素引导的聚类方法,从支持图像中提取多个原型,并采用分配策略重构支持特征图。然而,大多数的原型学习方法都会导致空间结构损失。为了充分挖掘前景对象的特征,在使用类代表原型向量方面还有改进的空间。另一方面,在FSS中发现视觉对应关系和处理相关张量显示了显著的结果[ 36 - 38 ]。HSNet 被训练用来压缩密集的特征相关张量,并通过高维卷积将其转化为分割掩模。然而,高维卷积( 4D卷积)具有很高的空间复杂度和时间复杂度。为了提取轻量级的CNN特征,DENet 引入了引导注意模块来估计受传统启发的新型分类器的权值。文献17提出了一种基于注意力的多上下文引导网络,融合小到大尺度的上下文信息,对查询分支进行全局引导。BAM 没有进行特征提取或视觉对应的工作,而是为FSS引入了一种新的方式,它使用了基类训练的监督模型的额外块。监督模型从查询图像中预测基类,帮助元学习者抑制虚假预测。受近期视觉对应和注意机制研究进展的启发,我们提出了在原型网络背景下的多层相似模块和轻量级注意模块,将FSS网络带到下一级。