NNDL 作业11:优化算法比较

目录

1. 编程实现图6-1,并观察特征

2. 观察梯度方向

3. 编写代码实现算法,并可视化轨迹

4. 分析上图,说明原理

1. 为什么SGD会走“之字形”?其它算法为什么会比较平滑?

2. Momentum、AdaGrad对SGD的改进体现在哪里?速度?方向?在图上有哪些体现?

3. 仅从轨迹来看,Adam似乎不如AdaGrad效果好,是这样么?

5. 总结SGD、Momentum、AdaGrad、Adam的优缺点

6. Adam这么好,SGD是不是就用不到了?

总结

ref

1. 编程实现图6-1,并观察特征

![]()

代码实现如下:

import numpy as np

from matplotlib import pyplot as plt

from mpl_toolkits.mplot3d import Axes3D

def func(x, y):

return x * x / 20 + y * y

def paint_loss_func():

x = np.linspace(-50, 50, 100) # x的绘制范围是-50到50,从改区间均匀取100个数

y = np.linspace(-50, 50, 100) # y的绘制范围是-50到50,从改区间均匀取100个数

X, Y = np.meshgrid(x, y)

Z = func(X, Y)

fig = plt.figure() # figsize=(10, 10))

ax = Axes3D(fig)

plt.xlabel('x')

plt.ylabel('y')

ax.plot_surface(X, Y, Z, rstride=1, cstride=1, cmap='rainbow')

plt.show()

paint_loss_func()结果如下:

特征:

- 有全局最小值

- 是一个向x轴方向延申的“碗”状函数

- 等高线呈向x轴方向延申的椭圆状

2. 观察梯度方向

![]()

这个梯度的特征是,y轴方向上大,x轴方向上小。换句话说, 就是y轴方向的坡度大,而x轴方向的坡度小。这里需要注意的是,虽然式 (6.2)的最小值在(x, y)= (0, 0)处,但是图6-2中的梯度在很多地方并没有指向(0,0)

3. 编写代码实现算法,并可视化轨迹

![]()

代码实现:

# coding: utf-8

import numpy as np

import matplotlib.pyplot as plt

from collections import OrderedDict

class SGD:

"""随机梯度下降法(Stochastic Gradient Descent)"""

def __init__(self, lr=0.01):

self.lr = lr

def update(self, params, grads):

for key in params.keys():

params[key] -= self.lr * grads[key]

class Momentum:

"""Momentum SGD"""

def __init__(self, lr=0.01, momentum=0.9):

self.lr = lr

self.momentum = momentum

self.v = None

def update(self, params, grads):

if self.v is None:

self.v = {}

for key, val in params.items():

self.v[key] = np.zeros_like(val)

for key in params.keys():

self.v[key] = self.momentum * self.v[key] - self.lr * grads[key]

params[key] += self.v[key]

class Nesterov:

"""Nesterov's Accelerated Gradient (http://arxiv.org/abs/1212.0901)"""

def __init__(self, lr=0.01, momentum=0.9):

self.lr = lr

self.momentum = momentum

self.v = None

def update(self, params, grads):

if self.v is None:

self.v = {}

for key, val in params.items():

self.v[key] = np.zeros_like(val)

for key in params.keys():

self.v[key] *= self.momentum

self.v[key] -= self.lr * grads[key]

params[key] += self.momentum * self.momentum * self.v[key]

params[key] -= (1 + self.momentum) * self.lr * grads[key]

class AdaGrad:

"""AdaGrad"""

def __init__(self, lr=0.01):

self.lr = lr

self.h = None

def update(self, params, grads):

if self.h is None:

self.h = {}

for key, val in params.items():

self.h[key] = np.zeros_like(val)

for key in params.keys():

self.h[key] += grads[key] * grads[key]

params[key] -= self.lr * grads[key] / (np.sqrt(self.h[key]) + 1e-7)

class RMSprop:

"""RMSprop"""

def __init__(self, lr=0.01, decay_rate=0.99):

self.lr = lr

self.decay_rate = decay_rate

self.h = None

def update(self, params, grads):

if self.h is None:

self.h = {}

for key, val in params.items():

self.h[key] = np.zeros_like(val)

for key in params.keys():

self.h[key] *= self.decay_rate

self.h[key] += (1 - self.decay_rate) * grads[key] * grads[key]

params[key] -= self.lr * grads[key] / (np.sqrt(self.h[key]) + 1e-7)

class Adam:

"""Adam (http://arxiv.org/abs/1412.6980v8)"""

def __init__(self, lr=0.001, beta1=0.9, beta2=0.999):

self.lr = lr

self.beta1 = beta1

self.beta2 = beta2

self.iter = 0

self.m = None

self.v = None

def update(self, params, grads):

if self.m is None:

self.m, self.v = {}, {}

for key, val in params.items():

self.m[key] = np.zeros_like(val)

self.v[key] = np.zeros_like(val)

self.iter += 1

lr_t = self.lr * np.sqrt(1.0 - self.beta2 ** self.iter) / (1.0 - self.beta1 ** self.iter)

for key in params.keys():

self.m[key] += (1 - self.beta1) * (grads[key] - self.m[key])

self.v[key] += (1 - self.beta2) * (grads[key] ** 2 - self.v[key])

params[key] -= lr_t * self.m[key] / (np.sqrt(self.v[key]) + 1e-7)

def f(x, y):

return x ** 2 / 20.0 + y ** 2

def df(x, y):

return x / 10.0, 2.0 * y

init_pos = (-7.0, 2.0)

params = {}

params['x'], params['y'] = init_pos[0], init_pos[1]

grads = {}

grads['x'], grads['y'] = 0, 0

optimizers = OrderedDict()

optimizers["SGD"] = SGD(lr=0.95)

optimizers["Momentum"] = Momentum(lr=0.1)

optimizers["AdaGrad"] = AdaGrad(lr=1.5)

optimizers["Adam"] = Adam(lr=0.3)

idx = 1

for key in optimizers:

optimizer = optimizers[key]

x_history = []

y_history = []

params['x'], params['y'] = init_pos[0], init_pos[1]

for i in range(30):

x_history.append(params['x'])

y_history.append(params['y'])

grads['x'], grads['y'] = df(params['x'], params['y'])

optimizer.update(params, grads)

x = np.arange(-10, 10, 0.01)

y = np.arange(-5, 5, 0.01)

X, Y = np.meshgrid(x, y)

Z = f(X, Y)

# for simple contour line

mask = Z > 7

Z[mask] = 0

# plot

plt.subplot(2, 2, idx)

idx += 1

plt.plot(x_history, y_history, 'o-', color="red")

plt.contour(X, Y, Z) # 绘制等高线

plt.ylim(-10, 10)

plt.xlim(-10, 10)

plt.plot(0, 0, '+')

plt.title(key)

plt.xlabel("x")

plt.ylabel("y")

plt.subplots_adjust(wspace=0, hspace=0) # 调整子图间距

plt.show()

结果如下:

4. 分析上图,说明原理

1. 为什么SGD会走“之字形”?其它算法为什么会比较平滑?

因为图像的变化并不均匀,所以y方向变化很大时,x方向变化很小,只能迂回往复地寻找, 效率很低,但对于算法自己来说这是不可避免的“最优路径”。其他算法在下降开始阶段,历史速度变量和当前梯度方向相反,就会使下降的过程更为平滑。

2. Momentum、AdaGrad对SGD的改进体现在哪里?速度?方向?在图上有哪些体现?

Momentum算法借用了物理中的动量概念,它模拟的是物体运动时的惯性,即更新的时候在一定程度上保留之前更新的方向,同时利用当前batch的梯度微调最终的更新方向。这样一来,可以在一定程度上增加稳定性,从而学习地更快,并且还有一定摆脱局部最优的能力:

Momentum算法会观察历史梯度![]() ,若当前梯度的方向与历史梯度一致(表明当前样本不太可能为异常点),则会增强这个方向的梯度,若当前梯度与历史梯方向不一致,则梯度会衰减。

,若当前梯度的方向与历史梯度一致(表明当前样本不太可能为异常点),则会增强这个方向的梯度,若当前梯度与历史梯方向不一致,则梯度会衰减。

Adagrad算法能够在训练中自动的对learning rate进行调整,对于出现频率较低参数采用较大的α更新;相反,对于出现频率较高的参数采用较小的α更新。因此,Adagrad非常适合处理稀疏数据。

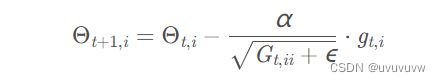

Adagrad在每轮训练中对每个参数![]() 的学习率进行更新,参数更新公式如下:

的学习率进行更新,参数更新公式如下:

3. 仅从轨迹来看,Adam似乎不如AdaGrad效果好,是这样么?

是,AdaGrad擅长学习稀疏feature和稀疏梯度。学习率衰减的Adam算法在imdb数据集(Bow feature)上,可以取得和AdaGrad一样的效果。

5. 总结SGD、Momentum、AdaGrad、Adam的优缺点

SGD:

优点:

- 算法收敛速度快(在Batch Gradient Descent算法中, 每轮会计算很多相似样本的梯度, 这部分是冗余的)

- 可以在线更新

- 有几率跳出一个比较差的局部最优而收敛到一个更好的局部最优甚至是全局最优

缺点:

- 容易收敛到局部最优,并且容易被困在鞍点

Momentum:

优点:

- 增加了稳定性;

- 收敛速度更快;

- 还有一定摆脱局部最优的能力。

AdaGrad:

优点:

- 不同更新频率的参数具有不同的学习率,减少摆动,在稀疏数据场景下表现会非常好;

- 允许使用一个更大的学习率

,从而加快算法的学习速度;

,从而加快算法的学习速度;

缺点:

- 因为

是不断累积单调递增的,会使得学习率单调递减至0,可能会使得训练过程提前结束,即使后续还有数据也无法学到需要的知识;

是不断累积单调递增的,会使得学习率单调递减至0,可能会使得训练过程提前结束,即使后续还有数据也无法学到需要的知识;

Adam:

优点:

- 自动调整参数的学习率;

- 大幅提升了训练速度;

- 提高了稳定性;

6. Adam这么好,SGD是不是就用不到了?

不是,Adam操作并不一定能够适应所有的场合,如果能够深入了解数据,可以更加自如地控制优化迭代的各类参数,实现更好的效果。Adam也存在一些问题:

- SGD没有用到二阶动量,因此学习率是恒定的(实际使用过程中会采用学习率衰减策略,因此学习率递减),但Adam则不然。二阶动量是固定时间窗口内的累积,随着时间窗口的变化,遇到的数据可能发生巨变,使得

可能会时大时小,不是单调变化。这就可能在训练后期引起学习率的震荡,导致模型无法收敛。

可能会时大时小,不是单调变化。这就可能在训练后期引起学习率的震荡,导致模型无法收敛。 - 深度神经网络往往包含大量的参数,在这样一个维度极高的空间内,非凸的目标函数往往起起伏伏,拥有无数个高地和洼地。有的是高峰,通过引入动量可能很容易越过;但有些是高原,可能探索很多次都出不来,于是停止了训练。

总结

这次作业通过对几种优化算法的比较,对SGD、Momentum、AdaGrad、Adam有了一定的了解,SGD最大的缺点是下降速度慢,而且可能会陷入局部最优,Adam虽然说已经简化了调参,但是并没有一劳永逸地解决问题,虽然有默认参数,但并不是任何情况都适用。因此,在充分理解数据的基础上,依然需要根据数据特性、算法特性进行充分的调参实验,找到最优解。

ref

优化方法总结:SGD,Momentum,AdaGrad,RMSProp,Adam_Joe-Han的博客-CSDN博客_sgd momentum

Adam那么棒,为什么还对SGD念念不忘 (2)—— Adam的两宗罪 - 知乎 (zhihu.com)