Docker高级

文章目录

- 一.Docker复杂安装

-

- 1.安装mysql主从复制

- 2.redis集群配置

-

- 集群搭建

- 主从容错切换迁移案例

- 主从扩容案例

- 主从缩容案例

- 二.DockerFile解析

-

- 1.是什么

- 2.DockerFile构建过程解析

-

- Dockerfile内容基础知识

- Docker执行Dockerfile的大致流程

- 总结

- 3.DockerFile常用保留字指令

- 4.自定义镜像mycentosjava8

- 5.虚悬镜像

- 三.Docker微服务实战

-

- 1.通过IDEA新建一个普通微服务模块

- 2.通过dockerfile发布微服务部署到docker容器

- 四.Docker网络

-

- 1.是什么

- 2.常用基本命令

- 3.能干嘛

- 4.网络模式

-

- 总体介绍

- 案例说明

- 5.Docker平台架构图解

- 五.Docker-compose容器编排

-

- 1.简介

- 2.Compose核心概念

- 3.Compose使用的三个步骤

- 4.Compose常用命令

- 5.Compose编排微服务

- 六.Docker轻量级可视化工具Portainer

- 七.Docker容器监控CAdvisor+InfluxDB+Granfana

-

- 1. 原生命令

- 2.容器监控3剑客

- 八.docker常见错误

-

- 1.no space left on device 硬盘空间满了

一.Docker复杂安装

1.安装mysql主从复制

新建主服务器容器实例3307

docker run -p 3307:3306 --name mysql-master

-v /messi/mysql-master/log:/var/log/mysql

-v /messi/mysql-master/data:/var/lib/mysql

-v /messi/mysql-master/conf:/etc/mysql

-e MYSQL_ROOT_PASSWORD=root

-d mysql:5.7

进入/mydata/mysql-master/conf目录下新建my.cnf

[mysqld]

## 设置server_id,同一局域网中需要唯一

server_id=101

## 指定不需要同步的数据库名称

binlog-ignore-db=mysql

## 开启二进制日志功能

log-bin=mall-mysql-bin

## 设置二进制日志使用内存大小(事务)

binlog_cache_size=1M

## 设置使用的二进制日志格式(mixed,statement,row)

binlog_format=mixed

## 二进制日志过期清理时间。默认值为0,表示不自动清理。

expire_logs_days=7

## 跳过主从复制中遇到的所有错误或指定类型的错误,避免slave端复制中断。

## 如:1062错误是指一些主键重复,1032错误是因为主从数据库数据不一致

slave_skip_errors=1062

修改完配置后重启master实例

docker restart mysql-master

进入mysql-master容器

docker exec -it mysql-master /bin/bash

mysql -uroot -proot

master容器实例内创建数据同步用户

CREATE USER 'slave'@'%' IDENTIFIED BY 'root';

GRANT REPLICATION SLAVE, REPLICATION CLIENT ON *.* TO 'slave'@'%';

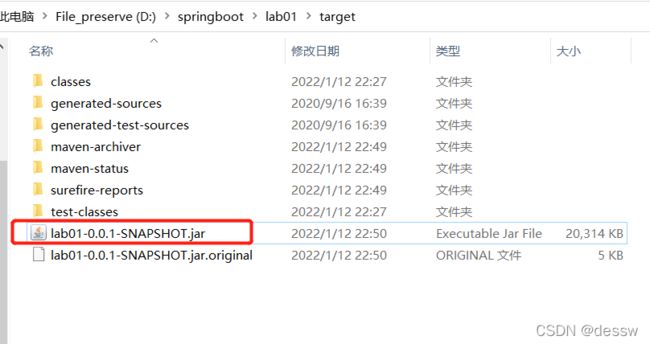

新建从服务器容器实例3308

docker run -p 3308:3306 --name mysql-slave \

-v /messi/mysql-slave/log:/var/log/mysql \

-v /messi/mysql-slave/data:/var/lib/mysql \

-v /messi/mysql-slave/conf:/etc/mysql \

-e MYSQL_ROOT_PASSWORD=root \

-d mysql:5.7

进入/mydata/mysql-slave/conf目录下新建my.cnf

修改完配置后重启slave实例

docker restart mysql-slave

在主数据库中查看主从同步状态

show master status;

进入mysql-slave容器

docker exec -it mysql-slave/bin/bash

mysql -uroot -proot

在从数据库中配置主从复制

change master to master_host='192.168.172.128',

master_user='slave',

master_password='root',

master_port=3307,

master_log_file='mall-mysql-bin.000001',

master_log_pos=617,

master_connect_retry=30;

主从复制命令参数说明

master_host:主数据库的IP地址;

master_port:主数据库的运行端口;

master_user:在主数据库创建的用于同步数据的用户账号;

master_password:在主数据库创建的用于同步数据的用户密码;

master_log_file:指定从数据库要复制数据的日志文件,通过查看主数据的状态,获取File参数;

master_log_pos:指定从数据库从哪个位置开始复制数据,通过查看主数据的状态,获取Position参数;

master_connect_retry:连接失败重试的时间间隔,单位为秒。

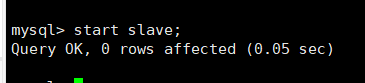

在从数据库中查看主从同步状态

show slave status \G;

在从数据库中开启主从同步

查看从数据库状态发现还不能同步

原因: Last_SQL_Error: Error ‘Operation DROP USER failed for ‘slave’@’%‘’ on query. Default database: ‘alldb’. Query: ‘drop user slave’@'%

就是没有同步之前的的主库授权用户,在部署完之后发现从库上没有之前主库上的授权用户,然后我撤销了,从库的SQL线程就断了,所以要谨慎操作。

解决办法: 一般都不是删除、撤销、当然就是在从库上做同样的授权。

CREATE USER 'slave'@'%' IDENTIFIED BY 'root';

GRANT REPLICATION SLAVE, REPLICATION CLIENT ON *.* TO 'slave'@'%';

成功

若主从库上的Master_Log_File也会报错,解决方式是修改从库上的该文件,使之保持一致:

CHANGE MASTER TO MASTER_LOG_FILE='mall-mysql-bin.000006', MASTER_LOG_POS=0;

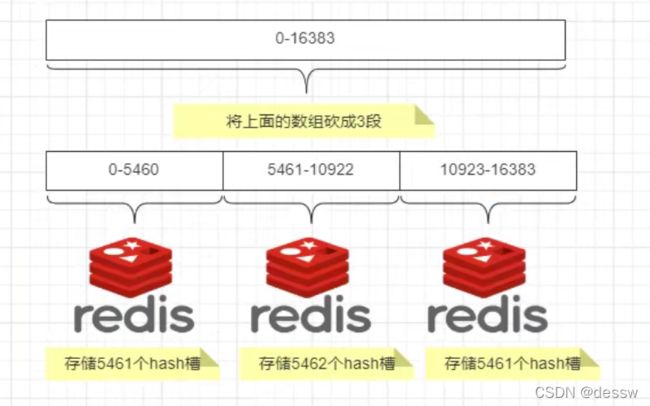

2.redis集群配置

集群搭建

新建6个docker容器redis实例

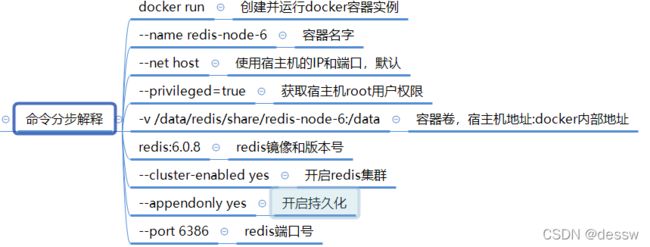

docker run -d --name redis-node-1 --net host --privileged=true -v /messi/rediscolony/redis-node-1:/data redis:6.0.8 --cluster-enabled yes --appendonly yes --port 6381

docker run -d --name redis-node-2 --net host --privileged=true -v /messi/rediscolony/redis-node-2:/data redis:6.0.8 --cluster-enabled yes --appendonly yes --port 6382

docker run -d --name redis-node-3 --net host --privileged=true -v /messi/rediscolony/redis-node-3:/data redis:6.0.8 --cluster-enabled yes --appendonly yes --port 6383

docker run -d --name redis-node-4 --net host --privileged=true -v /messi/rediscolony/redis-node-4:/data redis:6.0.8 --cluster-enabled yes --appendonly yes --port 6384

docker run -d --name redis-node-5 --net host --privileged=true -v /messi/rediscolony/redis-node-5:/data redis:6.0.8 --cluster-enabled yes --appendonly yes --port 6385

docker run -d --name redis-node-6 --net host --privileged=true -v /messi/rediscolony/redis-node-6:/data redis:6.0.8 --cluster-enabled yes --appendonly yes --port 6386

docker exec -it redis-node-1 /bin/bash

redis-cli --cluster create

192.168.172.128:6381

192.168.172.128:6382

192.168.172.128:6383

192.168.172.128:6384

192.168.172.128:6385

192.168.172.128:6386

--cluster-replicas 1

–cluster-replicas 1 表示为每个master创建一个slave节点

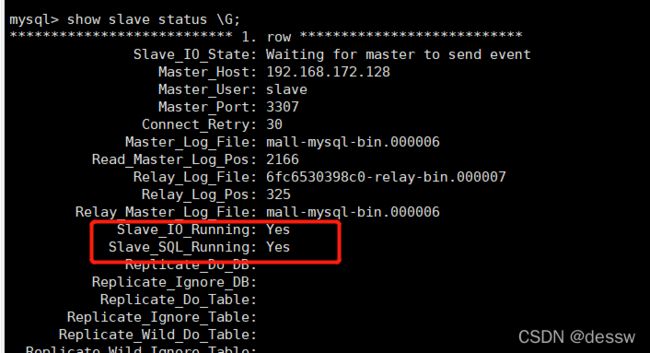

链接进入6381作为切入点,查看集群状态

cluster info

cluster nodes

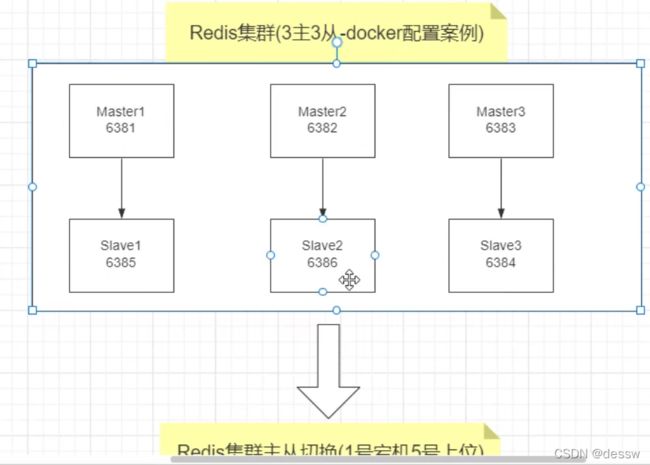

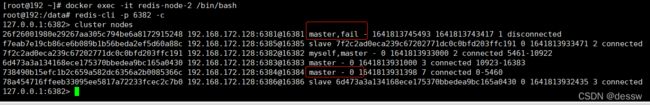

主从容错切换迁移案例

数据读写存储:防止路由失效加参数-c并新增两个key

查看集群信息

redis-cli --cluster check 192.168.172.128:6381

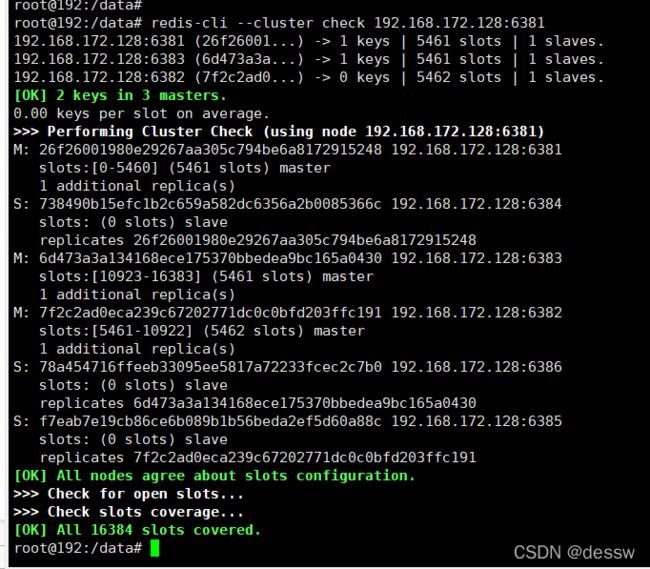

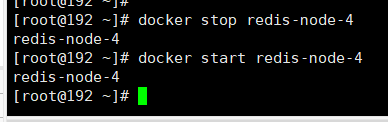

主6381和从机切换,先停止主机6381

6381宕机了,6384上位成为了新的master

重启6381,6381为从机,6384依然为主机

再停6384,之后再启6384,6381为主机,6384变为从机

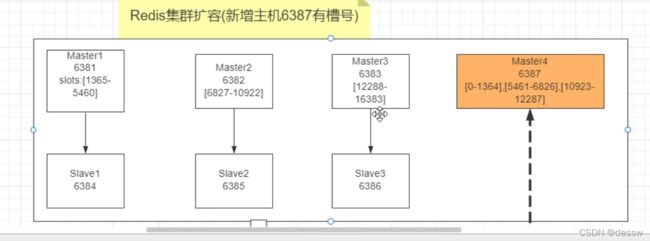

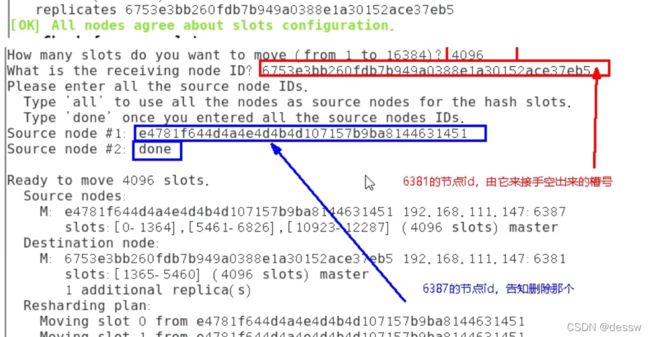

主从扩容案例

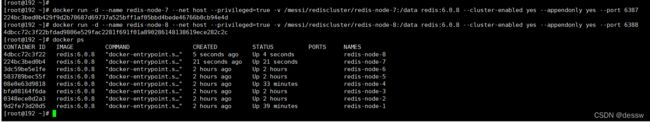

新建6387、6388两个节点+新建后启动+查看是否8节点

docker run -d --name redis-node-7 --net host --privileged=true -v /messi/rediscluster/redis-node-7:/data redis:6.0.8 --cluster-enabled yes --appendonly yes --port 6387

docker run -d --name redis-node-8 --net host --privileged=true -v /messi/rediscluster/redis-node-8:/data redis:6.0.8 --cluster-enabled yes --appendonly yes --port 6388

docker ps

进入6387容器实例内部 ,将新增的6387节点(空槽号)作为master节点加入原集群

redis-cli --cluster add-node 192.168.172.128:6387 192.168.172.128:6381

6387 就是将要作为master新增节点,6381 就是原来集群节点里面的领路人,相当于6387拜拜6381的码头从而找到组织加入集群

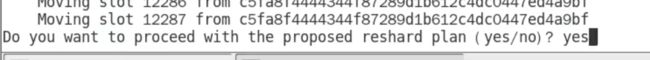

redis-cli --cluster reshard 192.168.172.128:6381

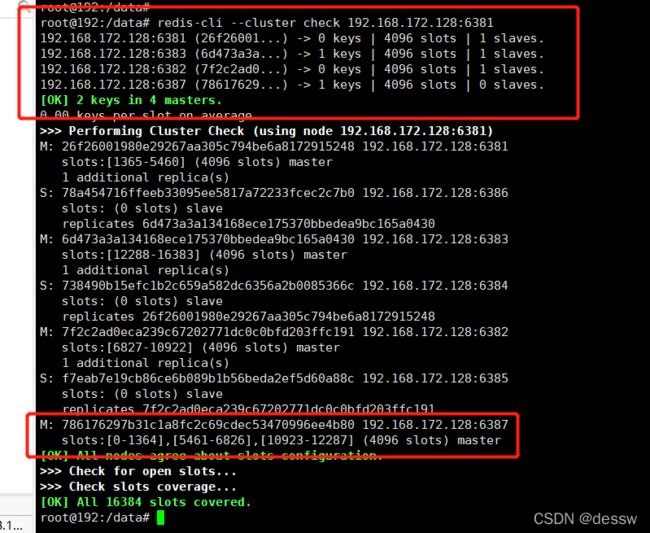

检查集群情况第2次

槽号分派说明

为什么6387是3个新的区间,以前的还是连续?重新分配成本太高,所以前3家各自匀出来一部分,从6381/6382/6383三个旧节点分别匀出1364个坑位给新节点6387

命令:

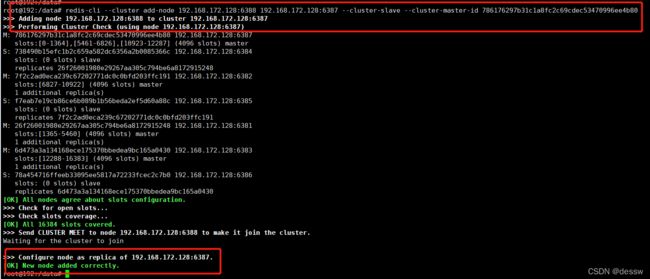

redis-cli --cluster add-node ip:新slave端口 ip:新master端口 --cluster-slave --cluster-master-id 新主机节点ID

redis-cli --cluster add-node 192.168.172.128:6388 192.168.172.128:6387 --cluster-slave --cluster-master-id 786176297b31c1a8fc2c69cdec53470996ee4b80-------这个是6387的编号,按照自己实际情况

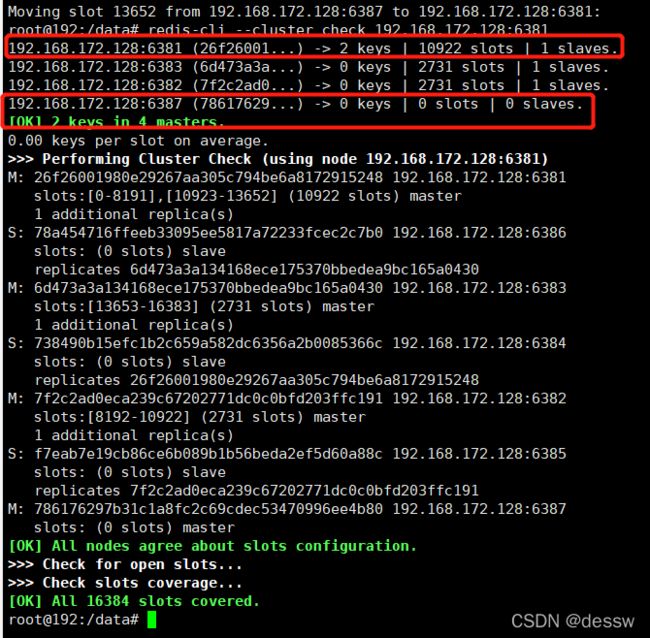

主从缩容案例

目的

6387和6388下线

将6388删除,从集群中将4号从节点6388删除

命令:redis-cli --cluster del-node ip:从机端口 从机6388节点ID

redis-cli --cluster del-node 192.168.172.128:6388 a8c7226a7f9505084dce9409d995a07dce719746

将6387的槽号清空,重新分配,本例将清出来的槽号都给6381

检查集群情况第二次

4096个槽位都指给6381,它变成了8192个槽位,相当于全部都给6381了,不然要输入3次,一锅端

将6387删除

redis-cli --cluster del-node ip:端口 6387节点ID

redis-cli --cluster del-node 192.168.172.128:6387 786176297b31c1a8fc2c69cdec53470996ee4b80

二.DockerFile解析

1.是什么

Dockerfile是用来构建Docker镜像的文本文件,是由一条条构建镜像所需的指令和参数构成的脚本。

构建三步骤

- 编写Dockerfile文件

- docker build命令构建镜像

- docker run依镜像运行容器实例

2.DockerFile构建过程解析

Dockerfile内容基础知识

- 1:每条保留字指令都必须为大写字母且后面要跟随至少一个参数

- 2:指令按照从上到下,顺序执行

- 3:#表示注释

- 4:每条指令都会创建一个新的镜像层并对镜像进行提交

Docker执行Dockerfile的大致流程

- (1)docker从基础镜像运行一个容器

- (2)执行一条指令并对容器作出修改

- (3)执行类似docker commit的操作提交一个新的镜像层

- (4)docker再基于刚提交的镜像运行一个新容器

- (5)执行dockerfile中的下一条指令直到所有指令都执行完成

总结

从应用软件的角度来看,Dockerfile、Docker镜像与Docker容器分别代表软件的三个不同阶段, Dockerfile是软件的原材料, Docker镜像是软件的交付品, Docker容器则可以认为是软件镜像的运行态,也即依照镜像运行的容器实例。Dockerfile面向开发,Docker镜像成为交付标准,Docker容器则涉及部署与运维,三者缺一不可,合力充当Docker体系的基石。

-

1 Dockerfile,需要定义一个Dockerfile,Dockerfile定义了进程需要的一切东西。Dockerfile涉及的内容包括执行代码或者是文件、环境变量、依赖包、运行时环境、动态链接库、操作系统的发行版、服务进程和内核进程(当应用进程需要和系统服务和内核进程打交道,这时需要考虑如何设计namespace的权限控制)等等;

-

2 Docker镜像,在用Dockerfile定义一个文件之后,docker build时会产生一个Docker镜像,当运行 Docker镜像时会真正开始提供服务;

-

3 Docker容器,容器是直接提供服务的。

3.DockerFile常用保留字指令

FROM

基础镜像,当前新镜像是基于哪个镜像的,指定一个已经存在的镜像作为模板,第一条必须是from

MAINTAINER

镜像维护者的姓名和邮箱地址

RUN

容器构建时需要运行的命令,RUN是在 docker build时运行

- 两种格式

- shell格式 :RUN yum -y install vim

- exec格式

EXPOSE

当前容器对外暴露出的端口

WORKDIR

指定在创建容器后,终端默认登陆的进来工作目录,一个落脚点

USER

指定该镜像以什么样的用户去执行,如果都不指定,默认是root

ENV

用来在构建镜像过程中设置环境变量

ADD

将宿主机目录下的文件拷贝进镜像且会自动处理URL和解压tar压缩包

COPY

类似ADD,拷贝文件和目录到镜像中。将从构建上下文目录中 <源路径> 的文件/目录复制到新的一层的镜像内的 <目标路径> 位置

- COPY src dest

- COPY [“src”, “dest”]

:源文件或者源目录 :容器内的指定路径,该路径不用事先建好,路径不存在的话,会自动创建。

VOLUME

容器数据卷,用于数据保存和持久化工作

CMD

指定容器启动后的要干的事情

注意:

Dockerfile 中可以有多个 CMD 指令,但只有最后一个生效,CMD 会被 docker run 之后的参数替换

它和前面RUN命令的区别:

CMD是在docker run 时运行。

RUN是在 docker build时运行。

ENTRYPOINT

也是用来指定一个容器启动时要运行的命令,类似于 CMD 指令,但是ENTRYPOINT不会被docker run后面的命令覆盖,而且这些命令行参数会被当作参数送给 ENTRYPOINT 指令指定的程序

命令格式:

ENTRYPOINT可以和CMD一起用,一般是变参才会使用 CMD ,这里的 CMD 等于是在给 ENTRYPOINT 传参。当指定了ENTRYPOINT后,CMD的含义就发生了变化,不再是直接运行其命令而是将CMD的内容作为参数传递给ENTRYPOINT指令,他两个组合会变成

案例如下:

假设已通过 Dockerfile 构建了 nginx:test 镜像:

是否传参按照dockerfile编写执行传参运行Docker命令docker run nginx:test

docker run nginx:test -c /etc/nginx/new.conf衍生出的实际命令nginx -c /etc/nginx/nginx.conf

nginx -c /etc/nginx/new.conf

优点

在执行docker run的时候可以指定 ENTRYPOINT 运行所需的参数。

注意

如果 Dockerfile 中如果存在多个 ENTRYPOINT 指令,仅最后一个生效。

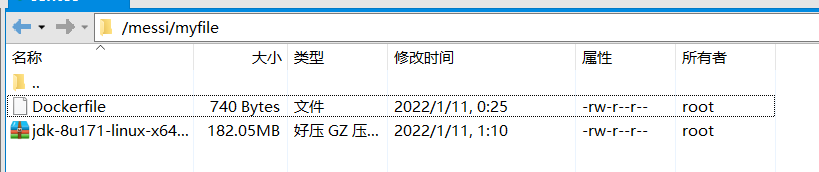

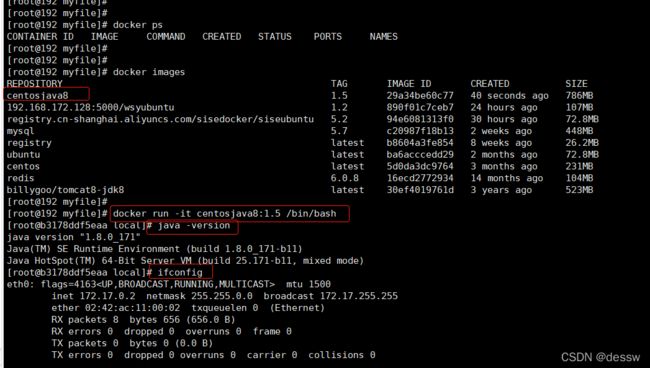

4.自定义镜像mycentosjava8

要求

Centos7镜像具备vim+ifconfig+jdk8

下载jdk

https://mirrors.yangxingzhen.com/jdk/

编写Dockerfile文件

FROM centos

MAINTAINER dessw<1335162133@qq.com>

ENV MYPATH /usr/local

WORKDIR $MYPATH

#安装vim编辑器

RUN yum -y install vim

#安装ifconfig命令查看网络IP

RUN yum -y install net-tools

#安装java8及lib库

RUN yum -y install glibc.i686

RUN mkdir /usr/local/java

#ADD 是相对路径jar,把jdk-8u171-linux-x64.tar.gz添加到容器中,安装包必须要和Dockerfile文件在同一位置

ADD jdk-8u171-linux-x64.tar.gz /usr/local/java/

#配置java环境变量

ENV JAVA_HOME /usr/local/java/jdk1.8.0_171

ENV JRE_HOME $JAVA_HOME/jre

ENV CLASSPATH $JAVA_HOME/lib/dt.jar:$JAVA_HOME/lib/tools.jar:$JRE_HOME/lib:$CLASSPATH

ENV PATH $JAVA_HOME/bin:$PATH

EXPOSE 80

CMD echo $MYPATHCMD echo "success--------------ok"

CMD /bin/bash

构建

docker build -t 新镜像名字:TAG .

(注意,上面TAG后面有个空格,有个点)

运行

docker run -it 新镜像名字:TAG

docker run -it centosjava8:1.5 /bin/bash

再体会下UnionFS(联合文件系统)

UnionFS(联合文件系统):Union文件系统(UnionFS)是一种分层、轻量级并且高性能的文件系统,它支持对文件系统的修改作为一次提交来一层层的叠加,同时可以将不同目录挂载到同一个虚拟文件系统下(unite several directories into a single virtual filesystem)。Union 文件系统是 Docker 镜像的基础。镜像可以通过分层来进行继承,基于基础镜像(没有父镜像),可以制作各种具体的应用镜像。

特性:一次同时加载多个文件系统,但从外面看起来,只能看到一个文件系统,联合加载会把各层文件系统叠加起来,这样最终的文件系统会包含所有底层的文件和目录

5.虚悬镜像

是什么

仓库名、标签都是的镜像,俗称dangling image

Dockerfile写一个

1 vim Dockerfilefrom ubuntuCMD echo 'action is success'

2 docker build .

查看

docker image ls -f dangling=true

删除

docker image prune

虚悬镜像已经失去存在价值,可以删除

三.Docker微服务实战

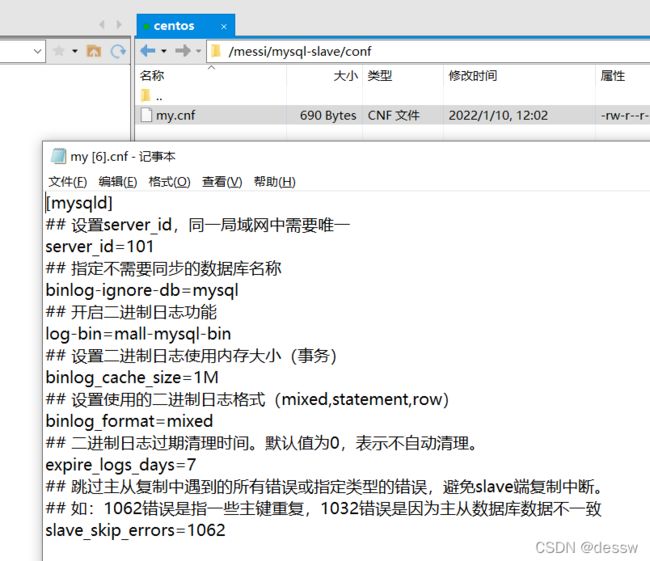

1.通过IDEA新建一个普通微服务模块

2.通过dockerfile发布微服务部署到docker容器

编写Dockerfile

# 基础镜像使用java

FROM java:8

# 作者

MAINTAINER wsy

# VOLUME 指定临时文件目录为/tmp,在主机/var/lib/docker目录下创建了一个临时文件并链接到容器的/tmp

VOLUME /tmp

# 将jar包添加到容器中并更名为zzyy_docker.jar

ADD lab01-0.0.1-SNAPSHOT.jar wsy_docker.jar

# 运行jar包

RUN bash -c 'touch /wsy_docker.jar'

ENTRYPOINT ["java","-jar","/wsy_docker.jar"]

#暴露6001端口作为微服务

EXPOSE 6001

将微服务jar包和Dockerfile文件上传到同一个目录下/dockerservice

构建镜像

docker build -t wsy_docker:1.6 .

运行容器

docker run -d -p 6001:6001 wsy_docker:1.6

四.Docker网络

1.是什么

docker不启动,默认网络情况

ens33

lo

virbr0

2.常用基本命令

查看网络

docker network ls

查看网络源数据

docker network inspect XXX网络名字

删除网络

docker network rm XXX网络名字

3.能干嘛

容器间的互联和通信以及端口映射

容器IP变动时候可以通过服务名直接网络通信而不受到影响

4.网络模式

总体介绍

- bridge模式:使用–network bridge指定,默认使用docker0

- host模式:使用–network host指定

- none模式:使用–network none指定

- container模式:使用–network container:NAME或者容器ID指定

容器实例内默认网络IP生产规则

1 先启动两个ubuntu容器实例

2 docker inspect 容器ID or 容器名字

3 关闭u2实例,新建u3,查看ip变化

结论:docker容器内部的ip是有可能会发生改变的

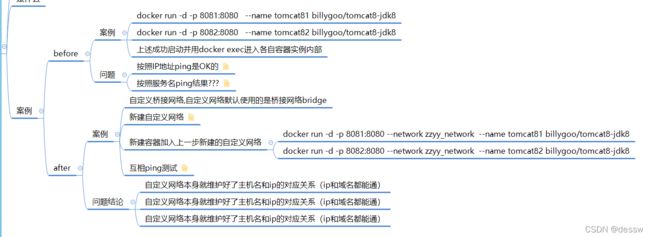

案例说明

- host

直接使用宿主机的 IP 地址与外界进行通信,不再需要额外进行NAT 转换。

容器将不会获得一个独立的Network Namespace, 而是和宿主机共用一个Network Namespace。容器将不会虚拟出自己的网卡而是使用宿主机的IP和端口。

警告

docker run -d -p 8083:8080 --network host --name tomcat83 billygoo/tomcat8-jdk8

问题: docke启动时总是遇见标题中的警告

原因:

docker启动时指定–network=host或-net=host,如果还指定了-p映射端口,那这个时候就会有此警告,

并且通过-p设置的参数将不会起到任何作用,端口号会以主机端口号为主,重复时则递增。

解决:

解决的办法就是使用docker的其他网络模式,例如–network=bridge,这样就可以解决问题,或者直接无视。

正确

docker run -d --network host --name tomcat83 billygoo/tomcat8-jdk8

没有设置-p的端口映射了,如何访问启动的tomcat83?

http://宿主机IP:8080/

在CentOS里面用默认的火狐浏览器访问容器内的tomcat83看到访问成功,因为此时容器的IP借用主机的,所以容器共享宿主机网络IP,这样的好处是外部主机与容器可以直接通信。

- bridge

是什么

Docker 服务默认会创建一个 docker0 网桥(其上有一个 docker0 内部接口),该桥接网络的名称为docker0,它在内核层连通了其他的物理或虚拟网卡,这就将所有容器和本地主机都放到同一个物理网络。Docker 默认指定了 docker0 接口 的 IP 地址和子网掩码,让主机和容器之间可以通过网桥相互通信。

查看 bridge 网络的详细信息,并通过 grep 获取名称项

docker network inspect bridge | grep name

ifconfig

案例

docker run -d -p 8081:8080 --name tomcat81 billygoo/tomcat8-jdk8

docker run -d -p 8082:8080 --name tomcat82 billygoo/tomcat8-jdk8

- none

是什么

禁用网络功能,只有lo标识(就是127.0.0.1表示本地回环)

在none模式下,并不为Docker容器进行任何网络配置。 也就是说,这个Docker容器没有网卡、IP、路由等信息,只有一个lo需要我们自己为Docker容器添加网卡、配置IP等。

docker run -d -p 8084:8080 --network none --name tomcat84 billygoo/tomcat8-jdk8

- container

是什么

container⽹络模式

新建的容器和已经存在的一个容器共享一个网络ip配置而不是和宿主机共享。新创建的容器不会创建自己的网卡,配置自己的IP,而是和一个指定的容器共享IP、端口范围等。同样,两个容器除了网络方面,其他的如文件系统、进程列表等还是隔离的。

案例

docker run -d -p 8085:8080 --name tomcat85 billygoo/tomcat8-jdk8

docker run -d -p 8086:8080 --network container:tomcat85 --name tomcat86 billygoo/tomcat8-jdk8

运行结果

相当于tomcat86和tomcat85公用同一个ip同一个端口,导致端口冲突

- 自定义网络

5.Docker平台架构图解

从其架构和运行流程来看,Docker 是一个 C/S 模式的架构,后端是一个松耦合架构,众多模块各司其职。

Docker 运行的基本流程为:

- 1 用户是使用 Docker Client 与 Docker Daemon 建立通信,并发送请求给后者。

- 2 Docker Daemon 作为 Docker 架构中的主体部分,首先提供 Docker Server 的功能使其可以接受 Docker Client 的请求。

- 3 Docker Engine 执行 Docker 内部的一系列工作,每一项工作都是以一个 Job 的形式的存在。

- 4 Job 的运行过程中,当需要容器镜像时,则从 Docker Registry 中下载镜像,并通过镜像管理驱动 Graph driver将下载镜像以Graph的形式存储。

- 5 当需要为 Docker 创建网络环境时,通过网络管理驱动 Network driver 创建并配置 Docker 容器网络环境。

- 6 当需要限制 Docker 容器运行资源或执行用户指令等操作时,则通过 Execdriver 来完成。

- 7 Libcontainer是一项独立的容器管理包,Network driver以及Exec driver都是通过Libcontainer来实现具体对容器进行的操作。

五.Docker-compose容器编排

1.简介

Compose 是 Docker 公司推出的一个工具软件,可以管理多个 Docker 容器组成一个应用。你需要定义一个 YAML 格式的配置文件docker-compose.yml,写好多个容器之间的调用关系。然后,只要一个命令,就能同时启动/关闭这些容器

作用

docker建议我们每一个容器中只运行一个服务,因为docker容器本身占用资源极少,所以最好是将每个服务单独的分割开来但是这样我们又面临了一个问题?

如果我需要同时部署好多个服务,难道要每个服务单独写Dockerfile然后在构建镜像,构建容器,这样累都累死了,所以docker官方给我们提供了docker-compose多服务部署的工具。

例如,要实现一个Web微服务项目,除了Web服务容器本身,往往还需要再加上后端的数据库mysql服务容器,redis服务器,注册中心eureka,甚至还包括负载均衡容器等等。。

Compose允许用户通过一个单独的docker-compose.yml模板文件(YAML 格式)来定义一组相关联的应用容器为一个项目(project)。

可以很容易地用一个配置文件定义一个多容器的应用,然后使用一条指令安装这个应用的所有依赖,完成构建。Docker-Compose 解决了容器与容器之间如何管理编排的问题。

安装步骤

curl -L "https://github.com/docker/compose/releases/download/1.29.2/docker-compose-$(uname -s)-$(uname -m)" -o /usr/local/bin/docker-composechmod +x /usr/local/bin/docker-composedocker-compose --version

sudo curl -L "https://github.com/docker/compose/releases/download/1.29.2/docker-compose-$(uname -s)-$(uname -m)" -o /usr/local/bin/docker-compose

2.Compose核心概念

一文件

docker-compose.yml

两要素

-

服务(service):一个个应用容器实例,比如订单微服务、库存微服务、mysql容器、nginx容器或者redis容器

-

工程(project):由一组关联的应用容器组成的一个完整业务单元,在 docker-compose.yml 文件中定义。

3.Compose使用的三个步骤

- 编写Dockerfile定义各个微服务应用并构建出对应的镜像文件

- 使用 docker-compose.yml 定义一个完整业务单元,安排好整体应用中的各个容器服务。

- 最后,执行docker-compose up命令 来启动并运行整个应用程序,完成一键部署上线

4.Compose常用命令

-

docker-compose -h # 查看帮助

-

docker-compose up # 启动所有docker-compose服务

-

docker-compose up -d # 启动所有docker-compose服务并后台运行

-

docker-compose down # 停止并删除容器、网络、卷、镜像。

-

docker-compose exec yml里面的服务id # 进入容器实例内部 docker-compose exec docker-compose.yml文件中写的服务id /bin/bash

-

docker-compose ps # 展示当前docker-compose编排过的运行的所有容器

-

docker-compose top # 展示当前docker-compose编排过的容器进程

-

docker-compose logs yml里面的服务id # 查看容器输出日志

-

docker-compose config # 检查配置

-

docker-compose config -q # 检查配置,有问题才有输出

-

docker-compose restart # 重启服务

-

docker-compose start # 启动服务

-

docker-compose stop # 停止服务

5.Compose编排微服务

编写docker-compose.yml文件

version: "3"

#需要启动的镜像服务

services:

microService:

image: zzyy_docker:1.6

container_name: ms01

ports:

- "6001:6001"

volumes:

- /app/microService:/data

networks:

- atguigu_net

depends_on:

- redis

- mysql

redis:

image: redis:6.0.8

ports:

- "6379:6379"

volumes:

- /app/redis/redis.conf:/etc/redis/redis.conf

- /app/redis/data:/data

networks:

- atguigu_net

command: redis-server /etc/redis/redis.conf

mysql:

image: mysql:5.7

environment:

MYSQL_ROOT_PASSWORD: '123456'

MYSQL_ALLOW_EMPTY_PASSWORD: 'no'

MYSQL_DATABASE: 'db2021'

MYSQL_USER: 'zzyy'

MYSQL_PASSWORD: 'zzyy123'

ports:

- "3306:3306"

volumes:

- /app/mysql/db:/var/lib/mysql

- /app/mysql/conf/my.cnf:/etc/my.cnf

- /app/mysql/init:/docker-entrypoint-initdb.d

networks:

- atguigu_net

command: --default-authentication-plugin=mysql_native_password #解决外部无法访问

networks:

atguigu_net:

修改微服务工程docker_boot

通过服务名访问,IP无关

spring.datasource.url=jdbc:mysql://mysql:3306/db2021?useUnicode=true&characterEncoding=utf-8&useSSL=false

spring.redis.host=redis

mvn package命令将微服务形成新的jar包

并上传到Linux服务器/mydocker目录下

编写Dockerfile

# 基础镜像使用java

FROM java:8

# 作者

MAINTAINER zzyy

# VOLUME 指定临时文件目录为/tmp,在主机/var/lib/docker目录下创建了一个临时文件并链接到容器的/tmp

VOLUME /tmp

# 将jar包添加到容器中并更名为zzyy_docker.jar

ADD docker_boot-0.0.1-SNAPSHOT.jar zzyy_docker.jar

# 运行jar包

RUN bash -c 'touch /zzyy_docker.jar'

ENTRYPOINT ["java","-jar","/zzyy_docker.jar"]

#暴露6001端口作为微服务

EXPOSE 6001

构建镜像

docker build -t zzyy_docker:1.6 .

执行

docker-compose up

或者

docker-compose up -d

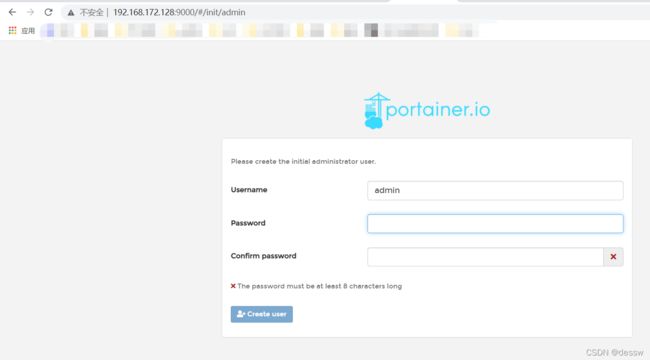

六.Docker轻量级可视化工具Portainer

Portainer 是一款轻量级的应用,它提供了图形化界面,用于方便地管理Docker环境,包括单机环境和集群环境。

docker命令安装

docker run -d -p 8000:8000 -p 9000:9000 --name portainer --restart=always -v /var/run/docker.sock:/var/run/docker.sock -v portainer_data:/data portainer/portainer

第一次登录需创建admin,访问地址:xxx.xxx.xxx.xxx:9000

设置admin用户和密码后首次登陆

选择local选项卡后本地docker详细信息展示

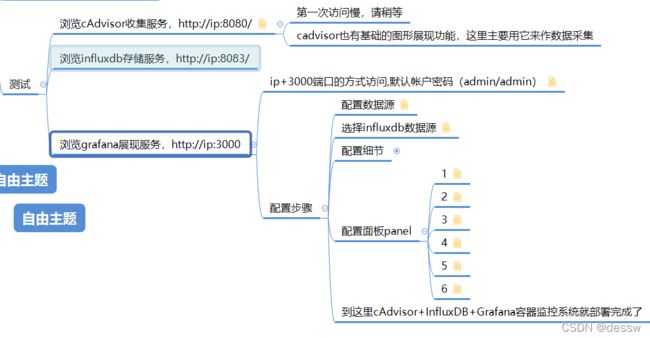

七.Docker容器监控CAdvisor+InfluxDB+Granfana

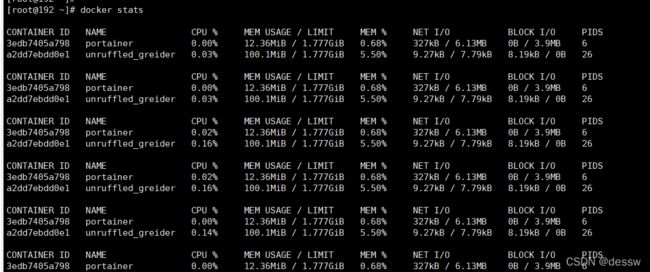

1. 原生命令

docker stats

通过docker stats命令可以很方便的看到当前宿主机上所有容器的CPU,内存以及网络流量等数据,一般小公司够用了。。。但是,docker stats统计结果只能是当前宿主机的全部容器,数据资料是实时的,没有地方存储、没有健康指标过线预警等功能

2.容器监控3剑客

CAdvisor监控收集+InfluxDB存储数据+Granfana展示图表

新建3件套组合的docker-compose.yml

version: '3.1'

volumes:

grafana_data: {}

services:

influxdb:

image: tutum/influxdb:0.9

restart: always

environment:

- PRE_CREATE_DB=cadvisor

ports:

- "8083:8083"

- "8086:8086"

volumes:

- ./data/influxdb:/data

cadvisor:

image: google/cadvisor

links:

- influxdb:influxsrv

command: -storage_driver=influxdb -storage_driver_db=cadvisor -storage_driver_host=influxsrv:8086

restart: always

ports:

- "8080:8080"

volumes:

- /:/rootfs:ro

- /var/run:/var/run:rw

- /sys:/sys:ro

- /var/lib/docker/:/var/lib/docker:ro

grafana:

user: "104"

image: grafana/grafana

user: "104"

restart: always

links:

- influxdb:influxsrv

ports:

- "3000:3000"

volumes:

- grafana_data:/var/lib/grafana

environment:

- HTTP_USER=admin

- HTTP_PASS=admin

- INFLUXDB_HOST=influxsrv

- INFLUXDB_PORT=8086

- INFLUXDB_NAME=cadvisor

- INFLUXDB_USER=root

- INFLUXDB_PASS=root

启动docker-compose文件

docker-compose up

八.docker常见错误

1.no space left on device 硬盘空间满了

a.检查Docker Root Dir,命令执行:

docker info

2.根据上一步骤的Docker Root Dir查看空间使用情况

df -h /var/lib/docker/

看到空间已经满了。

3.清理一些无用的docker数据

docker system prune -a

4.查找系统中的大文件

find / -type f -size +100M -print0 | xargs -0 du -h | sort -nr #

查找"/"目录下所有大于100M的所有文件

5.docker配置日志文件最大容量、最大日志文件数

创建或修改文件 /etc/docker/daemon.json,并增加以下配置

{

"log-driver":"json-file",

"log-opts":{

"max-size" :"50m","max-file":"1"

}

}