CUGAN=CResMD+GAN | 为进一步提升调制图像复原视觉质量,先进院董超团队提出集成CResMD与GAN的CUGAN

编辑:Happy

首发:AIWalker

本文是中科院深圳先进技术研究院董超团队在调制图像复原方面的最新力作。该团队在调试图像复原方面的工作从CVPR2019的AdaFM与DNI,到ECCV2020的CResMD,再到本文CUGAN,延续了其一贯简单且实用的风格。本文所提CUGAN当属CResMD的扩展版:引入GAN训练提升纹理细节。

Abstract

调制图像复原水平旨在通过改变影响复原强度的因子生成复原图像。已有工作主要聚焦于优化均方误差,它会带来比较的重建精度,但缺乏细粒度的纹理细节。

本文提出一种CUGAN(Controllable Unet Generative Adversarial Network)用于在调制任务中生成高频纹理,CUGAN由BaseNet与ConditionNet构成。

- BaseNet包含生成器与判别器,在生成器中,我们通过天界不同特征的尺度达到控制复原水平的目的。此外,我们对判别器按照退化的严重性自适应调制中间特征。

- ConditionNet则接收条件向量(编码了退化信息)作为输入,为生成器与判别器生成调制参数。

在测试阶段,用户可以通过调节条件向量控制输出图像的效果。我们还通过一种简单的过渡方法提供了GAN和MSE效应之间的平滑过渡。实验结果表明:所提CUGAN可以在调制图像复原任务上取得非常优秀的性能。

本文贡献包含以下几点:

- 提出一种新颖的基于GAN的调制图像复原框架CUGAN;

- 提出一种带全局特征调制的判别器以缓解生成器在严重退化时的梯度消失问题;

- 合成数据与真实数据验证了所提CUGAN在调制图像复原方面的优异性能。

Method

本文目标在于设计一种基于GAN的图像复原模型,它以退化图像核期望的复原信息作为输入,输出视觉友好的复原图像。这里的复原信息等价于退化信息,可以通过滑动条方式让用户在测试阶段调节。

给定通过某些退化方式得到的退化图像 I i d i s I_i^{dis} Iidis,我们期望将其复原为 I i r e s I_i^{res} Iires并与真值图像 I g t I^{gt} Igt尽可能相似。为使得模型可以处理不同退化程度图像,我们引入了一个条件向量 z ( z k ∈ [ 0 , 1 ] ) z(z^k \in [0,1]) z(zk∈[0,1])。具体来说, z z z的每一维表示特定的退化类型,其值表示退化程度。因此我们的任务是寻找这样一个函数: F ( I i d i s , z i ) → I g t , i = 1 , 2 , ⋯ , N F(I_i^{dis}, z_i) \rightarrow I^{gt},i=1,2,\cdots, N F(Iidis,zi)→Igt,i=1,2,⋯,N。此外,我们引入了条件判别器,用于判别复原图像与真值图像在条件下的差异性。下图给出了本文所提CUGAN的框架示意图。

Base Networks

BaseNet由生成器G与判别器D构成,生成器G以退化图像作为输入,输出复原结果;判别器D则旨在对生成结果与真值进行真假判别。

Generator 架构见上面的Figure3,它是一种集成残差模块的UNet架构。G包含三个尺度: s c a l e 1 , s c a l e 2 , s c a l e 3 scale_1, scale_2, scale_3 scale1,scale2,scale3。相比普通网络,这种多尺度架构有助于获得更好的GAN调制结果。对于每个尺度,在左右分别有两个残差模块;尺度间通过 s t r i d e = 2 stride=2 stride=2的卷积和反卷积衔接。此外,我们还添加了全局链接以环节轻微退化时的复原难度。

Discriminator 它以 64 × 64 64\times 64 64×64图像块作为输入,输出预测结果,其架构见Figure3。我们参考SRGAN设计将输入逐渐下采样为特征向量。判别器总结有10个卷积,采用LeakyReLU激活函数,最后采用GAP+两个全连接层输出最后的概率。

Condition Networks

条件网络包含两部分: C G , C D C_G, C_D CG,CD分别表示作用生成器、作用于判别器。每个条件网络以条件向量作为输入,输出调制模块的参数。

首先,每个退化图像 x x x的退化信息编码为条件向量 z z z。具体来说,对于每个退化类型,其对应的退化强度缩放到 [ 0 , 1 ] [0,1] [0,1]。比如,假设输入图像的退化模糊核水平 r = 1 ( r ∈ [ 0 , 4 ] ) r=1 (r\in [0,4]) r=1(r∈[0,4]),噪声水平 σ = 10 , ( σ ∈ [ 0 , 50 ] ) \sigma=10,(\sigma \in [0,50]) σ=10,(σ∈[0,50]),我们可以得到对应的条件向量 z = [ 0.25 , 0.2 ] z=[0.25,0.2] z=[0.25,0.2]。

条件网络的架构见前面的Figure3,每个条件网络由多个独立全连接层构成。为生成作用于生成器的调制权值,第 i i i个全连接层将条件向量 z z z变换为可调权值 w i w_i wi。该过程可以描述如下:

w i = F i w ( z ) w_i = F_i^w(z) wi=Fiw(z)

其中, F i 2 ( ⋅ ) F_i^2(\cdot) Fi2(⋅)表示第 i i i个全连接层。 w i w_i wi的维度与待调制特征通道数相同。

对于判别器的调制,我们采用两个独立全连接层生成用于全局特征调制的尺度与偏移参数,描述如下:

α i = F i α ( z ) β i = F i β ( z ) \alpha_i = F_i^{\alpha}(z) \\ \beta_i = F_i^{\beta}(z) αi=Fiα(z)βi=Fiβ(z)

Modulation in Base Network

接下来,我们将引入了本文在生成器与判别器中的调制策略,见上面的Figure3。调制操作的参数通过条件网络生成。

对于生成器,我们对不同尺度以及同一尺度的不同特征添加控制约束。正如前面所提到的,生成器有三个尺度,不同尺度具有不同的分辨率。具体来说,对两个连续尺度,我们有:

x m ′ = F m + 1 G ( x m ) + x m x_m^{'} = F_{m+1}^G(x_m) + x_m xm′=Fm+1G(xm)+xm

F m + 1 G F_{m+1}^G Fm+1G表示生成器在尺度 s c a l e m + 1 scale_{m+1} scalem+1的变换操作。因此,我们定义调制尺度融合如下:

x m ′ = w i ∗ F m + 1 G ( x m ) + x m x_m^{'} = w_i * F_{m+1}^G(x_m) + x_m xm′=wi∗Fm+1G(xm)+xm

这种控制策略可以动态改变低分辨率特征的权值。直观的,当退化信息非常轻微时,调节权值将接近于0,也就是说不需要从低分辨率接受丰富上下文信息。

在同一尺度内,我们构建了调制残差模块,定义如下:

x i ′ = w i ∗ f ( x i ) + x i x_i^{'} = w_i * f(x_i) + x_i xi′=wi∗f(xi)+xi

在判别器中,我们采用了全局特征调制进行中间特征的调节。具体来说,我们基于条件对中间特征进行缩放、偏移。定义如下:

x i ′ = α i ∗ x i + β i x_i^{'} = \alpha_i * x_i + \beta_i xi′=αi∗xi+βi

Interpolation between modulation models

所提CUGAN可以取得真实图像复原调制效果,为了满足不同用户品味,我们采用网络插值技术(DNI)获得GAN到MSE效果之间的平滑过度。具体来说,我们先训练一个PSNR导向的调制模型得到 G M S E , C M S E G_{MSE}, C_{MSE} GMSE,CMSE;然后我们在前述基础上微调一个GAN导向的调制模型得到 G G A N , C G A N G_{GAN}, C_{GAN} GGAN,CGAN;最后我们对所得模型进行如下参数插值:

θ G i n t e r p = ( 1 − α ) θ G G A N + α θ G M S E θ C i n t e r p = ( 1 − α ) θ C G A N + α θ C M S E \theta_G^{interp} = (1 - \alpha) \theta_G^{GAN} + \alpha \theta_G^{MSE} \\ \theta_C^{interp} = (1 - \alpha) \theta_C^{GAN} + \alpha \theta_C^{MSE} θGinterp=(1−α)θGGAN+αθGMSEθCinterp=(1−α)θCGAN+αθCMSE

注: α \alpha α表示插值系数。在实际应用中,我们首先制定合适的条件向量以生成真实复原图像;然后我们调节插值系数以得到无伪影的GAN与MSE的平滑过度效果。

Experiments

我们采用DIV2K进行模型训练,在退化类型方面,我们选择了高斯噪声(噪声水平范围 σ ∈ [ 0 , 50 ] \sigma \in [0,50] σ∈[0,50])、高斯模糊(模糊半径 r ∈ [ 0 , 4 ] r \in [0,4] r∈[0,4]),在两个退化方面以1和0.1间隔进行退化强度采样。

整个训练过程包含两个阶段:

- 首先,我们采用MSE损失预训练得到PSNR导向的调制模型CUnet;

- 然后,在上述预训练模型CUnet基础上采用GAN方式进行微调。损失函数定义如下:

L t o t a l = L p e r c e p + 0.005 L G A N + 0.01 L M S E \mathcal{L}_{total} = \mathcal{L}_{percep}+0.005 \mathcal{L}_{GAN} + 0.01 \mathcal{L}_{MSE} Ltotal=Lpercep+0.005LGAN+0.01LMSE

Evaluation for Modulation Performance

Settings 我们采用LIVE1与CBSD68评估该模型,评价指标方面,我们选择LPIPS、DISTS评价GAN模型,PSNR评价PSNR导向模型。

上表给出了LIVE1数据集上的定量评价对比。从中可以看到:

- 在单退化方面,LPIPS/DISTS指标均低于0.0041/0.0068。这意味着所提CUGAN可以取得非常高的调制质量;

- 在双退化方面,CUGAN的性能要在多个退化水平高于UGAN。这意味着:当退化变得更复杂、更严重时,CUGAN具有更强的图像复原能力。

上图给出了所提方案的图像复原视觉效果对比:

- 通过调节条件向量,所提方案可以生成平滑而稳定的过度效果。

- 通过调节插值系数,我们可以得到视觉效果更佳的图像复原结果。

Comparison on Image Denoising

上表对比了在图像降噪方面的性能对比,从中可以看到:CUnet取得了与当前SOTA方案相当甚至更好的性能。

Modulation on Real-World Images

为进一步验证所提方案的泛化性能,我们在真实图像上进行了超分和降噪验证。

上图给出了所提方案与ESRGAN、SDSR、TDSR、RealSR等方案在DPED数据上的超分效果对比。可以看到:CUGAN可以取得极具竞争力的性能。

上表对比了所提方案在真实图像上降噪效果对比,可以看到:通过调制过程,我们可以得到无噪且清晰的复原结果。

Ablation Study

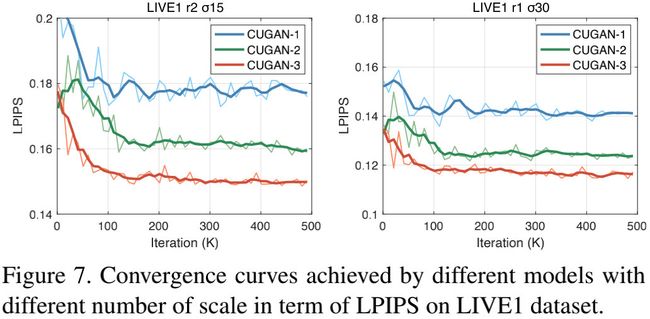

上图对比了多尺度架构的影响性,可以看到:三尺度CUGAN明显优于单尺度与双尺度版本。也就是说,相比朴素网络,多尺度架构对于基于GAN的调制复原更有效。

上图对比了判别器中的调制模块的影响性,可以看到:在所有退化类型方面,带有GFM的CUGAN显著优于其他方案。

推荐阅读

- NTIRE2020图像去模糊冠军方案分享,首次解决跨设备部署问题

- CVPR20201|港理工&达摩院张磊团队提出支持实时4K超高分辨率Image2Image的拉普拉斯金字塔变换网络

- 浙大&微软联合提出实时视频增强|RT-VENet

- 图像增强领域大突破!以1.66ms的速度处理4K图像,港理工提出图像自适应的3DLUT

- 超越RCAN,图像超分又一峰:RFANet

- 可控图像复原之CResMD

- CVPR2021 | 性能不变,计算量减少41%,国防科大提出加速图像超分高效推理的SMSR

- ACNet|增强局部显著特征,哈工大左旺孟老师团队提出非对称卷积用于图像超分

- 46FPS+1080Px2超分+手机NPU,arm提出一种基于重参数化思想的超高效图像超分方案

- CVPR2021|超分性能不变,计算量降低50%,董超等人提出用于low-level加速的ClassSR